핵심 요약

오픈소스 소프트웨어(OSS) 기업들은 많은 GitHub 스타를 보유하고도 이를 실제 매출로 전환하는 데 어려움을 겪는다. Clarm은 이 문제를 해결하기 위해 Vespa Cloud를 도입하여 텍스트, 벡터, 구조화된 검색을 통합한 하이브리드 검색 엔진을 구축했다. 이를 통해 수백만 개의 GitHub 데이터 포인트를 실시간으로 분석하고, 환각 현상 없는(Zero-hallucination) AI 응답을 제공하며 리드 생성 및 고객 지원을 자동화한다. 결과적으로 Clarm은 단 하루 만에 프로덕션 환경을 구축하고 고객사의 매출 성장을 견인하고 있다.

배경

RAG(Retrieval-Augmented Generation) 개념, 벡터 검색 및 하이브리드 검색 기초, GitHub API 및 데이터 구조 이해

대상 독자

AI 기반 B2B 솔루션 개발자 및 OSS 수익화를 고민하는 창업자

의미 / 영향

이 사례는 RAG 시스템에서 단순 벡터 검색의 한계를 지적하며, 정교한 랭킹과 하이브리드 검색이 실질적인 비즈니스 가치를 창출하는 핵심임을 보여준다. 특히 스타트업이 관리형 인프라를 통해 기술적 우위를 빠르게 확보하는 전략을 제시한다.

섹션별 상세

이미지 분석

기사의 핵심 주제인 Clarm이 Vespa Cloud를 사용하여 에이전트형 AI 영업 도구를 구축했음을 시각적으로 보여준다.

Clarm과 Vespa Cloud의 협업을 나타내는 로고 이미지.

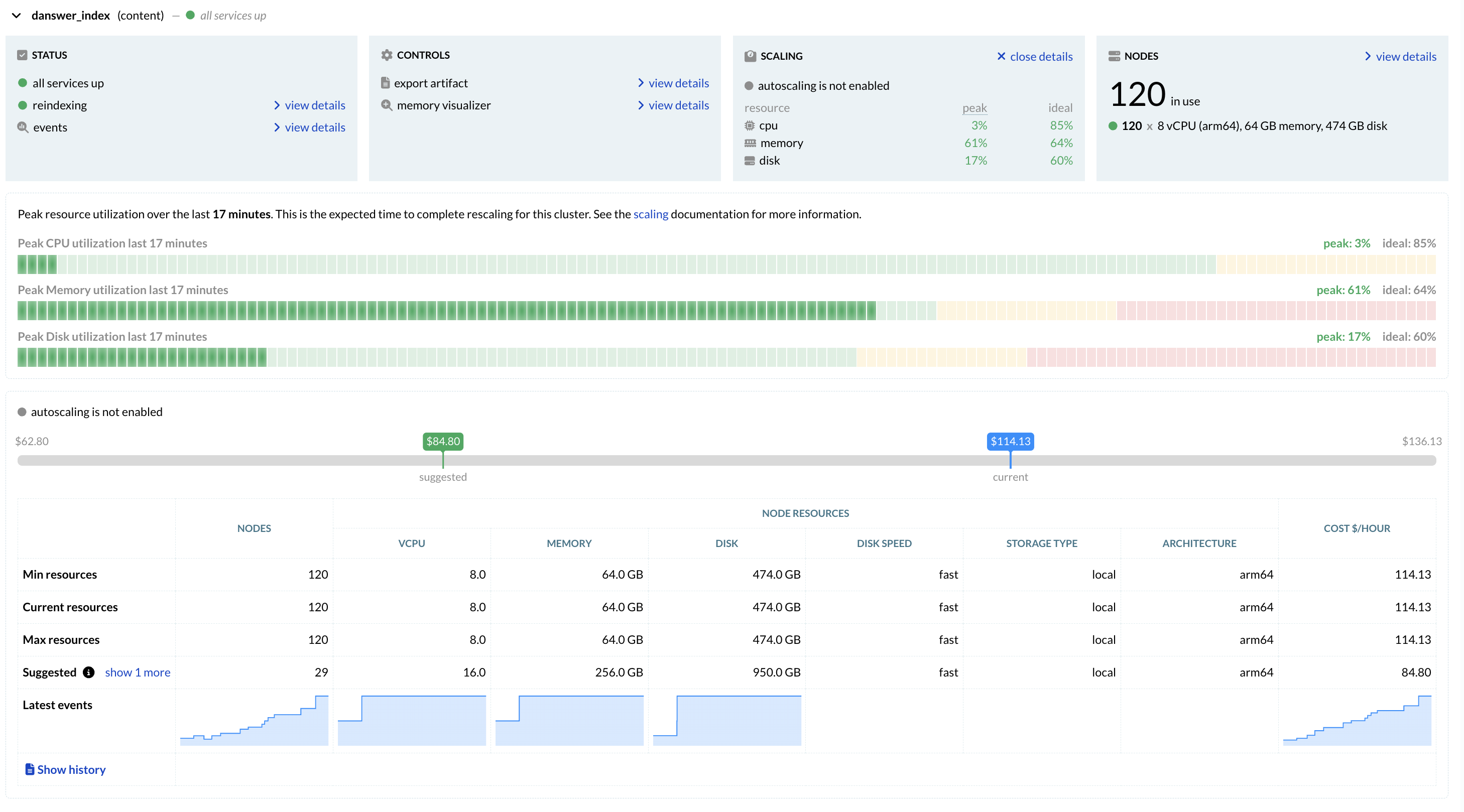

Vespa Cloud가 제공하는 자동 스케일링 및 비용 최적화 기능을 시각적으로 설명하며, 기사 하단에 언급된 리소스 최적화 사례 연구와 연결된다.

Vespa Cloud의 리소스 최적화 제안 대시보드 스크린샷.

실무 Takeaway

- LLM의 신뢰성은 그 뒤를 받치는 검색(Retrieval) 시스템의 성능에 직결되므로 하이브리드 검색 도입이 필수적이다.

- Vespa Cloud와 같은 관리형 서비스를 활용하면 복잡한 검색 인프라 구축 시간을 수주에서 단 하루로 단축할 수 있다.

- 벡터 전용 DB보다는 텍스트, 벡터, 구조화된 데이터를 통합 처리할 수 있는 엔진이 프로덕션 환경의 복잡한 비즈니스 로직 구현에 유리하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료