핵심 요약

임베딩 모델 선택 시 MTEB 리더보드 순위만으로는 실제 운영 환경의 지연 시간과 비용 효율성을 파악하기 어렵다. Vespa는 5억 파라미터 이하의 주요 모델들을 대상으로 모델 양자화, 벡터 정밀도, 하드웨어별 추론 속도를 직접 벤치마크하여 실질적인 트레이드오프 데이터를 산출했다. 결과적으로 ModernBERT 기반 모델은 이진 양자화 시에도 품질 저하가 거의 없으며 CPU 환경에서 INT8 양자화는 품질을 유지하면서도 추론 속도를 3배 이상 향상시킨다. 하이브리드 검색과 단계별 랭킹 아키텍처를 결합함으로써 성능과 비용의 최적점을 찾는 것이 가능하다.

배경

벡터 임베딩의 개념, 양자화(Quantization) 기초, Vespa 또는 유사 벡터 DB 사용 경험

대상 독자

벡터 검색 시스템을 설계하고 운영하는 ML 엔지니어 및 인프라 아키텍트

의미 / 영향

임베딩 모델의 선택 기준이 단순 품질 점수에서 하드웨어 효율성과 양자화 내성을 포함한 실전 지표로 전환될 것이다. 특히 ModernBERT와 같은 최신 아키텍처가 비용 효율적인 RAG 시스템 구축의 핵심 동력이 될 것으로 보인다.

섹션별 상세

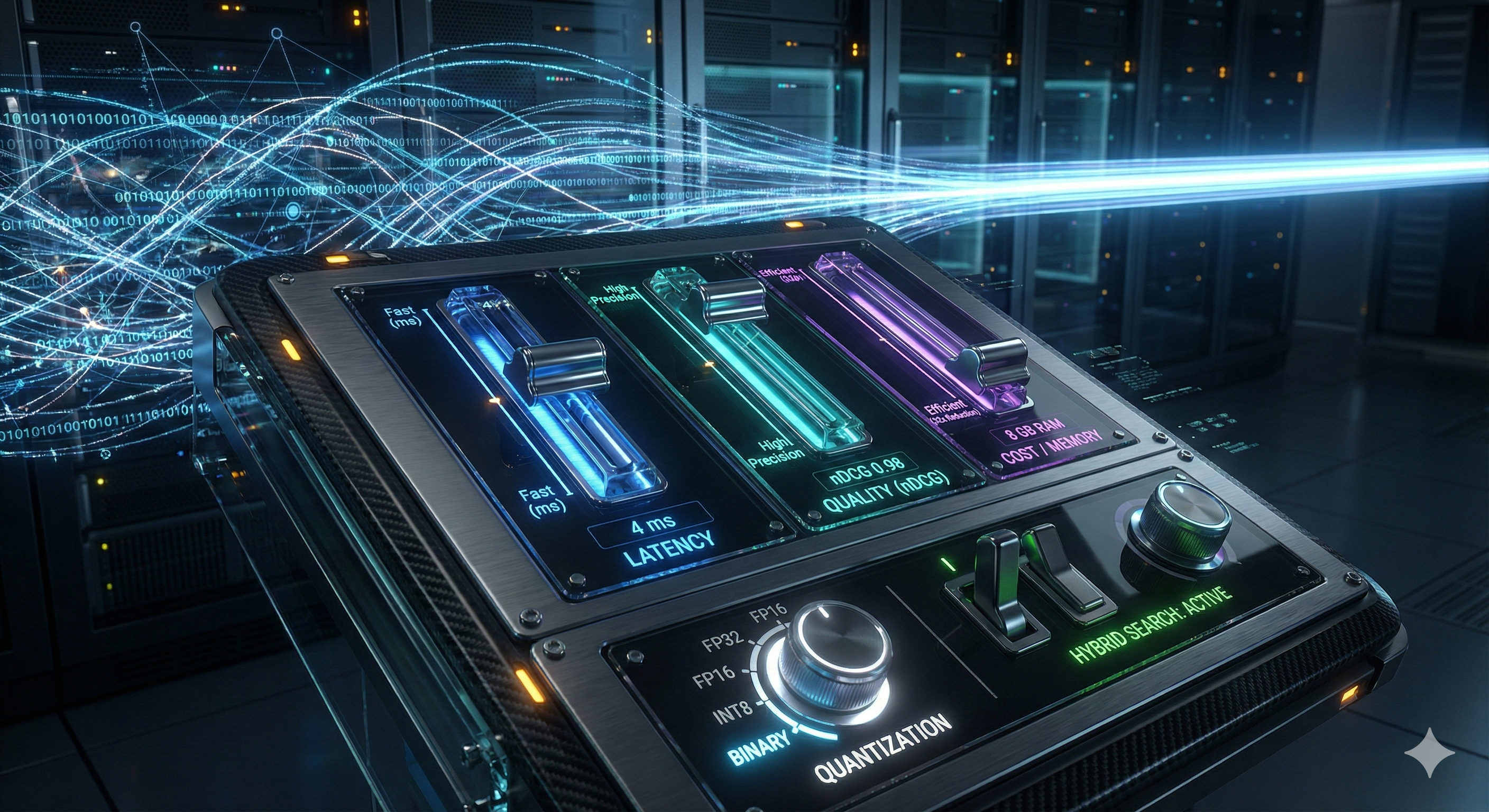

이미지 분석

사용자가 조절 가능한 다양한 변수들이 시스템 전체 성능에 미치는 영향을 직관적으로 이해하도록 돕는다. 지연 시간, 품질, 비용 사이의 트레이드오프를 정량적으로 관리해야 함을 나타낸다.

임베딩 모델 선택 시 고려해야 할 지연 시간, 품질, 비용 간의 상관관계를 대시보드 형태로 시각화했다.

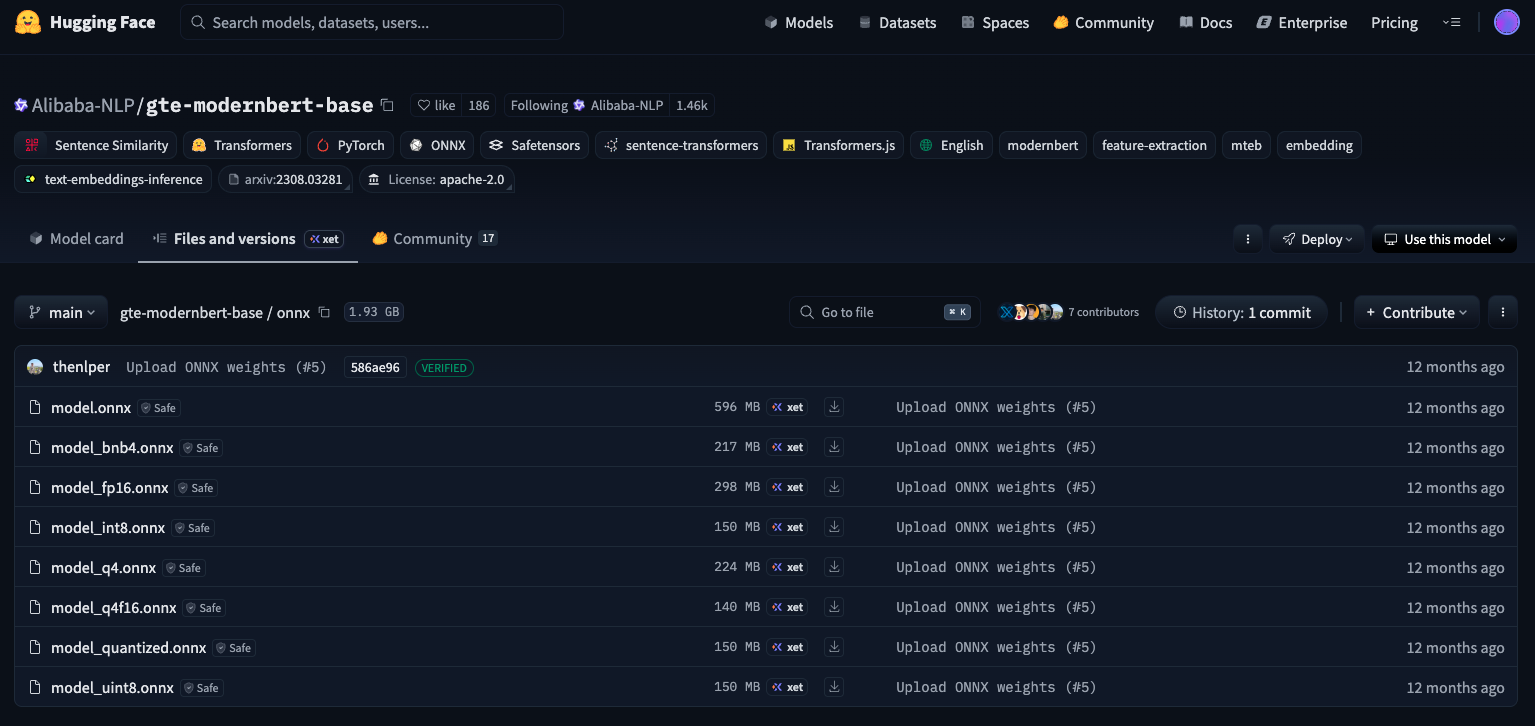

FP32, FP16, INT8 등 정밀도별로 준비된 파일들이 실제 추론 환경에서 선택 가능한 옵션임을 나타낸다. 모델 양자화가 실무에서 이미 보편적으로 지원되고 있음을 보여준다.

Hugging Face 저장소에 업로드된 다양한 ONNX 양자화 파일 목록을 확인 가능하다.

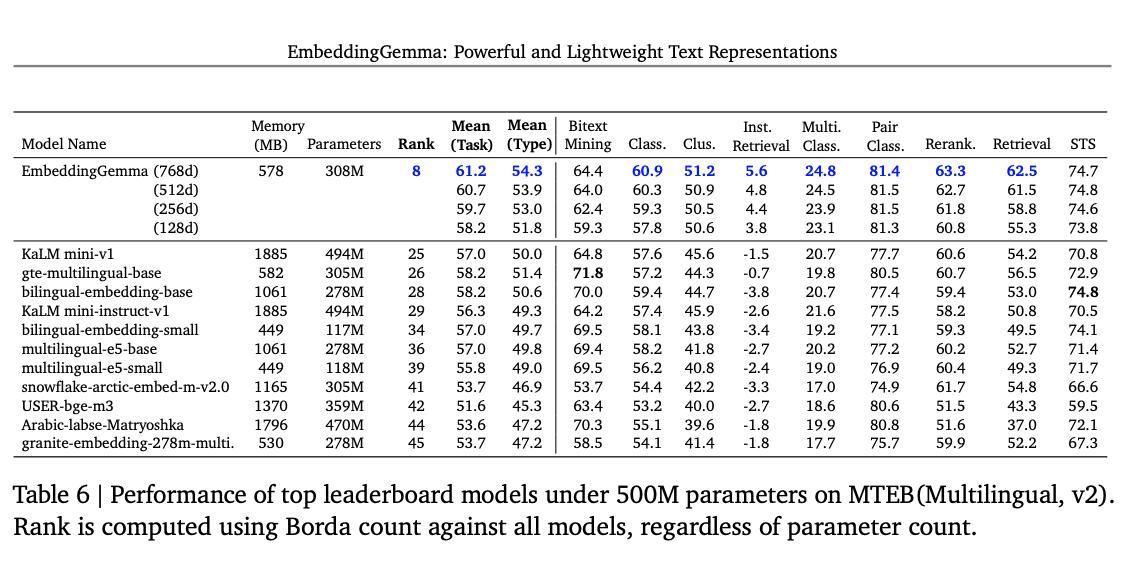

768차원보다 512차원에서 더 높은 점수를 기록하는 등 차원 축소가 성능에 미치는 실제 영향을 수치로 입증한다. 마트료시카 임베딩의 유연성과 효율성을 데이터로 뒷받침한다.

EmbeddingGemma 모델의 차원 수 변화에 따른 MTEB 벤치마크 성능 수치를 표로 정리했다.

실무 Takeaway

- CPU 환경에서는 INT8 모델 양자화를 통해 품질 손실을 최소화하면서 추론 속도를 3배 이상 향상시킬 수 있다.

- 메모리 비용이 병목인 경우 ModernBERT와 같은 이진화 친화적 모델을 선택하여 벡터 저장 공간을 32배 절감한다.

- 단일 벡터 검색에 의존하기보다 BM25를 결합한 하이브리드 검색을 기본으로 채택하여 검색 품질을 3-5%p 개선한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료