핵심 요약

데이터 증강은 기존 데이터를 지능적으로 변형하여 모델의 과적합을 방지하고 일반화 능력을 향상시키는 필수적인 기법이다. 이 가이드는 이미지의 기하학적 변형부터 텍스트의 유의어 교체, 오디오의 노이즈 주입, 정형 데이터의 수치 변동까지 데이터 유형별 최적의 증강 전략을 제시한다. 특히 실시간으로 변형을 생성하는 온라인 증강의 이점과 데이터 누수(Data Leakage)를 방지하기 위한 엄격한 데이터 분리 원칙을 강조한다. 이를 통해 제한된 데이터 환경에서도 고성능 AI 모델을 구축할 수 있는 실무적 통찰을 제공한다.

배경

Python 프로그래밍 기초, 머신러닝의 과적합(Overfitting) 및 일반화(Generalization) 개념, TensorFlow/Keras 또는 Pandas 라이브러리 사용 경험

대상 독자

데이터 부족으로 모델 성능 향상에 어려움을 겪는 ML 엔지니어 및 데이터 사이언티스트

의미 / 영향

데이터 증강은 고비용의 추가 데이터 수집 없이도 모델의 견고함을 높일 수 있는 가장 경제적인 방법이다. 특히 엣지 케이스나 실세계의 다양한 변수를 학습 단계에서 미리 반영함으로써 프로덕션 환경에서의 모델 신뢰도를 크게 향상시킨다.

섹션별 상세

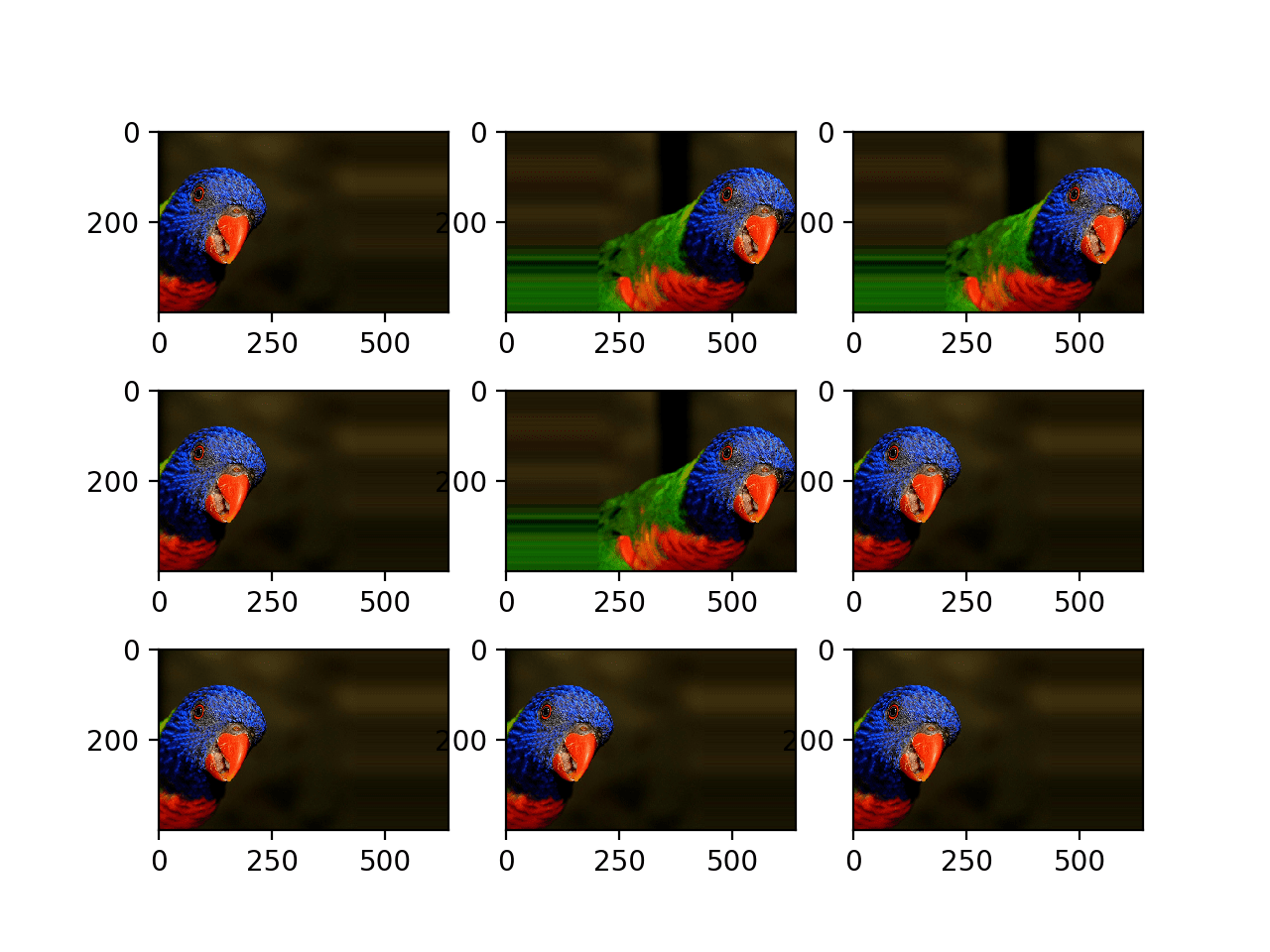

datagen = ImageDataGenerator(

rotation_range=15,

width_shift_range=0.1,

height_shift_range=0.1,

zoom_range=0.1,

shear_range=0.1,

fill_mode='nearest'

)TensorFlow/Keras를 사용하여 이미지 회전, 이동, 줌 등의 증강 파라미터를 설정하는 예시

def synonym_replacement(sentence):

words = sentence.split()

idx = random.randint(0, len(words) - 1)

synsets = wordnet.synsets(words[idx])

if synsets and synsets[0].lemmas():

replacement = synsets[0].lemmas()[0].name().replace("_", " ")

words[idx] = replacement

return " ".join(words)NLTK와 WordNet을 활용하여 문장 내 단어를 유의어로 교체하는 텍스트 증강 함수

noise = np.random.randn(len(audio))

audio_noisy = audio + 0.005 * noise

audio_stretched = librosa.effects.time_stretch(audio, rate=1.1)librosa를 사용하여 오디오 데이터에 백그라운드 노이즈를 추가하고 재생 속도를 조절하는 예시

실무 Takeaway

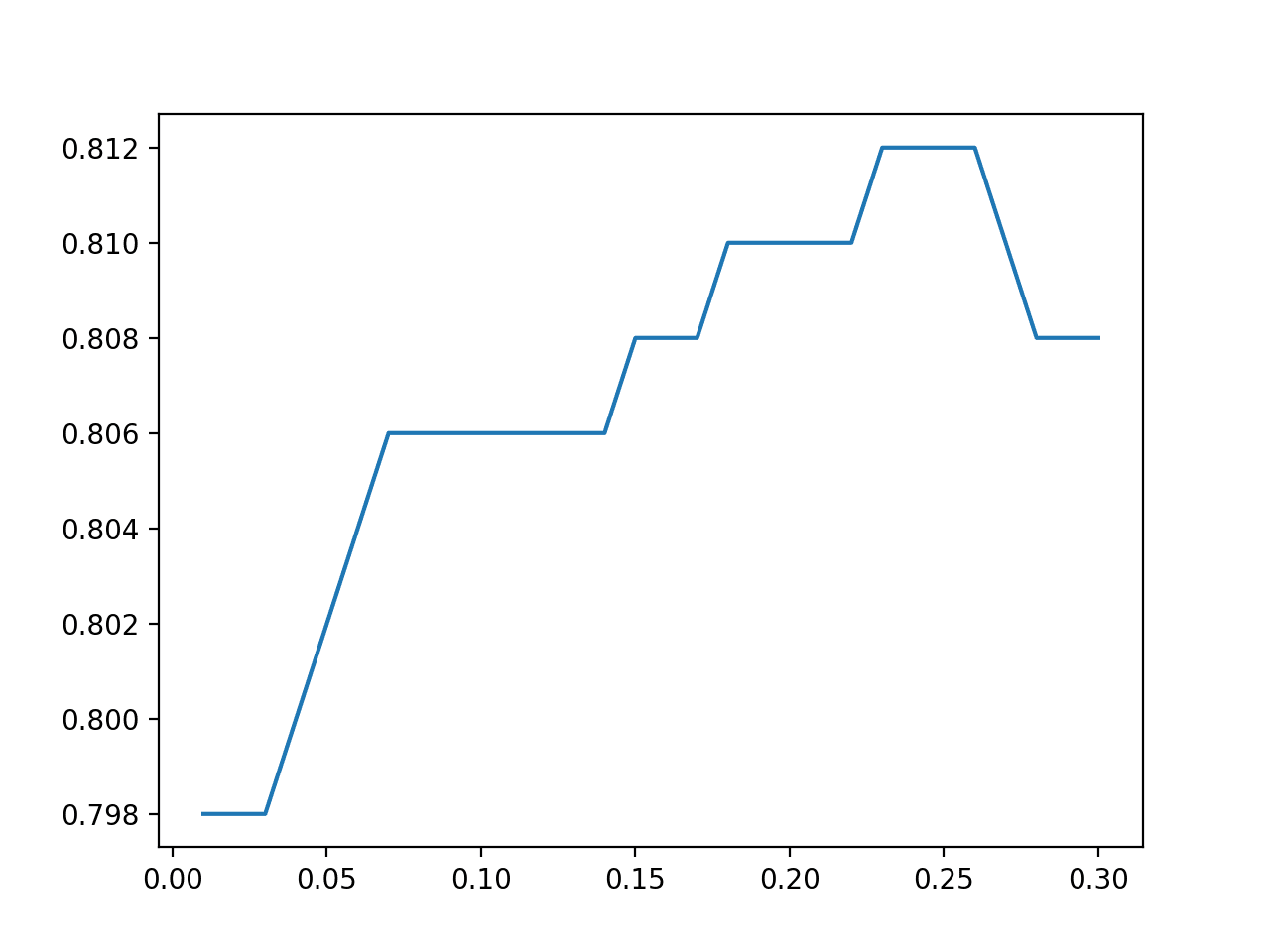

- 모델의 학습 정확도는 높으나 검증 정확도가 낮을 때 데이터 증강을 적용하면 과적합을 효과적으로 억제하고 일반화 성능을 개선할 수 있다.

- 딥러닝 모델 학습 시에는 ImageDataGenerator와 같은 도구를 활용하여 실시간 온라인 증강을 적용함으로써 저장 공간 효율과 데이터 다양성을 동시에 확보해야 한다.

- 데이터 누수를 방지하기 위해 데이터 증강 파이프라인은 반드시 학습 데이터셋에만 국한되어야 하며 검증 및 테스트 데이터는 원본 상태를 유지해야 한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.