핵심 요약

엔비디아는 CES 2026에서 차세대 AI 컴퓨팅 플랫폼인 '베라 루빈(Vera Rubin)'을 공식 발표했다. 이 플랫폼은 기존 블랙웰 아키텍처 대비 5배의 성능 향상을 제공하며, HBM4 메모리와 88개의 올림푸스 코어를 탑재한 베라 CPU를 특징으로 한다. 또한 메르세데스-벤츠와 협력하여 자율주행 차량이 인간처럼 사고할 수 있게 돕는 오픈 AI 모델 '알파마요(Alpamayo)'를 함께 공개했다. 이번 발표는 AI 인프라와 모빌리티 분야에서 엔비디아의 기술적 우위를 공고히 하려는 전략으로 풀이된다.

배경

GPU 아키텍처 기초, HBM(고대역폭 메모리) 개념, 자율주행 AI 모델링 이해

대상 독자

AI 인프라 엔지니어, 자율주행 기술 개발자, 하드웨어 전략 분석가

의미 / 영향

엔비디아는 매년 새로운 아키텍처를 출시하는 공격적인 로드맵을 유지하며 경쟁사와의 격차를 벌리고 있다. 특히 자율주행 모델의 오픈 소스화는 자동차 산업의 AI 도입 속도를 가속화할 것으로 예상된다.

섹션별 상세

이미지 분석

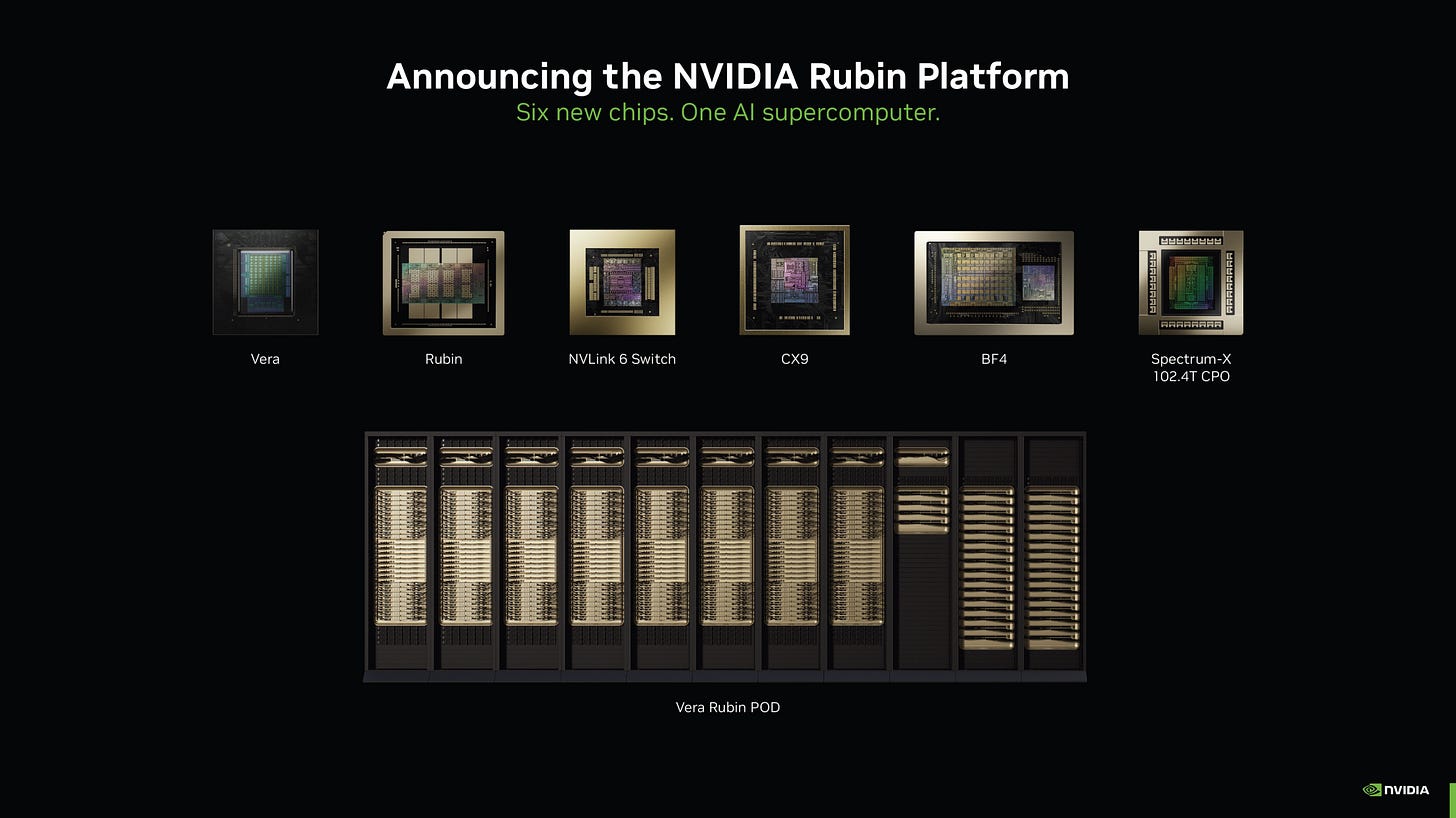

베라 CPU, 루빈 GPU, NVLink 6 스위치, CX9, BF4, Spectrum-X 등 플랫폼을 구성하는 핵심 반도체 라인업을 시각화했다. 하단에는 이 칩들이 집약된 'Vera Rubin POD' 서버 랙 구조를 보여주며 전체 시스템 아키텍처를 설명한다.

엔비디아 베라 루빈 플랫폼의 주요 구성 요소인 6개의 칩과 베라 루빈 POD 시스템 구성을 보여주는 이미지이다.

실무 Takeaway

- 베라 루빈 플랫폼은 블랙웰 대비 5배의 성능 향상을 달성하여 대규모 언어 모델 학습 및 추론 효율을 획기적으로 개선한다.

- HBM4 메모리와 88코어 베라 CPU의 조합은 메모리 대역폭 병목 현상을 해결하고 연산 밀도를 높이는 핵심 요소이다.

- 자율주행 모델 알파마요의 공개는 엔비디아가 하드웨어를 넘어 자율주행 소프트웨어 스택에서도 오픈 모델 생태계를 주도하려는 의지를 보여준다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료