핵심 요약

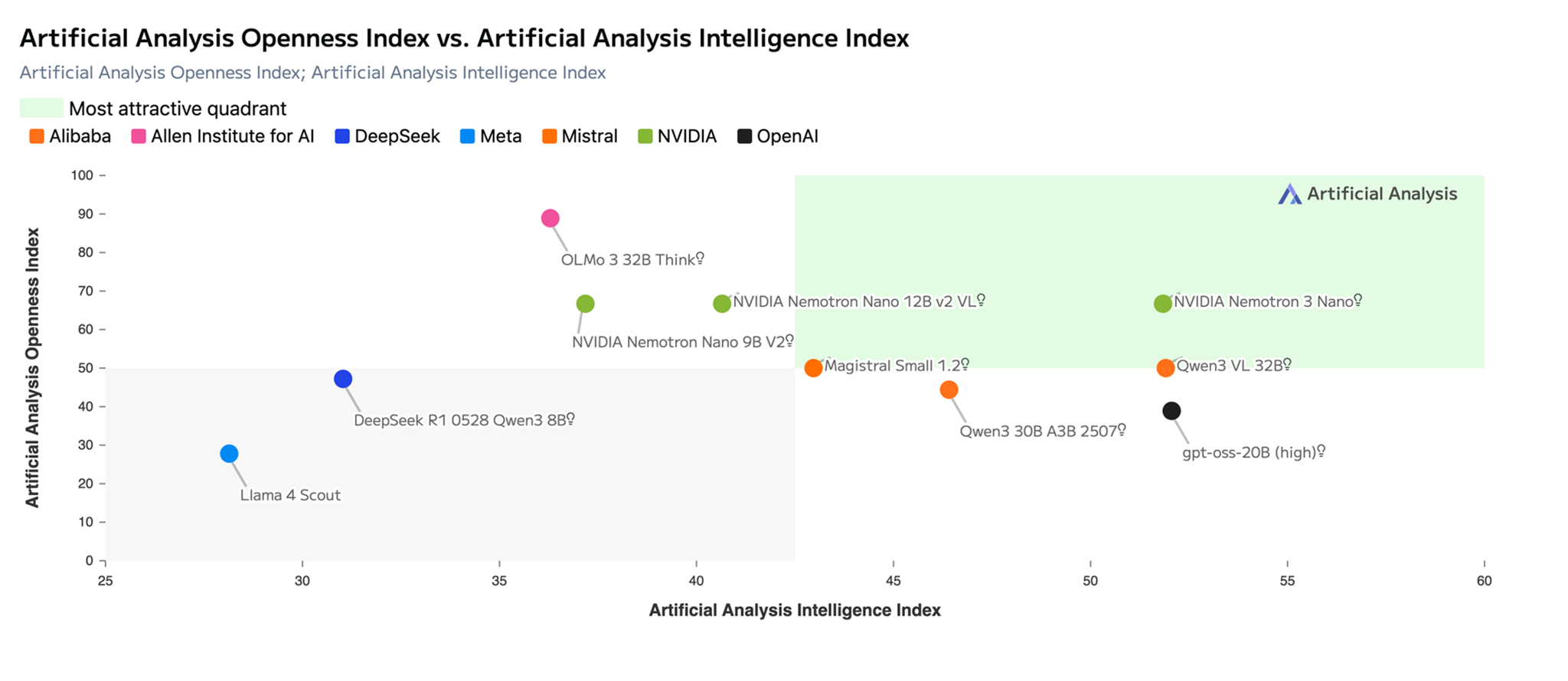

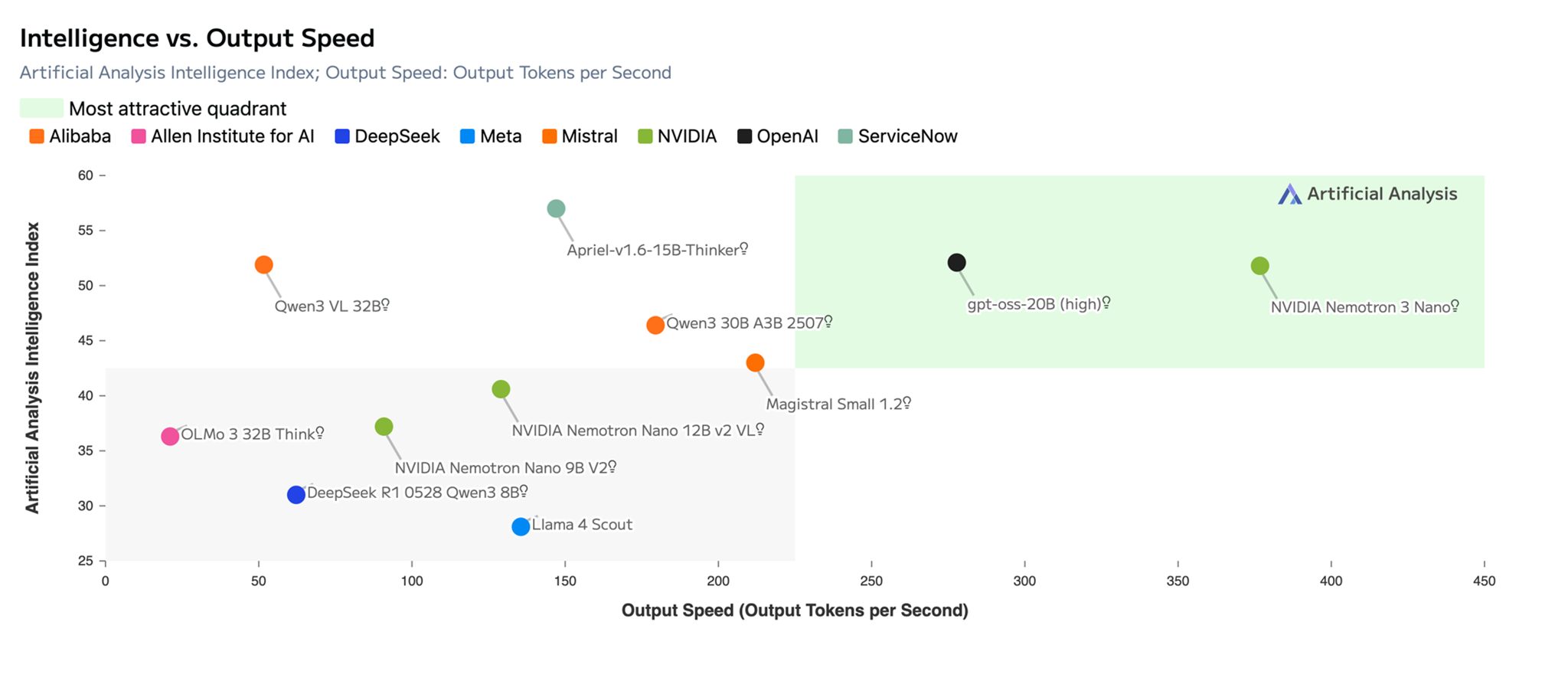

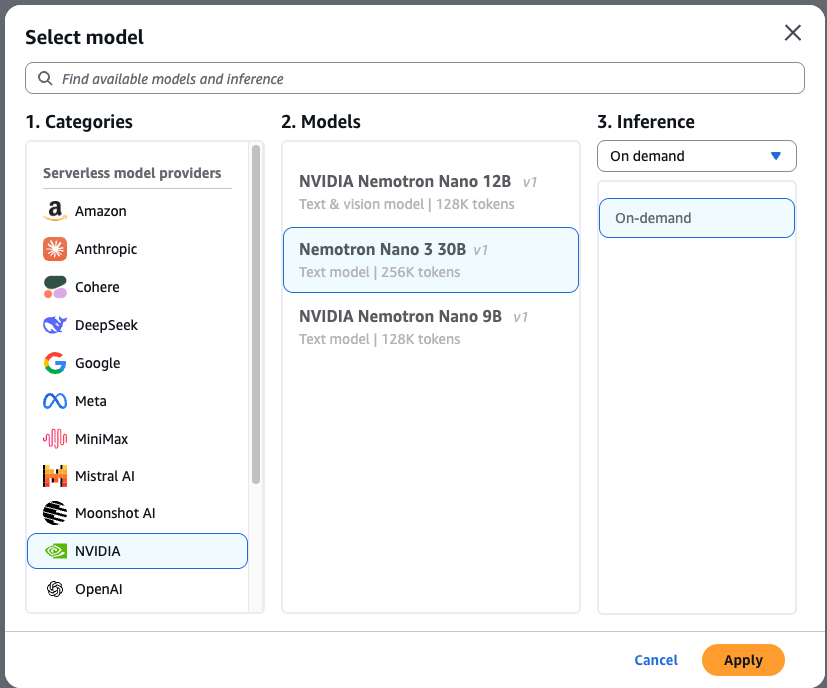

NVIDIA의 소형 언어 모델(SLM)인 Nemotron 3 Nano가 Amazon Bedrock에서 완전 관리형 서버리스 모델로 제공된다. 이 모델은 Transformer와 Mamba 아키텍처를 결합한 하이브리드 Mixture-of-Experts(MoE) 구조를 채택하여 추론 효율성과 정확도를 동시에 확보했다. 30B 파라미터 규모임에도 활성 파라미터는 3B에 불과하며, 256K의 긴 컨텍스트 길이를 지원해 복잡한 에이전트 워크플로우에 최적화되어 있다. 개발자는 Bedrock의 Guardrails 및 Knowledge Bases 기능을 활용해 안전하고 강력한 RAG 시스템을 구축할 수 있다.

배경

AWS 계정 및 Amazon Bedrock 권한, Python 및 Boto3 SDK 기본 지식, RAG 및 에이전트 아키텍처에 대한 이해

대상 독자

Amazon Bedrock을 사용하여 고성능 에이전트 및 RAG 시스템을 구축하려는 AI 개발자 및 아키텍트

의미 / 영향

SLM의 성능이 고도화됨에 따라 고비용 대형 모델 대신 Nemotron 3 Nano와 같은 효율적인 모델로 에이전트 워크플로우를 대체하여 운영 비용을 획기적으로 낮출 수 있게 되었다.

섹션별 상세

aws bedrock-runtime invoke-model \

--model-id nvidia.nemotron-nano-3-30b \

--region us-west-2 \

--body '{"messages": [{"role": "user", "content": "Type_Your_Prompt_Here"}], "max_tokens": 512, "temperature": 0.5, "top_p": 0.9}' \

--cli-binary-format raw-in-base64-out \

invoke-model-output.txtAWS CLI를 사용하여 Nemotron 3 Nano 모델을 직접 호출하는 예시

import boto3

client = boto3.client("bedrock-runtime", region_name="us-west-2")

model_id = "nvidia.nemotron-nano-3-30b"

conversation = [{"role": "user", "content": [{"text": "Type_Your_Prompt_Here"}]}]

response = client.converse(

modelId=model_id,

messages=conversation,

inferenceConfig={"maxTokens": 512, "temperature": 0.5, "topP": 0.9}

)Boto3 SDK의 Converse API를 사용하여 모델과 대화를 수행하는 파이썬 코드

from openai import OpenAI

client = OpenAI(base_url="https://bedrock-runtime.<region>.amazon.com/openai/v1")

response = client.chat.completions.create(

model="nvidia.nemotron-nano-3-30b",

messages=[{"role": "user", "content": "Hello!"}]

)Amazon Bedrock의 OpenAI 호환 엔드포인트를 사용하는 방법

실무 Takeaway

- 에이전트 기반 시스템 구축 시 Nemotron 3 Nano의 하이브리드 MoE 아키텍처를 활용하면 3B 모델 수준의 비용으로 30B급의 고성능 추론 결과를 얻을 수 있다.

- 256K의 긴 컨텍스트가 필요한 RAG 시스템에서 Amazon Bedrock Knowledge Bases와 연동하여 대규모 기술 문서나 법률 데이터를 효율적으로 처리할 수 있다.

- 금융이나 의료 등 규제가 엄격한 산업군에서는 Bedrock Guardrails를 적용하여 특정 주제에 대한 답변을 제한하고 개인정보 노출을 방지하는 안전 장치를 마련해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.