핵심 요약

DeepSeek는 추론 능력을 대폭 강화한 오픈 소스 모델 DeepSeek-V3.2와 DeepSeek-V3.2-Speciale를 공개했다. 이 모델들은 Hugging Face를 통해 배포되었으며 DeepSeek 앱에서도 즉시 사용 가능하다. 벤치마크 결과에 따르면 수학, 코딩, 에이전트 능력 등 다양한 지표에서 GPT-5-High 및 Gemini-3.0-Pro와 대등하거나 이를 능가하는 성능을 보여준다. 이번 출시는 고성능 추론 모델 시장의 경쟁을 더욱 가속화할 것으로 전망된다.

배경

LLM 추론 메커니즘 이해, Hugging Face 모델 사용법, 벤치마크 지표(AIME, Codeforces 등)에 대한 기본 지식

대상 독자

AI 연구원, LLM 애플리케이션 개발자, 오픈 소스 모델 활용 기업

의미 / 영향

고성능 추론 모델의 오픈 소스화는 독점적 AI 모델에 대한 의존도를 낮추고 연구 및 산업 전반의 기술 상향 평준화를 이끌 것이다. 특히 비용 효율적인 고성능 모델의 등장은 복잡한 추론이 필요한 AI 에이전트 시장의 확장을 가속화할 것으로 보인다.

섹션별 상세

이미지 분석

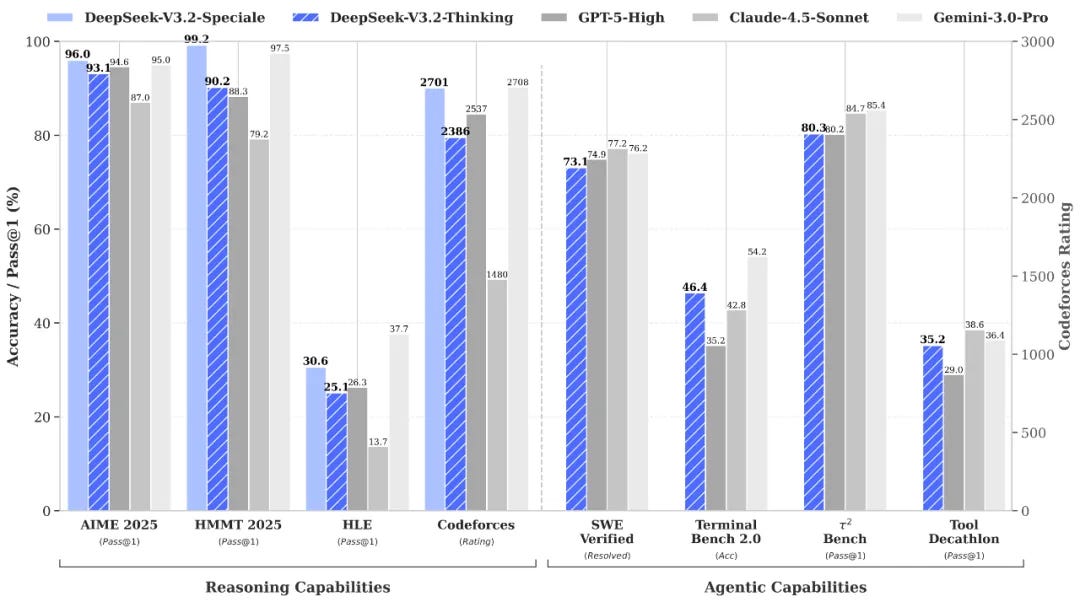

DeepSeek-V3.2-Speciale 모델이 AIME 2025(96.0%)와 HMMT 2025(99.2%)에서 최고 수준의 성적을 기록했음을 보여준다. 또한 Codeforces 레이팅에서 2701점을 기록하며 GPT-5-High(2537점)를 앞서는 등 코딩과 수학적 추론 영역에서의 우위를 시각화한다.

DeepSeek-V3.2 시리즈와 주요 경쟁 모델들의 추론 및 에이전트 역량 벤치마크 비교 차트이다.

실무 Takeaway

- DeepSeek-V3.2는 오픈 소스임에도 불구하고 폐쇄형 모델인 GPT-5-High 및 Gemini-3.0-Pro와 대등한 추론 성능을 제공한다.

- 수학(AIME 96.0%) 및 코딩(Codeforces 2701) 분야에서 압도적인 수치를 기록하며 전문적인 기술 작업에 적합함을 보여준다.

- 에이전트 역량(Agentic Capabilities) 지표에서도 높은 점수를 기록하여 자율적인 도구 사용 및 문제 해결 시나리오에 활용 가능하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료