이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

강화학습(RL)은 연구실을 벗어나 기업용 AI 에이전트의 신뢰성을 높이는 핵심 도구로 진화하고 있다. 최근 구인 공고 분석 결과, RL은 생성형 AI 및 인프라와 밀접하게 연계되어 있으며 특히 자율 워크플로우 분야에서 활발히 도입되고 있다. 수익 최적화부터 과학적 발견에 이르기까지 8개 주요 도메인에서 RL이 적용되는 구체적인 방식과 안전한 배포 패턴을 제시한다. RL은 이제 단순한 연구 주제가 아니라 복잡한 비즈니스 프로세스를 자동화하기 위한 실무적인 최적화 수단으로 활용된다.

배경

Reinforcement Learning 기초 개념, LLM Fine-tuning (SFT/RLHF) 프로세스 이해, Ray 프레임워크에 대한 기본 지식

대상 독자

AI 에이전트를 프로덕션에 도입하려는 엔지니어 및 ML 팀 리더

의미 / 영향

RL은 더 이상 연구용이 아니며 에이전트의 실행력을 보장하는 실무적인 최적화 도구로 자리 잡았다. 이는 AI 시스템이 말하는 도구에서 일하는 주체로 전환되는 기술적 토대가 될 것이다.

섹션별 상세

RL의 역할 변화: 단순 텍스트 생성을 넘어 CRM 조작, 클라우드 터미널 실행, 문서 구조화 등 복잡한 비즈니스 작업을 수행하는 에이전트의 신뢰성을 확보하는 사후 학습(Post-training) 단계의 필수 기술이 되었다.

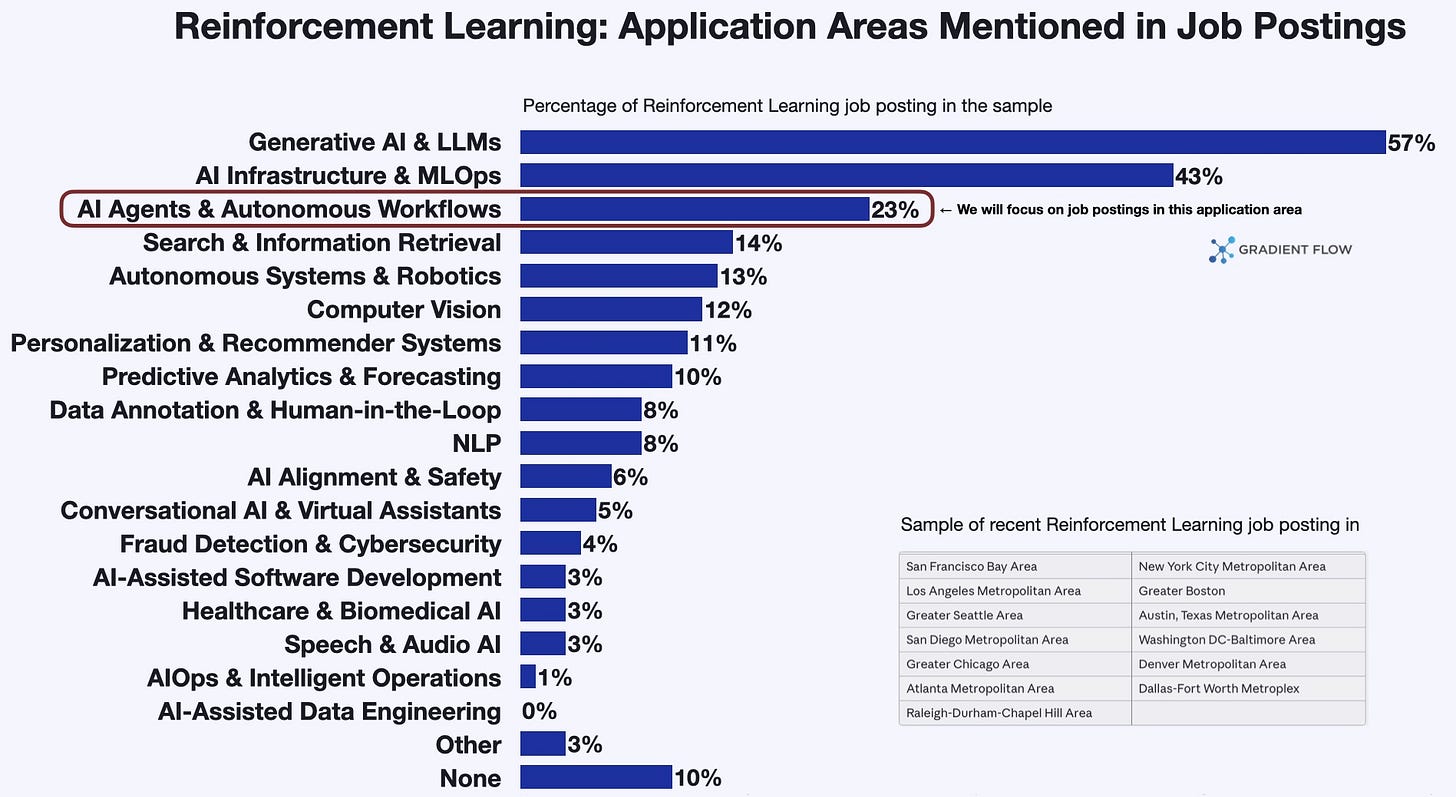

시장 수요 분석: 미국 주요 기술 허브의 구인 공고를 분석한 결과, RL은 생성형 AI(57%)와 AI 인프라(43%) 분야에서 가장 많이 언급되며 자율 에이전트(23%)가 그 뒤를 잇는 핵심 역량으로 부상했다.

8대 적용 도메인: 광고 수익 최적화, 소프트웨어 리팩터링, 백오피스 자동화, 레드팀 보안, 심층 정보 합성, 공급망 관리, 과학적 발견, 에이전트 오케스트레이션 레이어 등에서 RL이 의사결정 정책을 고도화하는 데 사용된다.

안전한 배포 패턴: 실제 운영 환경에서의 위험을 최소화하기 위해 로그 기반의 오프라인 RL로 시작하여 시뮬레이션 학습, 안전 필터 적용, 단계적 자율성 확대(제안 후 확인에서 제한적 자율로 이행) 순으로 배포가 이루어진다.

기술 스택의 표준화: Verl, OpenRLHF, NeMo-RL 등 거의 모든 주요 오픈소스 RL 프레임워크가 Ray를 오케스트레이터로 채택하여 분산 학습 및 추론 인프라를 구축하고 있다.

실무 Takeaway

- 반복적인 도구 사용(Tool Use)이 필요한 워크플로우에 RL을 적용하여 에이전트의 성공률을 높이고 재시도 횟수를 줄이는 신뢰할 수 있는 습관을 형성할 수 있다.

- 실제 환경에서의 직접 탐색은 위험하므로 운영 로그를 활용한 오프라인 RL과 시뮬레이션 환경을 먼저 구축하여 안전한 정책 학습 기반을 마련해야 한다.

- 에이전트 오케스트레이션 레이어에 RL을 도입하면 하드코딩된 규칙 대신 지연 시간과 비용 제약 조건을 고려한 최적의 도구 선택 및 라우팅 정책을 학습시킬 수 있다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 03. 10.수집 2026. 03. 10.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.