핵심 요약

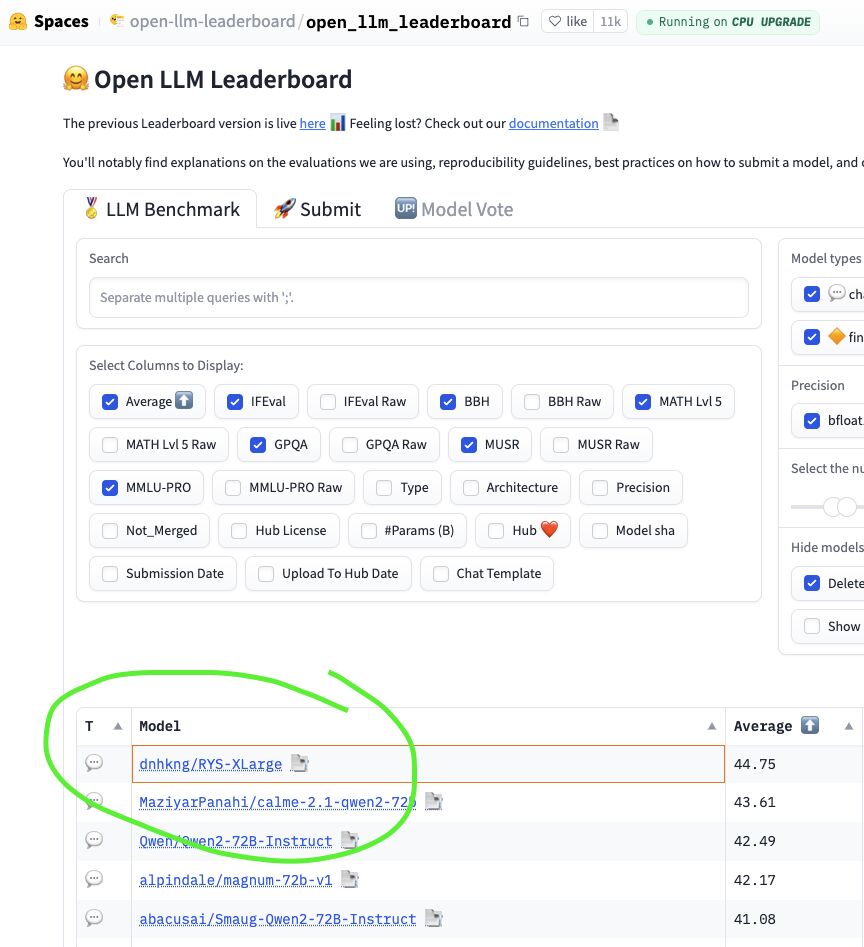

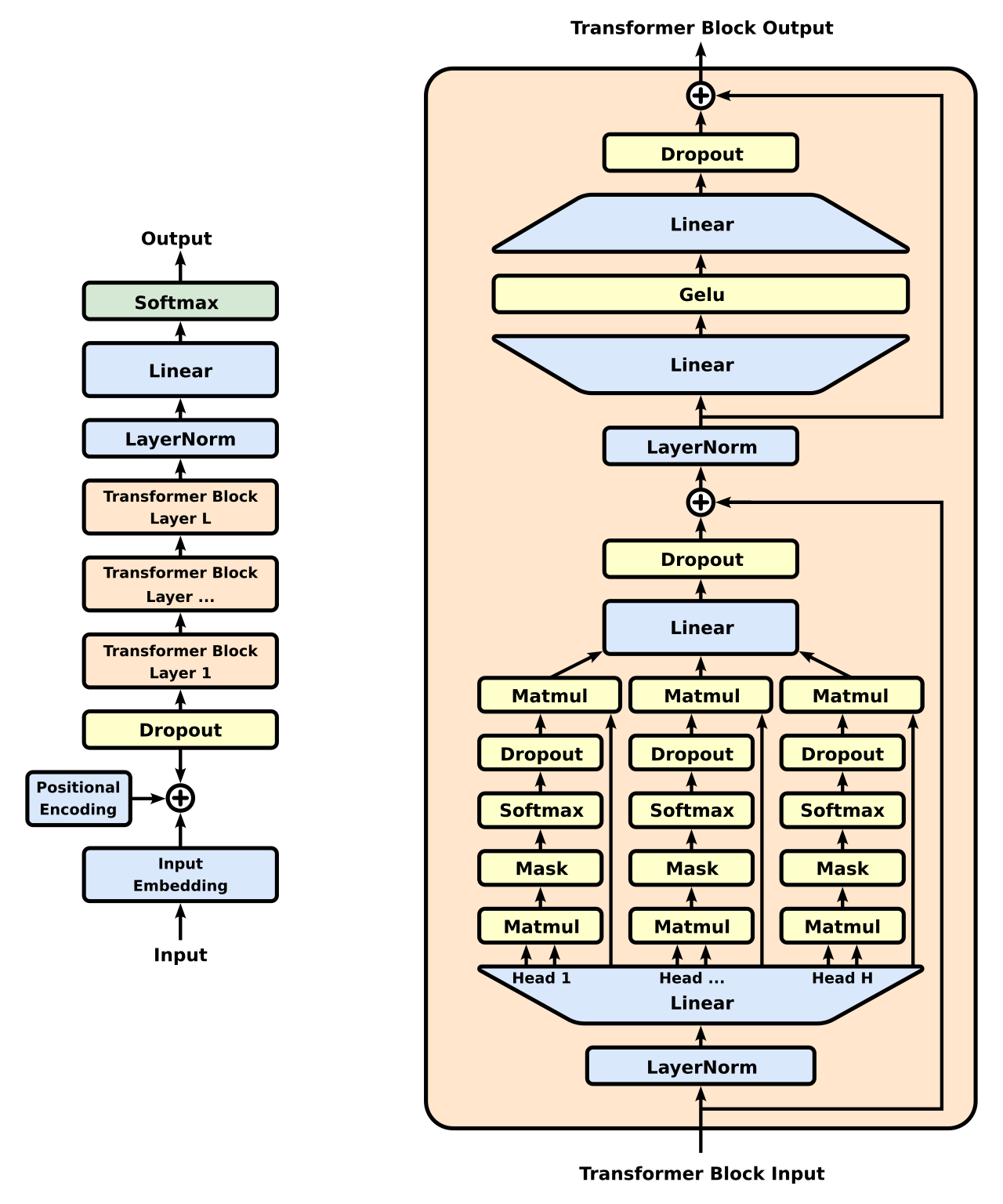

대형 언어 모델(LLM)의 중간 레이어가 추상적 추론을 담당하는 '신경 피질' 역할을 한다는 가설을 바탕으로, 특정 레이어 범위를 중복 실행하는 '레이어 복제' 기법을 제안한다. 저자는 Qwen2-72B 모델을 대상으로 모든 레이어 조합을 테스트하는 '브레인 스캐너' 파이프라인을 구축하고, 수학과 감성 지능(EQ)을 지표로 최적의 블록을 찾아냈다. 결과적으로 7개의 중간 레이어를 복제한 RYS-XLarge 모델은 추가 학습 없이도 주요 벤치마크에서 성능 향상을 보이며 오픈 LLM 리더보드 1위를 기록했다. 이는 LLM의 내부 구조가 단순한 나열이 아닌 특정 기능을 수행하는 '회로(Circuit)' 단위로 구성되어 있음을 시사한다.

배경

Transformer 아키텍처에 대한 깊은 이해, LLM 추론 및 레이어 구조 지식, 벤치마크 평가 지표(MMLU, MATH 등)에 대한 이해

대상 독자

LLM 아키텍처 및 성능 최적화에 관심 있는 AI 엔지니어 및 연구자

의미 / 영향

이 연구는 거대 모델의 성능 향상이 반드시 막대한 비용의 추가 학습을 통해서만 가능한 것이 아님을 보여준다. 레이어 복제 기법은 기존 모델의 잠재력을 저비용으로 끌어올릴 수 있는 새로운 스케일링 패러다임을 제시하며, 모델 내부의 기능적 회로 구조를 이해하는 것이 성능 최적화의 핵심임을 시사한다.

섹션별 상세

실무 Takeaway

- LLM의 중간 레이어는 독립적인 연산이 아닌 여러 레이어가 하나의 회로로 묶여 작동하므로, 성능 향상을 위해서는 단일 레이어가 아닌 블록 단위의 복제가 필요하다.

- 추가적인 GPU 메모리 점유 없이 레이어 포인터 복제만으로도 모델의 추론 능력을 확장하고 리더보드 벤치마크 성능을 개선할 수 있다.

- 모델의 크기가 커질수록 인코딩, 추론, 디코딩 기능이 더 명확하게 분리되는 경향이 있어 대형 모델일수록 이러한 신경해부학적 접근이 더 효과적이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.