핵심 요약

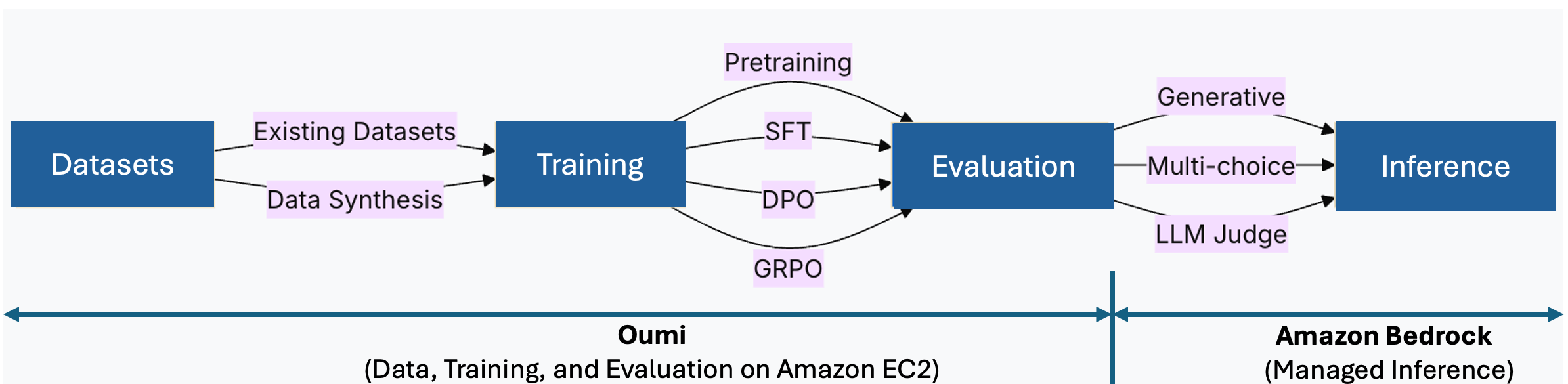

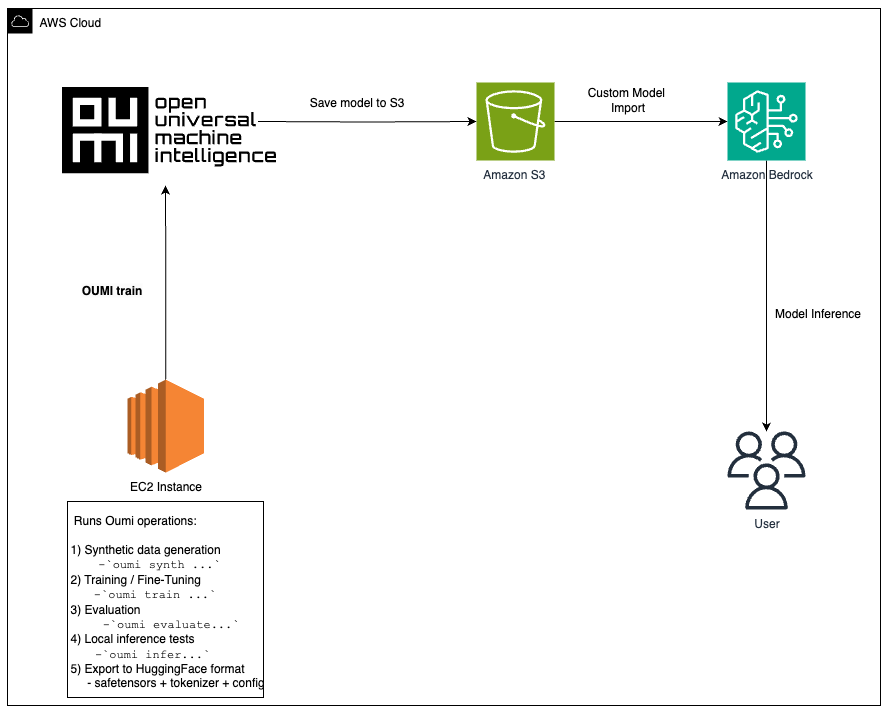

대형 언어 모델(LLM)의 파인튜닝은 실험 단계에서 프로덕션 배포로 넘어갈 때 도구의 파편화와 인프라 관리의 복잡성이라는 문제에 직면한다. 오픈소스 시스템인 Oumi는 데이터 준비, 학습, 평가 과정을 단일 구성 파일로 관리하여 이러한 마찰을 줄여준다. 본 가이드에서는 Amazon EC2에서 Oumi를 사용하여 Llama 3.2-1B-Instruct 모델을 파인튜닝하고, 결과물을 Amazon Bedrock의 Custom Model Import 기능을 통해 서버리스 환경으로 배포하는 방법을 제시한다. 이를 통해 개발자는 학습의 유연성과 배포의 편의성을 동시에 확보할 수 있다.

배경

AWS 계정 및 EC2, S3, Bedrock 권한, GPU 최적화 인스턴스 (g6.12xlarge 등) 사용 가능 여부, Hugging Face 계정 및 Llama 모델 접근 권한, AWS CLI v2 및 Python 환경

대상 독자

AWS 환경에서 오픈소스 LLM을 파인튜닝하고 효율적으로 배포하고자 하는 ML 엔지니어 및 개발자

의미 / 영향

이 워크플로는 오픈소스 모델의 유연한 학습과 클라우드 관리형 서비스의 안정적인 배포를 결합하는 표준 패턴을 제시한다. 특히 중소규모 기업이 고가의 GPU 인프라를 직접 운영하지 않고도 맞춤형 LLM 서비스를 프로덕션 수준으로 빠르게 출시할 수 있게 한다.

섹션별 상세

./scripts/import-to-bedrock.sh --model-name my-fine-tuned-llama --s3-uri s3://$S3_BUCKET/$S3_PREFIX --role-arn $BEDROCK_ROLE_ARN --waitS3에 저장된 모델 아티팩트를 Amazon Bedrock의 Custom Model Import로 등록하는 과정

./scripts/fine-tune.sh --config configs/oumi-config.yaml --output-dir models/final정의된 레시피 구성을 바탕으로 Llama 모델의 파인튜닝을 시작하는 스크립트 실행

oumi synth -c configs/synthesis-config.yamlOumi의 데이터 합성 기능을 사용하여 학습용 데이터셋을 생성하는 명령어

oumi evaluate -c configs/evaluation-config.yaml학습이 완료된 모델을 MMLU 등의 벤치마크를 통해 평가하는 명령어

실무 Takeaway

- Oumi의 레시피 기반 설정을 활용하면 파인튜닝 실험의 모든 파라미터를 코드화하여 관리함으로써 운영 효율성을 극대화할 수 있다.

- Amazon Bedrock Custom Model Import를 적용하면 자체 학습 모델에 대해서도 GPU 프로비저닝 없는 자동 확장 추론 환경을 구축할 수 있다.

- 실제 데이터가 부족한 초기 프로젝트 단계에서는 Oumi의 합성 데이터 생성 기능을 통해 학습 파이프라인의 병목 현상을 해결할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.