핵심 요약

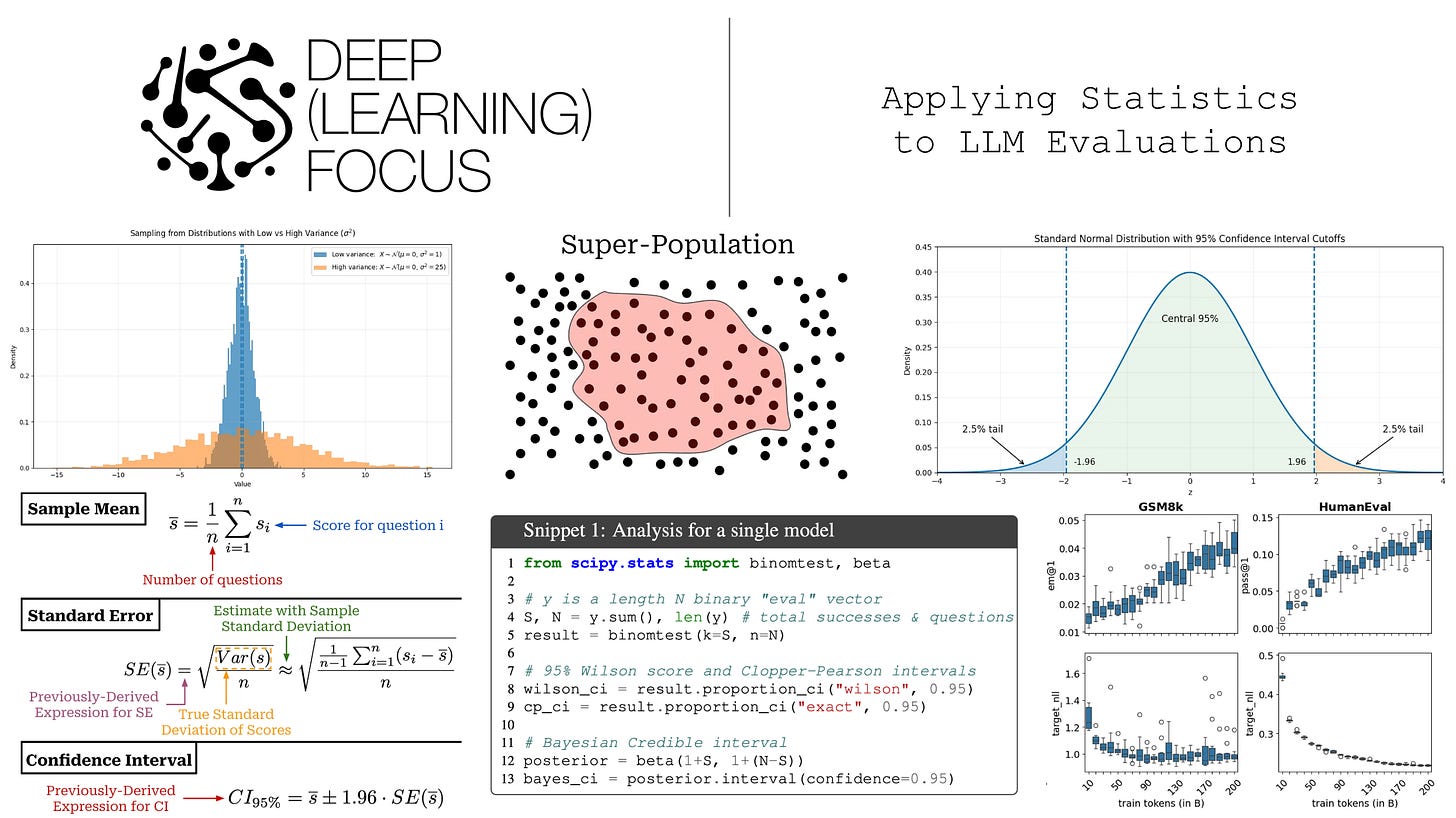

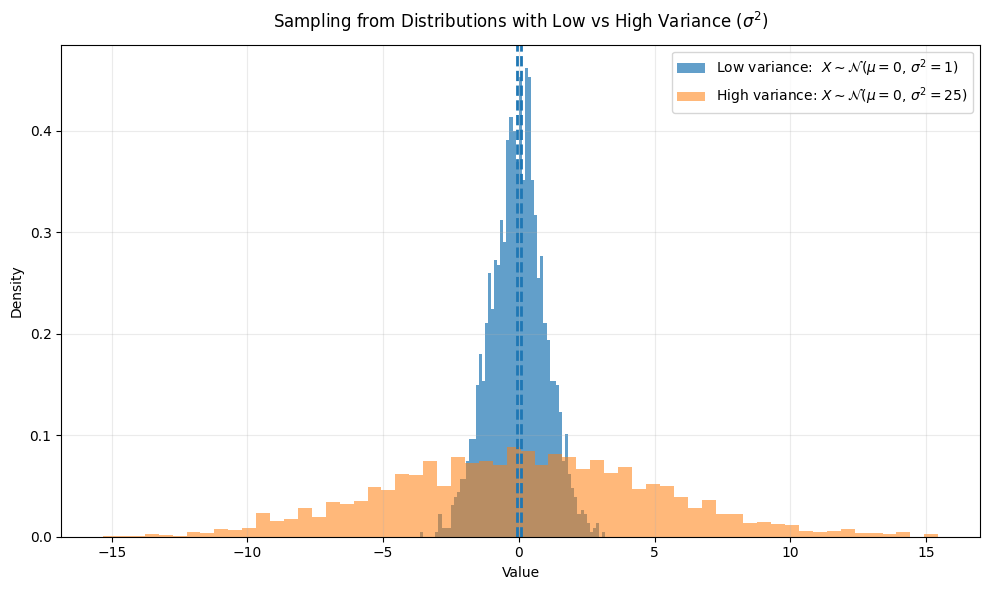

LLM 연구는 실험 중심적이지만, 현재의 평가는 통계적 유의성을 고려하지 않은 채 단순 평균 점수만 비교하는 나이브한 방식에 머물러 있다. 이 글은 평가 결과의 불확실성을 정량화하고 노이즈를 줄이기 위한 통계적 프레임워크를 제시한다. 표준 오차와 신뢰 구간을 통해 점수의 신뢰도를 측정하고, 재표본 추출과 쌍체 비교를 통해 평가의 효율성을 극대화하는 방법을 다룬다. 결과적으로 통계적으로 근거 있는 평가 방식을 도입함으로써 가짜 진보를 걸러내고 모델 개발 속도를 높일 수 있다.

배경

기초 통계학 (평균, 분산, 정규 분포), Python 프로그래밍 및 NumPy 활용 능력, LLM 평가 지표(Accuracy, MMLU 등)에 대한 이해

대상 독자

LLM 평가 시스템을 구축하거나 벤치마크 결과를 분석하는 연구자 및 엔지니어

의미 / 영향

이 가이드는 LLM 평가의 표준을 단순 수치 보고에서 통계적 검증으로 격상시킵니다. 이를 통해 모델 개발 과정에서 발생하는 무의미한 반복 실험을 줄이고, 실제 성능 향상을 가져오는 변경 사항에만 집중할 수 있게 하여 업계 전반의 R&D 효율성을 높일 것입니다.

섹션별 상세

from scipy.stats import binomtest, beta

# y is a length N binary "eval" vector

S, N = y.sum(), len(y) # total successes & questions

result = binomtest(k=S, n=N)

# 95% Wilson score and Clopper-Pearson intervals

wilson_ci = result.proportion_ci("wilson", 0.95)

cp_ci = result.proportion_ci("exact", 0.95)

# Bayesian Credible interval

posterior = beta(1+S, 1+(N-S))

bayes_ci = posterior.interval(confidence=0.95)단일 모델의 이진 평가 결과에 대해 빈도주의 및 베이지안 방식으로 신뢰 구간을 계산하는 예시

def paired_differences(scores_a, scores_b, clusters):

# ... (중략)

diffs = scores_a - scores_b

mean_diff = np.mean(diffs)

se_paired_clt = np.std(diffs, ddof=1) / np.sqrt(len(diffs))

# 95% CI for the difference

ci_paired_clt = (mean_diff - 1.96 * se_paired_clt,

mean_diff + 1.96 * se_paired_clt)

return {"mean_diff": mean_diff, "se_paired_clt": se_paired_clt, "ci_paired_clt": ci_paired_clt}동일 질문 세트에서 두 모델의 점수 차이를 분석하여 통계적 유의성을 검정하는 쌍체 비교 로직

실무 Takeaway

- 새로운 벤치마크 설계 시 검정력 분석 공식을 사용하여 목표 성능 차이($\delta$)를 감지하기 위한 최소 질문 수($n$)를 산출하여 데이터셋 크기를 결정하라.

- 모델 간 순위를 매길 때 단순 점수 차이가 아닌 신뢰 구간의 중첩 여부를 확인하여 통계적으로 유의미한 차이인지 반드시 검증하라.

- 이산적인 정답 여부(0/1)보다 로그 가능도(Log-likelihood)와 같은 연속적 지표를 사용하면 신호 대 잡음비(SNR)를 높여 평가의 안정성을 확보할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.