핵심 요약

Together AI는 비디오 생성, 아바타 합성 등 맞춤형 생성형 미디어 모델을 효율적으로 배포할 수 있는 '전용 컨테이너 추론(Dedicated Container Inference)' 서비스를 출시했다. 이 서비스는 기존 LLM 중심의 추론 방식에서 벗어나 GPU 집약적인 미디어 워크로드에 특화된 작업 오케스트레이션 레이어를 제공한다. 사용자는 Docker 컨테이너만 준비하면 자동 확장, 큐 관리, 트래픽 격리 및 모니터링 기능을 즉시 활용할 수 있다. 특히 Together GPU Cloud에서 학습한 모델은 별도의 데이터 이전 없이 즉시 배포가 가능하여 운영 효율성을 극대화한다.

배경

Docker 컨테이너화 기술, GPU 기반 추론 워크로드에 대한 이해, 기본적인 네트워크 및 API 통합 지식

대상 독자

맞춤형 비디오/미디어 생성 모델을 프로덕션 환경에 배포하려는 ML 엔지니어 및 개발팀

의미 / 영향

이 서비스는 LLM에 편중되었던 AI 인프라 시장에서 비디오 및 미디어 생성 모델을 위한 전문화된 배포 표준을 제시한다. 고성능 오케스트레이션과 연구팀의 최적화 지원을 결합함으로써 미디어 AI 스타트업들의 운영 비용을 낮추고 서비스 확장성을 크게 개선할 것으로 기대된다.

섹션별 상세

전용 컨테이너 추론 서비스는 단순한 GPU 제공을 넘어 맞춤형 모델을 위한 프로덕션급 오케스트레이션을 지원한다. 기존 플랫폼들이 상태 비저장(Stateless) 엔드포인트나 대규모 배치 작업에 최적화된 것과 달리, 이 서비스는 작업(Job)과 큐(Queue)를 핵심 개념으로 설계했다. 이를 통해 다중 독립 큐 운영, 정책 기반 트래픽 제어, 실시간 및 배치 트래픽 간의 격리가 가능해져 갑작스러운 수요 급증에도 안정적인 성능을 유지한다.

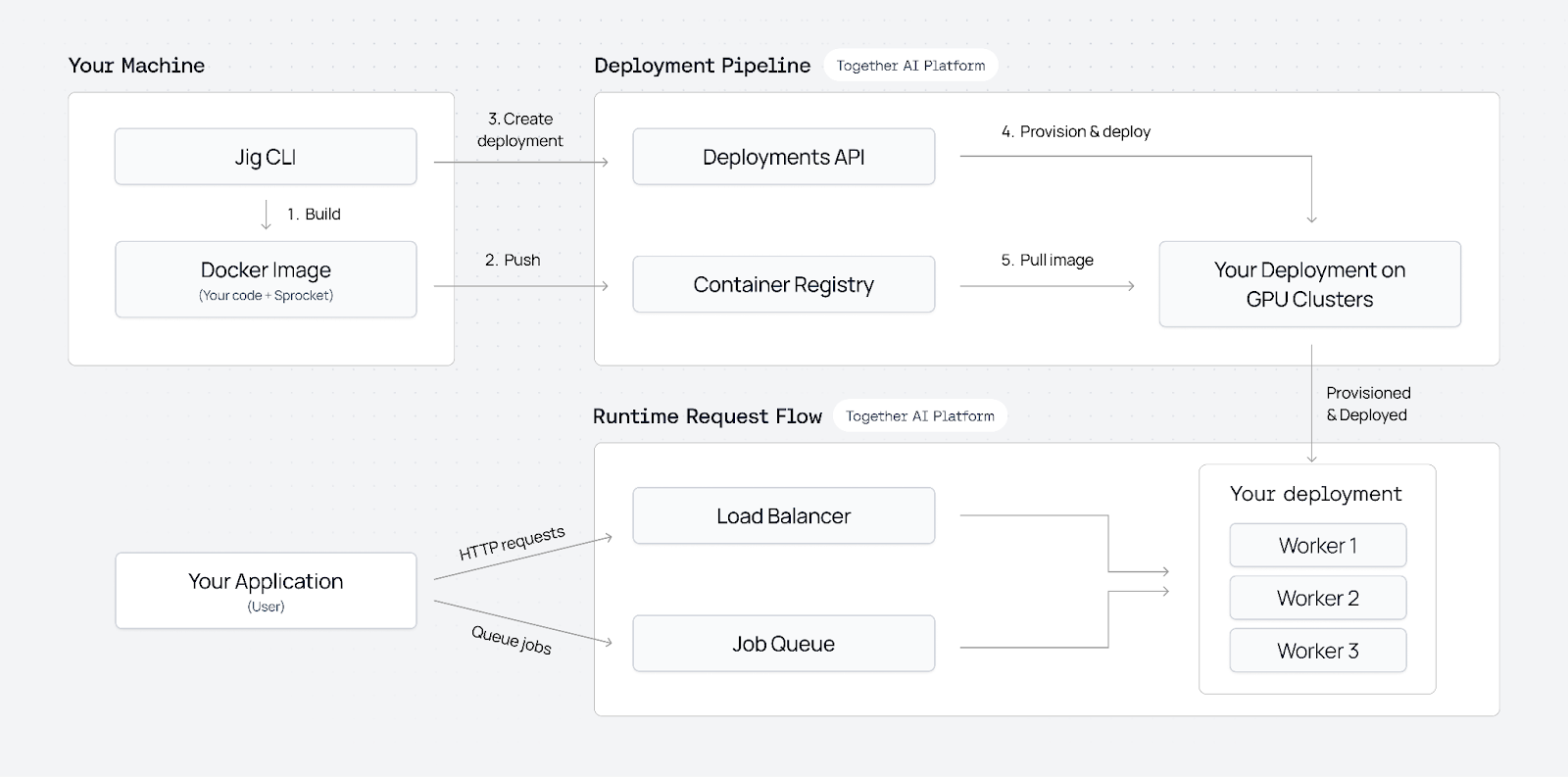

아키텍처 측면에서 사용자의 Docker 컨테이너를 실행 단위로 관리하며 유연한 인프라 제어를 제공한다. 컨테이너에는 런타임, 종속성, 추론 로직이 포함되며 Together AI는 GPU 프로비저닝, 네트워킹, 상태 확인 및 모니터링을 전담한다. 대규모 모델을 위해 torchrun을 통한 분산 추론을 기본 지원하며, 볼륨 마운트 기능을 통해 수십 기가바이트에 달하는 모델 가중치를 매번 빌드하지 않고도 신속하게 업데이트할 수 있다.

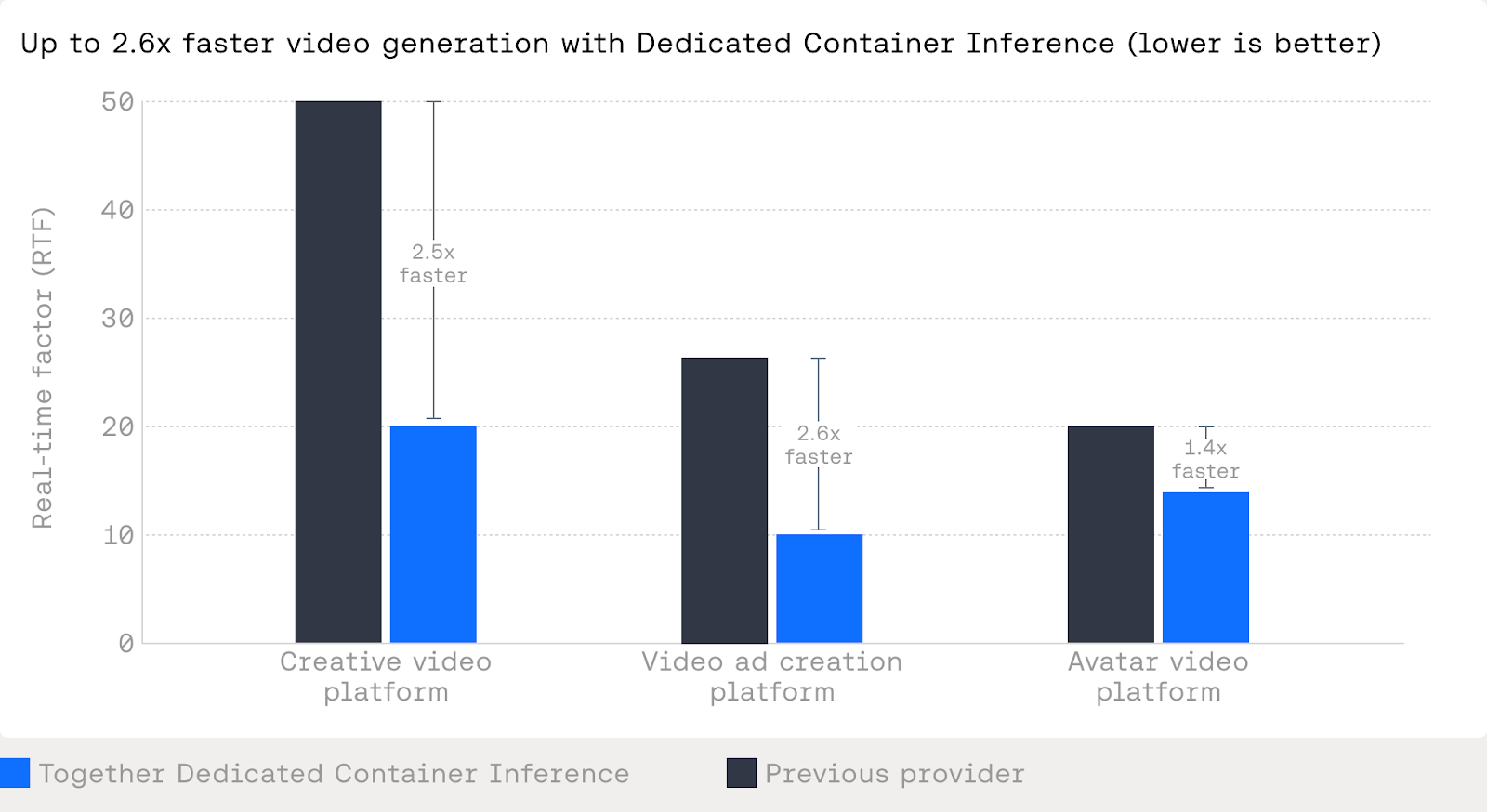

성능 면에서 생성형 미디어 워크로드의 비용과 지연 시간을 획기적으로 개선했다. Together AI 연구팀의 커널 최적화와 맞춤형 프로파일링을 통해 Creatify와 Hedra 같은 고객사들은 추론 속도가 1.4배에서 최대 2.6배까지 향상되는 결과를 얻었다. 비디오 생성 모델의 경우 실시간 계수(RTF)가 크게 낮아져 이전에는 경제성이 없던 모델들도 실제 상용 서비스로 운영 가능한 수준에 도달했다.

이미지 분석

실무 Takeaway

- 비디오 및 미디어 AI 모델 배포 시 자체 오케스트레이션 레이어 구축 비용을 절감하고 전문적인 큐 관리 시스템을 즉시 도입할 수 있다.

- Together GPU Cloud에서 학습과 추론을 통합하여 아티팩트 전송 과정에서 발생하는 오류를 방지하고 배포 파이프라인을 단순화할 수 있다.

- 볼륨 마운트 기능을 활용해 대용량 모델 가중치 업데이트 시간을 단축하고 컨테이너 빌드 비용을 최적화할 수 있다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료