핵심 요약

비전 AI의 급격한 성장으로 대규모 시각 데이터를 효율적으로 처리할 수 있는 고성능 추론 엔진의 필요성이 커지고 있다. Roboflow는 이러한 요구에 부응하여 ONNX, PyTorch, TensorRT를 모두 지원하는 모듈형 실행 엔진인 Inference 1.0을 발표했다. 이 엔진은 하드웨어에 맞춰 최적화된 런타임을 자동으로 선택하며, 모델 로딩 시간 단축과 동적 배칭을 통해 GPU 활용도를 극대화한다. 클라우드와 엣지 환경 모두에서 동일한 API로 배포가 가능하여 기업의 인프라 전환 비용을 획기적으로 낮춘다.

배경

컴퓨터 비전 기초 지식, Docker 및 API 통신 이해, NVIDIA GPU 및 TensorRT 개념

대상 독자

비전 AI 모델을 엣지나 클라우드에 배포하고 운영하는 MLOps 엔지니어 및 개발자

의미 / 영향

Inference 1.0은 하드웨어 종속성을 제거하여 기업이 엣지에서 클라우드로, 또는 그 반대로 자유롭게 인프라를 확장할 수 있는 유연성을 제공한다. 특히 TensorRT 사전 컴파일과 같은 최적화 기술은 실시간 비전 서비스의 안정성을 크게 높여 산업 현장의 AI 도입을 가속화할 것으로 보인다.

섹션별 상세

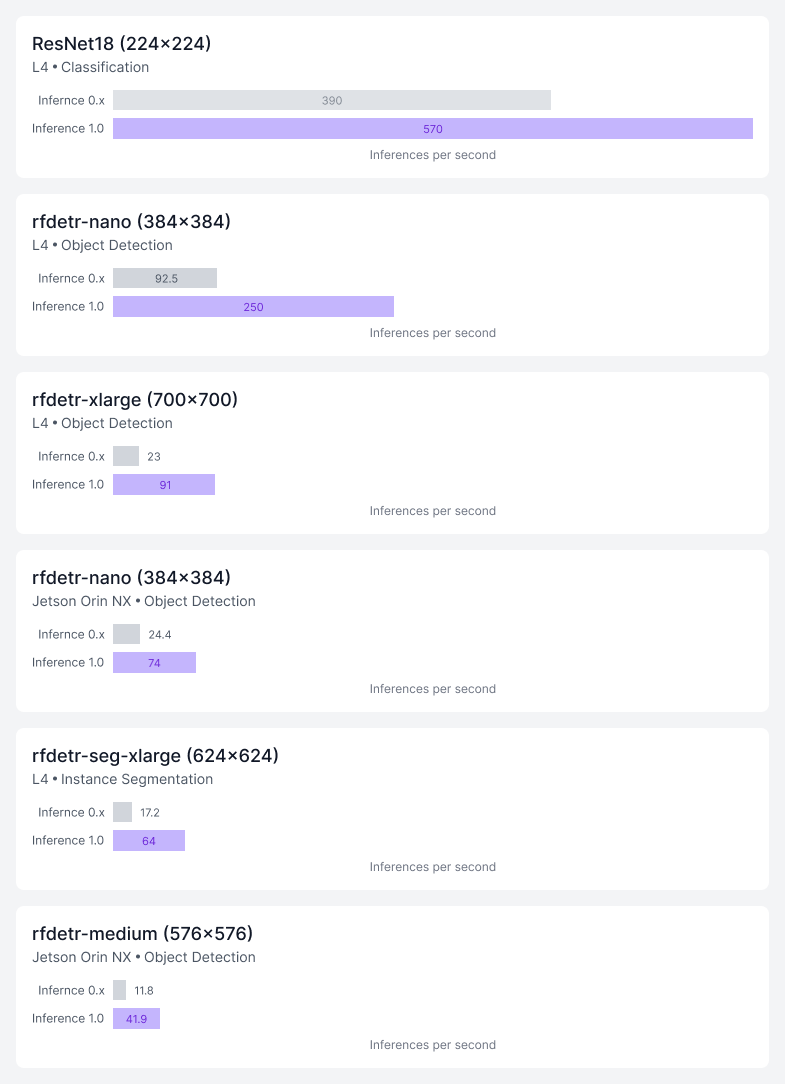

Inference 1.0은 ONNX, PyTorch, TensorRT를 아우르는 멀티 백엔드 지원을 통해 하드웨어별 최적의 성능을 보장한다. NVIDIA GPU 환경에서는 CUDA와 TensorRT를, CPU 환경에서는 최적화된 ONNX를 자동으로 선택하여 실행함으로써 개발자가 직접 런타임을 관리해야 하는 번거로움을 제거했다.

TensorRT 사전 컴파일(Pre-compilation) 기능을 도입하여 엣지 디바이스에서의 모델 로딩 지연 문제를 해결했다. 기존에는 실행 시점에 컴파일이 이루어져 실시간 프로세스를 방해했으나, 이제는 사전 컴파일된 파일을 사용하여 40개 이상의 스트림을 운영하는 공장 환경에서도 즉각적인 모델 교체가 가능하다.

콜드 스타트(Cold-start) 로직 개선과 동적 배칭(Dynamic Batching) 및 멀티스레딩 기술을 통해 처리량을 대폭 향상시켰다. 특히 여러 대의 카메라에서 들어오는 30fps 비디오 스트림과 같은 고부하 상황에서도 CPU/GPU 자원을 효율적으로 배분하여 안정적인 성능을 유지한다.

서빙 레이어(HTTP/REST/gRPC)와 모델 런타임을 분리한 모듈형 아키텍처를 채택하여 디버깅과 확장이 용이하다. Jetson 엣지 장비부터 AWS/GCP/Azure 클라우드 클러스터까지 환경에 구애받지 않고 동일한 로직으로 배포할 수 있는 추상화 계층을 제공한다.

Roboflow Cloud를 통한 완전 관리형 서비스와 자체 호스팅(Self-host) 옵션을 모두 제공하여 데이터 프라이버시와 운영 편의성을 동시에 확보했다. SOC 2 Type II 및 HIPAA 인증을 준수하며, 로컬 환경에서 클라우드로 인프라를 이전하더라도 애플리케이션 코드를 재작성할 필요가 없다.

실무 Takeaway

- TensorRT 사전 컴파일 기능을 활용하면 엣지 디바이스에서 모델 로딩 시 발생하는 병목 현상을 제거하고 실시간 서비스의 가용성을 확보할 수 있다.

- Inference 1.0의 멀티 백엔드 자동 선택 기능을 통해 개발자가 하드웨어별 최적화 코드를 직접 작성하지 않고도 GPU 활용도를 극대화하여 하드웨어 비용을 절감할 수 있다.

- 추론 엔진의 추상화 계층을 활용하면 엣지(Jetson)에서 클라우드(Docker)로 인프라를 변경할 때 코드 수정 없이 배포 환경을 유연하게 확장할 수 있다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료