핵심 요약

AI 코딩 플랫폼 Cursor는 개발자의 편집 흐름을 방해하지 않는 실시간 피드백을 제공하기 위해 Together AI와 파트너십을 맺고 추론 인프라를 혁신했다. 양사는 NVIDIA Blackwell GB200 NVL72 및 HGX B200 시스템을 도입하여 높은 메모리 대역폭과 텐서 처리량을 확보하고 ARM 호스트 최적화 및 커스텀 커널을 개발했다. 특히 NVFP4 양자화 파이프라인을 통해 모델 품질을 유지하면서도 추론 속도를 극대화하는 성과를 거두었다. 현재 이 시스템은 여러 데이터 센터에서 가동 중이며 향후 처리량 확대와 경제성 개선에 집중할 계획이다.

배경

NVIDIA GPU 아키텍처(Blackwell, Hopper)에 대한 이해, LLM 추론 최적화 및 양자화(Quantization) 개념, 병렬 처리 및 분산 컴퓨팅 기초 지식

대상 독자

실시간 AI 서비스를 운영하는 MLOps 엔지니어 및 인프라 아키텍트

의미 / 영향

NVIDIA Blackwell의 조기 도입과 최적화 성공 사례는 차세대 AI 하드웨어가 실시간 에이전트 서비스의 경제성과 성능을 어떻게 변화시킬 수 있는지 보여준다. 특히 하드웨어 특성에 맞춘 커스텀 커널과 양자화 전략이 모델의 실질적인 사용자 경험을 결정짓는 핵심 요소가 될 것임을 시사한다.

섹션별 상세

이미지 분석

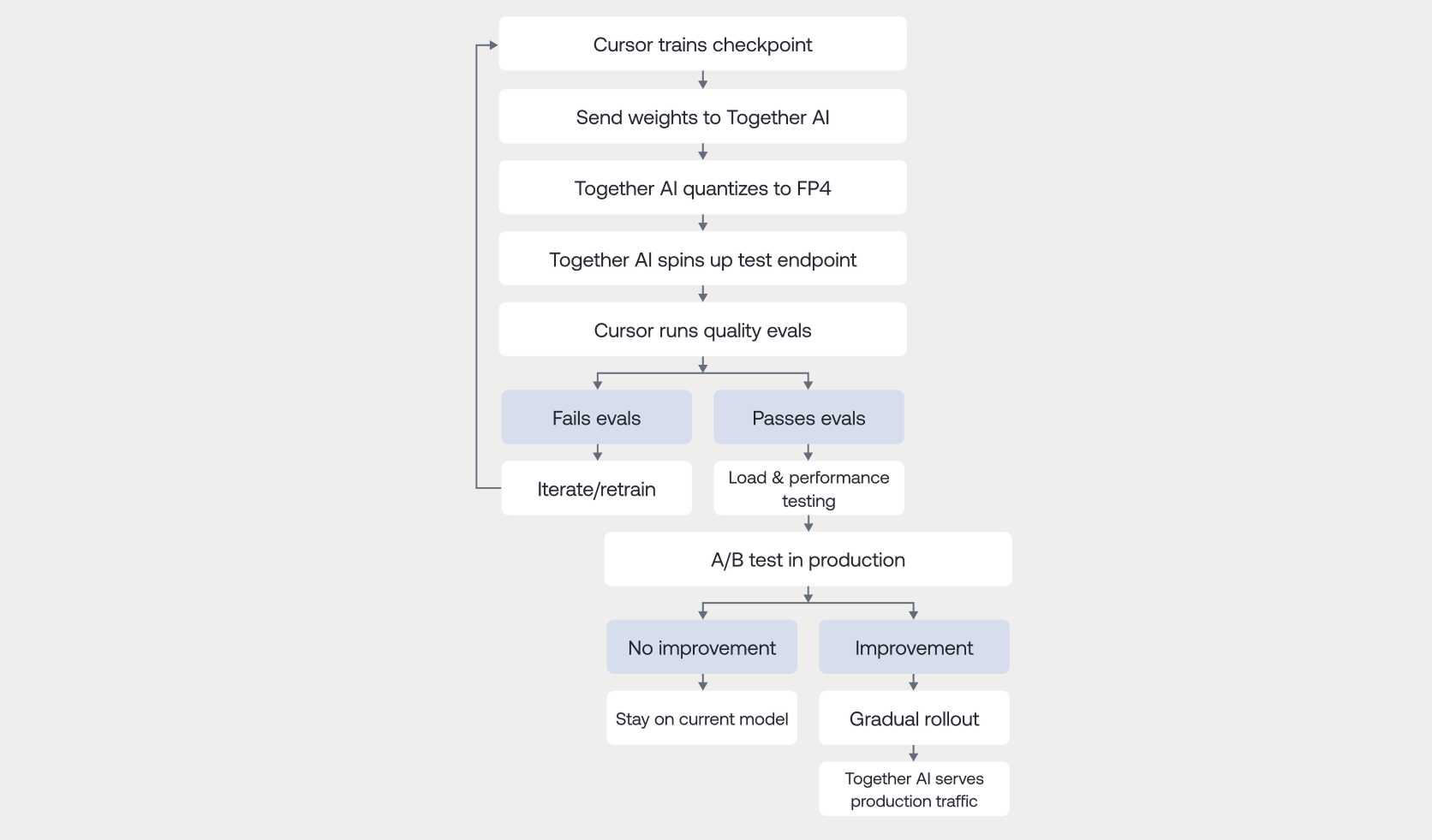

Cursor가 체크포인트를 학습한 후 Together AI로 가중치를 전달하고, FP4 양자화 및 테스트 엔드포인트 생성을 거쳐 품질 평가와 A/B 테스트 후 최종 배포되는 전체 파이프라인을 시각화한다. 모델 업데이트가 실시간 서비스에 반영되기까지의 단계별 검증 과정을 명확히 보여준다.

Cursor 모델의 학습부터 Together AI를 통한 프로덕션 배포까지의 워크플로우 다이어그램

실무 Takeaway

- 실시간 인터랙티브 AI 서비스에서는 하드웨어 가속기뿐만 아니라 ARM 호스트 튜닝 및 커스텀 커널 수준의 풀스택 최적화가 성능 차별화의 핵심이다.

- NVFP4와 같은 최신 저정밀도 양자화 기술을 활용하면 코딩과 같은 정밀한 작업에서도 품질 저하 없이 추론 비용과 지연 시간을 획기적으로 줄일 수 있다.

- 학습된 가중치를 며칠 내에 양자화하여 프로덕션급 엔드포인트로 배포하고 A/B 테스트를 수행하는 자동화된 파이프라인이 모델 개선 속도를 결정한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료