핵심 요약

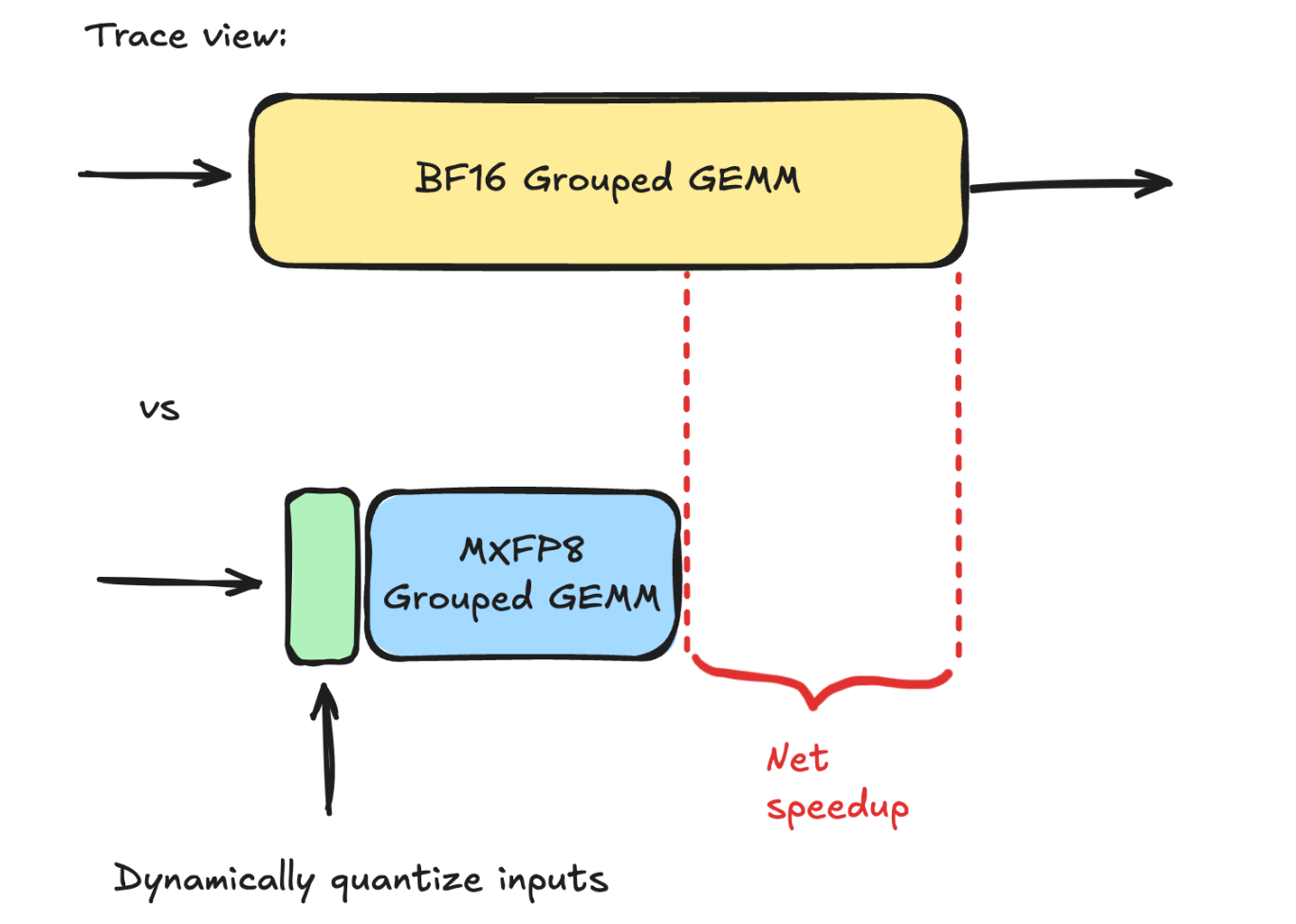

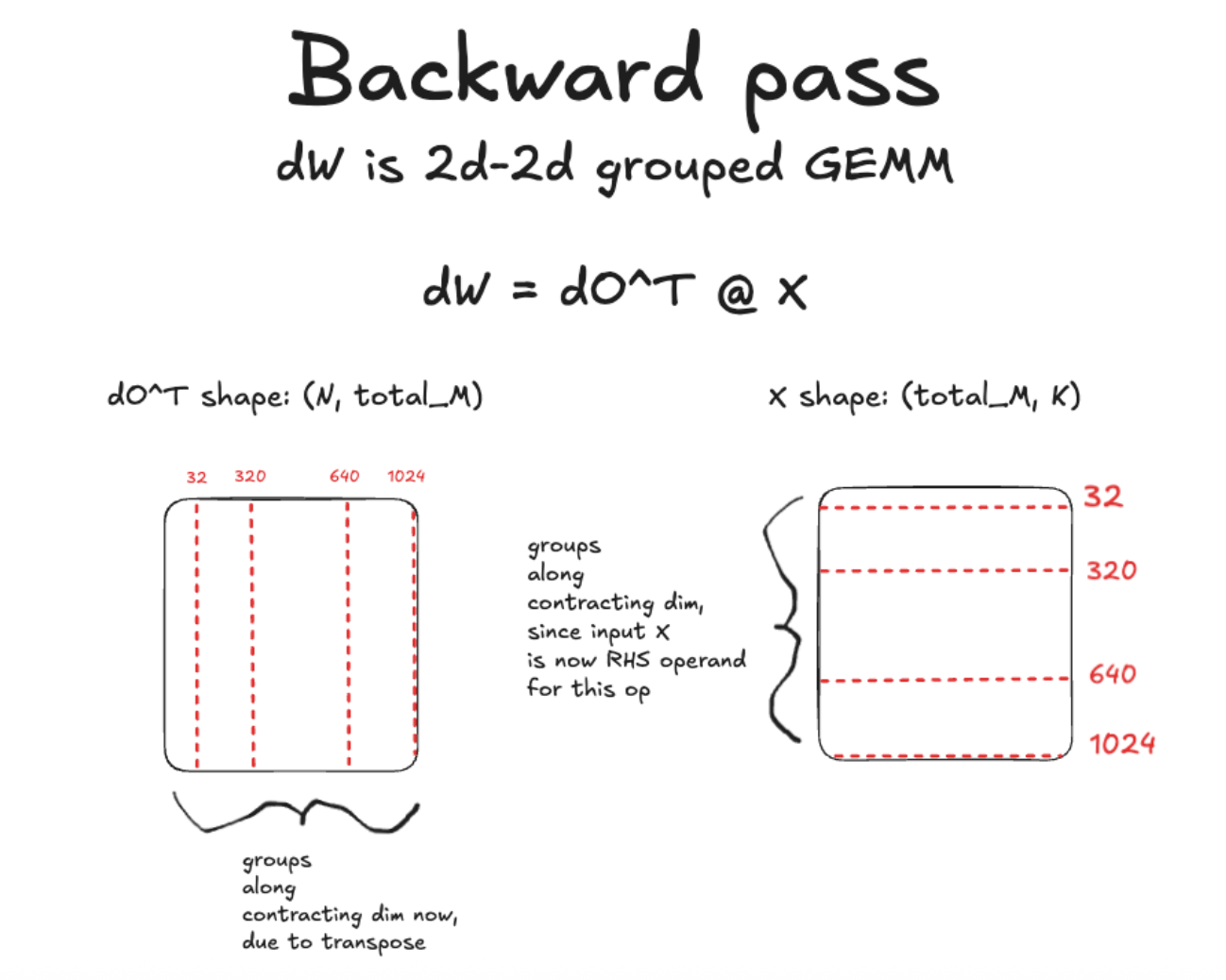

대형 언어 모델(LLM) 학습의 효율성을 극대화하기 위해 PyTorch는 TorchAO 라이브러리에 MXFP8(Microscaling Formats) MoE 학습 프리미티브를 도입했다. Llama 4 Scout 모델을 대상으로 한 실험에서 BF16 정밀도와 동일한 수렴 성능을 유지하면서도 학습 속도를 30.2% 향상시키는 데 성공했다. 이는 NVIDIA Blackwell GPU의 5세대 텐서 코어를 활용한 결과로, 이론적 최대 가속치의 약 81%에 해당하는 성능이다. 이 기술은 동적 양자화와 특수한 메모리 레이아웃 변환 커널을 결합하여 저정밀도 연산의 이점을 극대화하며, 현재 TorchTitan과 TorchAO에서 프로토타입 형태로 사용 가능하다.

배경

PyTorch 프레임워크 활용 능력, MoE(Mixture of Experts) 아키텍처에 대한 이해, 양자화(Quantization) 및 저정밀도 연산 기초 지식, NVIDIA GPU 아키텍처 및 커널 연산 개념

대상 독자

대규모 LLM 및 MoE 모델 학습 최적화를 담당하는 ML 엔지니어 및 인프라 전문가

의미 / 영향

MXFP8은 기존 FP8의 정밀도 문제를 해결하면서도 하드웨어 가속 이점을 극대화할 수 있어, 차세대 GPU 환경에서 대규모 모델 학습의 표준적인 최적화 기법으로 자리 잡을 것으로 전망된다.

섹션별 상세

실무 Takeaway

- Blackwell(B200/GB200) 인프라에서 MoE 모델 학습 시 TorchAO의 MXFP8 API를 적용하면 수렴 성능 저하 없이 학습 시간을 약 30% 단축할 수 있다.

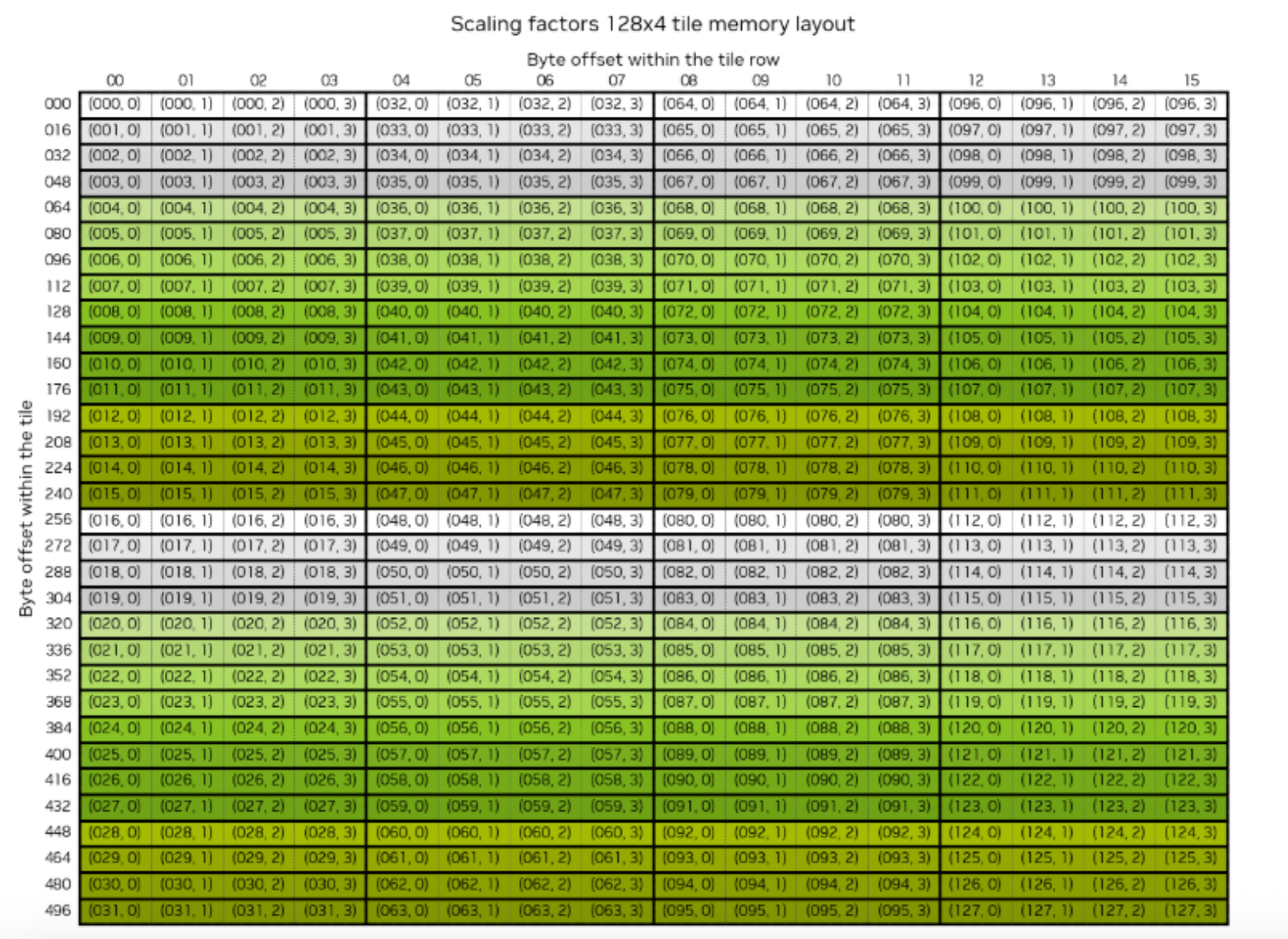

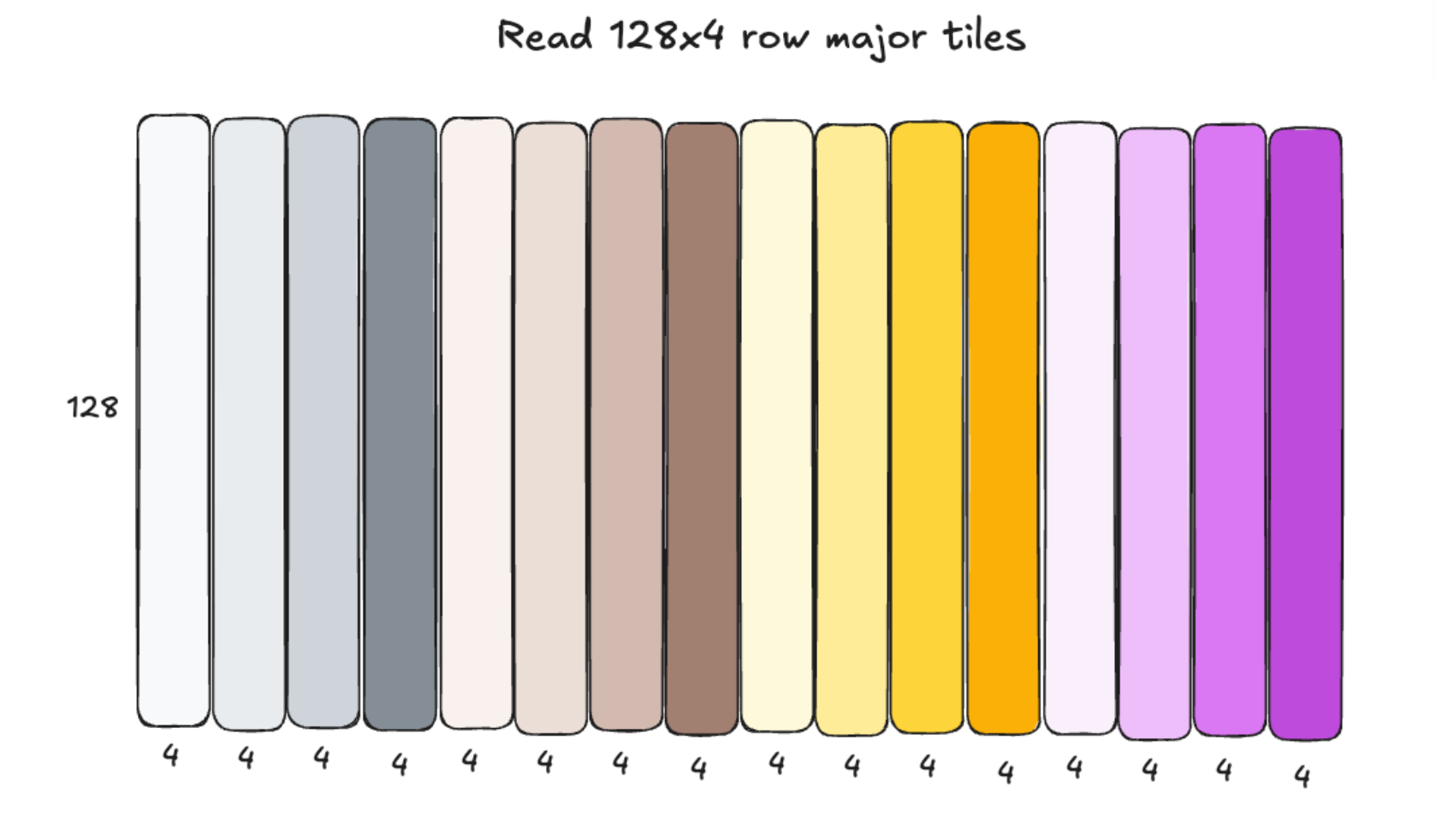

- 동적 양자화 과정에서 발생하는 메모리 레이아웃 변환 오버헤드를 줄이기 위해 디바이스 단에서 직접 처리하는 커널 최적화가 전체 성능 향상의 핵심이다.

- 모든 레이어에 일괄 적용하기보다 수렴 민감도가 높은 출력층 등을 제외하는 선택적 MXFP8 적용 전략이 실무적으로 유효하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료