핵심 요약

강화학습 시스템 구축에는 효율적인 연산 자원과 유연한 툴링 레이어가 필수적이다. Together AI는 자사의 Instant Clusters에서 PyTorch의 TorchForge 및 Monarch 스택을 구동하여 분산 RL 학습을 지원하기 시작했다. 이 시스템은 InfiniBand 기반의 저지연 통신과 함께 코드 실행을 위한 샌드박스 환경인 CodeSandbox 및 Code Interpreter를 기본적으로 통합한다. 이를 통해 개발자는 복잡한 환경 설정 없이도 대규모 GPU 클러스터에서 에이전트의 도구 사용 및 코드 생성 능력을 학습시킬 수 있다.

배경

강화학습(RL) 기본 개념 및 GRPO 알고리즘, PyTorch 분산 학습 프레임워크(TorchTitan, Monarch 등), Kubernetes(kubectl) 기본 조작

대상 독자

강화학습(RL) 기반 에이전트를 개발하거나 대규모 분산 학습 인프라를 구축하려는 ML 엔지니어

의미 / 영향

PyTorch 생태계의 최신 RL 도구들이 클라우드 서비스와 밀착 통합됨에 따라, 에이전트의 추론 및 코딩 능력 향상을 위한 RLHF/GRPO 학습의 진입 장벽이 크게 낮아질 것으로 보입니다.

섹션별 상세

이미지 분석

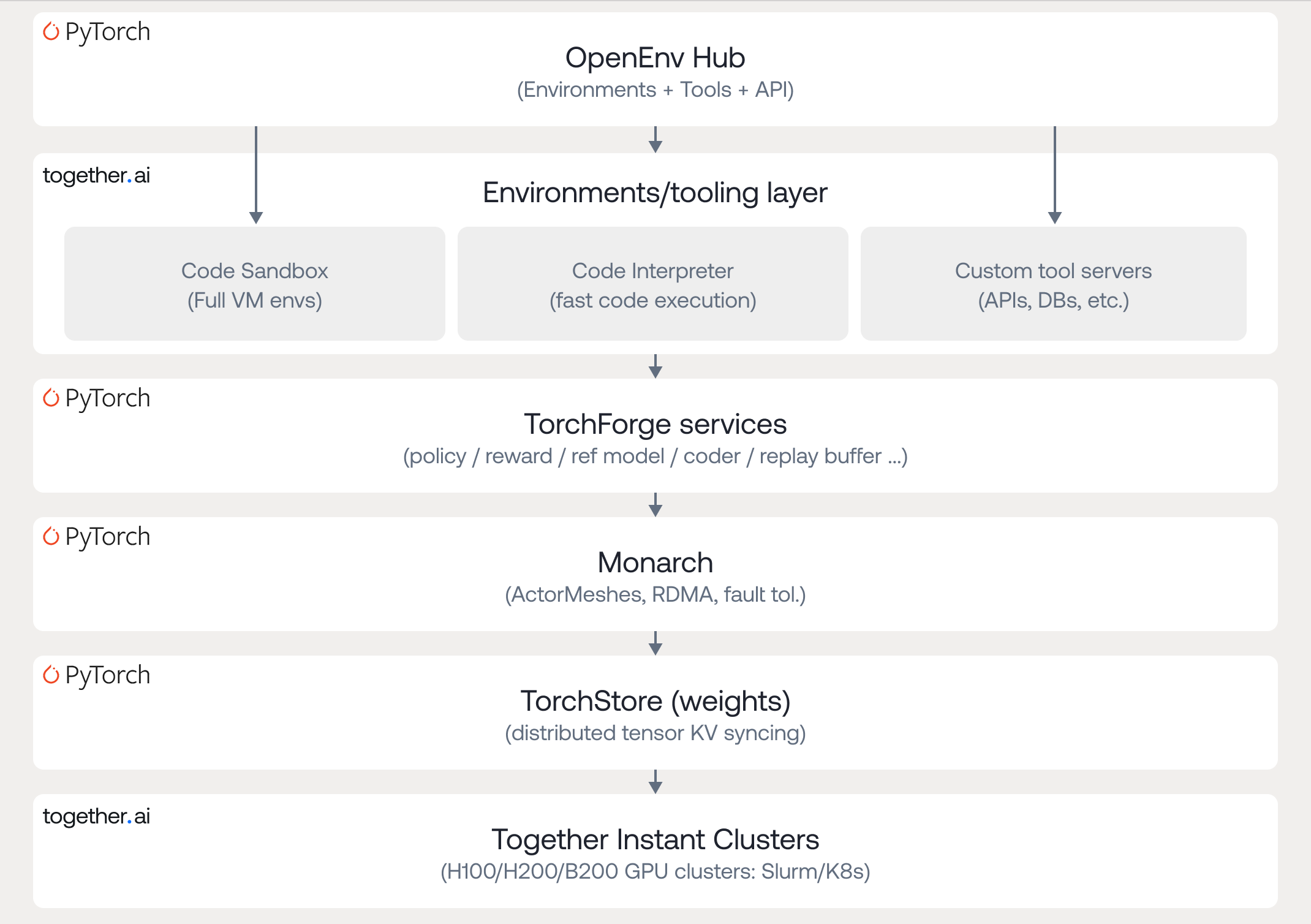

OpenEnv Hub부터 Together Instant Clusters까지 이어지는 기술 스택의 계층 구조를 보여줍니다. PyTorch의 TorchForge, Monarch, TorchStore가 Together AI의 샌드박스 환경 및 GPU 클러스터와 어떻게 상호작용하여 RL 파이프라인을 구성하는지 시각화합니다.

PyTorch 스택과 Together AI 인프라 간의 통합 워크플로 다이어그램

실무 Takeaway

- Together AI의 Instant Clusters를 활용하면 복잡한 인프라 설정 없이 TorchForge 기반의 분산 RL 학습 환경을 즉시 구축할 수 있습니다.

- Code Interpreter를 OpenEnv 환경으로 래핑하여 RL 에이전트가 코드 스니펫을 실행하고 그 결과를 관찰값으로 받아 보상을 계산하는 워크플로를 구현할 수 있습니다.

- InfiniBand 기반의 RDMA 통신을 지원하여 대규모 액터 메쉬와 트레이너 간의 데이터 동기화 병목 현상을 최소화했습니다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료