핵심 요약

대형 언어 모델의 추론 속도를 높이기 위한 기존의 추측 디코딩은 타겟 모델과 드래프트 모델의 토큰이 완벽하게 일치해야 한다는 제약이 있었다. Together AI가 제안한 AutoJudge는 '손실 추측 디코딩(Lossy Speculative Decoding)' 방식을 채택하여, 최종 결과의 품질에 영향을 주지 않는 사소한 불일치는 수용함으로써 더 많은 토큰을 한 번에 생성한다. 이 방식은 수동 데이터 주석 없이도 자가 지도 학습을 통해 작업별로 중요한 토큰을 식별하는 분류기를 훈련시켜 적용된다. 실험 결과 GSM8K 및 LiveCodeBench와 같은 벤치마크에서 정확도 손실을 최소화하면서도 표준 추측 디코딩 대비 1.5~2배의 속도 향상을 달성했다.

배경

추측 디코딩(Speculative Decoding)의 기본 원리, LLM 추론 프레임워크(vLLM 등)에 대한 이해, 트랜스포머 아키텍처 및 임베딩 개념

대상 독자

LLM 추론 엔진 최적화 개발자 및 AI 인프라 엔지니어

의미 / 영향

AutoJudge는 엄격한 분포 일치라는 추측 디코딩의 한계를 극복하여 실질적인 추론 속도를 한 단계 더 끌어올렸다. 이는 특히 수학이나 코딩처럼 정답의 논리적 구조가 중요한 영역에서 효율적인 비용 절감 대안이 될 것이다.

섹션별 상세

이미지 분석

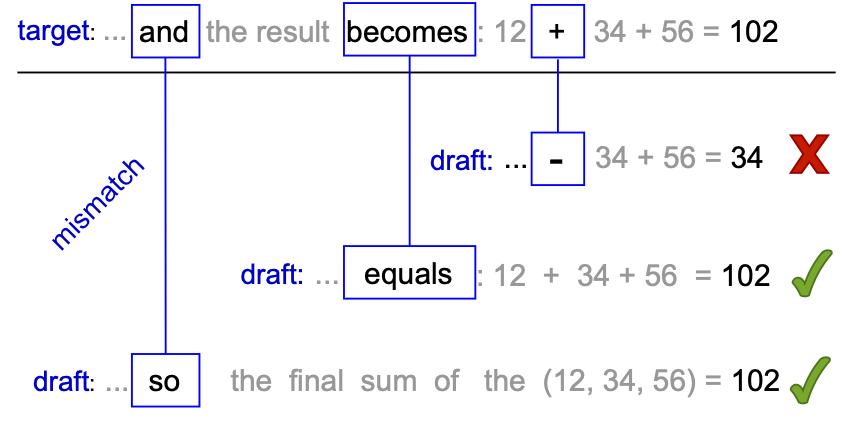

드래프트 모델과 타겟 모델 간의 토큰 불일치가 발생했을 때, 해당 토큰을 교체하며 최종 결과의 정답 여부를 확인하여 중요 토큰을 레이블링하는 과정을 설명한다. 이 프로세스를 통해 수동 작업 없이 학습 데이터를 확보한다.

AutoJudge의 데이터 수집 단계를 보여주는 다이어그램

'equals'와 'becomes' 같은 의미상 차이가 없는 불일치는 분류기가 수용하여 더 긴 토큰 시퀀스를 한 번에 생성하게 함으로써 추론 속도를 높이는 메커니즘을 보여준다. 반면 수학 기호의 오류는 정확히 거절한다.

추론 시 분류기가 추가 토큰을 수용하는 예시

AutoJudge(빨간색)가 기존 Top-K 방식보다 훨씬 더 많은 토큰을 수용하면서도 타겟 모델의 원래 정확도를 더 잘 유지함을 보여준다. Llama 3.1 8B와 70B 모델 모두에서 우수한 성능 향상을 입증한다.

GSM8K 벤치마크에서의 정확도와 평균 수용 토큰 수 비교 그래프

실무 Takeaway

- 작업별 중요도를 판단하는 분류기를 통해 추측 디코딩의 토큰 수용률을 높여 추론 비용을 절감할 수 있다.

- 수동 레이블링 없이 자가 지도 학습만으로 도메인 특화된 최적화 모델을 구축하는 것이 가능하다.

- 정확도와 속도 사이의 트레이드오프를 분류기 임계값 조절을 통해 서비스 요구사항에 맞춰 유연하게 설정할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료