핵심 요약

Thinking Machines Lab이 자사의 모델 학습 및 커스터마이징 플랫폼인 Tinker를 정식 출시(GA)했다. 이번 업데이트를 통해 1조 개의 파라미터를 보유한 대규모 추론 모델 Kimi K2 Thinking과 시각 정보 처리가 가능한 Qwen3-VL 모델이 새롭게 추가되었다. 또한 OpenAI API와 호환되는 추론 인터페이스를 도입하여 기존 워크플로우와의 통합을 용이하게 했으며, 비전 모델의 효율적인 파인튜닝 성능을 입증하는 벤치마크 결과도 함께 공개했다.

배경

Python, LLM 파인튜닝 기본 개념, OpenAI API 사용 경험

대상 독자

대규모 모델 파인튜닝 및 멀티모달 AI 애플리케이션을 개발하는 엔지니어와 연구자

의미 / 영향

Tinker의 정식 출시와 대규모 모델 지원은 개발자들이 고성능 추론 및 비전 모델을 더 쉽게 커스터마이징할 수 있게 한다. 특히 1조 파라미터 모델의 파인튜닝 접근성을 높임으로써 특정 도메인에 특화된 고성능 에이전트 개발이 가속화될 것으로 보인다.

섹션별 상세

이미지 분석

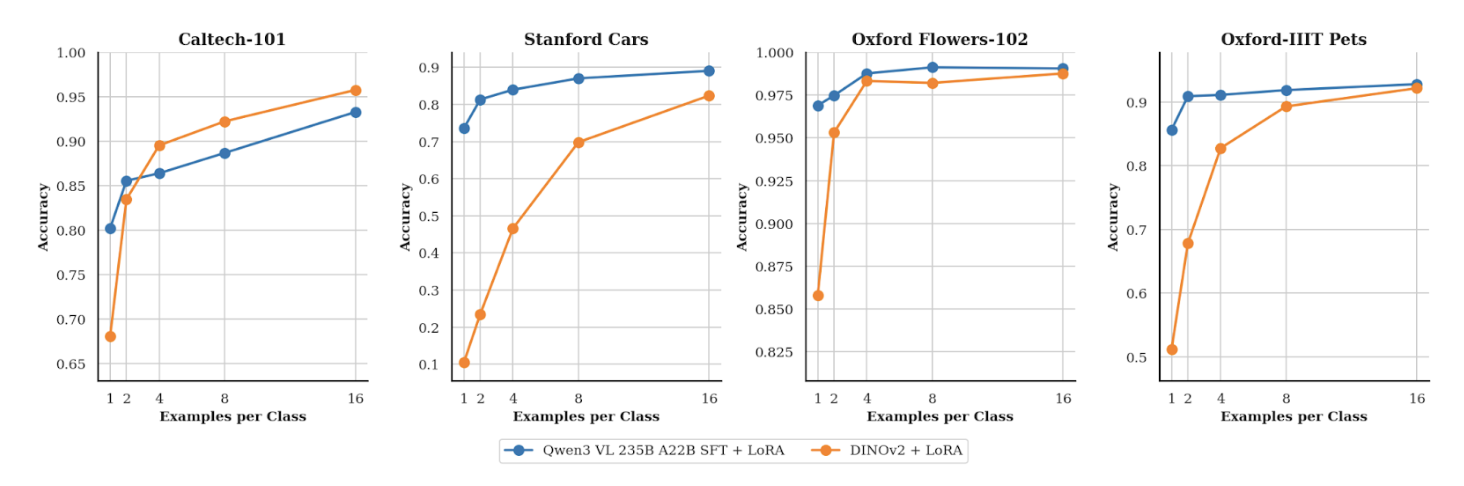

Caltech-101, Stanford Cars 등 4개 데이터셋에서 클래스당 학습 예시 수(1~16개)에 따른 정확도 변화를 보여준다. Qwen3-VL(파란색)이 모든 데이터셋에서, 특히 데이터가 매우 적은 퓨샷(Few-shot) 환경에서 DINOv2(주황색)보다 일관되게 높은 성능을 기록함을 증명한다.

Qwen3-VL과 DINOv2 모델의 데이터 양에 따른 이미지 분류 정확도 비교 그래프.

실무 Takeaway

- Tinker 정식 출시로 1조 파라미터급 모델인 Kimi K2 Thinking을 누구나 직접 파인튜닝할 수 있는 환경이 마련되었다.

- OpenAI API 호환 인터페이스를 통해 기존 인프라 변경 없이 Tinker 모델을 즉시 프로덕션에 통합할 수 있다.

- 데이터가 부족한 특정 도메인의 이미지 분류 작업에서 Qwen3-VL과 같은 VLM을 활용하면 DINOv2 대비 높은 정확도를 확보할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료