핵심 요약

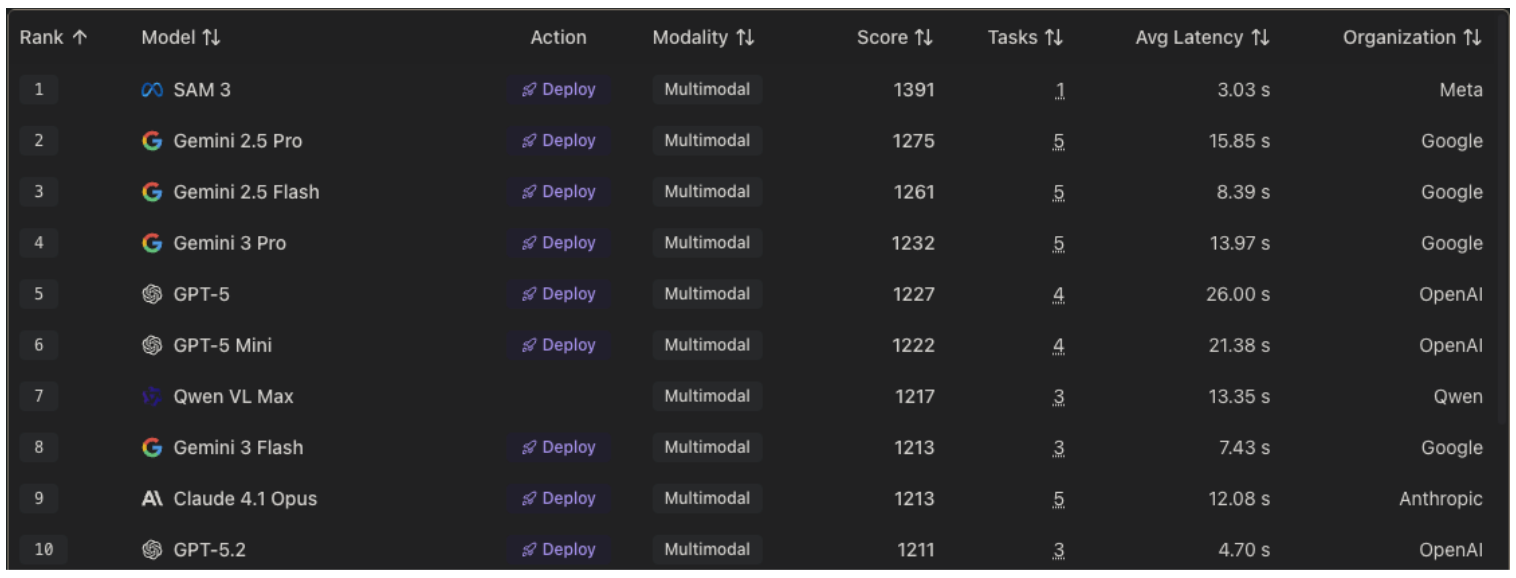

2026년 초 멀티모달 모델은 텍스트, 이미지, 비디오를 통합 이해하는 수준을 넘어 컴퓨터 비전 작업에서 핵심적인 역할을 수행 중이다. Meta의 SAM 3가 제로샷 세그멘테이션 성능을 바탕으로 랭킹 1위를 차지했으며, Google의 Gemini 시리즈와 OpenAI의 GPT-5가 그 뒤를 잇고 있다. 각 모델은 아키텍처 혁신을 통해 추론 속도와 복잡한 문제 해결 능력을 강화했으며, 실무 개발자들은 용도에 맞는 모델 선택이 중요하다. 멀티모달 AI의 급격한 발전은 다양한 산업 분야에서 인간과 AI의 상호작용 방식을 근본적으로 변화시키고 있다.

배경

컴퓨터 비전 기초, Transformer 아키텍처 이해, VLM(Vision-Language Model) 개념

대상 독자

AI 비전 시스템 개발자 및 멀티모달 LLM 도입을 검토 중인 엔지니어

의미 / 영향

멀티모달 모델의 성능 상향 평준화로 인해 이제는 단순한 성능 비교보다는 지연 시간, 컨텍스트 크기, 특정 언어 지원 여부 등 목적에 따른 세부 최적화가 모델 선택의 핵심 기준이 되고 있다. 이는 AI 도입 비용 절감과 실질적인 비즈니스 가치 창출로 이어질 것이다.

섹션별 상세

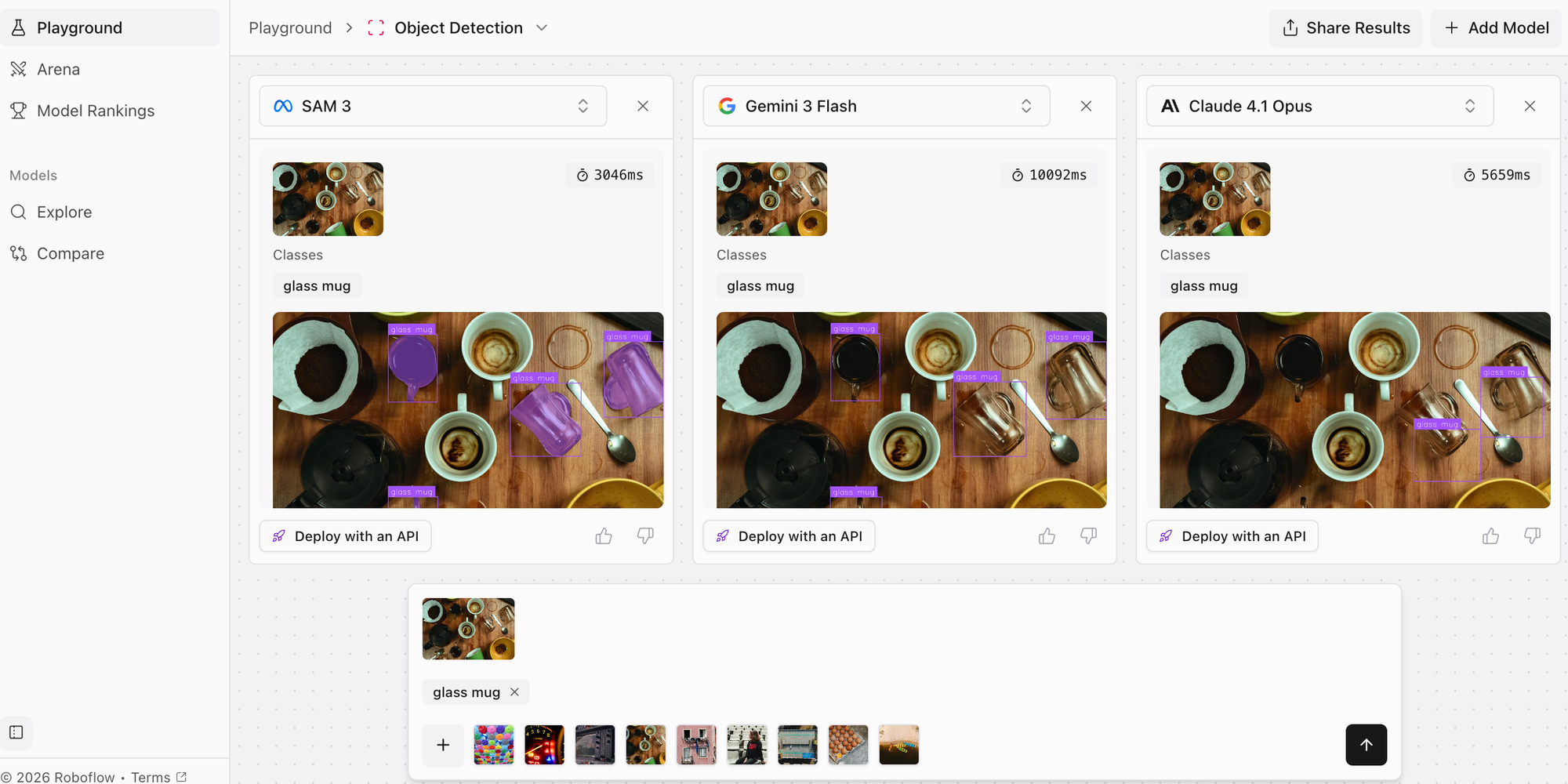

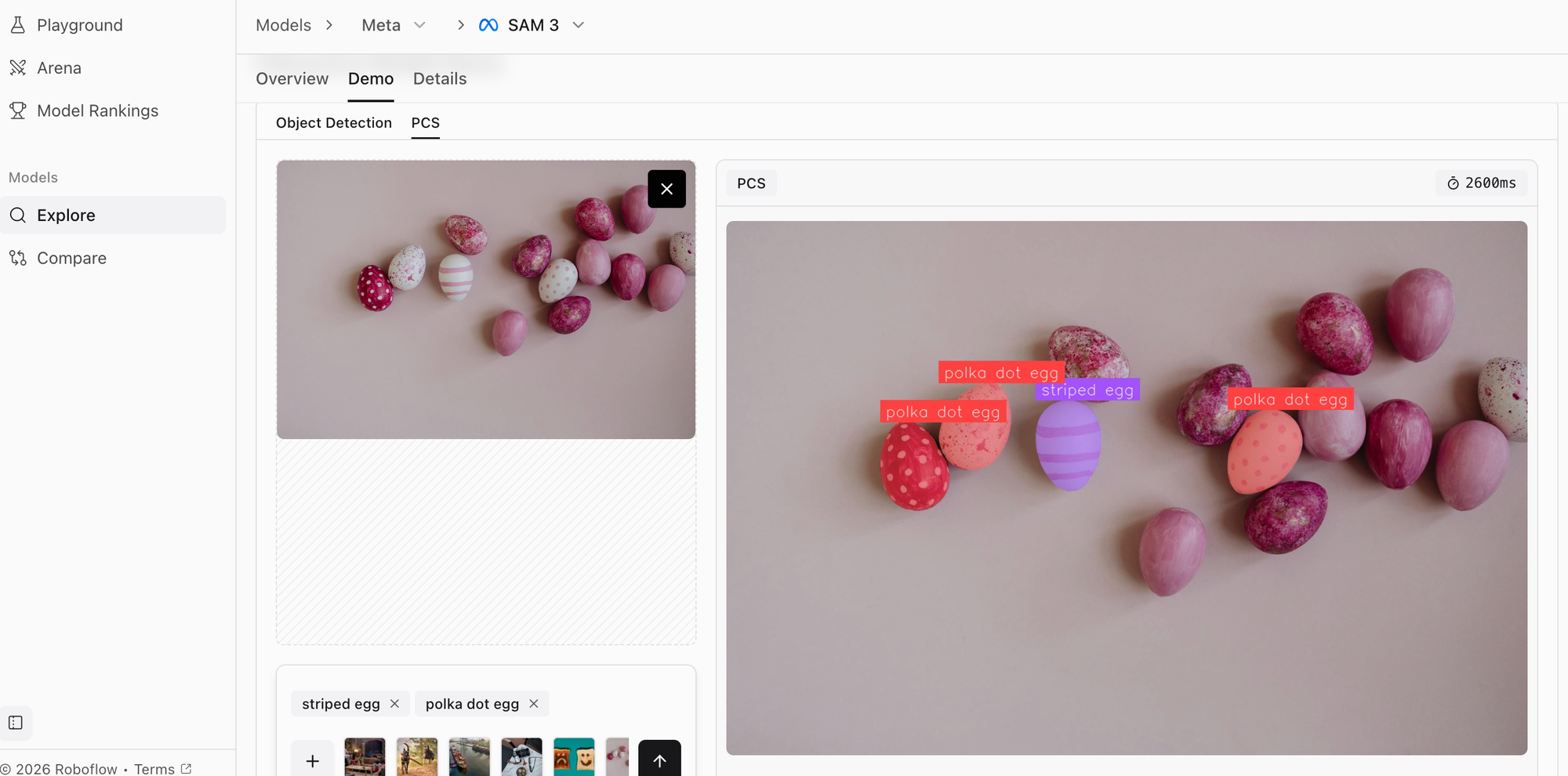

SAM 3(Segment Anything Model 3)는 Meta AI가 2025년 2월 출시한 모델로, Roboflow 랭킹에서 1391점으로 1위를 기록했다. 텍스트, 박스, 포인트 등 다양한 멀티모달 프롬프트를 지원하며 학습하지 않은 객체도 정확히 분할하는 제로샷 능력이 탁월하다. ViT 인코더와 경량 마스크 디코더를 결합한 아키텍처로 3.03초의 낮은 지연 시간을 달성했다. 실시간 추론이 가능하여 엣지 디바이스에서도 활용도가 높으며 비디오 프레임 간 일관된 세그멘테이션을 유지한다.

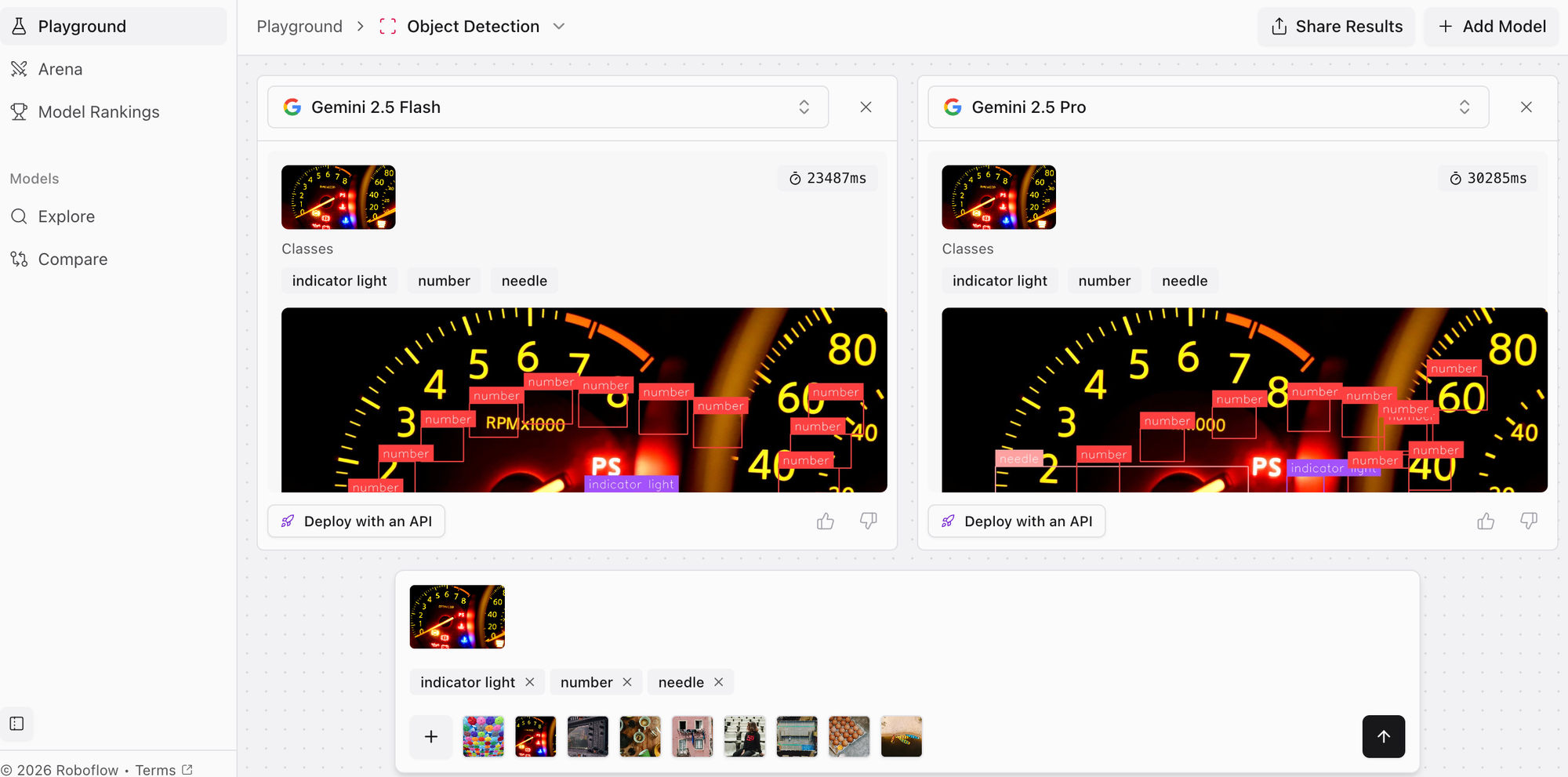

Google Gemini 시리즈는 2.5 Pro와 Flash, 그리고 최신 Gemini 3 Pro가 상위권을 차지하며 강력한 성능을 보여준다. 최대 200만 토큰의 방대한 컨텍스트 윈도우를 지원하며 Flash 모델은 MoE(Mixture-of-Experts) 아키텍처를 통해 속도를 최적화했다. 문서 이해, 비디오 모더레이션, 시각적 컨텍스트를 포함한 코드 생성에 강점을 가진다. 네이티브 코드 실행 기능을 통해 실시간으로 코드를 생성하고 디버깅하는 능력을 갖췄다.

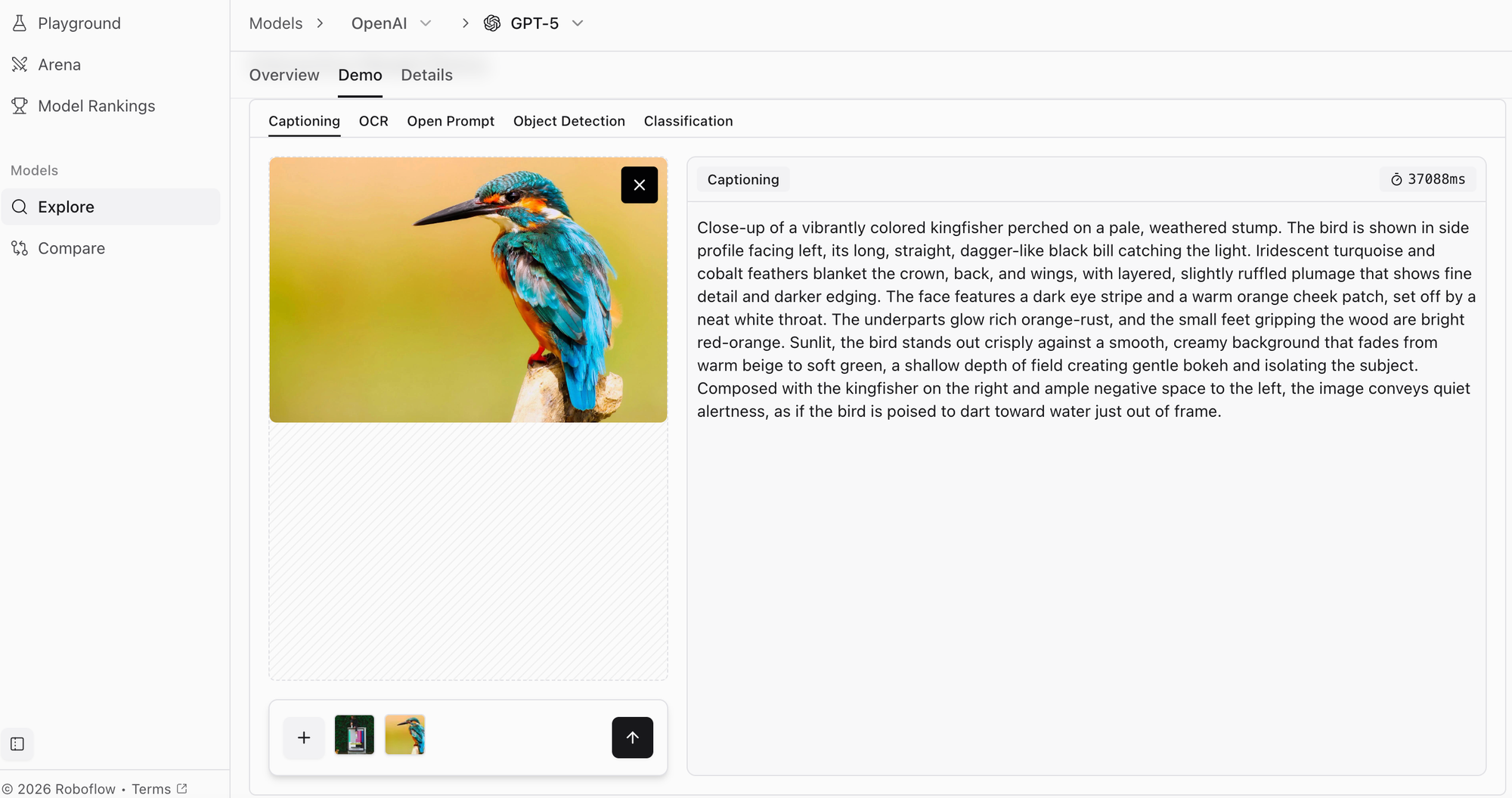

OpenAI GPT-5는 복잡한 문제 해결과 추론에 최적화된 고밀도(Dense) 트랜스포머 아키텍처를 채택했다. 텍스트, 이미지 패치, 오디오를 공유 토큰 공간으로 변환하여 통합적인 이해를 제공하며 특히 차트와 다이어그램 분석 능력이 크게 향상됐다. 외부 API 연동을 위한 도구 사용(Tool Use) 기능이 네이티브로 통합되어 있다. 사고의 중간 단계를 명시적으로 모델링하는 강화된 연쇄 사고(Chain-of-Thought) 추론을 통해 사실성을 높였다.

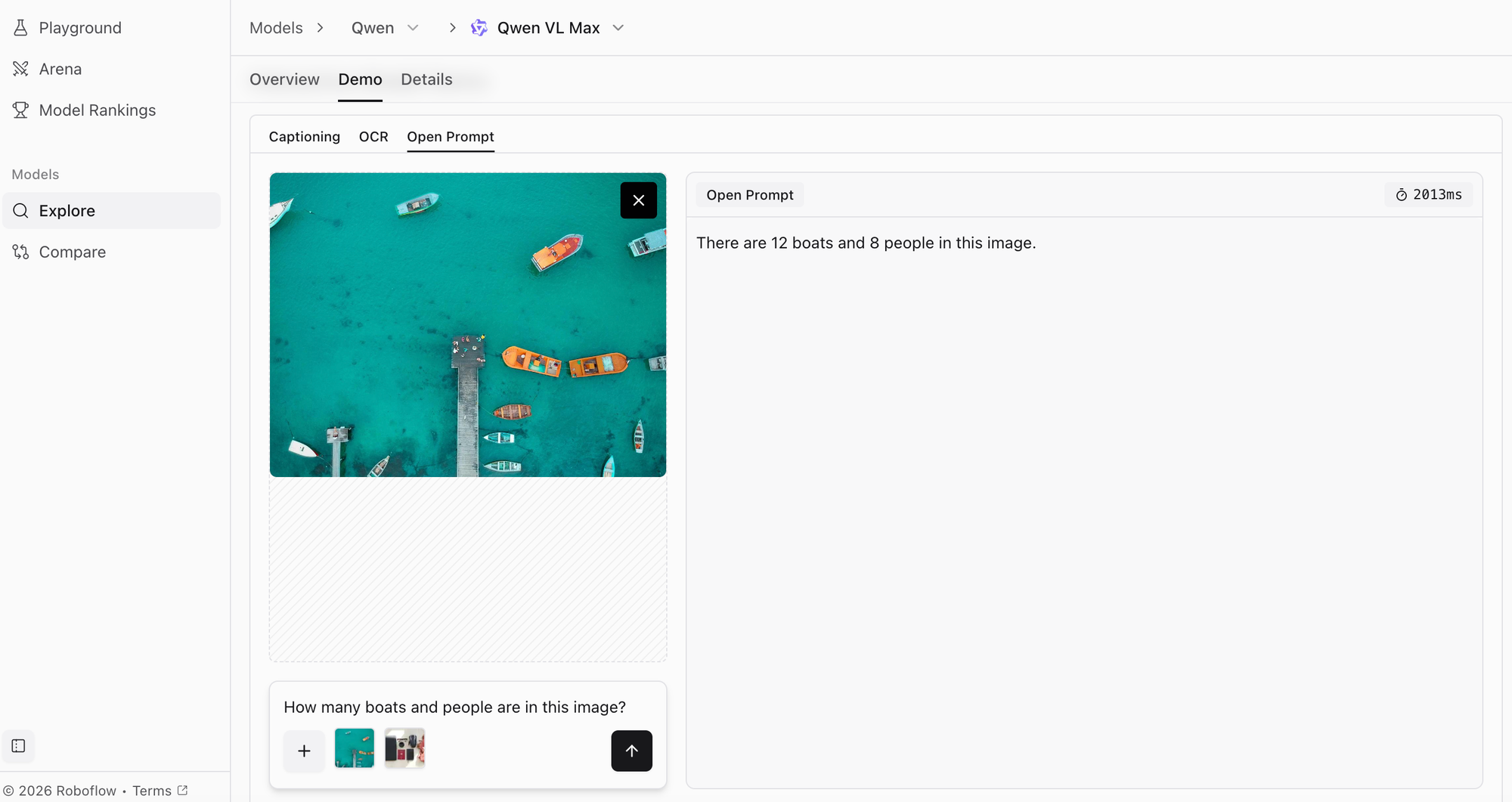

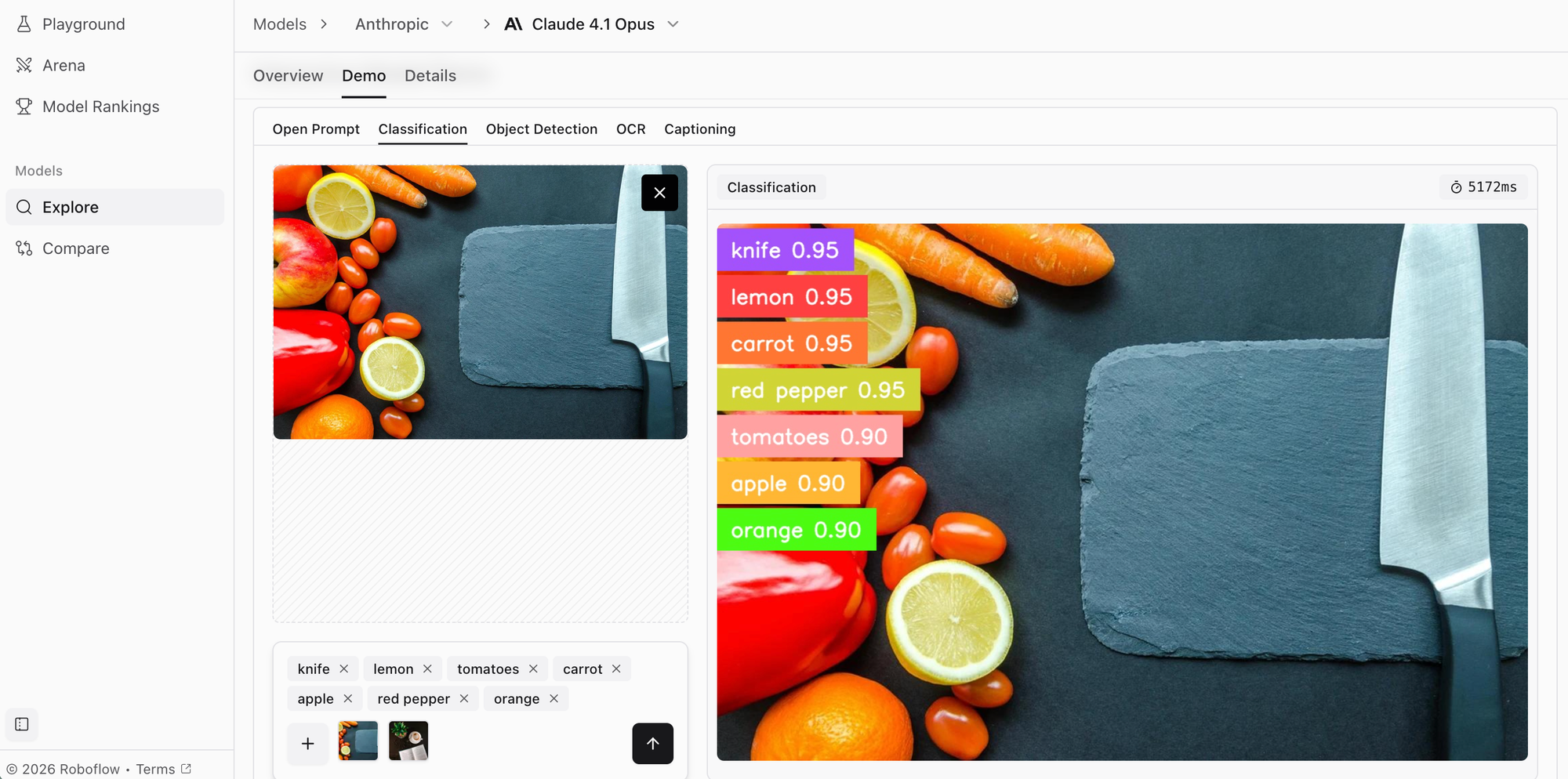

Qwen VL Max와 Claude 4.1 Opus는 각각 오픈소스 대안과 기술 분석 특화 모델로서 차별화된 가치를 제공한다. 알리바바의 Qwen VL Max는 아시아 언어 지원과 OCR 성능이 뛰어나며 오픈소스 라이선스로 접근성이 높다. Anthropic의 Claude 4.1 Opus는 대학원 수준의 추론 과제에서 높은 정확도를 보이며 20만 토큰 이상의 컨텍스트에서 완벽한 회상 능력을 유지한다. 두 모델 모두 특정 도메인이나 고도의 신뢰성이 필요한 환경에서 강력한 성능을 발휘한다.

이미지 분석

실무 Takeaway

- 실시간 세그멘테이션과 데이터 라벨링 자동화가 필요한 경우 지연 시간이 가장 짧고 제로샷 성능이 우수한 SAM 3를 우선 고려해야 한다.

- 수백만 토큰 분량의 대규모 문서 분석이나 긴 비디오 컨텍스트 처리가 핵심인 프로젝트에는 Gemini Pro 라인업이 가장 적합하다.

- 단순 인식을 넘어 복잡한 논리적 추론이나 시각 자료 기반의 문제 해결이 필요한 경우 GPT-5나 Claude 4.1 Opus를 선택하는 것이 유리하다.

- 아시아 시장을 타겟으로 하거나 모델 커스터마이징이 필요한 연구 프로젝트에는 Qwen VL Max가 강력한 대안이 된다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료