핵심 요약

컴퓨터 비전 분야에서 고정된 클래스 기반 세그멘테이션의 한계를 극복하기 위해 메타 AI가 출시한 Segment Anything(SAM) 모델 시리즈가 진화하고 있다. SAM 1은 이미지 기반의 제로샷 기초 모델을 확립했고, SAM 2는 비디오의 시간적 일관성을 위한 메모리 뱅크를 도입했다. 최신 버전인 SAM 3는 텍스트 프롬프트를 통해 특정 개념을 직접 분할하는 오픈 보캐블러리 기능을 제공하여 라벨링 작업의 패러다임을 바꾼다. 이러한 모델들은 Roboflow Workflows를 통해 실무 환경에 즉시 통합되어 복잡한 비전 문제를 해결하는 데 기여한다.

배경

컴퓨터 비전 기초 지식, 객체 탐지(Object Detection) 개념, Python 및 API 활용 능력

대상 독자

컴퓨터 비전 엔지니어 및 데이터 어노테이션 자동화에 관심 있는 AI 개발자

의미 / 영향

SAM 3의 등장은 수동 라벨링 의존도를 낮추고 자연어 기반의 직관적인 비전 시스템 구축을 가속화할 것이다. 이는 의료, 제조 등 특수 도메인에서의 AI 도입 장벽을 크게 낮추는 효과를 가져온다.

섹션별 상세

이미지 분석

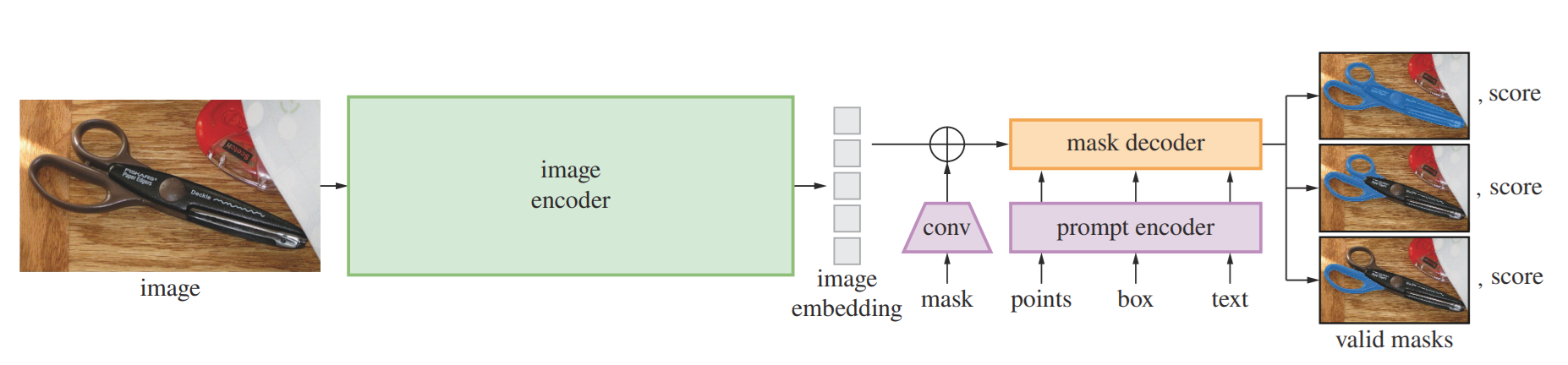

이미지 인코딩을 한 번만 수행하고 경량 디코더로 여러 프롬프트를 실시간 처리하는 원리를 확인할 수 있다.

SAM 1의 이미지 인코더와 프롬프트 인코더, 마스크 디코더 분리 구조 다이어그램이다.

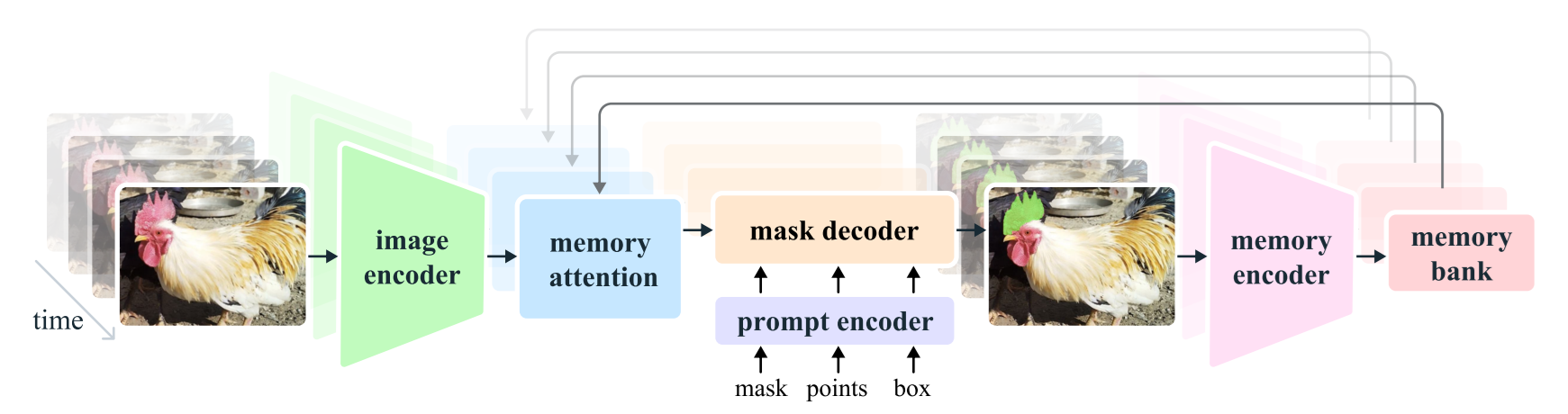

비디오 프레임 간의 시간적 일관성을 유지하기 위해 과거 정보를 활용하는 메커니즘이 포함되어 있다.

메모리 어텐션과 메모리 뱅크가 추가된 SAM 2의 아키텍처 구조도이다.

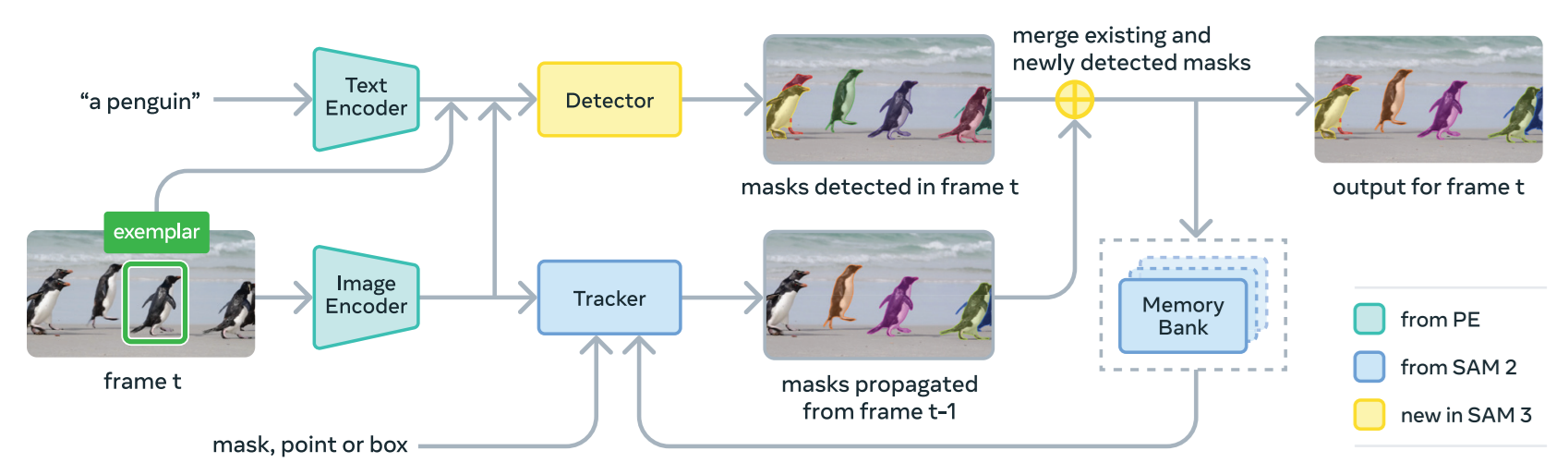

언어와 비전 특징을 정렬하여 텍스트 프롬프트만으로 객체를 분할하는 과정을 구체화했다.

텍스트 인코더와 이미지 인코더가 통합된 SAM 3의 개념 세그멘테이션 구조이다.

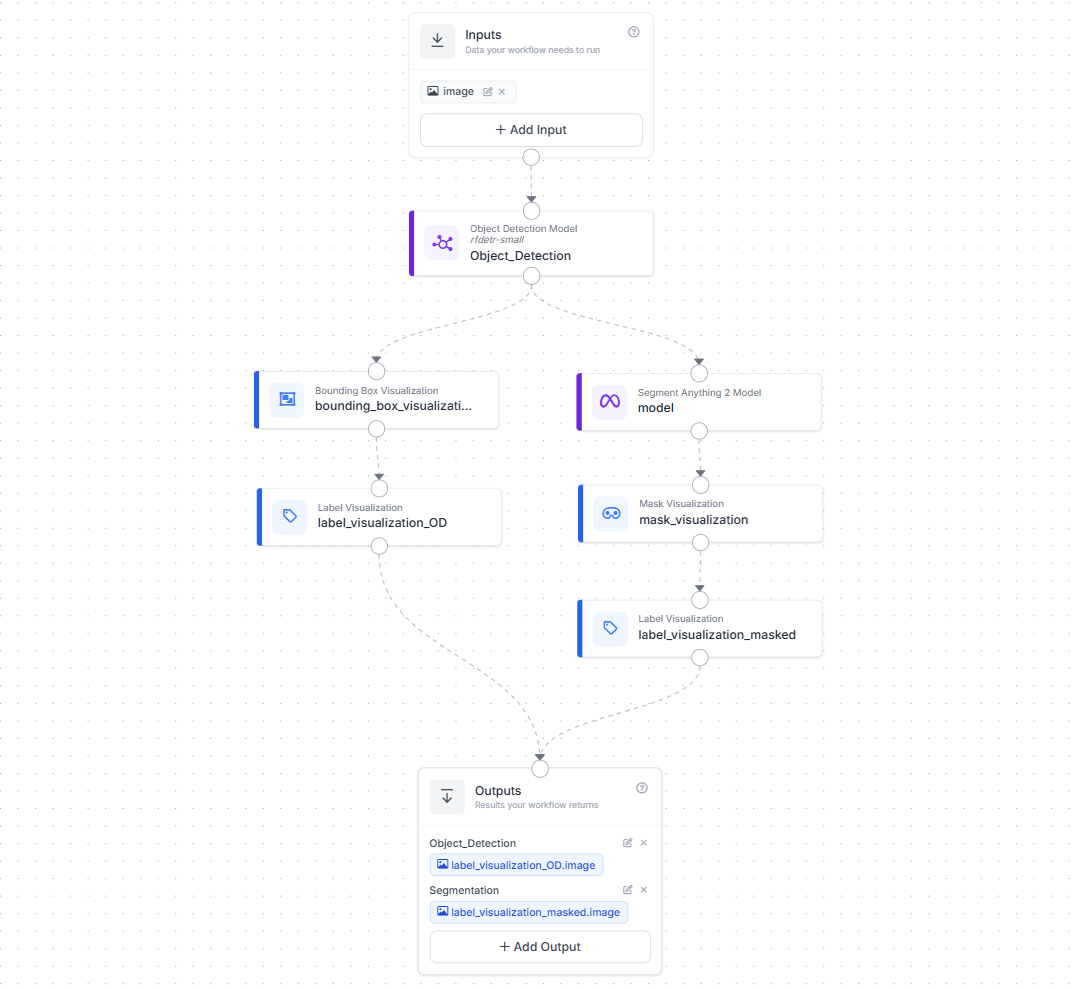

탐지된 바운딩 박스를 SAM 2의 프롬프트로 사용하여 정밀 마스크를 생성하는 파이프라인 구조를 형성한다.

객체 탐지 모델과 SAM 2를 결합한 Roboflow 워크플로우 구성도이다.

객체 탐지 결과가 SAM 2를 거쳐 픽셀 단위의 정교한 마스크로 변환된 실제 출력 사례이다.

야구 선수의 바운딩 박스가 세그멘테이션 마스크로 변환된 결과 화면이다.

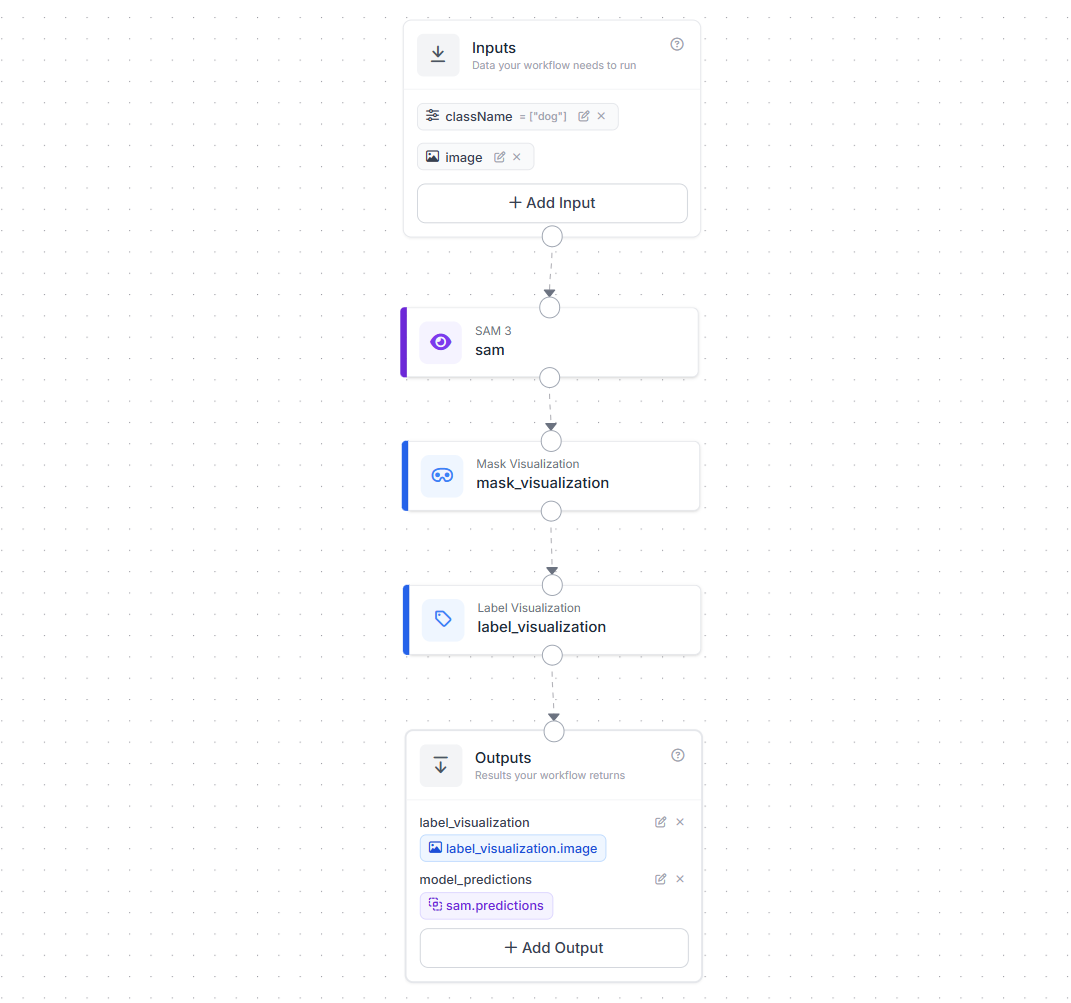

별도의 탐지 모델 없이 텍스트 프롬프트가 SAM 3 블록으로 전달되어 마스크를 생성하는 구조를 가진다.

텍스트 입력을 직접 사용하는 SAM 3 기반의 단순화된 워크플로우이다.

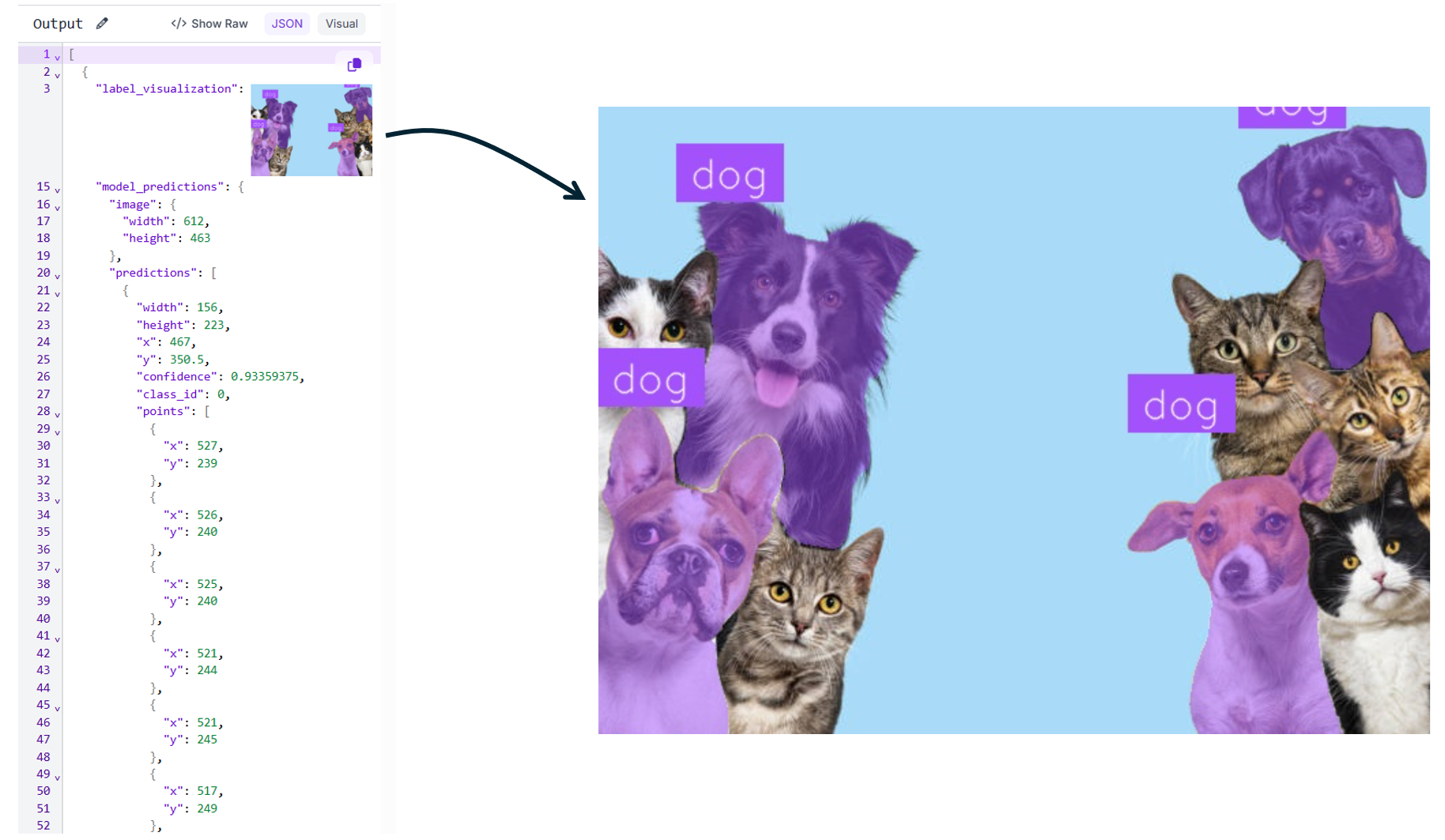

오픈 보캐블러리 기능을 통해 텍스트만으로 이미지 내의 특정 개념 객체들을 정확히 분할한 결과이다.

'dog'라는 텍스트 프롬프트로 여러 마리의 강아지를 분할한 결과 이미지이다.

실무 Takeaway

- SAM 3의 오픈 보캐블러리 기능을 활용하면 별도의 학습 데이터 없이도 텍스트 입력만으로 특정 객체를 즉시 분할할 수 있다.

- 비디오 프로젝트에서는 SAM 2의 메모리 기반 추적 기능을 사용하여 프레임 간 객체 정체성 유실 문제를 해결해야 한다.

- Roboflow Workflows를 이용해 기존 탐지 모델의 출력을 SAM의 프롬프트로 연결하면 마스크 생성 자동화가 가능하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료