핵심 요약

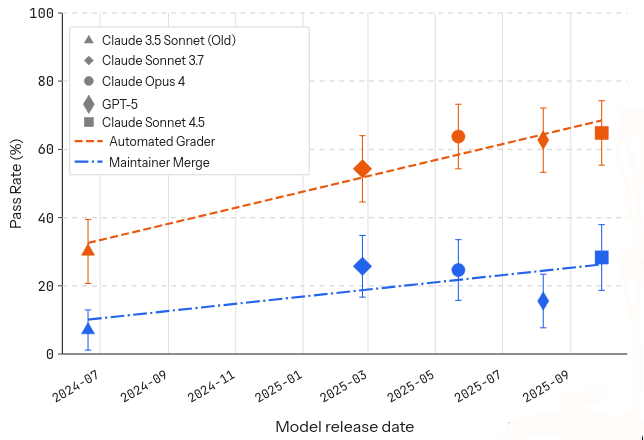

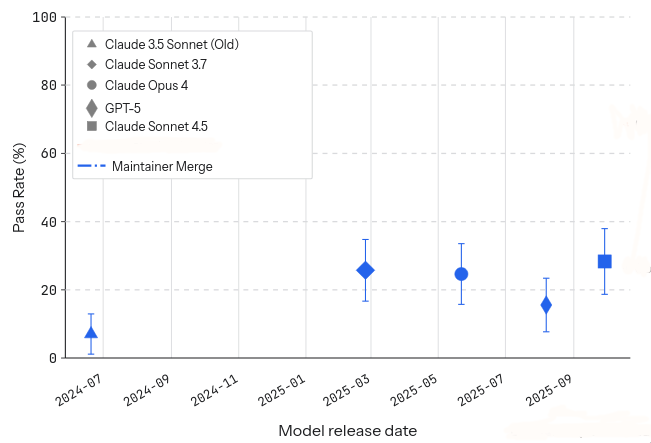

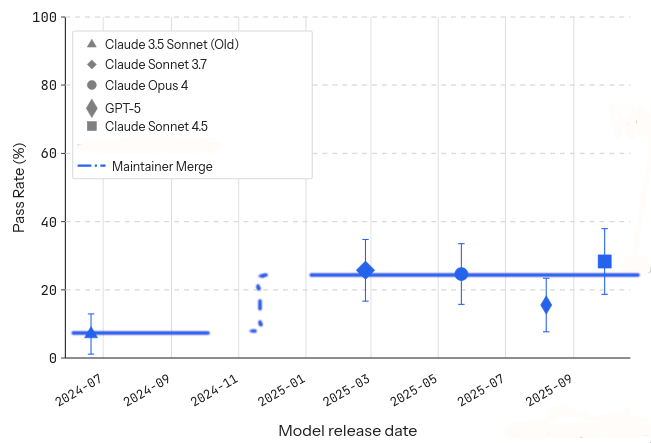

METR의 데이터를 바탕으로 LLM의 코딩 성능을 '테스트 통과'와 '유지보수자 머지 승인' 기준으로 나누어 분석했다. 자동화된 테스트 통과율은 꾸준히 상승하는 경향을 보이지만, 실제 머지 가능한 수준의 코드 품질을 나타내는 머지율은 2025년 초부터 유의미한 향상이 없는 상태다. Brier score를 이용한 모델 비교 결과, 선형 성장 모델보다 상수 함수 모델이 데이터에 더 잘 부합하여 지난 1년간 실질적인 코딩 능력의 도약이 없었음이 확인됐다. 이는 벤치마크 수치와 실제 현업에서 체감하는 성능 사이의 간극이 커지고 있음을 시사한다.

배경

SWE-bench 벤치마크에 대한 기본 이해, Brier Score 및 교차 검증 등 기초 통계 지식, LLM의 코드 생성 및 리뷰 프로세스에 대한 경험

대상 독자

LLM 기반 코딩 도구를 개발하거나 도입하려는 엔지니어 및 AI 성능 평가 연구자

의미 / 영향

이 분석은 LLM의 코딩 능력이 겉보기 벤치마크와 달리 실제 품질 면에서는 정체기에 접어들었을 가능성을 제기한다. 이는 단순히 모델의 크기를 키우거나 데이터를 늘리는 방식만으로는 실제 개발 환경의 복잡한 요구사항을 충족하는 '머지 가능한 코드'를 생성하는 데 한계가 있음을 시사하며, 새로운 아키텍처나 평가 방법론의 필요성을 강조한다.

섹션별 상세

실무 Takeaway

- LLM의 코딩 능력을 평가할 때 자동화된 테스트 통과율(Pass Rate)만으로는 실제 업무 적용 가능성을 판단하기 부족하므로 머지율(Merge Rate)과 같은 고차원 지표를 반드시 병행 확인해야 한다.

- 벤치마크 수치의 상승이 반드시 실질적인 논리력이나 코드 품질의 향상으로 이어지지 않을 수 있음을 인지하고, 신규 모델 도입 시 보수적인 성능 평가가 필요하다.

- Brier score와 같은 통계적 지표를 활용해 벤치마크 데이터의 시계열적 추세가 실제 기술적 성장인지 아니면 단순 노이즈인지를 객관적으로 검증하는 프로세스가 중요하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.