핵심 요약

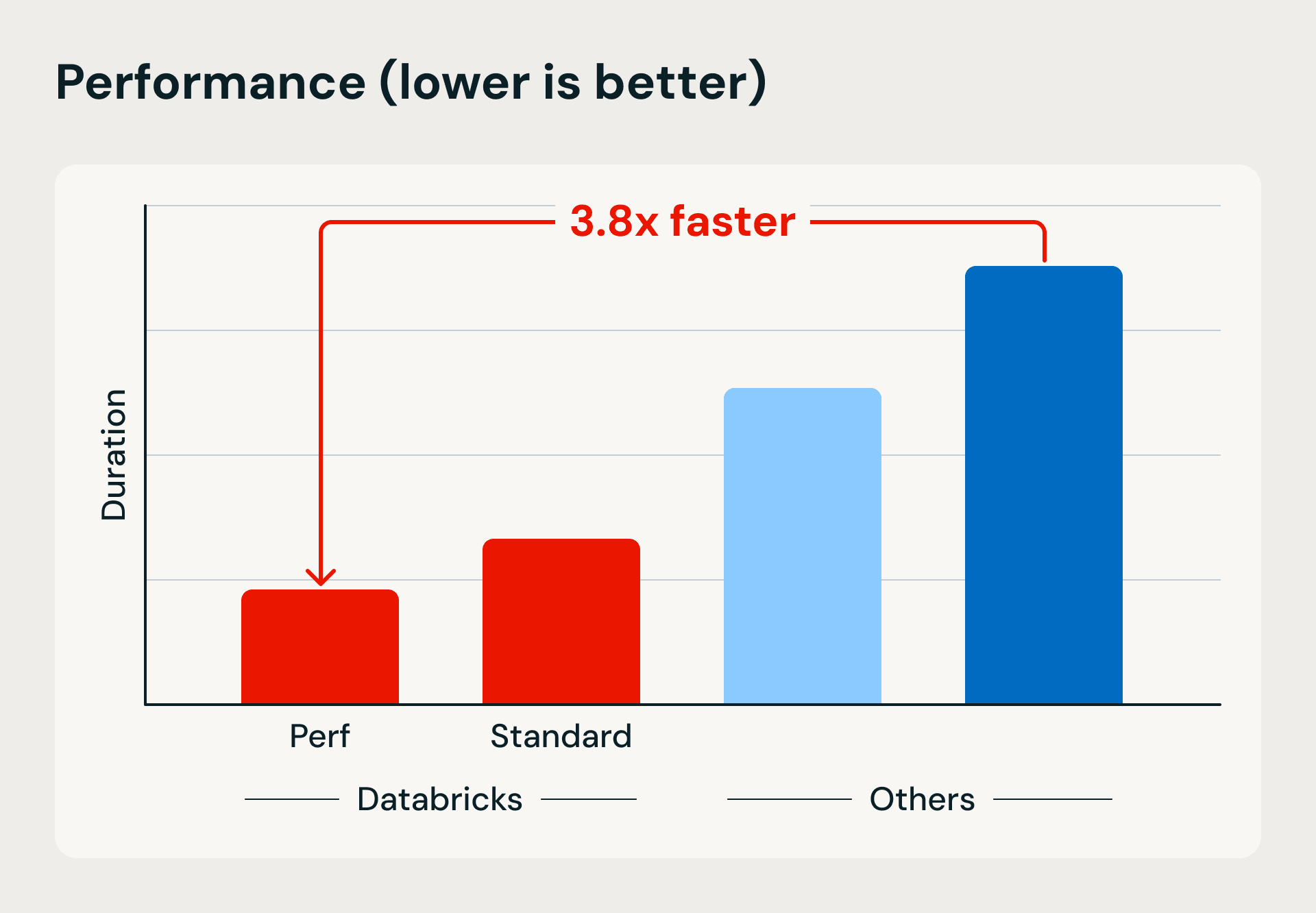

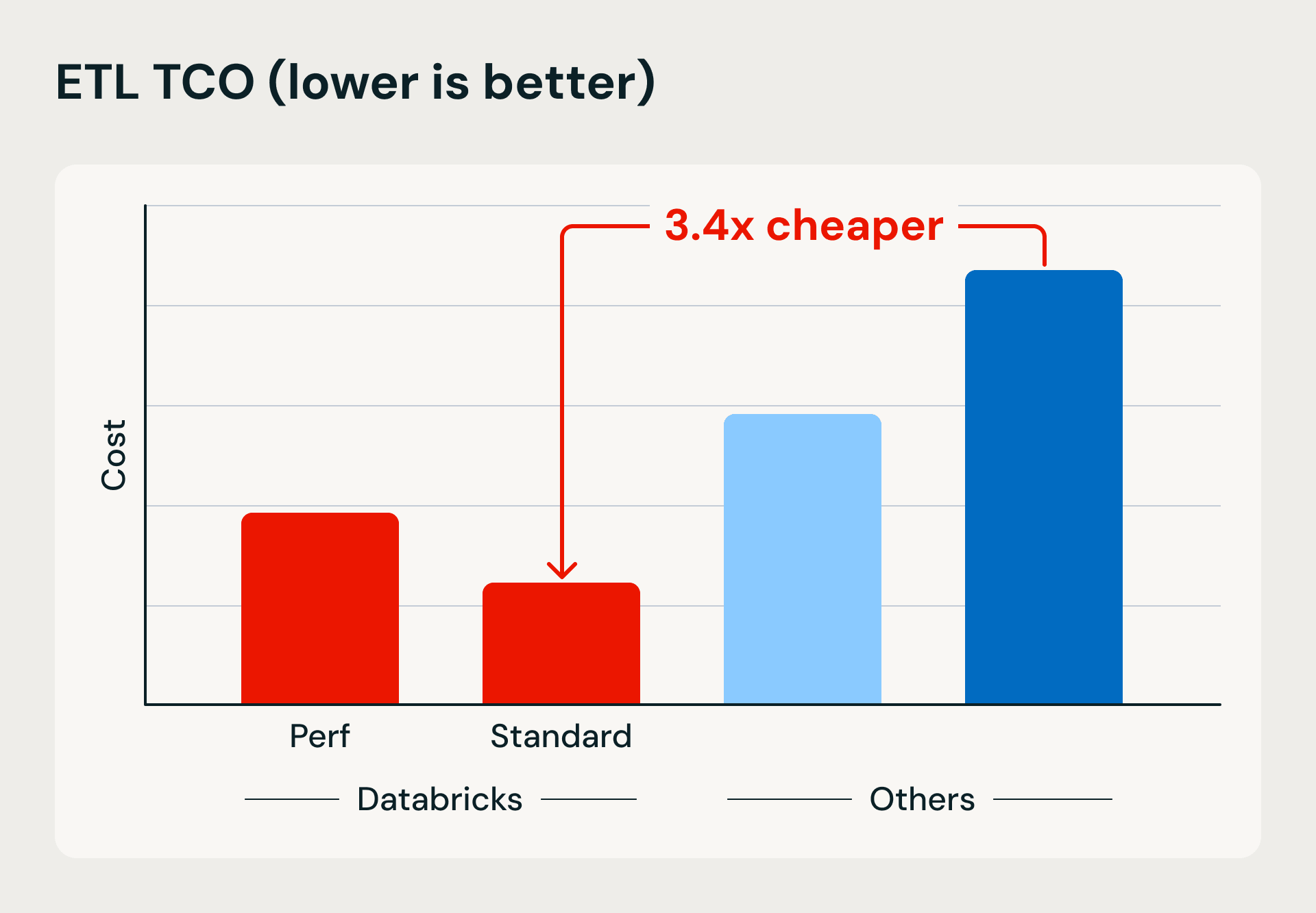

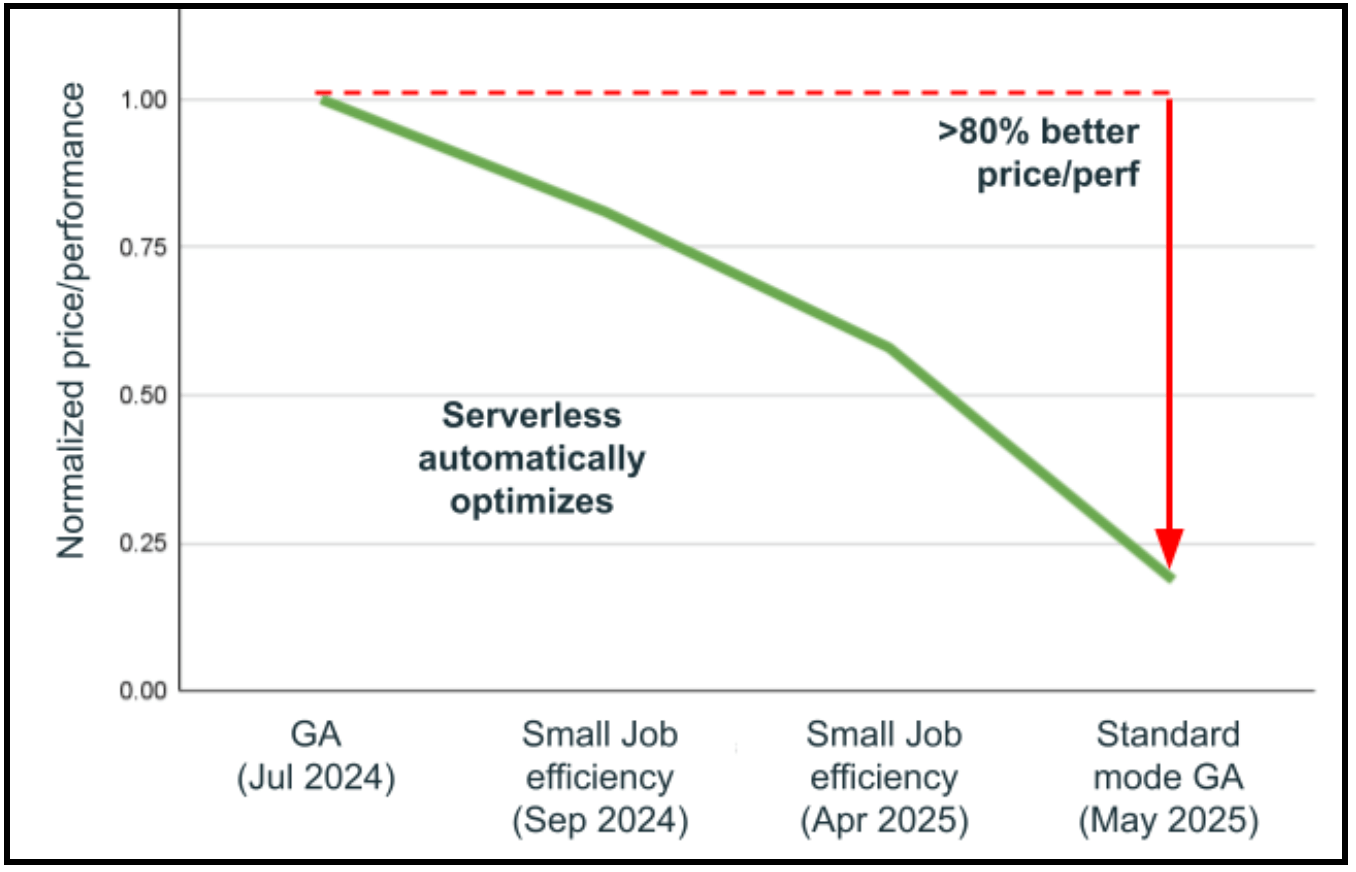

데이터 엔지니어링 팀은 전통적으로 VPC 설정, 인스턴스 사이징, 런타임 업그레이드와 같은 복잡한 인프라 관리에 많은 시간을 소모해 왔다. 데이터브릭스는 이를 해결하기 위해 노트북, Lakeflow Jobs, Spark Declarative Pipelines(SDP)를 위한 서버리스 컴퓨팅을 도입하여 인프라 운영을 완전히 자동화했다. 이 시스템은 지능형 환경 캐싱과 버전리스 아키텍처를 통해 지난 1년간 사용자 개입 없이도 성능을 80% 향상시켰으며, 표준 모드 사용 시 비용을 최대 70%까지 절감할 수 있게 한다. 결과적으로 데이터 팀은 인프라 유지보수 대신 비즈니스 가치를 창출하는 데이터 제품 개발에 집중할 수 있는 환경을 갖추게 되었다.

배경

Apache Spark 기본 지식, Databricks 플랫폼 사용 경험, 데이터 파이프라인 및 ETL 개념 이해

대상 독자

데이터 엔지니어, 데이터 과학자, MLOps 전문가 및 데이터 플랫폼 관리자

의미 / 영향

이 기술은 데이터 엔지니어링의 패러다임을 '인프라 관리'에서 '데이터 로직 집중'으로 전환시킵니다. 자동화된 최적화와 버전 관리는 운영 비용을 획기적으로 낮추어 소규모 팀도 대규모 데이터 파이프라인을 안정적으로 운영할 수 있게 하며, 기업 전반의 데이터 제품 출시 속도를 가속화할 것입니다.

섹션별 상세

실무 Takeaway

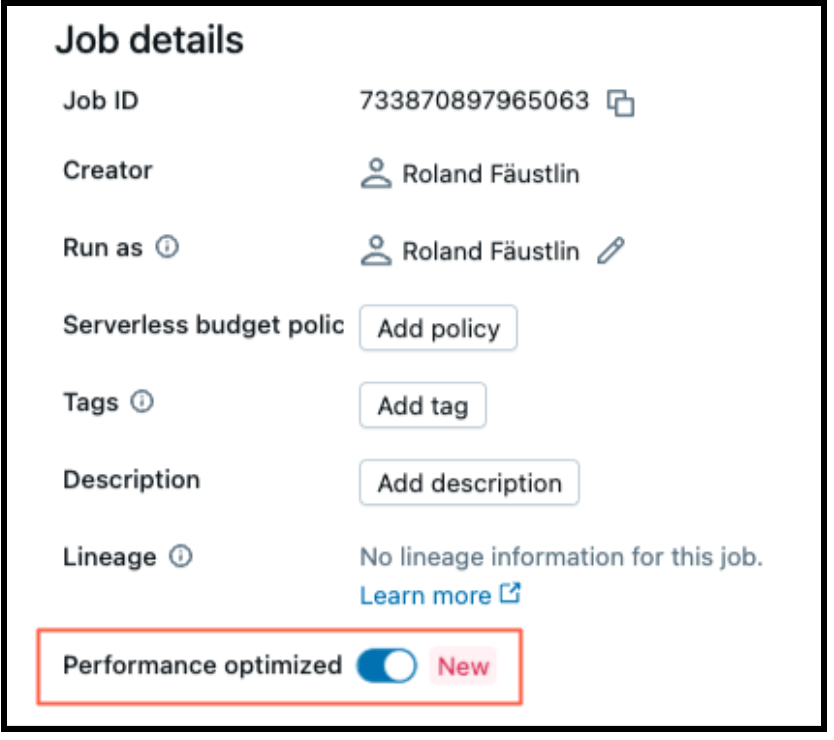

- 비용 효율이 중요한 대규모 배치 작업이나 예약된 작업에는 'Standard' 모드를 적용하여 성능 최적화 모드 대비 최대 70%의 DBUs 비용을 절감할 수 있다.

- 반복적인 라이브러리 설치가 필요한 데이터 과학 및 ML 워크로드에 서버리스 환경 캐싱을 활용하면 환경 준비 시간을 초 단위로 단축하여 전체 실행 속도를 2배 높일 수 있다.

- 수동 런타임 업그레이드 공수를 없애기 위해 버전리스 아키텍처를 채택하면 운영 리스크 없이 최신 Spark 성능 개선 사항을 즉시 워크로드에 반영할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료