핵심 요약

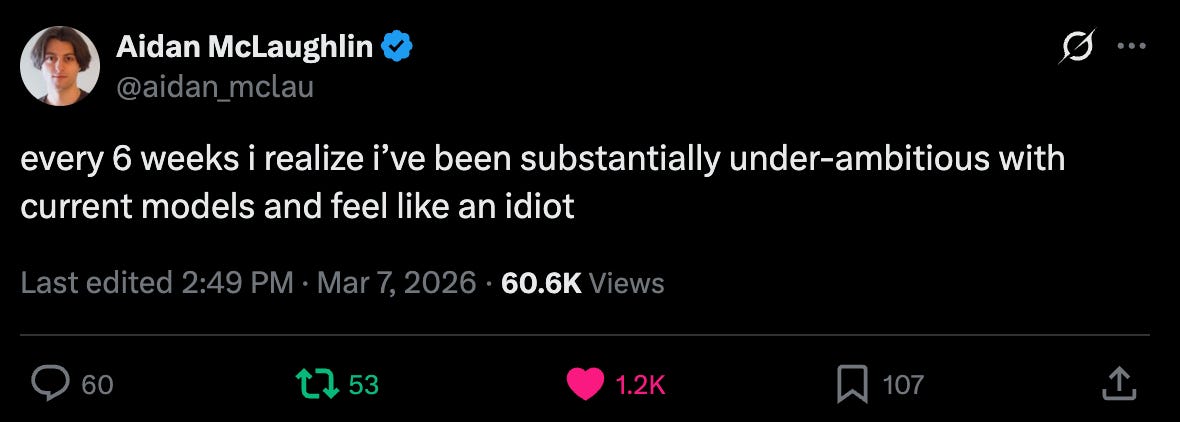

현재 AI 모델의 능력을 과소평가하고 낮은 수준의 작업에만 머무르는 '야망의 부족'이 LLM 활용의 가장 큰 장벽으로 지적되었습니다. 기술적으로는 MCP(Model Context Protocol)가 Uber와 같은 대기업 내부 인프라로 자리 잡으며 에이전트 통합의 표준이 되고 있으며, 코딩 에이전트 분야에서는 지능과 효율성을 동시에 측정하는 CursorBench와 같은 새로운 평가 체계가 등장했습니다. 또한 NVIDIA의 Nemotron 3 Super 공개와 구글의 네이티브 멀티모달 임베딩 출시로 인해 추론 경제성과 검색 성능을 둘러싼 기술 경쟁이 더욱 심화되는 양상입니다.

배경

LLM 에이전트 아키텍처에 대한 기본 이해, RAG(검색 증강 생성) 및 벡터 임베딩 개념, MoE(Mixture of Experts) 모델 구조에 대한 지식

대상 독자

LLM 애플리케이션 개발자, AI 시스템 아키텍트 및 기술 전략가

의미 / 영향

이 뉴스는 AI 모델의 지능 자체보다 모델을 둘러싼 '하네스'와 '인프라'의 중요성이 커지고 있음을 시사합니다. MCP의 확산과 새로운 코딩 벤치마크의 등장은 AI 에이전트가 실험실을 벗어나 실제 기업의 생산 환경으로 깊숙이 침투하고 있음을 보여주는 강력한 신호입니다.

섹션별 상세

실무 Takeaway

- 현재 LLM의 능력을 예단하여 단순한 작업에만 국한시키지 말고, 복잡한 에이전트 워크플로우와 도구 연동 시스템에 모델을 투입하여 잠재력을 최대한 끌어내야 한다.

- 에이전트 시스템 설계 시 MCP를 표준 프로토콜로 도입하여 향후 다양한 도구 및 데이터 소스와의 연동 확장성을 확보하고 기술 부채를 방지해야 한다.

- RAG 시스템 구축 시 단일 벡터 임베딩의 한계를 고려하여, 고도의 정확도가 필요한 멀티모달 검색 환경에서는 ColPali와 같은 후기 상호작용(Late Interaction) 모델 도입을 검토해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료