핵심 요약

소프트웨어 엔지니어링(SE) 에이전트는 작업 과정에서 방대한 로그를 생성하며, 이는 높은 API 비용과 모델 성능 저하를 초래한다. JetBrains Research는 기존의 'LLM 요약' 방식과 '관찰 마스킹' 방식을 실험적으로 비교하여 마스킹 방식의 효율성을 입증했다. 특히 두 방식의 장점을 결합한 하이브리드 솔루션을 통해 비용을 50% 이상 절감하면서도 문제 해결 능력을 유지하거나 향상시킬 수 있음을 보여주었다. 이 연구는 NeurIPS 2025 워크숍에서 발표될 예정이며, 실무적인 에이전트 설계 가이드를 제공한다.

배경

LLM 에이전트의 추론-행동-관찰(ReAct/CodeAct) 루프에 대한 이해, 토큰 기반 API 과금 체계 및 컨텍스트 윈도우 개념

대상 독자

프로덕션 환경에서 LLM 에이전트를 구축하고 운영 비용 최적화를 고민하는 AI 엔지니어 및 연구자

의미 / 영향

이 연구는 LLM 에이전트 운영의 경제적 장벽을 낮추는 실질적인 방법론을 제시한다. 특히 복잡한 알고리즘보다 단순한 데이터 마스킹이 더 효과적일 수 있다는 결과는 에이전트 아키텍처 설계 시 효율성 우선 원칙의 중요성을 시사한다.

섹션별 상세

에이전트 컨텍스트 팽창은 토큰 비용을 급증시키고 모델의 유효 컨텍스트 크기를 줄여 성능 저하를 유발하는 핵심 문제이다.

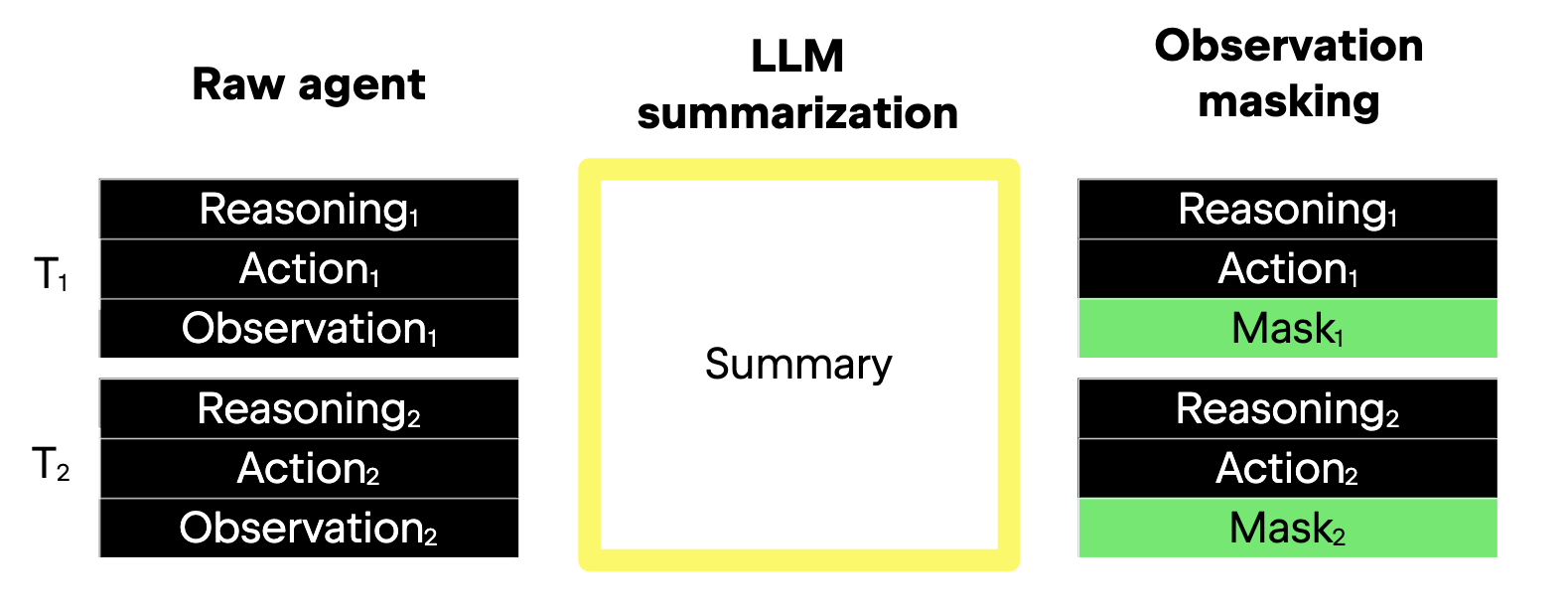

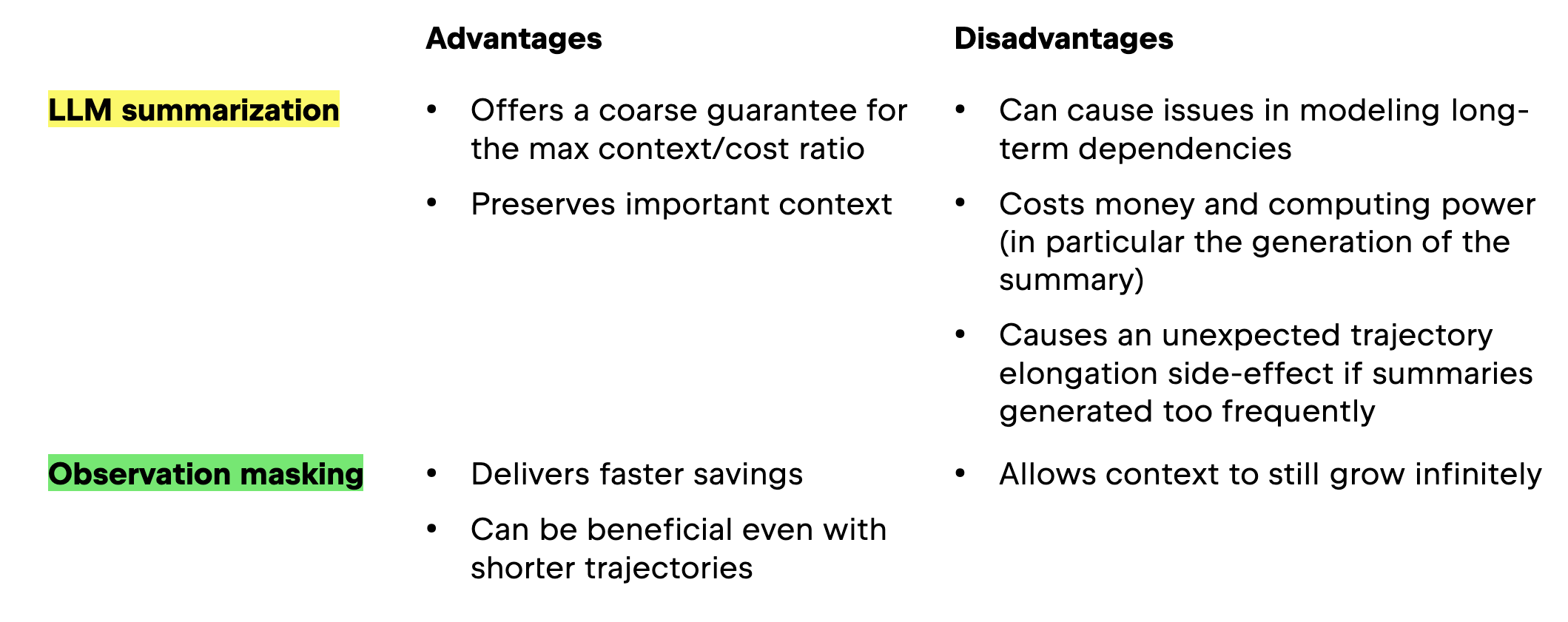

관찰 마스킹(Observation Masking)은 과거의 환경 관찰 결과만 플레이스홀더로 대체하고 추론과 행동 기록은 유지하여 컨텍스트 크기를 획기적으로 줄이는 저비용 고효율 방식이다.

LLM 요약(LLM Summarization)은 이론적으로 무한한 컨텍스트 확장이 가능하지만, 요약 생성 시 추가 API 비용이 발생하고 에이전트가 불필요하게 더 많은 단계를 수행하게 만드는 '궤적 연장' 부작용이 확인됐다.

SWE-bench Verified 벤치마크 실험 결과, 관찰 마스킹은 Qwen3-Coder 480B 모델 기준 비용을 52% 절감하면서도 성공률을 2.6% 향상시켜 요약 방식보다 우수한 효율성을 보였다.

JetBrains가 제안한 하이브리드 솔루션은 평소에는 마스킹을 사용하다가 컨텍스트가 임계치에 도달할 때만 요약을 수행하여, 순수 마스킹 대비 7%, 요약 대비 11%의 추가 비용 절감을 달성했다.

에이전트 프레임워크마다 대화 이력을 관리하는 방식이 다르므로, 최적의 성능을 위해서는 마스킹 윈도우 크기와 같은 하이퍼파라미터의 정밀한 튜닝이 필수적이다.

실무 Takeaway

- 복잡한 LLM 요약 기법을 도입하기 전에 단순한 관찰 마스킹(Observation Masking)을 우선 적용하여 비용 대비 성능을 검증해야 한다.

- LLM 요약은 에이전트가 종료 시점을 오판하게 하여 실행 시간을 15% 이상 늘릴 수 있으므로, 요약 호출 빈도를 엄격히 제어해야 한다.

- 하이브리드 접근법을 사용하면 모델 가중치 수정 없이도 GPT-5나 Claude 같은 최신 모델에서 즉각적인 비용 절감 효과를 거둘 수 있다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료