핵심 요약

LLM 추론 가속을 위한 투기적 디코딩 기법인 EAGLE은 드래프트 토큰 생성 시 순차적인 연산이 필요해 병목 현상이 발생한다. P-EAGLE은 이를 해결하기 위해 K개의 드래프트 토큰을 단일 포워드 패스에서 동시에 생성하는 병렬 구조를 도입했다. NVIDIA B200 환경에서 기존 EAGLE-3 대비 최대 1.69배의 속도 향상을 달성했으며, vLLM v0.16.0부터 공식 통합되어 사용 가능하다. 이 방식은 드래프트 토큰 수 증가에 따른 오버헤드를 제거하고 수용률(Acceptance Rate)까지 개선하여 실질적인 추론 효율을 극대화한다.

배경

vLLM v0.16.0 이상, 투기적 디코딩(Speculative Decoding) 기본 개념, NVIDIA GPU (B200 권장) 및 CUDA 환경

대상 독자

LLM 추론 성능 최적화 및 vLLM 기반 프로덕션 환경을 운영하는 엔지니어

의미 / 영향

P-EAGLE은 투기적 디코딩의 고질적인 문제인 드래프트 오버헤드를 해결함으로써 더 크고 정확한 드래프트 모델을 사용할 수 있는 길을 열었다. 이는 고성능 GPU 자원을 더 효율적으로 활용하게 하여 AI 서비스의 운영 비용 절감과 사용자 경험 개선에 기여할 것이다.

섹션별 상세

EAGLE은 드래프트 토큰을 생성할 때 순차적인(Autoregressive) 방식을 사용하므로 K개의 토큰을 예측하려면 K번의 포워드 패스가 필요하다. 드래프트 모델이 길게 예측할수록 이 오버헤드가 커져 성능 이득이 제한되는 병목 현상이 발생한다.

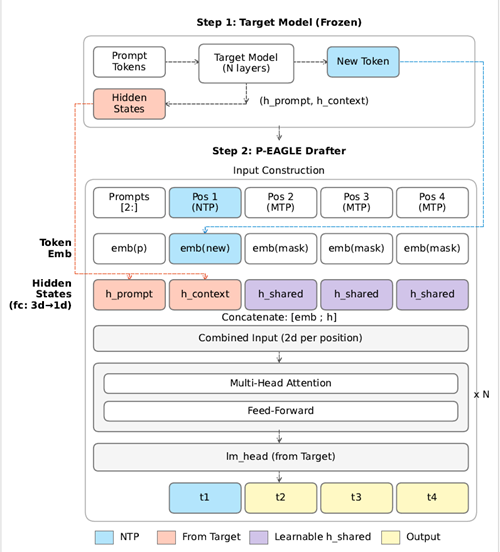

P-EAGLE은 모든 드래프트 토큰을 단일 포워드 패스에서 병렬로 생성하여 이 한계를 제거했다. 타겟 모델에서 추출한 히든 스테이트와 학습 가능한 마스크 임베딩을 결합하여 한 번의 연산으로 여러 위치의 토큰을 동시에 예측하는 아키텍처를 갖췄다.

긴 문맥(Long Context) 학습 시 발생하는 메모리 문제를 해결하기 위해 시퀀스 분할 알고리즘을 도입했다. 시퀀스를 청크로 나누고 청크 간 어텐션 의존성을 유지하며 그래디언트를 누적함으로써 8K 이상의 긴 시퀀스에서도 효과적인 학습이 가능하다.

vLLM 통합 과정에서 병렬 드래프팅에 특화된 융합 Triton 커널을 구현했다. GPU 상에서 배치 메타데이터를 직접 재구성하고 마스크 토큰을 삽입하는 과정을 최적화하여 CPU-GPU 간 통신 오버헤드와 런칭 지연 시간을 최소화했다.

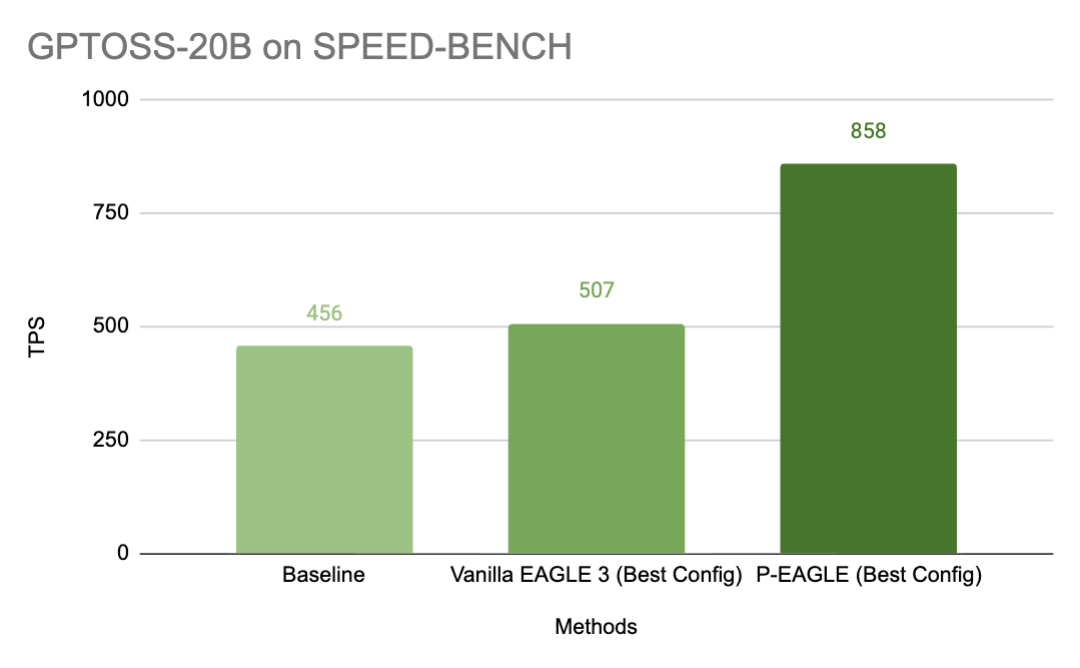

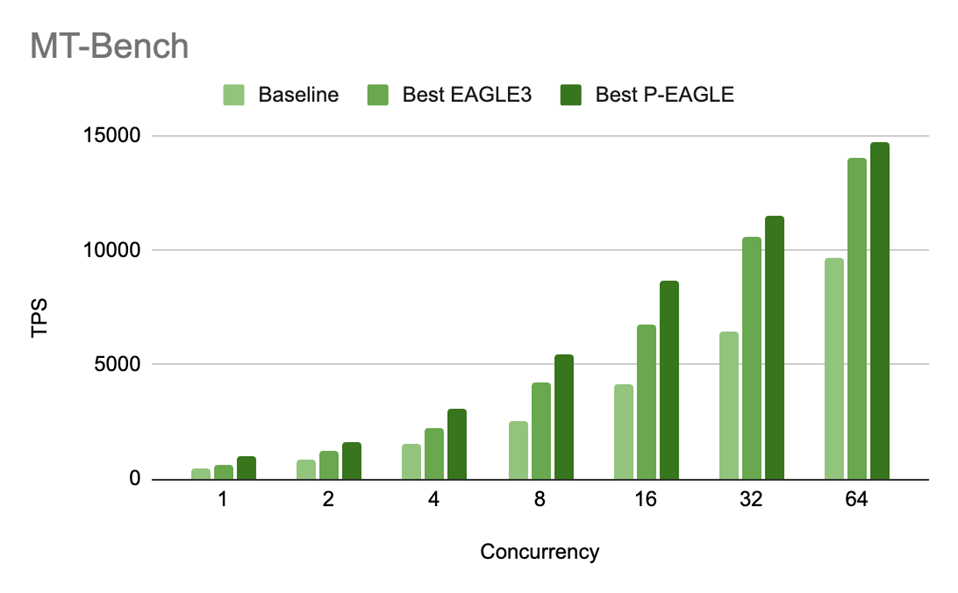

NVIDIA B200 GPU에서 수행한 벤치마크 결과, P-EAGLE은 낮은 동시성 환경에서 최대 1.69배의 성능 향상을 보였다. 특히 드래프트 토큰 수(K)를 7개까지 늘려도 연산 비용이 추가되지 않아 기존 EAGLE-3보다 높은 토큰 수용률과 처리량을 유지했다.

실무 Takeaway

- vLLM 설정에서 parallel_drafting: true 옵션을 활성화하여 P-EAGLE의 병렬 투기적 디코딩 기능을 즉시 적용할 수 있다.

- 드래프트 토큰 수(K)를 늘려도 연산 오버헤드가 증가하지 않으므로, 더 깊은 투기적 예측을 통해 전체적인 추론 처리량을 극대화할 수 있다.

- NVIDIA B200과 같은 최신 하드웨어에서 P-EAGLE은 기존 방식 대비 최대 69% 이상의 속도 향상을 제공하여 대규모 서비스의 지연 시간을 단축한다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료