핵심 요약

임베딩은 주로 자연어 처리에서 사용되지만, 정형 데이터의 수치적 표현을 보완하거나 대체하는 데에도 강력한 도구이다. 이 글은 고차원 범주형 변수 처리부터 수치형 데이터의 비선형 구조 캡처까지, 정형 데이터 머신러닝 워크플로에서 임베딩을 활용하는 10가지 구체적인 전략을 제시한다. 각 전략은 의미론적 유사성을 포착하고 특성 공학의 효율성을 높이는 데 중점을 둔다. 이를 통해 정형 데이터 기반 모델의 성능을 한 단계 더 발전시킬 수 있는 실무적인 통찰을 제공한다.

배경

Python 및 Pandas 라이브러리 기초, 임베딩(Embedding) 및 벡터 표현에 대한 기본 개념, Scikit-learn, TensorFlow 또는 XGBoost 사용 경험

대상 독자

정형 데이터 기반 머신러닝 모델의 성능을 개선하고자 하는 데이터 사이언티스트 및 ML 엔지니어

의미 / 영향

이 기술들은 딥러닝의 전유물로 여겨졌던 임베딩을 전통적인 정형 데이터 분석에 이식하여 모델의 표현력을 획기적으로 높인다. 특히 텍스트와 수치가 혼재된 실제 비즈니스 데이터에서 단순한 인코딩보다 훨씬 풍부한 정보를 모델에 전달할 수 있게 한다.

섹션별 상세

from tensorflow.keras.layers import Input, Embedding, Flatten, Dense, Concatenate

from tensorflow.keras.models import Model

user_input = Input(shape=(1,))

user_embed = Embedding(input_dim=500, output_dim=8)(user_input)

user_vec = Flatten()(user_embed)

prod_input = Input(shape=(1,))

prod_embed = Embedding(input_dim=50, output_dim=8)(prod_input)

prod_vec = Flatten()(prod_embed)

concat = Concatenate()([user_vec, prod_vec])

output = Dense(1)(concat)

model = Model([user_input, prod_input], output)

model.compile("adam", "mse")TensorFlow를 사용하여 사용자 및 제품 ID와 같은 범주형 변수를 임베딩 레이어로 처리하는 예시

from gensim.models import Word2Vec

sentences = df["review"].str.lower().str.split().tolist()

w2v = Word2Vec(sentences, vector_size=16, min_count=1)

df["review_emb"] = df["review"].apply(

lambda t: np.mean([w2v.wv[w] for w in t.lower().split()], axis=0)

)Gensim의 Word2Vec을 사용하여 텍스트 리뷰의 단어 임베딩을 평균 내어 문장 벡터를 생성하는 예시

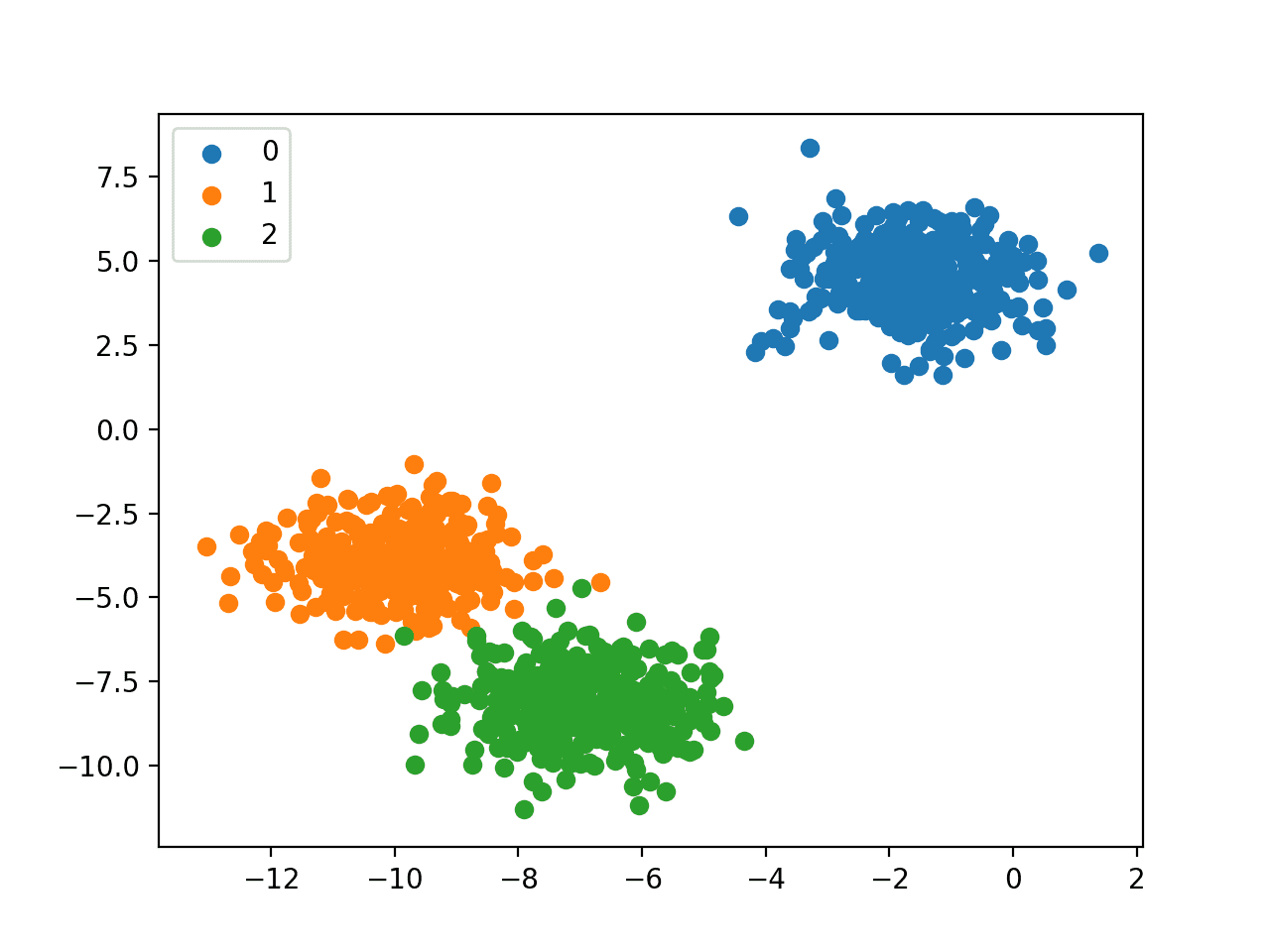

from sklearn.cluster import KMeans

emb_matrix = np.vstack(df["review_emb"].values)

km = KMeans(n_clusters=3, random_state=42).fit(emb_matrix)

df["review_topic"] = km.labels_생성된 임베딩 벡터에 K-Means 클러스터링을 적용하여 새로운 메타 특성을 추출하는 예시

from sentence_transformers import SentenceTransformer

model = SentenceTransformer("sentence-transformers/all-MiniLM-L6-v2")

df["sent_emb"] = list(model.encode(df["review"].tolist()))Sentence Transformers를 활용하여 긴 텍스트를 고정 크기의 의미론적 벡터로 변환하는 예시

import xgboost as xgb

X = pd.concat(

[pd.DataFrame(df["review_emb"].tolist()), df[["rating"]]], axis=1

)

y = df["rating"]

model = xgb.XGBRegressor()

model.fit(X, y)추출된 임베딩 벡터를 기존 수치형 데이터와 결합하여 XGBoost 모델의 입력값으로 사용하는 예시

이미지 분석

데이터 입력부터 중앙의 소용돌이 형태의 프로세스를 거쳐 검색, 보안, 분석, 통합 등 다양한 하위 작업으로 분기되는 과정을 보여준다. 기사에서 다루는 10가지 기법이 데이터 파이프라인의 각 단계에서 어떻게 적용될 수 있는지 상징적으로 나타낸다.

정형 데이터 ML 작업을 위한 10가지 임베딩 활용 전략을 시각화한 인포그래픽이다.

원본 데이터에서 유용한 특징을 뽑아내어 모델 학습에 적합한 형태로 변환하는 과정을 설명한다. 임베딩이 단순한 데이터 변환을 넘어 특성 공학의 핵심 도구로 사용됨을 강조하는 시각 자료이다.

정형 데이터 준비 과정에서 특성 추출이 이루어지는 흐름도이다.

실무 Takeaway

- 고카디널리티 범주형 변수에 원-핫 인코딩 대신 임베딩 레이어를 적용하여 차원의 저주를 피하고 항목 간 의미적 유사성을 학습한다.

- 정형 데이터 내의 텍스트 정보를 Sentence Transformers로 벡터화하여 기존 수치형 데이터와 결합하면 모델의 문맥 이해도를 극대화할 수 있다.

- 수치형 데이터를 구간화한 후 임베딩을 적용함으로써 단순 선형 관계를 넘어선 복잡한 데이터 패턴과 이상치를 효과적으로 캡처한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.