핵심 요약

Anthropic이 Claude Opus 4.6과 Sonnet 4.6 모델의 100만 토큰 컨텍스트 윈도우를 정식 출시하며 긴 문맥 처리 성능의 새로운 기준을 세웠다. 하지만 HBM 및 DRAM 공급 부족이라는 물리적 한계로 인해 컨텍스트 윈도우의 확장은 지난 2년간 100만 토큰 수준에서 정체된 상태이다. 이에 따라 업계는 단순한 크기 확장 대신 희소 어텐션 최적화, 영구 메모리 계층 구조 도입, 그리고 강화학습을 대체할 수 있는 효율적인 파인튜닝 기법인 RandOpt 등에 주목하고 있다. 또한 생물학 분야의 OpenFold3와 같은 오픈소스 모델의 발전도 이번 주 주요 소식으로 공유되었다.

배경

LLM 추론 및 어텐션 메커니즘에 대한 기본 지식, RAG(검색 증강 생성) 및 컨텍스트 윈도우 개념, 강화학습(RLHF, PPO)의 기초 이해

대상 독자

LLM 인프라 엔지니어, AI 에이전트 개발자 및 머신러닝 연구원

의미 / 영향

컨텍스트 윈도우의 물리적 확장 한계가 명확해짐에 따라, 향후 AI 경쟁의 핵심은 단순한 모델 크기나 컨텍스트 길이가 아니라 메모리 효율화 기술과 지능적인 정보 관리 아키텍처로 이동할 것이다.

섹션별 상세

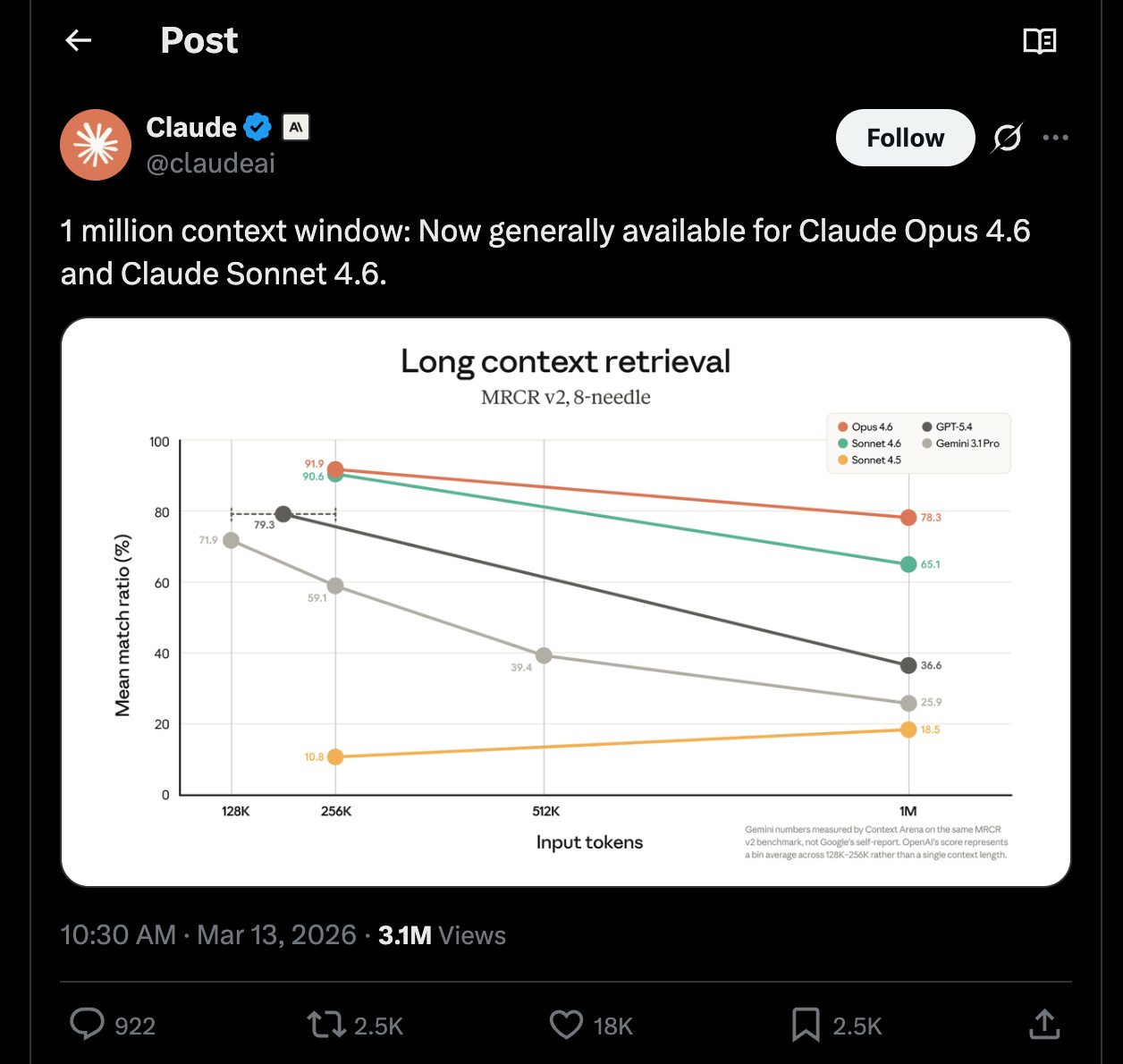

Anthropic은 Claude Opus 4.6 및 Sonnet 4.6 모델의 100만 토큰 컨텍스트 윈도우를 정식 출시했으며, MRCR v2 벤치마크에서 78.3%의 정확도를 기록하며 업계 최고 수준의 성능을 입증했다.

LLM의 컨텍스트 윈도우 확장은 HBM과 DRAM의 물리적 공급 부족으로 인해 지난 2년간 100만 토큰 수준에서 성장이 둔화되었으며, 향후 사용량에 따른 '컨텍스트 배급제'가 도입될 가능성이 제기되었다.

AI 에이전트 분야에서는 단순한 컨텍스트 확장의 대안으로 캐시와 메모리 계층 구조를 갖춘 컴퓨터 아키텍처 관점의 영구 메모리(Persistent Memory) 시스템 구축이 활발하게 논의되고 있다.

DeepSeek의 IndexCache 기법은 희소 어텐션의 인덱스 정보를 레이어 간에 재사용하여 GLM-5 모델에서 약 1.2배, 긴 문맥 추론 시 최대 1.82배의 속도 향상을 달성하며 실무적 최적화 가능성을 보여주었다.

MIT 연구진이 발표한 RandOpt 기법은 사전 학습된 모델 가중치에 가우시안 노이즈를 추가하고 앙상블하는 방식만으로도 GRPO나 PPO와 같은 복잡한 강화학습 파인튜닝에 필적하는 성능을 낼 수 있음을 확인했다.

생물학 연구 분야에서는 AlphaFold3의 성능을 추격하면서도 학습 데이터셋과 설정값을 완전히 공개하여 재현성을 확보한 OpenFold3 프리뷰 2 버전이 공개되어 연구 커뮤니티의 큰 관심을 받았다.

실무 Takeaway

- 대규모 문서 분석이나 복잡한 RAG 시스템 구축 시 MRCR 성능이 검증된 Claude 4.6의 100만 컨텍스트를 활용하여 정보 검색의 정확도를 극대화할 수 있다.

- 물리적 하드웨어 한계로 컨텍스트 확장이 정체됨에 따라, 에이전트 설계 시 단순 주입보다는 메모리 계층 구조나 효율적인 요약 저장 방식을 도입하는 것이 장기적으로 유리하다.

- 강화학습 파인튜닝의 높은 비용과 복잡성이 부담되는 환경에서는 RandOpt와 같은 가중치 노이즈 앙상블 기법을 통해 추론 및 코딩 성능 향상을 시도할 수 있다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료