핵심 요약

Z.ai가 시스템 엔지니어링과 장기 작업(Long-horizon) 에이전트에 최적화된 오픈 가중치 모델 GLM-5를 출시했다. Modal Research 팀은 출시 전 협력을 통해 자사 인프라에서 모델을 테스트했으며, MIT 라이선스로 제공되는 이 모델이 최신 상용 모델에 필적하는 성능을 보임을 확인했다. Modal은 개발자들이 GLM-5를 직접 경험해 볼 수 있도록 2026년 4월 말까지 무료 엔드포인트를 제공하며, SGLang과 8개의 B200 GPU를 활용한 최적화된 배포 코드도 함께 공개했다.

배경

LLM 추론 및 서빙 기초, GPU 병렬 처리 개념, OpenAI API 호환성 이해

대상 독자

AI 에이전트 개발자 및 인프라 엔지니어

의미 / 영향

오픈 소스 모델이 상용 모델의 성능을 빠르게 추격함에 따라, 기업들이 특정 벤더에 종속되지 않고 자체 인프라에서 고성능 에이전트를 운영할 수 있는 환경이 가속화될 것이다.

섹션별 상세

GLM-5는 장기적인 작업 수행이 필요한 에이전트와 복잡한 시스템 엔지니어링을 위해 설계된 프론티어급 오픈 모델이다. 기존의 단순 코드 완성이나 채팅 수준을 넘어 복잡한 시스템의 개발 및 개선과 같은 고난도 작업을 수행할 수 있는 능력을 갖추고 있다. 특히 MIT 라이선스를 채택하여 상용 모델 수준의 성능을 오픈 소스 생태계에 제공한다는 점에서 큰 의미가 있다.

기술적으로 GLM-5는 8비트 부동 소수점 정밀도에서 약 700GB에 달하는 거대한 크기를 자랑하며, 효율적인 추론을 위해 MoE(Mixture-of-Experts) 구조를 채택했다. 단일 GPU의 메모리 대역폭 한계를 극복하기 위해 DeepSeek의 Sparse Attention 변형 기술을 사용하며, Modal은 이를 8개의 B200 GPU 노드에서 텐서 병렬 처리(Tensor Parallelism)와 데이터 병렬 처리(Data Parallelism)를 결합해 최적화했다.

Modal은 개발자들이 GLM-5를 쉽게 통합할 수 있도록 OpenAI API 호환 엔드포인트를 무료로 개방했다. OpenCode, OpenClaw와 같은 최신 에이전트 프레임워크는 물론, LiteLLM 프록시를 통한 Claude Code 연동, Vercel AI SDK를 활용한 자바스크립트 애플리케이션 구축 방법이 포함되어 있다. 개인용 코딩 에이전트 활용을 위해 동시 요청 1회 제한 내에서 토큰 제한 없이 사용할 수 있다.

이미지 분석

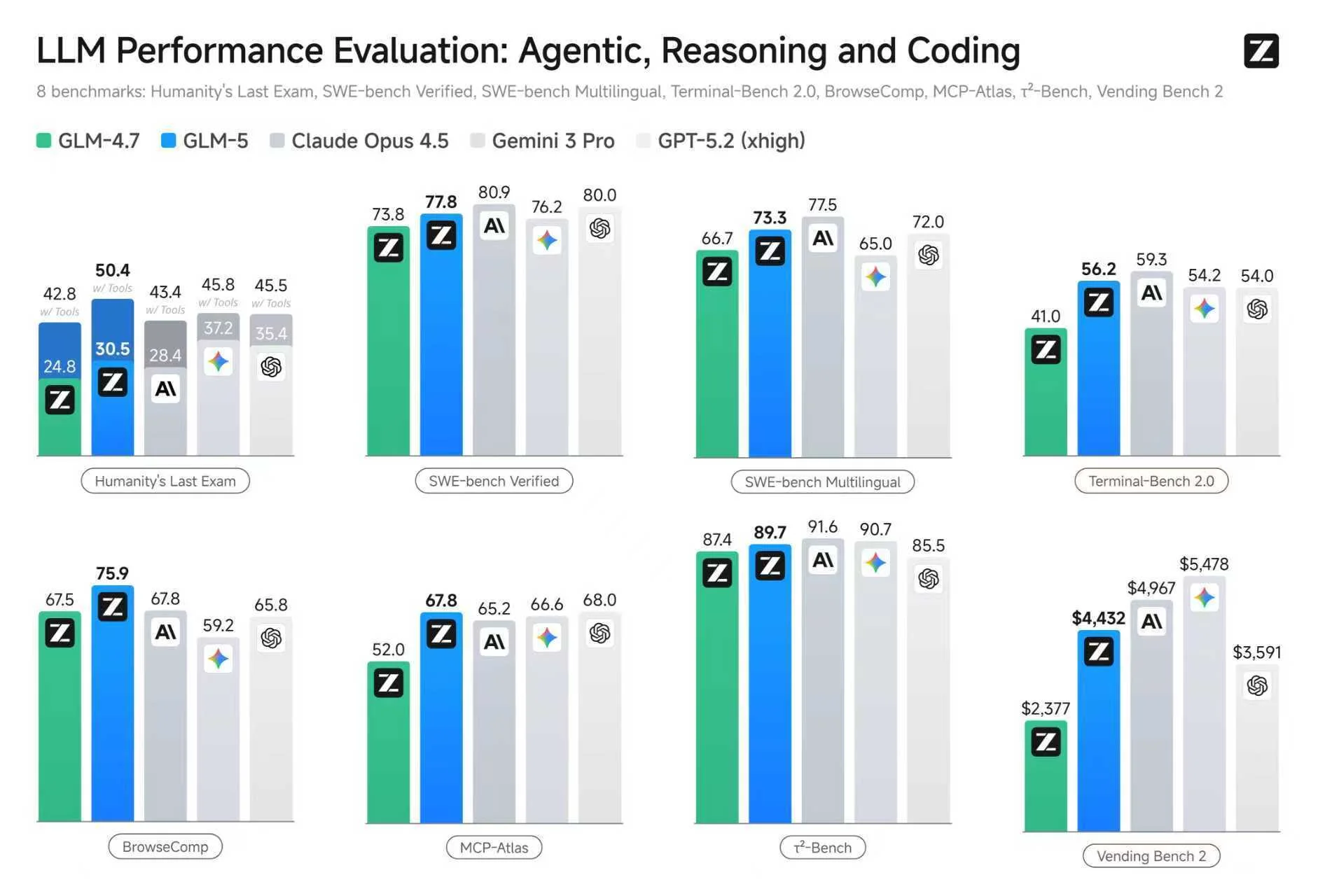

GLM-5가 최신 상용 모델들과 비교하여 어느 정도의 성능을 기록했는지 시각적으로 보여주며, 기사에서 주장하는 프론티어급 성능을 뒷받침하는 근거 자료로 활용된다.

GLM-5의 성능을 다른 모델들과 비교한 벤치마크 결과 차트

</> 코드 예제 포함

실무 Takeaway

- GLM-5는 MIT 라이선스로 공개되어 상용 모델에 의존하지 않고도 고성능 코딩 에이전트를 구축할 수 있는 강력한 대안을 제시한다.

- 700GB 규모의 모델을 효율적으로 구동하기 위해 MoE 구조와 DeepGemm, FlashMLA 같은 특화된 커널을 활용한 다중 GPU 병렬 처리가 필수적이다.

- Modal이 제공하는 무료 엔드포인트를 통해 2026년 4월까지 추가 비용 없이 최신 프론티어 모델을 기존 개발 워크플로우에 통합해 테스트할 수 있다.

언급된 리소스

GitHubGLM-5 Deployment Code

API DocsModal GLM-5 Endpoint

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료