핵심 요약

대규모 GPU 클러스터 운영은 하드웨어의 불완전성으로 인해 높은 신뢰도를 유지하기 매우 어렵다. Modal은 AWS, GCP, Azure, OCI 등 주요 클라우드 제공업체로부터 2만 대 이상의 GPU를 공급받아 운영하며, 각 업체별 성능 및 안정성 차이를 데이터로 확인했다. 이를 해결하기 위해 자동화된 머신 이미지 빌드, 부팅 시점의 경량 점검, 그리고 운영 중 지속적인 수동 및 능동 상태 점검 체계를 구축했다. 이러한 시스템을 통해 사용자에게 높은 수준의 업타임을 제공하며, 발생한 장애에 대해서는 투명한 가시성과 신속한 지원을 보장한다.

배경

클라우드 컴퓨팅 기초, NVIDIA GPU 아키텍처, Linux 시스템 관리

대상 독자

GPU 인프라 엔지니어, MLOps 전문가, 대규모 LLM 서비스를 운영하는 개발자

의미 / 영향

GPU 하드웨어의 높은 불량률을 인정하고 이를 소프트웨어적으로 자동 감지 및 격리하는 시스템의 중요성을 시사한다. 클라우드 제공업체 선택 시 단순 가격뿐만 아니라 실제 운영 데이터 기반의 신뢰도 평가가 필수적임을 보여준다.

섹션별 상세

이미지 분석

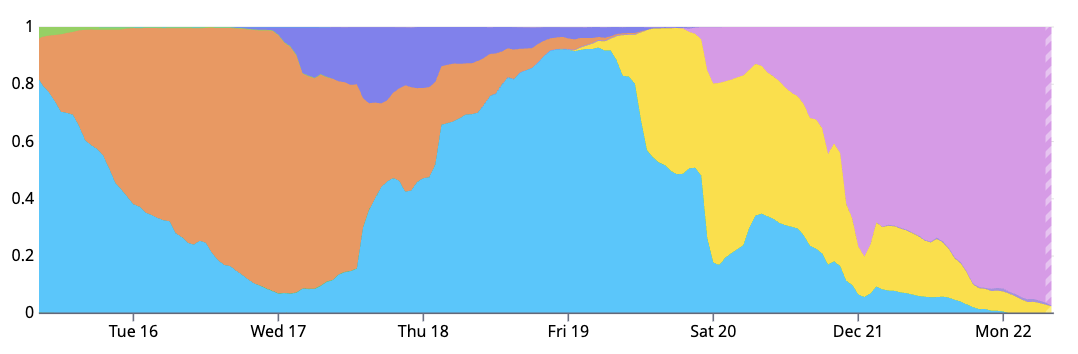

시간에 따라 여러 버전의 이미지가 점진적으로 배포되고, 특정 버전에서 문제가 발생했을 때 롤백되는 과정을 시각화하여 Modal의 안정적인 이미지 관리 전략을 나타낸다.

머신 이미지 버전별 배포 현황을 보여주는 시계열 그래프이다.

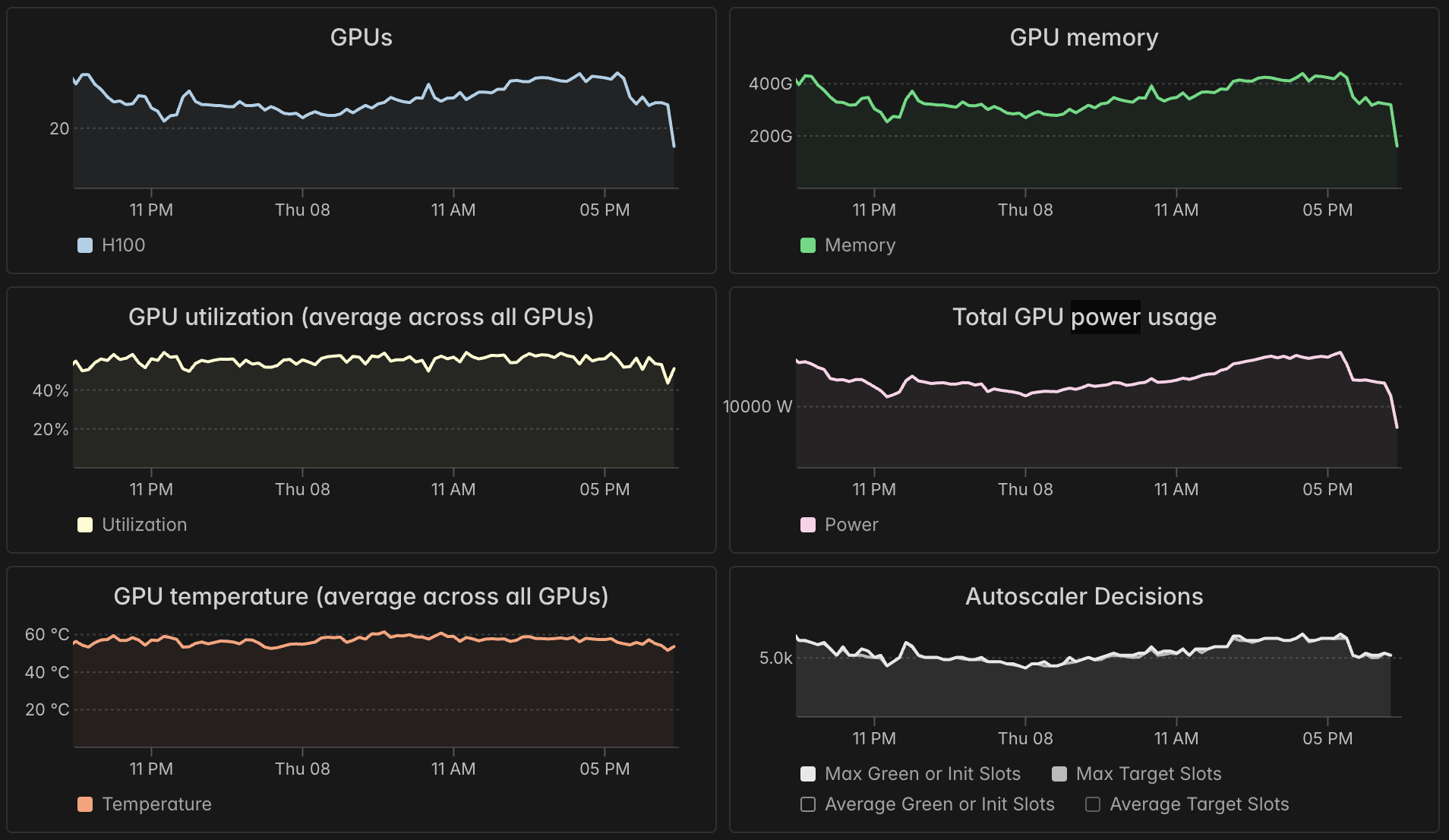

사용자에게 제공되는 실시간 모니터링 항목을 보여주며, 하드웨어 상태를 투명하게 공개하는 Modal의 운영 방식을 증명한다.

Modal 대시보드에서 제공하는 GPU 사용률, 메모리, 온도, 전력 지표 화면이다.

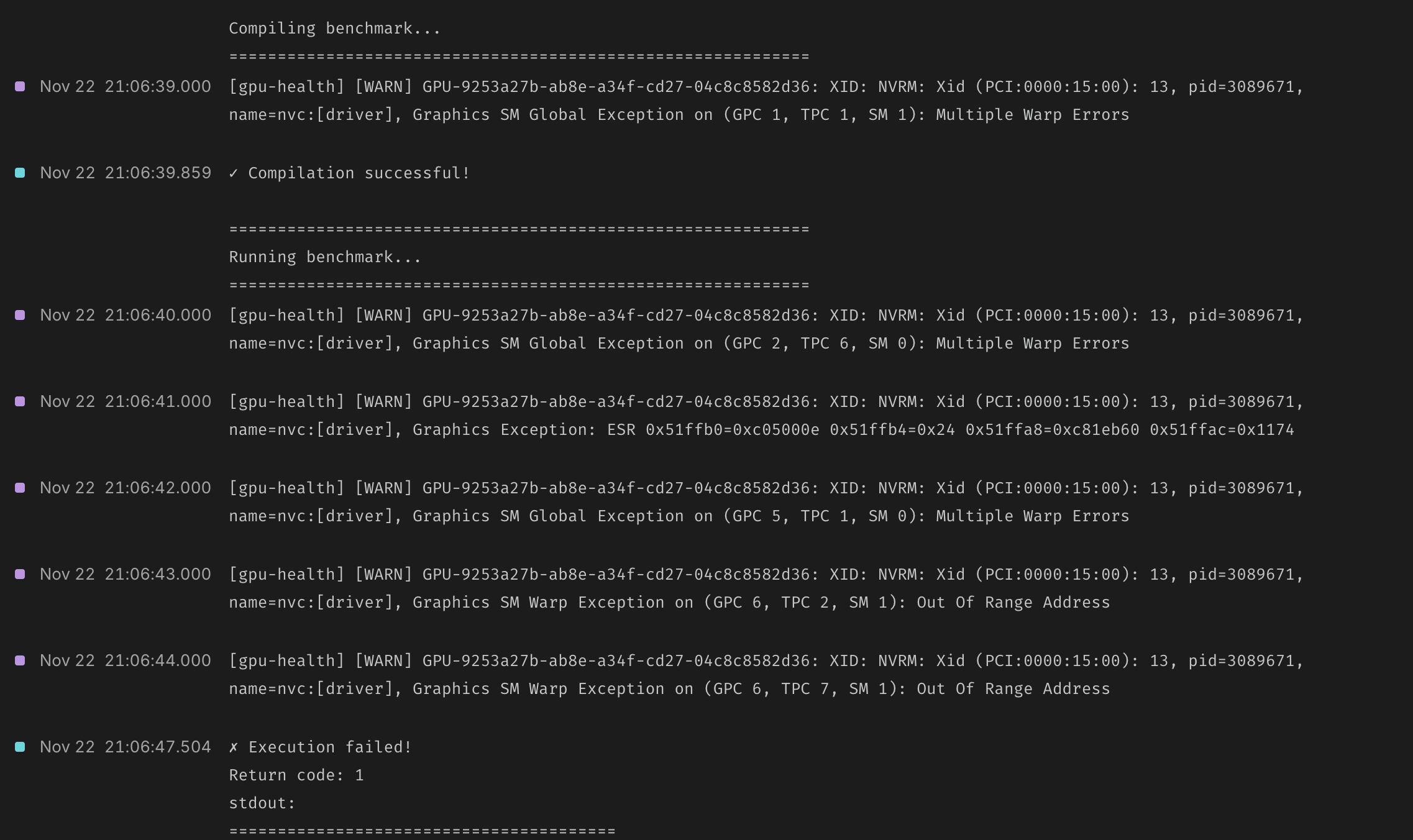

하드웨어 장애 발생 시 시스템이 이를 감지하여 사용자 로그에 직접 정보를 제공함으로써 장애 원인 파악을 돕는 기능을 보여준다.

컨테이너 로그에 표시된 Xid 13 오류 및 GPU 상태 점검 메시지이다.

실무 Takeaway

- H100 도입 시 성능 극대화를 위해 PCIe 방식보다 SXM 방식을 우선적으로 선택해야 하며, 이는 행렬 연산에서 40% 이상의 성능 차이를 만든다.

- 대규모 운영 시 모든 부팅 인스턴스에 정밀 진단을 돌리는 것은 비효율적이므로, 가벼운 부팅 체크와 주간 단위의 심층 체크를 병행하는 전략이 유효하다.

- GPU 장애의 약 58.7%가 하드웨어 이슈인 만큼, 애플리케이션 레벨에서 CUDA 초기화 재시도 로직을 구현하여 일시적인 결함에 대비해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료