핵심 요약

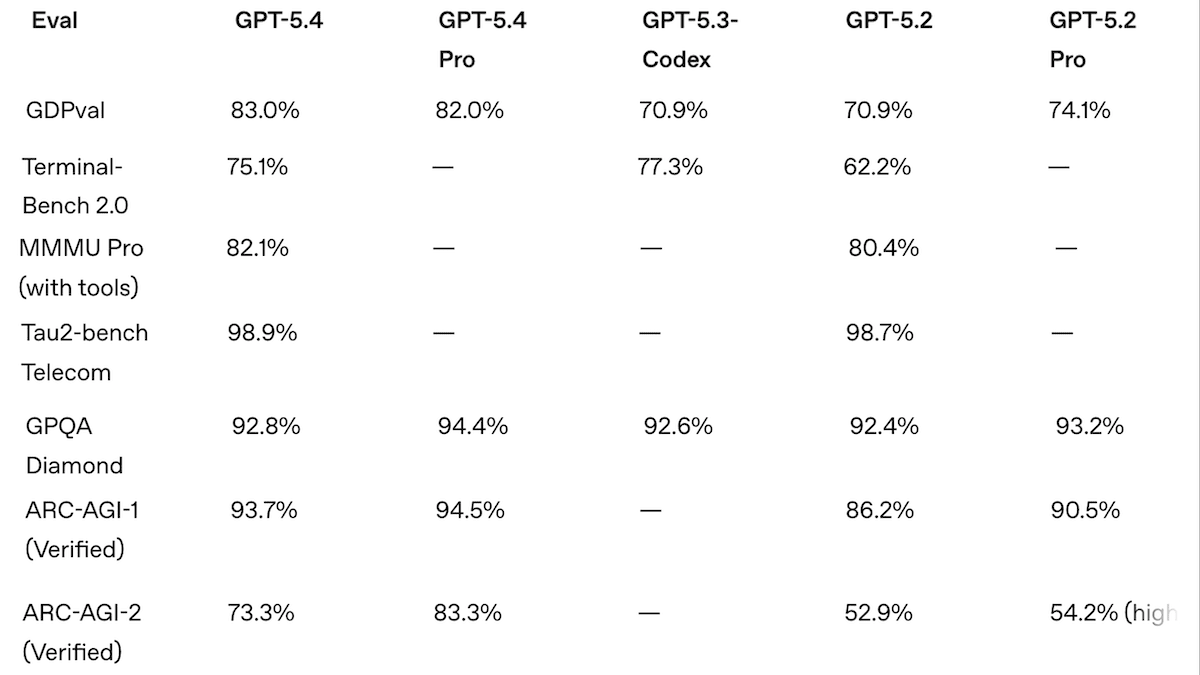

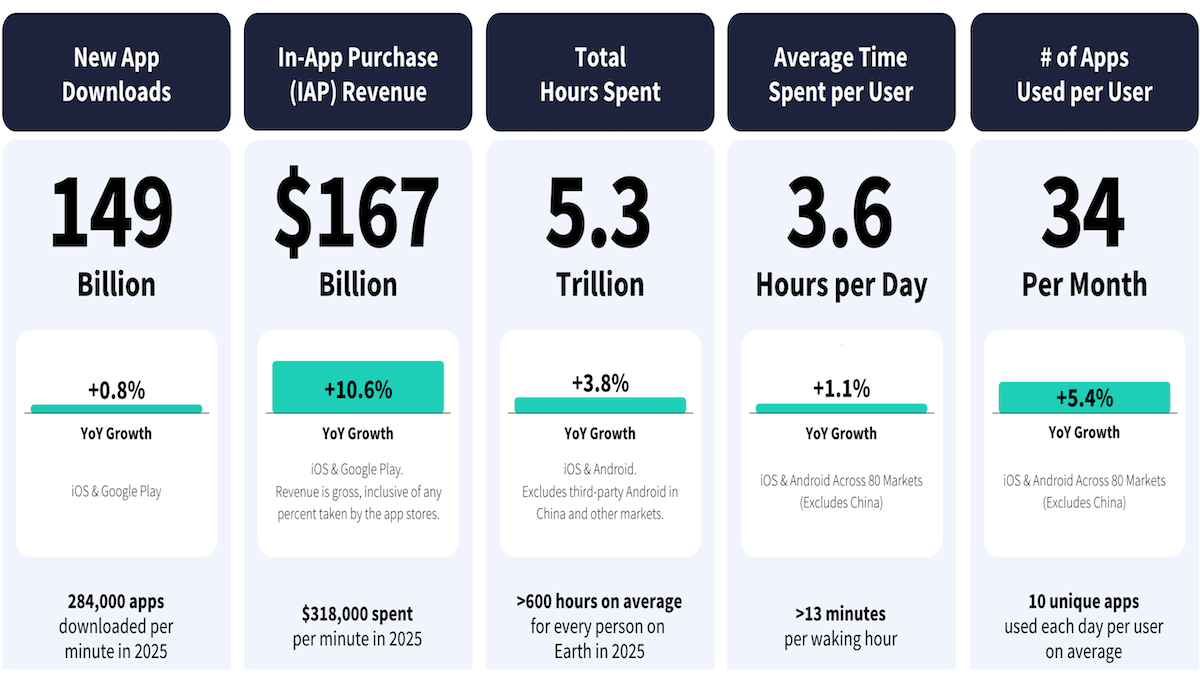

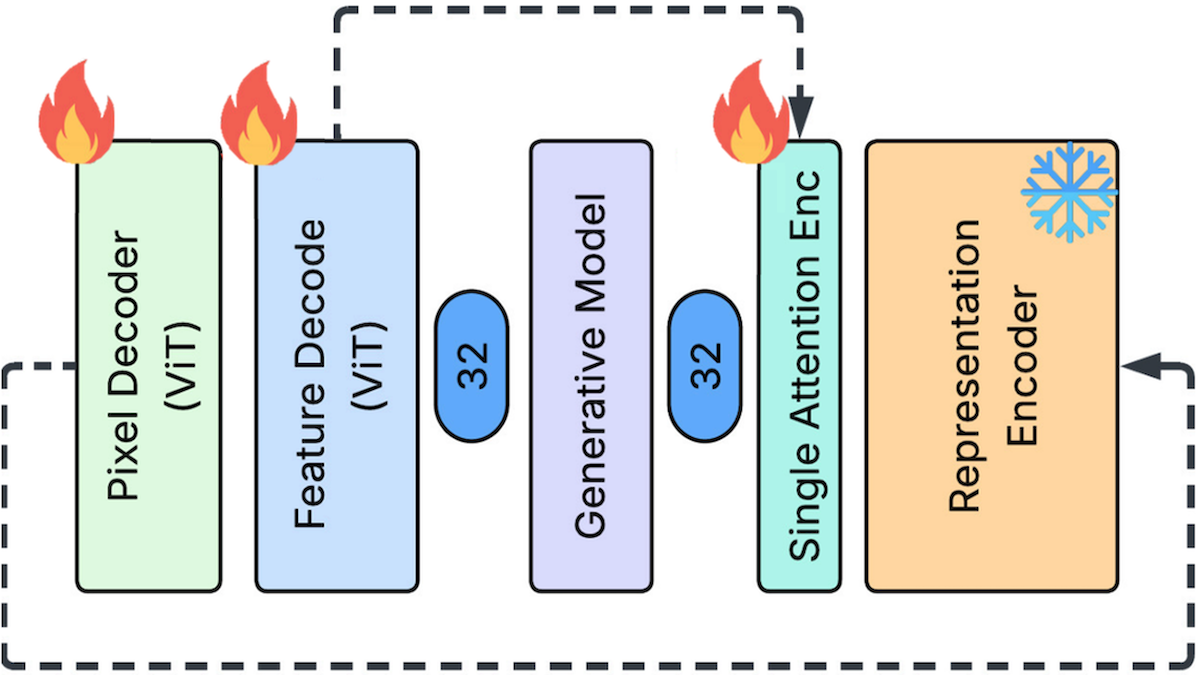

앤드류 응은 코딩 에이전트들이 최신 API 문서를 공유하고 버그 피드백을 주고받는 '에이전트를 위한 스택 오버플로우' 개념을 제시하며 Context Hub(chub)의 확장을 제안했다. OpenAI는 도구 사용과 컴퓨터 제어 능력이 강화된 GPT-5.4 Thinking 및 Pro 모델을 출시하며 벤치마크 성능을 갱신했으나 높은 가격 정책을 유지하고 있다. 모바일 환경에서는 AI 앱 매출이 50억 달러를 돌파하며 게임 매출을 추월하는 등 사용자 습관의 변화가 뚜렷해졌다. 또한 메타와 OpenAI 등은 전력망 병목 현상을 해결하기 위해 자체 가스 발전소를 건설하는 '오프그리드' 전략을 취하고 있으며, 애플 연구진은 비전 인코더 임베딩을 활용해 확산 모델 학습 속도를 7배 높이는 FAE 기법을 공개했다.

배경

LLM 및 에이전트 아키텍처 기본 지식, 확산 모델(Diffusion Model)의 작동 원리, API 비용 구조 및 벤치마크 지표에 대한 이해

대상 독자

AI 에이전트 개발자, LLM 서비스 기획자, 데이터센터 인프라 및 ML 연구원

의미 / 영향

AI 기술 경쟁이 모델 성능을 넘어 에이전트 간의 협업 생태계, 모바일 플랫폼 점유율, 그리고 에너지 인프라 확보라는 다각적인 차원으로 확대되고 있다. 특히 폐쇄형 모델의 고비용 구조와 전력 수급 문제는 향후 AI 산업의 지속 가능성을 결정짓는 핵심 변수가 될 것이다.

섹션별 상세

실무 Takeaway

- 코딩 에이전트의 정확도를 높이기 위해 Context Hub(chub)와 같은 최신 API 문서 공급 도구를 워크플로우에 통합하여 구식 코드 생성을 방지해야 한다.

- GPT-5.4 Pro는 높은 비용에도 불구하고 법률 문서 작성이나 고객 지원 등 고부가가치 사무 자동화 작업에서 인간 수준의 성능을 보여 실질적인 비용 절감 효과를 제공할 수 있다.

- 이미지 생성 모델 학습 시 비전 특화 인코더의 임베딩을 압축하여 활용하는 FAE 기법을 적용하면 컴퓨팅 자원을 획기적으로 아끼면서 고품질 모델을 구축할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료