핵심 요약

LLM 애플리케이션 개발 과정에서 단순한 로그 출력과 무거운 프로덕션 관측 도구 사이의 간극을 해결하기 위해 Loupe가 출시되었다. 이 도구는 로컬 환경에서 실행되며 모델에 전송된 페이로드, 도구 호출 인자, 스트리밍 청크 등을 실시간으로 캡처하여 직관적인 UI로 제공한다. 별도의 데이터베이스나 외부 서비스 연동 없이 메모리상에서 작동하여 개발 루프를 가속화하며, OpenAI 클라이언트 래퍼를 통해 기존 코드에 손쉽게 도입할 수 있다.

배경

Node.js 및 npm 환경, LLM API(예: OpenAI) 사용 경험, 기본적인 JavaScript/TypeScript 지식

대상 독자

로컬 환경에서 LLM 애플리케이션 및 에이전트를 개발하고 디버깅하는 개발자

의미 / 영향

이 도구는 LLM 개발 초기 단계에서 발생하는 디버깅의 어려움을 해소하여 개발 생산성을 크게 향상시킨다. 특히 복잡한 에이전트 워크플로우를 시각화함으로써 프롬프트 엔지니어링과 도구 사용 로직의 오류를 빠르게 식별할 수 있게 한다.

섹션별 상세

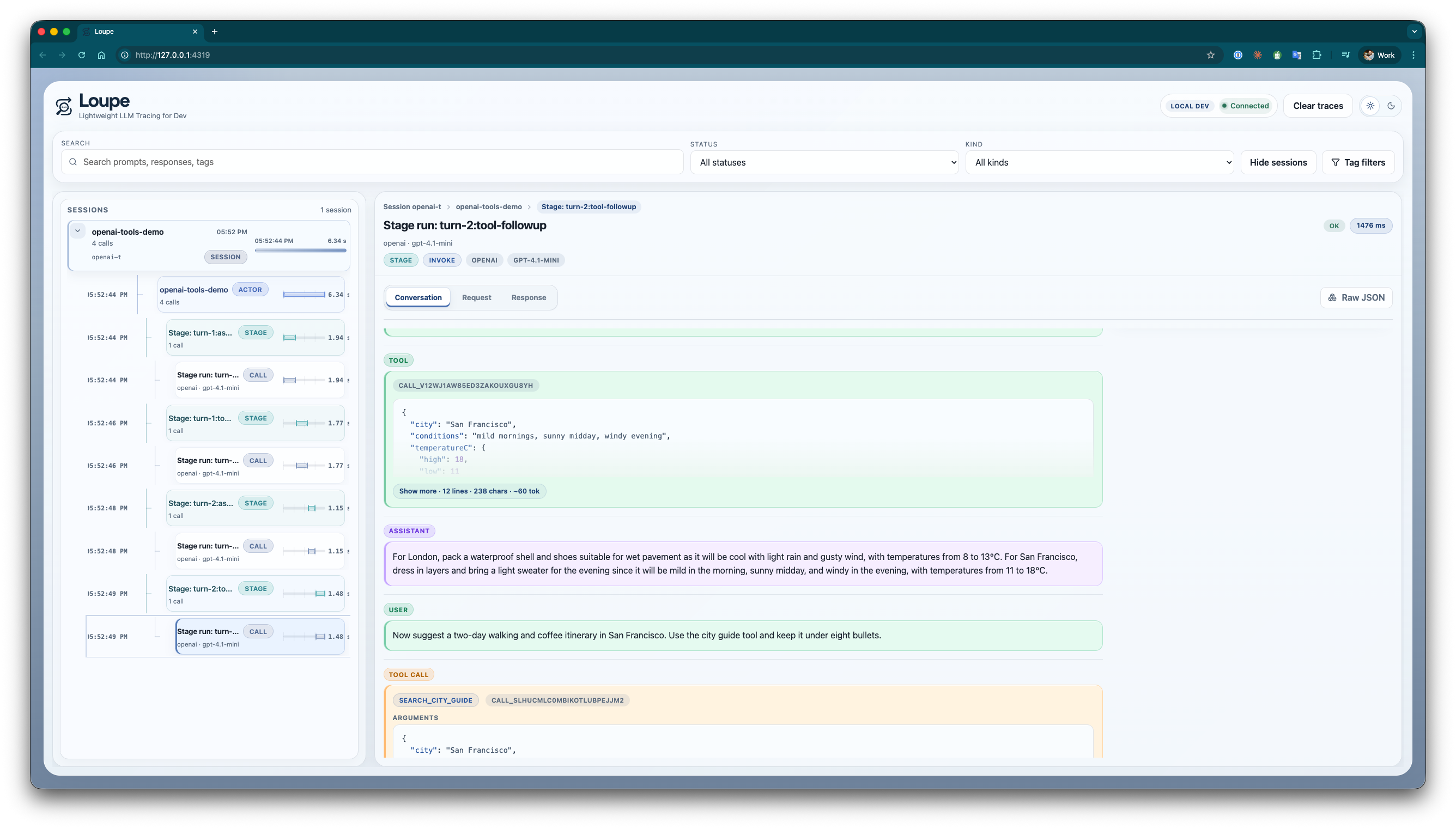

Loupe는 로컬 개발 환경에 최적화된 경량 트레이싱 대시보드로, 복잡한 인프라 설정 없이 LLM 애플리케이션의 내부 동작을 시각화한다.

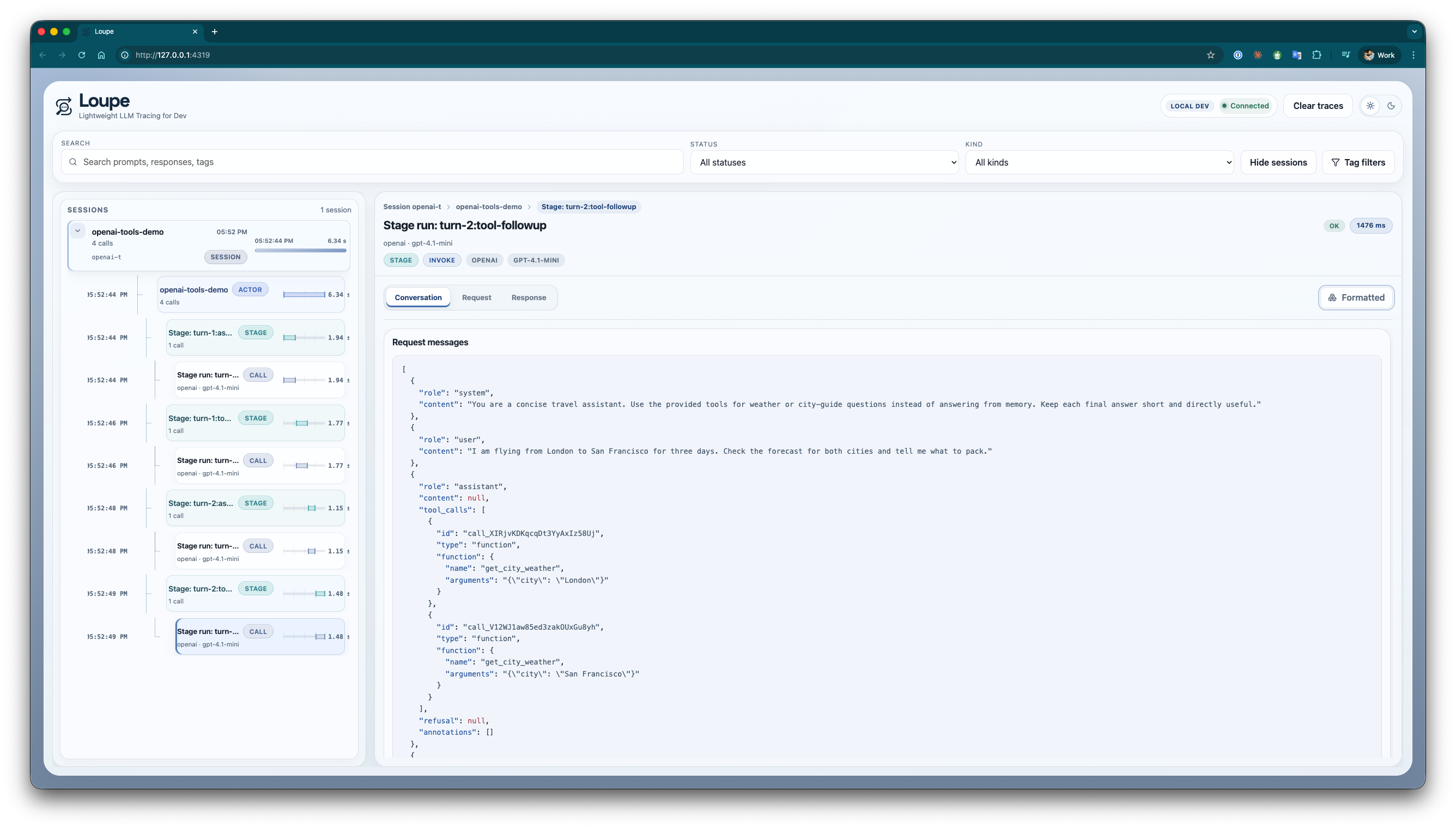

세션, 액터(Actor), 스테이지(Stage) 단위로 트레이스를 관리하며, 대화 흐름뿐만 아니라 원본 JSON 요청 및 응답 페이로드를 상세히 검사할 수 있는 UI를 제공한다.

OpenAI 공식 클라이언트를 사용하는 경우 wrapOpenAIClient 함수를 통해 기존 코드를 거의 수정하지 않고도 트레이싱 기능을 활성화할 수 있으며, 세션 ID와 태그를 통해 컨텍스트를 부여한다.

스트리밍 응답의 각 청크와 첫 번째 청크 지연 시간(First-chunk Latency), 도구 호출 결과 등을 타임라인 형태로 제공하여 에이전트 시스템의 디버깅 효율성을 높인다.

모든 데이터는 로컬 메모리에만 저장되는 휘발성 구조를 가지며, 인증 헤더와 같은 민감한 정보는 저장 전 자동으로 마스킹 처리되어 보안을 유지한다.

실무 Takeaway

- 로컬 개발 시 무거운 관측 도구 대신 Loupe를 사용하여 LLM 요청/응답 페이로드를 즉각적으로 확인하고 디버깅 시간을 단축할 수 있다.

- wrapOpenAIClient를 활용해 기존 OpenAI API 호출 로직에 세션 ID와 태그를 주입함으로써 계층적인 트레이싱 구조를 손쉽게 구축할 수 있다.

- 도구 호출(Tool Calling)이 포함된 복잡한 에이전트 시스템에서 각 단계별 입력과 출력을 시각화하여 프롬프트의 의도대로 작동하는지 실시간으로 검증할 수 있다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료