핵심 요약

LLM의 성능 향상을 위해 학습 단계뿐만 아니라 추론 단계에서도 더 많은 컴퓨팅 자원을 할당하는 '추론 시간 스케일링'이 주목받고 있다. 이 기법은 모델의 가중치를 변경하지 않고도 답변의 품질과 정확도를 높일 수 있는 효과적인 방법으로, OpenAI의 o1 모델 발표 이후 더욱 대중화되었다. 본 아티클은 Chain-of-Thought, Self-Consistency, Best-of-N 랭킹 등 다양한 추론 스케일링 기법을 체계적으로 분류하고 최신 연구 동향을 담고 있다. 특히 학습 자원 투입과 추론 자원 투입이 각각 모델 성능에 미치는 영향을 비교하며 실무적인 적용 가능성이 확인된다.

배경

LLM 추론 기본 개념, 프롬프트 엔지니어링, 컴퓨팅 자원(Compute)에 대한 이해

대상 독자

LLM 애플리케이션 개발자 및 AI 연구원

의미 / 영향

추론 비용과 성능 사이의 트레이드오프를 조절할 수 있는 새로운 설계 패러다임을 제공하며, 정확도가 중요한 복잡한 업무용 AI 시스템 구축에 핵심적인 역할을 할 것이다.

섹션별 상세

이미지 분석

파운데이션 모델에서 시작하여 파인튜닝을 거쳐 추론 시간 스케일링(Inference-time scaling)으로 이어지는 기술적 흐름이 시각화되어 있다. 본 아티클이 다루는 주제가 전체 LLM 개발 파이프라인 중 어느 단계에 해당하는지 명확히 확인된다.

LLM 추론 모델의 발전 단계와 추론 시간 스케일링의 위치를 나타내는 다이어그램이다.

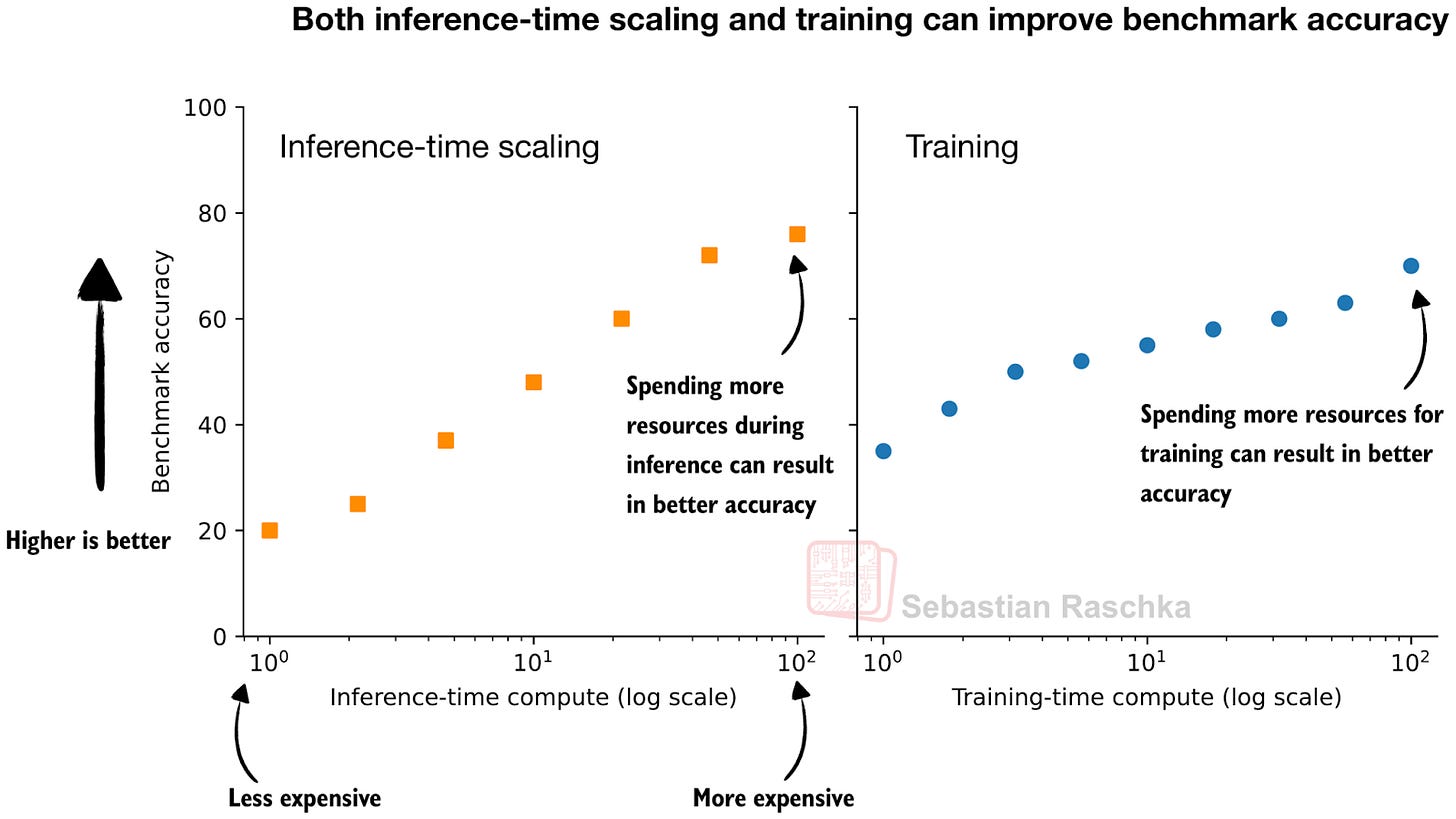

컴퓨팅 자원(Compute)을 더 많이 투입할수록 추론(왼쪽)과 학습(오른쪽) 모두에서 모델 성능이 우상향함이 입증된다. OpenAI o1 발표 자료를 인용한 것으로, 추론 스케일링의 정당성을 뒷받침하는 핵심 데이터이다.

추론 시간 연산량과 학습 시간 연산량 증가에 따른 벤치마크 정확도 향상을 비교한 그래프이다.

실무 Takeaway

- 모델의 파라미터를 수정할 수 없는 상황에서도 추론 시 연산량을 늘려 벤치마크 성능을 대폭 향상시킬 수 있다.

- 단순한 답변 생성보다 여러 후보를 생성하고 검증기(Verifier)로 필터링하는 방식이 실질적인 정확도 개선에 효과적이다.

- 최신 추론 모델들은 학습 단계의 강화학습과 추론 단계의 스케일링을 결합하여 성능을 극대화하는 추세이다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료