핵심 요약

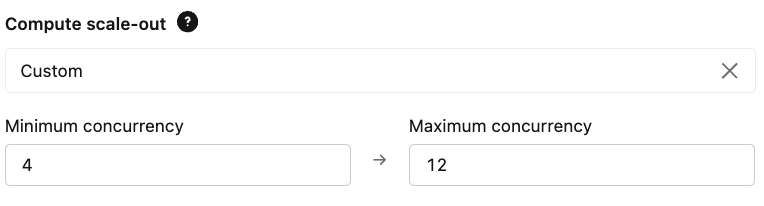

실시간 머신러닝 애플리케이션의 수요가 증가함에 따라 대규모 트래픽을 안정적으로 처리하는 모델 서빙 시스템의 중요성이 커지고 있다. Databricks Model Serving은 CPU 기반 엔드포인트에서 30만 QPS 이상의 성능을 제공하며, 추천 시스템이나 사기 탐지 등 저지연이 필수적인 작업에 최적화되어 있다. 본 아티클은 경로 최적화(Route Optimization), 모델 경량화, 클라이언트 측 연결 관리 등 고성능 서빙을 위한 구체적인 모범 사례를 설명한다. 이를 통해 개발자는 인프라 관리 부담을 줄이면서도 예측 가능한 성능과 비용 효율성을 확보할 수 있다.

배경

Databricks 플랫폼 사용 경험, REST API 및 모델 서빙 기본 지식, MLflow에 대한 이해

대상 독자

실시간 추천, 검색, 사기 탐지 시스템을 운영하는 ML 엔지니어 및 MLOps 전문가

의미 / 영향

모델 서빙의 기술적 장벽을 낮추어 기업들이 대규모 트래픽 환경에서도 안정적인 실시간 AI 서비스를 구축할 수 있게 한다. 특히 Lakehouse 통합 환경을 통해 데이터 관리부터 서빙까지의 운영 복잡성을 크게 줄여준다.

섹션별 상세

실무 Takeaway

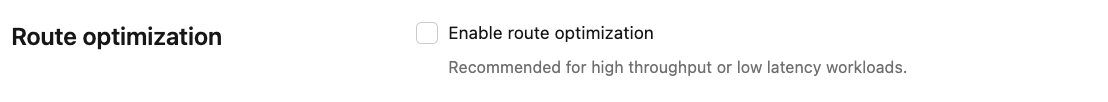

- 초고속 응답이 필요한 서비스라면 Databricks UI에서 Route Optimization 옵션을 활성화하여 네트워크 지연 시간을 최소화해야 한다.

- 서빙 엔드포인트의 부하를 줄이기 위해 복잡한 데이터 전처리는 피처 서빙(Feature Serving) 등으로 분리하고 모델 양자화를 통해 추론 속도를 개선한다.

- Databricks SDK를 활용하거나 커스텀 클라이언트에서 연결 풀링을 구현하여 불필요한 네트워크 핸드셰이크 비용을 절감한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.