핵심 요약

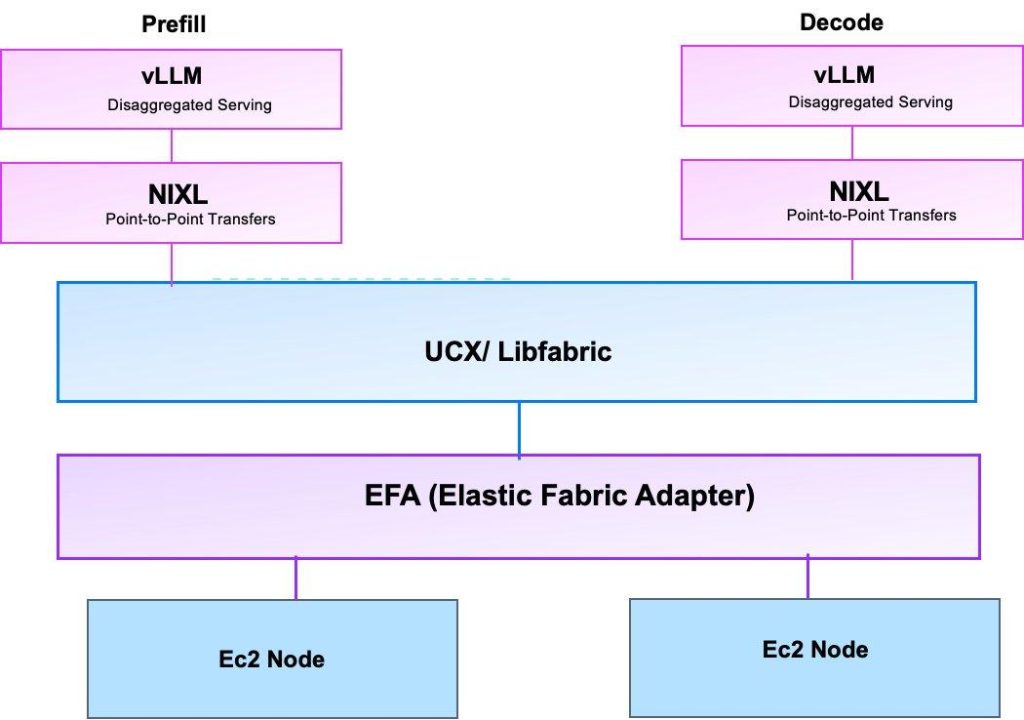

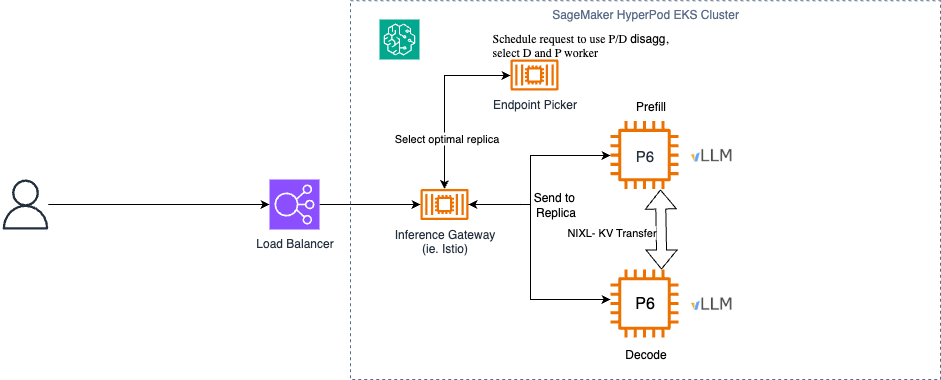

대형 언어 모델(LLM) 추론 시 발생하는 자원 불균형 문제를 해결하기 위해 AWS는 오픈소스 프레임워크인 llm-d를 도입했다. LLM 추론은 연산 집약적인 프리필(Prefill) 단계와 메모리 대역폭 중심의 디코드(Decode) 단계로 나뉘는데, 기존 방식은 이를 동일 하드웨어에서 처리하여 효율이 낮았다. llm-d는 이 두 단계를 물리적으로 분리하는 분리형 서빙(Disaggregated Serving) 아키텍처를 통해 각 단계에 최적화된 자원을 할당한다. AWS의 Elastic Fabric Adapter(EFA)와 NIXL 라이브러리를 결합하여 노드 간 고속 KV 캐시 전송을 구현함으로써 대규모 에이전트 워크로드와 MoE 모델의 추론 성능을 획기적으로 개선했다.

배경

AWS CLI 및 kubectl 설정, Helm 및 helmfile 사용법, Amazon SageMaker HyperPod 또는 EKS 클러스터 접근 권한, vLLM 및 KV 캐시 메커니즘에 대한 이해

대상 독자

대규모 LLM 서비스를 운영하며 추론 비용과 지연 시간 최적화가 필요한 MLOps 엔지니어 및 인프라 아키텍트

의미 / 영향

이 기술은 LLM 추론을 단일 모델 실행 단위가 아닌 클러스터 수준의 자원 오케스트레이션 문제로 전환시킨다. 특히 DeepSeek-R1과 같은 MoE 모델의 대중화와 에이전트 기반의 긴 추론 체인이 늘어나는 트렌드에서 하드웨어 효율을 극대화할 수 있는 표준 아키텍처가 될 것으로 전망된다.

섹션별 상세

실무 Takeaway

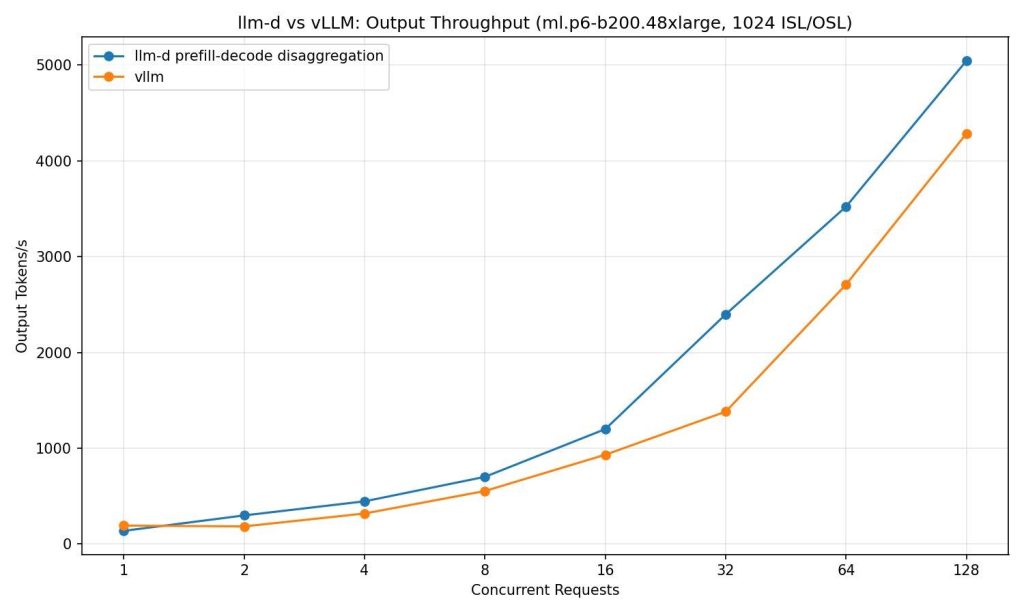

- 입력 프롬프트가 길고 반복되는 에이전트 워크로드에 분리형 추론을 적용하면 표준 vLLM 배포 대비 출력 처리량을 최대 70%까지 향상시킬 수 있다.

- AWS EFA와 NIXL 기반의 전용 컨테이너(ghcr.io/llm-d/llm-d-aws)를 사용하면 복잡한 네트워크 설정 없이도 고성능 분산 추론 환경을 구축할 수 있다.

- 워크로드의 특성(입력/출력 길이 비율)에 따라 프리필과 디코드 노드의 비율을 동적으로 조정함으로써 인프라 비용 대비 성능을 최적화해야 한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료