핵심 요약

중국의 AI 스타트업 DeepSeek이 차세대 모델인 V4(코드명 Model1)와 R2 출시를 앞두고 기술적 세부 사항을 공개했다. V4는 단순한 업데이트를 넘어 Engram이라는 조건부 메모리 시스템과 mHC(Manifold-Constrained Hyper-Connections) 기술을 도입한 전면적인 아키텍처 개편을 특징으로 한다. 이를 통해 100만 토큰 이상의 긴 문맥을 처리하면서도 GPU 메모리 사용량을 40% 절감하고, 사실적 지식 검색과 추론 과정을 분리하여 효율성을 극대화했다. 이번 출시는 오픈소스 모델이 폐쇄형 상용 모델과의 격차를 더욱 좁히는 중요한 분기점이 될 것으로 전망된다.

배경

Transformer Architecture, Mixture of Experts (MoE), Attention Mechanisms (MHA, GQA), Gradient Descent & Backpropagation

대상 독자

LLM 아키텍처 설계자, AI 인프라 엔지니어, 오픈소스 AI 연구원

의미 / 영향

DeepSeek의 혁신은 적은 자본과 하드웨어 제약 하에서도 아키텍처 최적화를 통해 세계 최고 수준의 성능을 낼 수 있음을 증명하며, 글로벌 AI 시장의 주도권이 오픈소스 생태계로 이동하는 계기가 될 수 있다.

섹션별 상세

이미지 분석

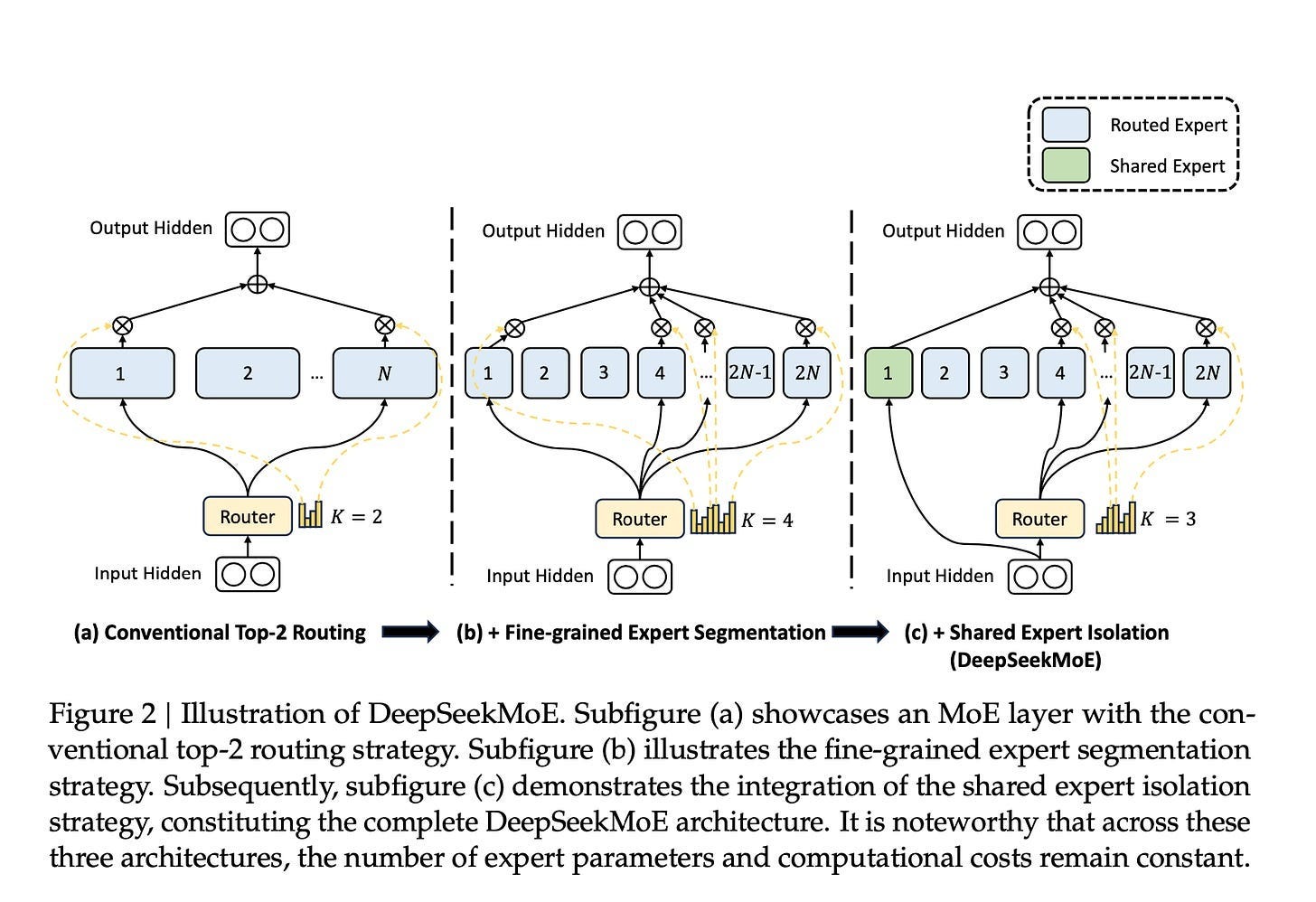

기존 Top-2 라우팅에서 세분화된 전문가 분할 및 공유 전문가 격리 구조로 발전하는 단계를 시각화한다. 이를 통해 연산 비용을 일정하게 유지하면서도 모델의 전문성을 높이는 과정을 나타낸다.

DeepSeekMoE의 진화 과정을 보여주는 아키텍처 다이어그램이다.

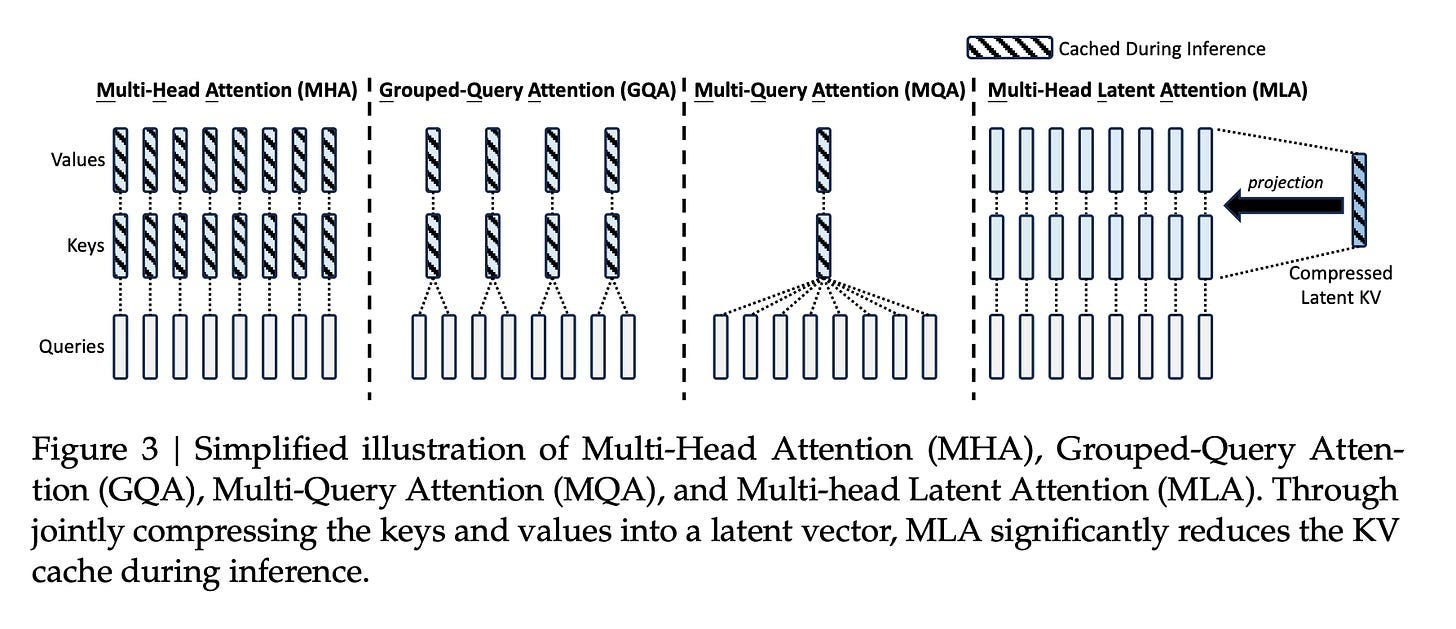

MLA가 어떻게 Key와 Value를 잠재 벡터로 압축하여 추론 시 KV 캐시를 획기적으로 줄이는지 구조적으로 대비한다. 이는 긴 문맥 처리 시 메모리 효율성을 확보하는 핵심 원리를 설명한다.

MHA, GQA, MQA와 DeepSeek의 MLA를 비교한 기술 도식이다.

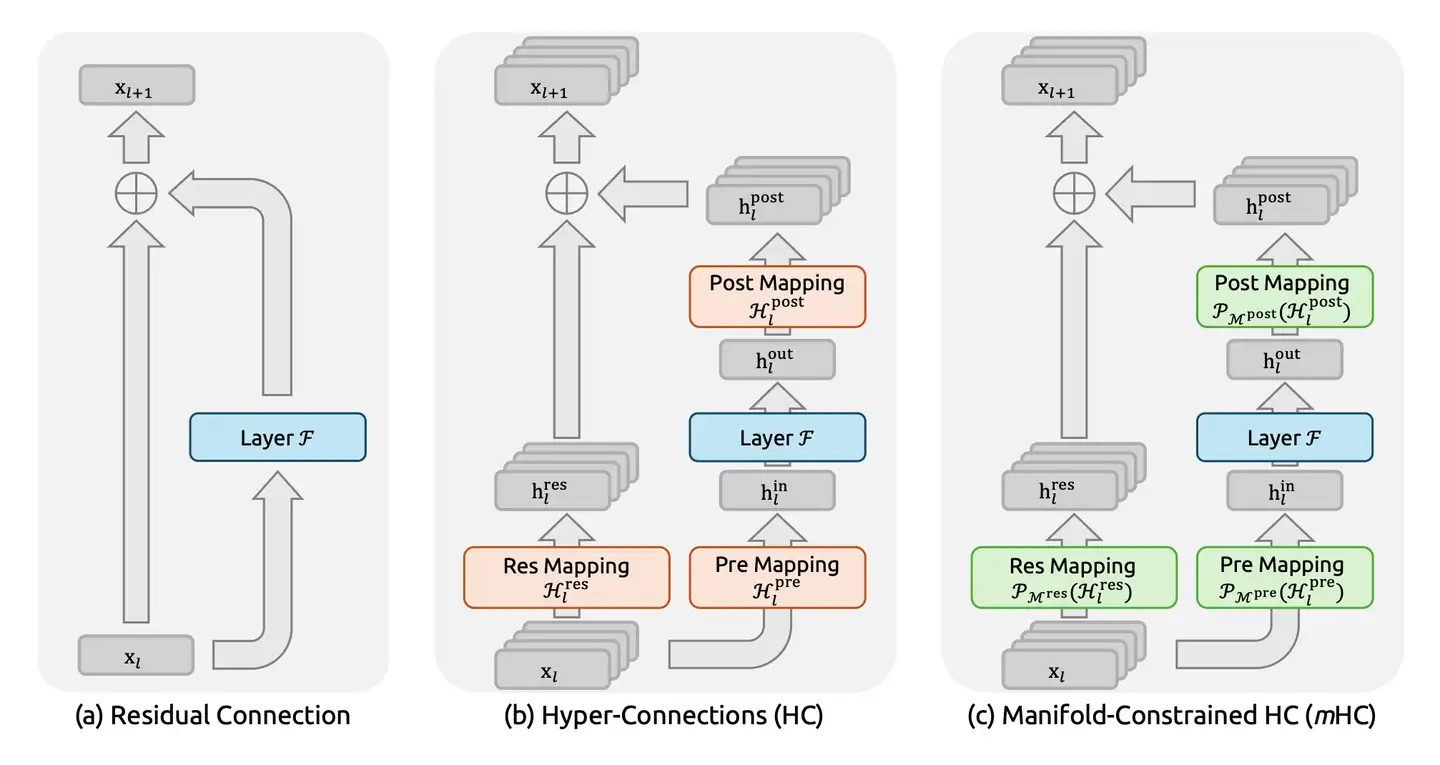

mHC가 정보 흐름의 유연성을 높이면서도 기하학적 제약을 통해 학습 안정성을 유지하는 메커니즘을 설명한다. 이는 V4의 심층 아키텍처에서 그래디언트 문제를 해결하는 핵심 기술이다.

잔차 연결(Residual Connection)과 하이퍼 연결(HC), 매니폴드 제약 하이퍼 연결(mHC)의 차이를 보여준다.

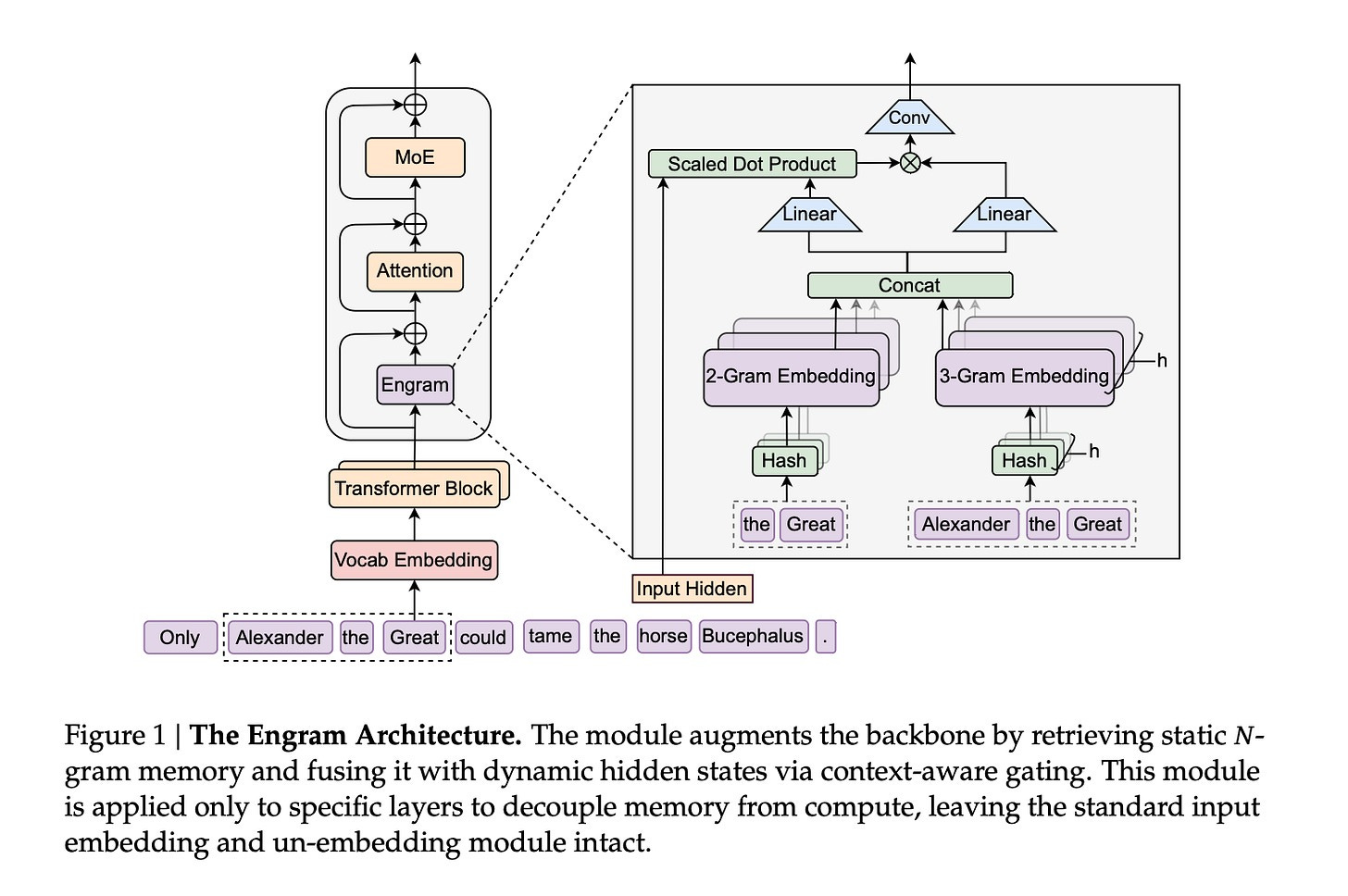

정적인 N-gram 메모리 검색 모듈이 어떻게 동적인 히든 상태와 결합하여 지식과 연산을 분리하는지 상세히 보여준다. GPU 메모리 오프로딩을 통한 효율적인 지식 확장을 시각적으로 증명한다.

Engram 아키텍처의 세부 구조와 N-gram 메모리 검색 모듈을 묘사한다.

실무 Takeaway

- Engram 기술을 활용해 정적 지식을 CPU로 오프로딩함으로써 GPU 메모리 비용을 40% 절감하고 100B 규모의 지식 베이스를 효율적으로 운영할 수 있다.

- mHC 아키텍처는 심층 신경망의 학습 안정성을 보장하므로, 더 깊고 복잡한 모델을 설계할 때 발생하는 수렴 문제를 해결하는 실무적 대안이 된다.

- DSA와 MLA의 결합은 긴 문맥 처리가 필요한 RAG 시스템이나 대규모 코드 분석 도구의 추론 속도와 비용 효율성을 동시에 개선한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료