핵심 요약

PDF와 같은 비정형 문서에서 깨끗한 데이터를 추출하는 것은 RAG 기반 AI 에이전트 구축의 주요 과제이다. Langflow 1.6은 오픈소스 문서 프로세서인 Docling을 파일 컴포넌트에 통합하여 이 문제를 해결했다. 사용자는 고급 파서를 활성화하여 표준 파이프라인이나 VLM 기반 파이프라인을 선택함으로써 문서를 구조화된 마크다운으로 변환할 수 있다. 변환된 데이터는 요약, 챗봇, 또는 벡터 데이터베이스 저장을 위한 RAG 인제스션 파이프라인 구축에 활용된다.

배경

Langflow 기본 사용법, RAG(검색 증강 생성) 개념, JavaScript/TypeScript 기초 지식

대상 독자

AI 애플리케이션 개발자 및 RAG 시스템 설계자

의미 / 영향

문서 전처리 과정의 자동화와 고도화를 통해 RAG 시스템의 답변 정확도를 높일 수 있다. 특히 오픈소스 도구인 Docling을 활용함으로써 상용 OCR 서비스 의존도를 낮추고 비용 효율적인 데이터 파이프라인 구축이 가능하다.

섹션별 상세

이미지 분석

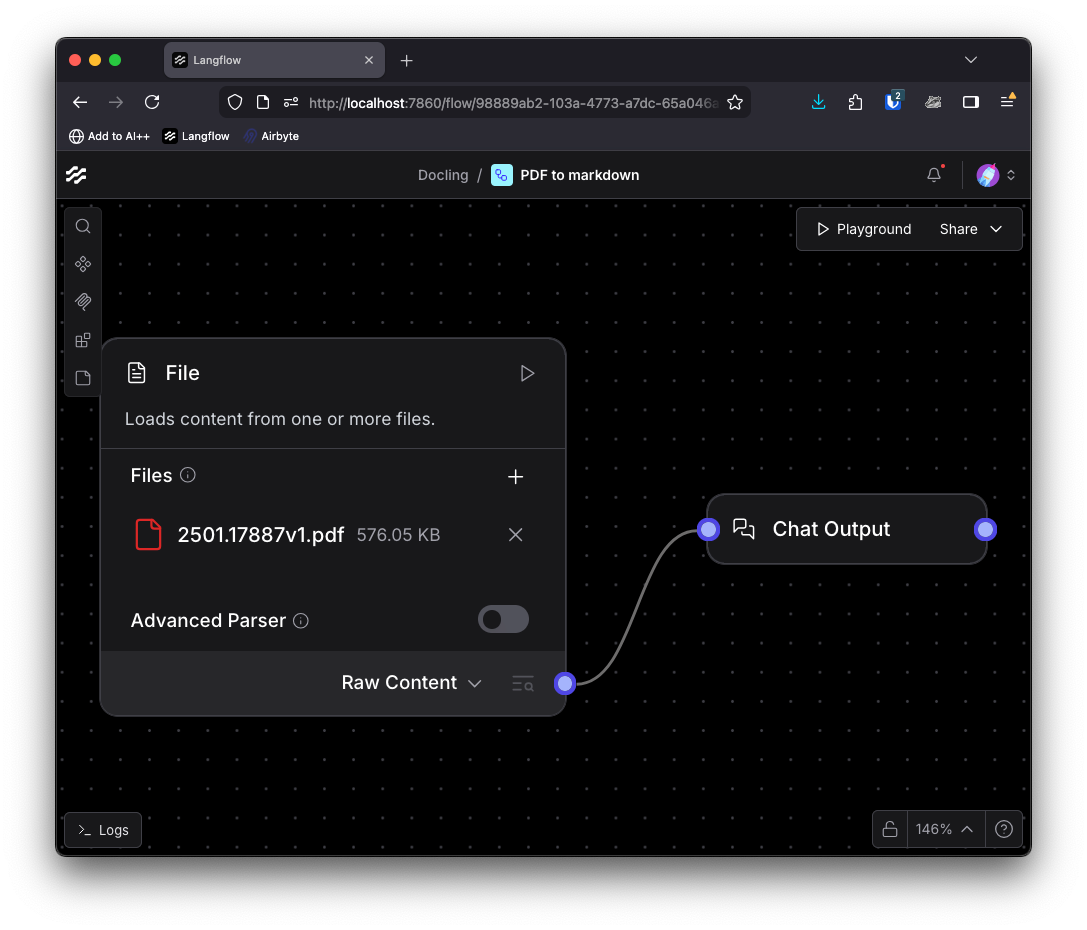

Langflow에서 가장 기본적인 PDF 텍스트 추출 방식을 보여준다. 별도의 설정 없이 텍스트 스트림을 추출할 수 있지만 문서 구조 보존 능력은 낮음을 시각적으로 확인시켜 준다.

PDF 파일의 원시 콘텐츠를 내보낼 수 있는 기본 파일 컴포넌트의 모습이다.

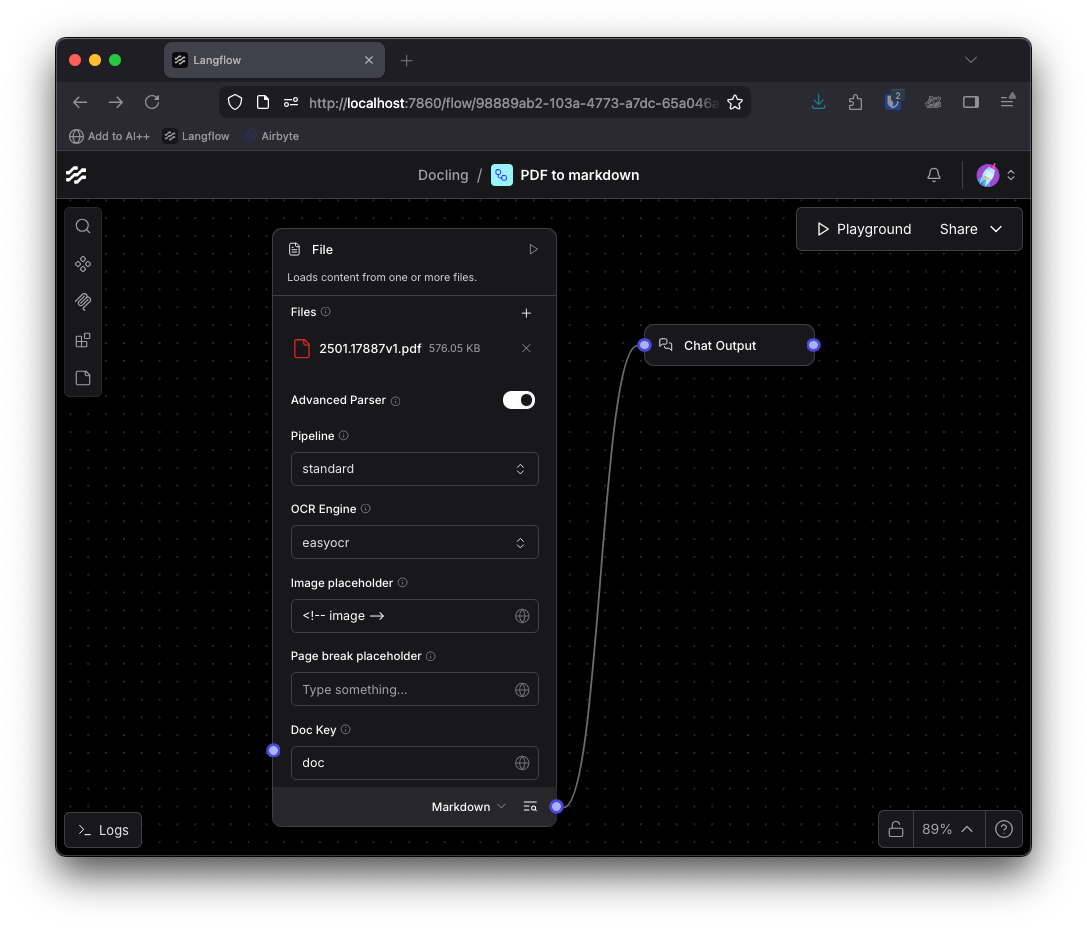

Docling 통합의 핵심인 고급 파서 옵션을 보여준다. 표준 파이프라인, EasyOCR 엔진 선택 등 세부적인 문서 처리 방식을 설정할 수 있음을 나타낸다.

고급 파서 설정을 통해 파이프라인과 OCR 엔진을 선택하는 화면이다.

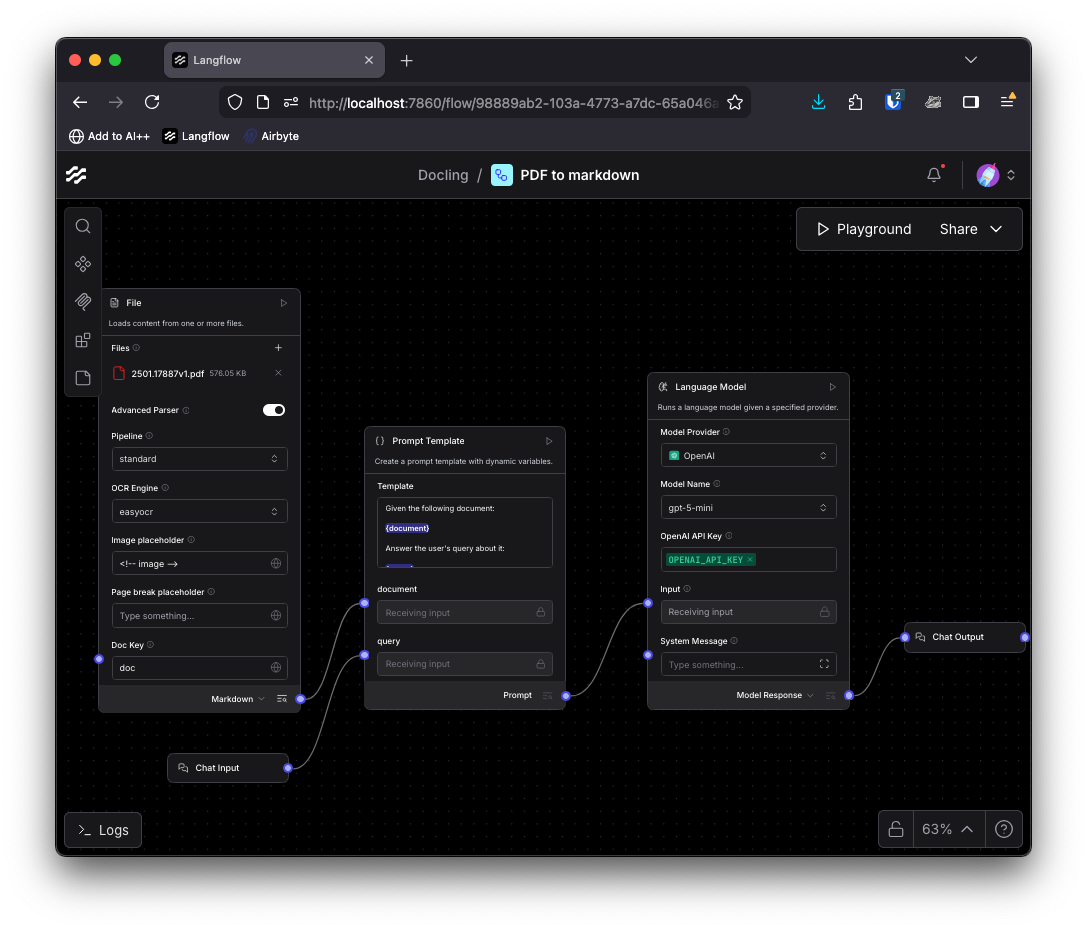

추출된 PDF 데이터를 실제 LLM과 연결하여 대화형 인터페이스를 구축하는 아키텍처를 설명한다. 파일 컴포넌트의 출력이 프롬프트의 컨텍스트로 주입되는 과정을 시각화한다.

채팅 입력, 프롬프트 템플릿, 언어 모델을 연결하여 PDF와 대화하는 플로우 구성도이다.

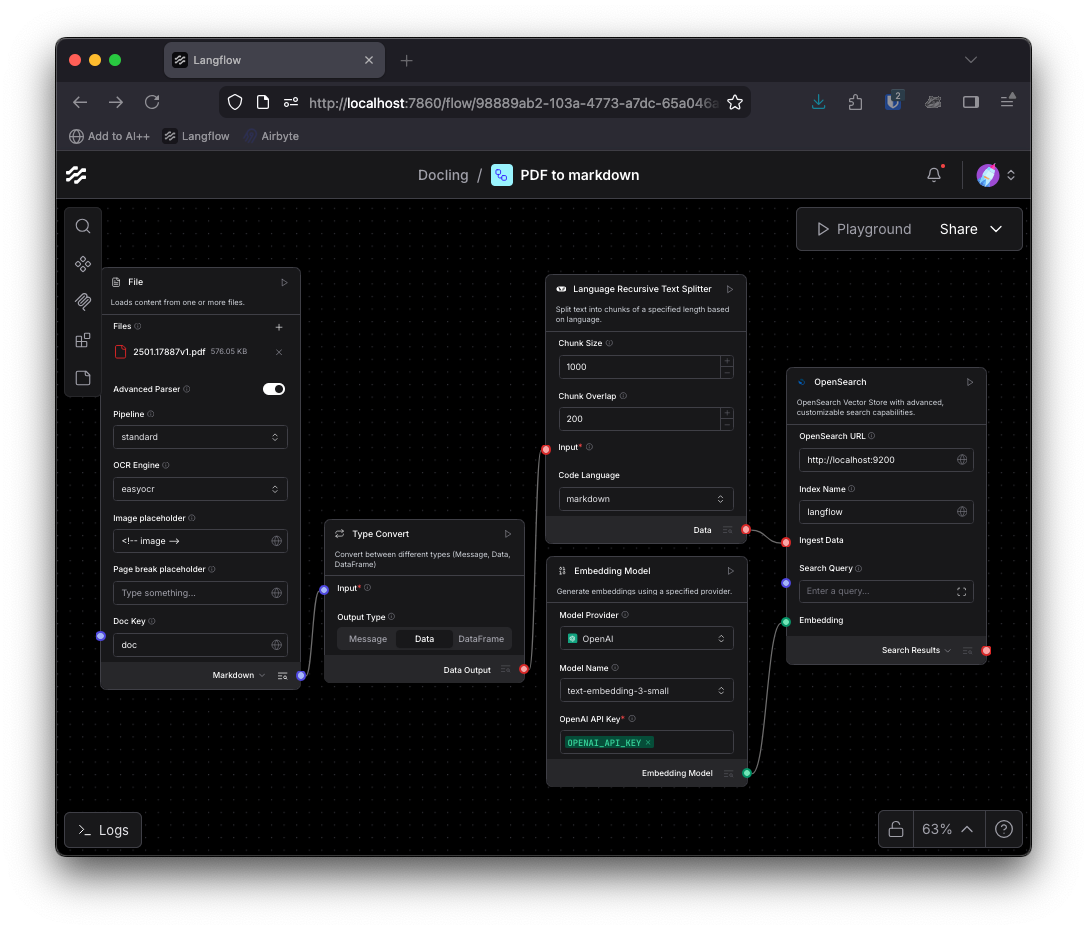

단순 텍스트 추출을 넘어 실제 RAG 시스템을 위한 데이터 파이프라인 구축 사례를 보여준다. 텍스트 분할기, 임베딩 모델, 벡터 DB가 유기적으로 연결된 구조를 제시한다.

마크다운 데이터를 청킹하고 임베딩하여 OpenSearch 벡터 저장소에 저장하는 RAG 인제스션 파이프라인이다.

Langflow 플로우를 외부 Next.js 앱에 통합했을 때의 최종 사용자 경험을 시연한다. 백엔드에서 Docling이 작동하여 구조화된 마크다운을 생성하는 과정을 직관적으로 전달한다.

PDF를 드래그 앤 드롭하여 실시간으로 마크다운 변환 결과를 보여주는 애플리케이션 시연 영상이다.

실무 Takeaway

- 지저분한 PDF 문서를 RAG에 적합한 구조화된 마크다운으로 변환하려면 Langflow의 Docling 기반 고급 파서를 사용해야 한다.

- 문서의 시각적 구조가 복잡한 경우 Granite-Docling-258M 모델을 사용하는 VLM 파이프라인이 효과적이다.

- Langflow 클라이언트 SDK를 활용하면 파일 업로드와 플로우 실행을 자동화하여 프로덕션 앱에 문서 처리 기능을 쉽게 통합할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료