핵심 요약

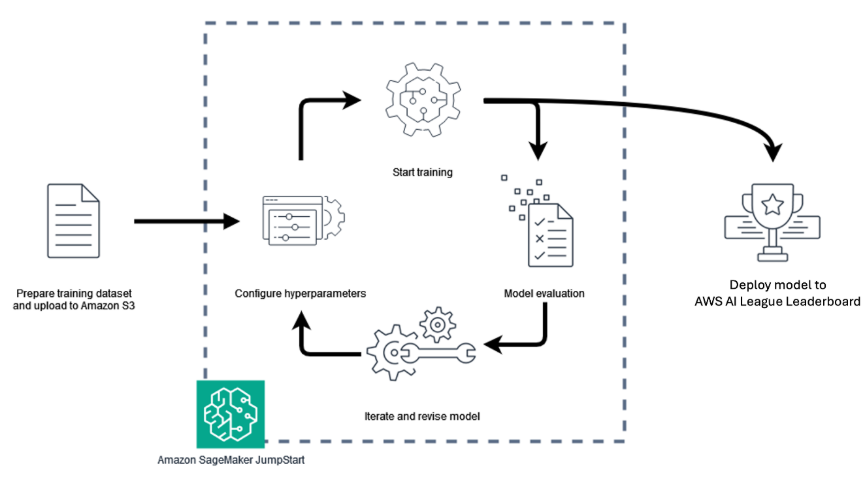

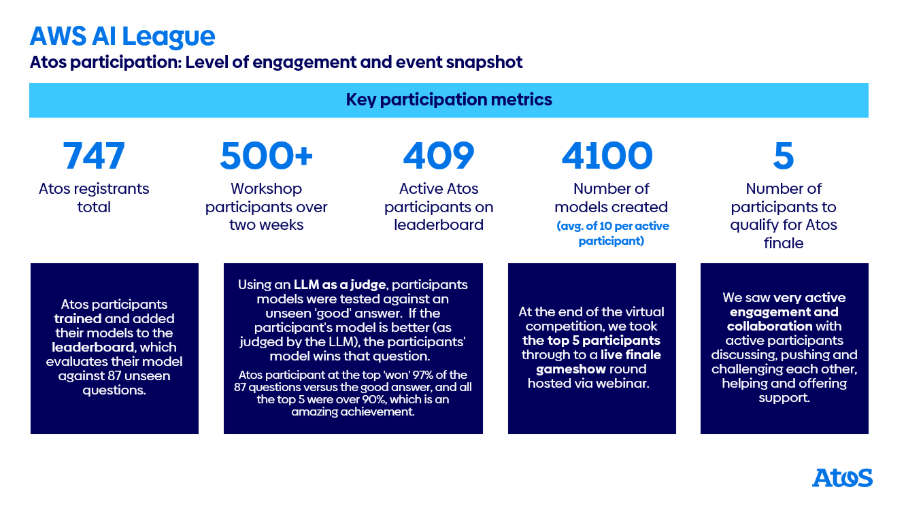

Atos는 2026년까지 전 직원의 AI 숙련도를 100% 달성하기 위해 AWS와 협력하여 'AWS AI League'라는 게임화된 실습 프로그램을 도입했다. 참가자들은 Amazon SageMaker JumpStart를 사용하여 Llama 3.2 3B 모델을 보험 언더라이팅 도메인에 맞게 파인튜닝하는 전 과정을 실습했다. 이 과정에서 데이터셋 구축, 하이퍼파라미터 튜닝, LLM-as-a-Judge 기반의 자동 평가를 경험하며 실무 역량을 쌓았다. 결과적으로 잘 훈련된 3B 소형 모델이 특정 작업에서 90B 대형 모델보다 높은 승률을 기록하며 비용 효율적인 AI 도입의 가능성을 확인했다.

배경

LLM 기본 개념, AWS SageMaker 기본 사용법, 파인튜닝 및 하이퍼파라미터에 대한 기초 지식

대상 독자

기업 내 AI 도입을 추진하는 리더 및 LLM 파인튜닝 실무 역량을 쌓고자 하는 개발자

의미 / 영향

이 사례는 대형 모델에 의존하는 대신 소형 모델을 특정 도메인에 최적화함으로써 성능과 비용을 모두 잡을 수 있음을 보여준다. 특히 에이전트 아키텍처에서 각 전문 분야를 담당하는 저비용 고효율 모델들을 배치하는 전략이 유효함을 시사한다.

섹션별 상세

{

"instruction": "보험 언더라이터로서 다음 위험 요소를 분석하고 적절한 공제액을 추천하십시오.",

"response": "제시된 위험 요소에 기반하여, 해당 정책에는 $5,000의 공제액이 적절합니다. 이유는..."

}파인튜닝에 사용되는 JSON Lines(JSONL) 형식의 데이터셋 구조 예시

실무 Takeaway

- 특정 도메인 데이터로 정교하게 파인튜닝된 3B 소형 모델은 범용 90B 대형 모델보다 높은 정확도와 비용 효율성을 동시에 제공할 수 있다.

- 기업 내 AI 역량 강화를 위해서는 단순 강의보다 리더보드와 실습 환경이 제공되는 게임화된 경쟁 방식이 참여도와 학습 효과를 극대화한다.

- LLM-as-a-Judge 방식을 활용하면 대규모 모델 평가를 자동화하고 객관적인 벤치마크 지표를 신속하게 확보하여 반복적인 모델 개선이 가능하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.