핵심 요약

Databricks는 벡터 검색과 AI 에이전트 워크로드에 최적화된 소형 고성능 임베딩 모델인 Qwen3-Embedding-0.6B를 모델 서빙 플랫폼에 도입했다. 이 모델은 0.6B라는 작은 파라미터 규모에도 불구하고 MTEB 벤치마크에서 OpenAI나 Cohere의 대형 모델과 대등하거나 이를 능가하는 성능을 보여준다. 특히 100개 이상의 언어를 지원하는 Databricks 최초의 다국어 임베딩 모델이며, Matryoshka 임베딩 기술을 통해 차원을 32에서 1024까지 유연하게 조절하여 저장 비용과 검색 속도를 최적화할 수 있다. 사용자는 Databricks의 보안 서버리스 인프라를 통해 이 모델을 즉시 배포하고 Agent Bricks 및 Vector Search와 결합하여 강력한 RAG 시스템을 구축할 수 있다.

배경

Vector Search 개념, 임베딩 모델의 역할, Databricks 플랫폼 기초

대상 독자

RAG 시스템 및 AI 에이전트를 구축하는 ML 엔지니어 및 데이터 사이언티스트

의미 / 영향

소형 모델이 대형 상용 모델의 성능을 위협하는 추세를 보여주며, 특히 Matryoshka 임베딩의 대중화로 벡터 검색 인프라 비용 최적화가 가속화될 것이다.

섹션별 상세

{

"input": "Your text here",

"dimensions": 256

}Matryoshka 기능을 사용하여 출력 임베딩 차원을 256으로 설정하는 API 요청 예시

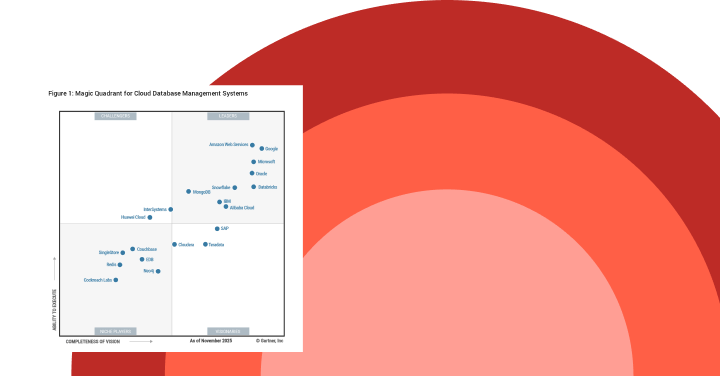

이미지 분석

Databricks가 클라우드 DBMS 시장에서 '리더(Leader)' 그룹에 위치하고 있음을 보여준다. 이는 해당 플랫폼에서 제공하는 임베딩 모델과 벡터 검색 서비스의 신뢰도와 시장 경쟁력을 뒷받침하는 근거로 제시되었다.

2025년 가트너 클라우드 데이터베이스 관리 시스템 부문 매직 쿼드런트 차트

실무 Takeaway

- Qwen3-Embedding-0.6B를 활용하면 0.6B의 작은 크기로도 OpenAI 등 상용 모델 수준의 검색 품질을 확보하면서 추론 지연 시간과 비용을 획기적으로 낮출 수 있다.

- Matryoshka 기능을 통해 벡터 차원을 32~1024 사이로 조정함으로써, 검색 정확도를 크게 해치지 않으면서도 벡터 DB 저장 비용을 최대 수십 배 절감할 수 있다.

- 100개 이상의 언어를 지원하므로 글로벌 비즈니스를 운영하는 기업은 단일 모델로 전 세계 지사의 다국어 문서를 통합 검색하는 RAG 시스템을 구축할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.