핵심 요약

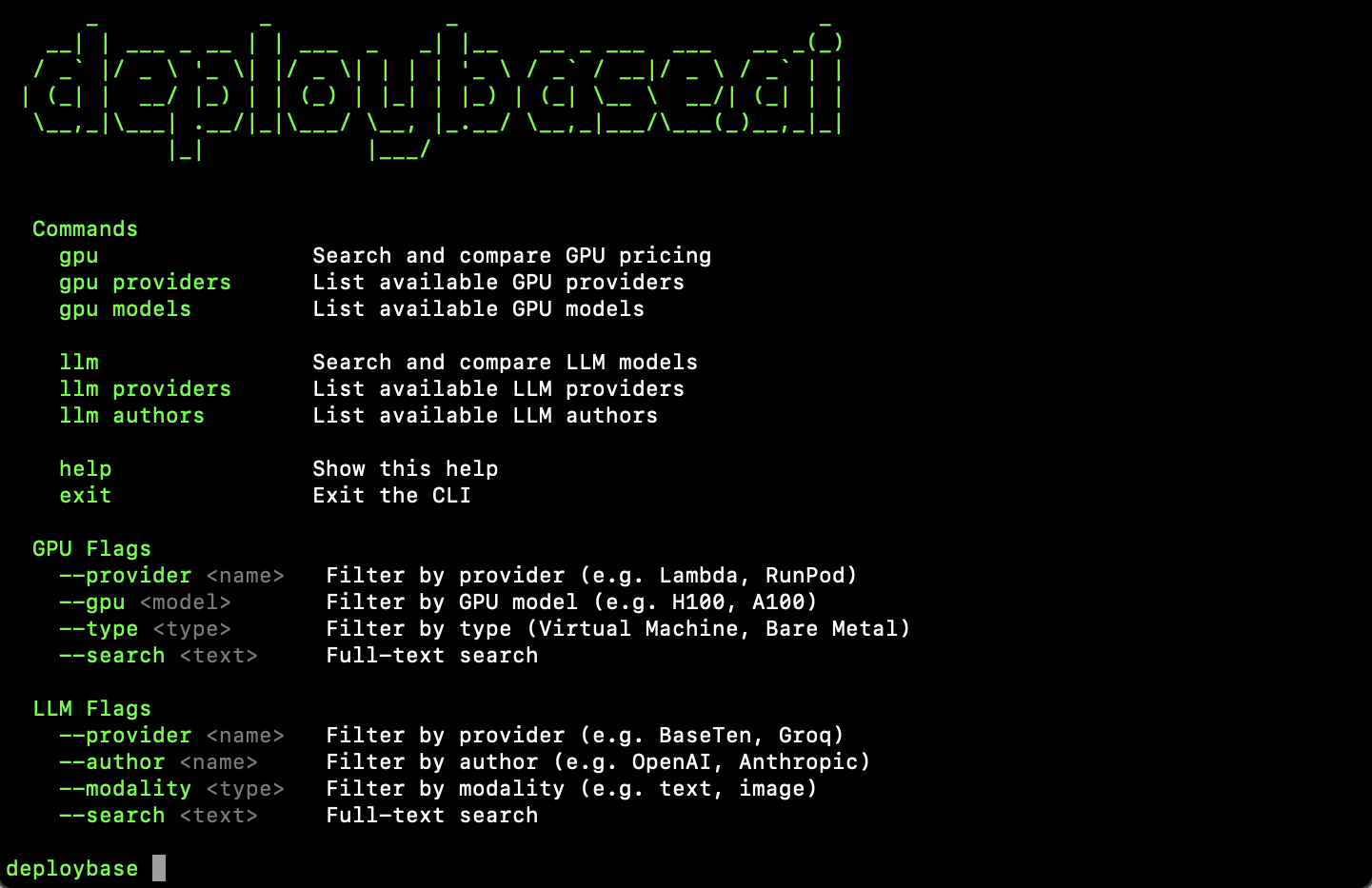

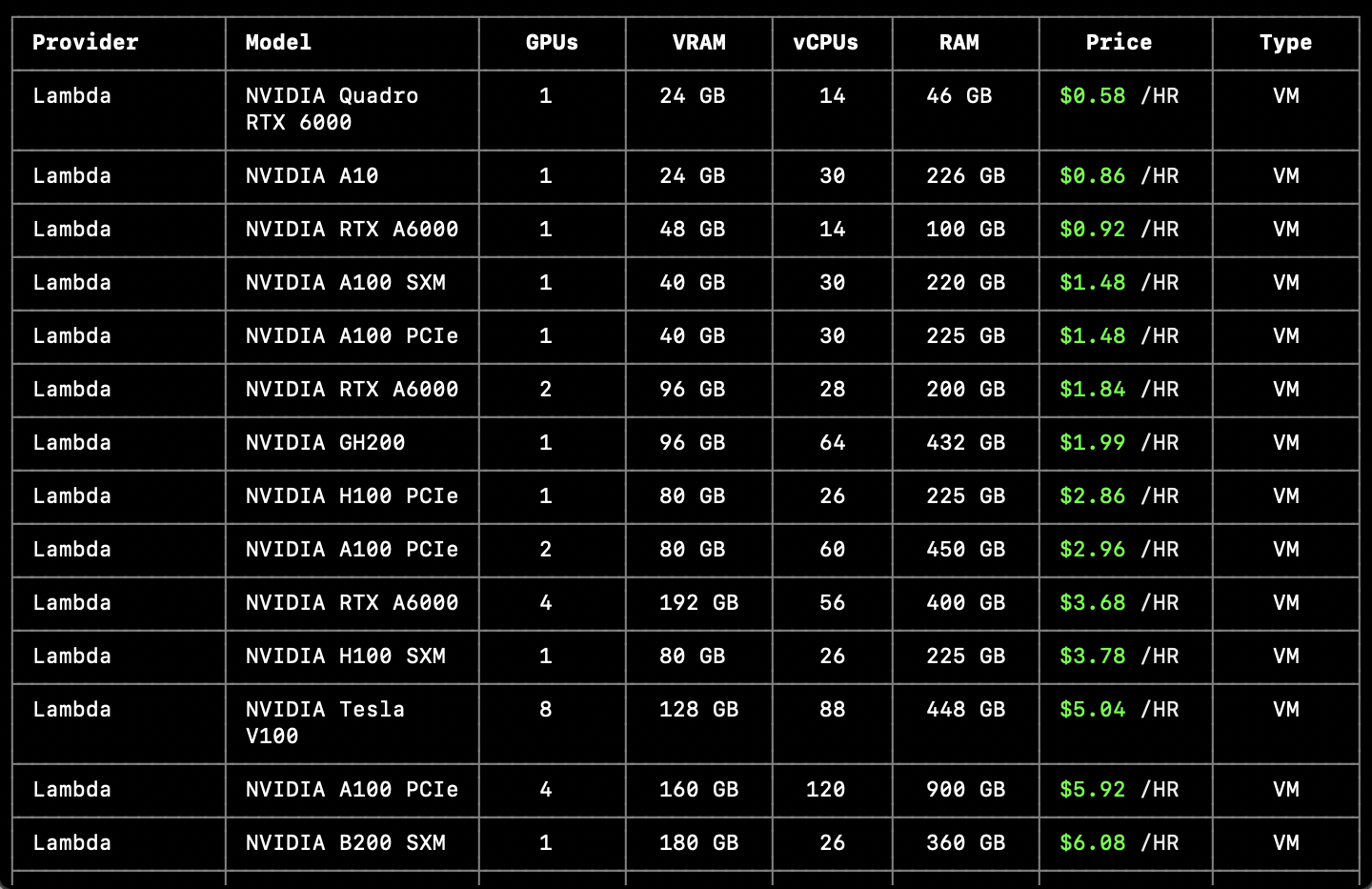

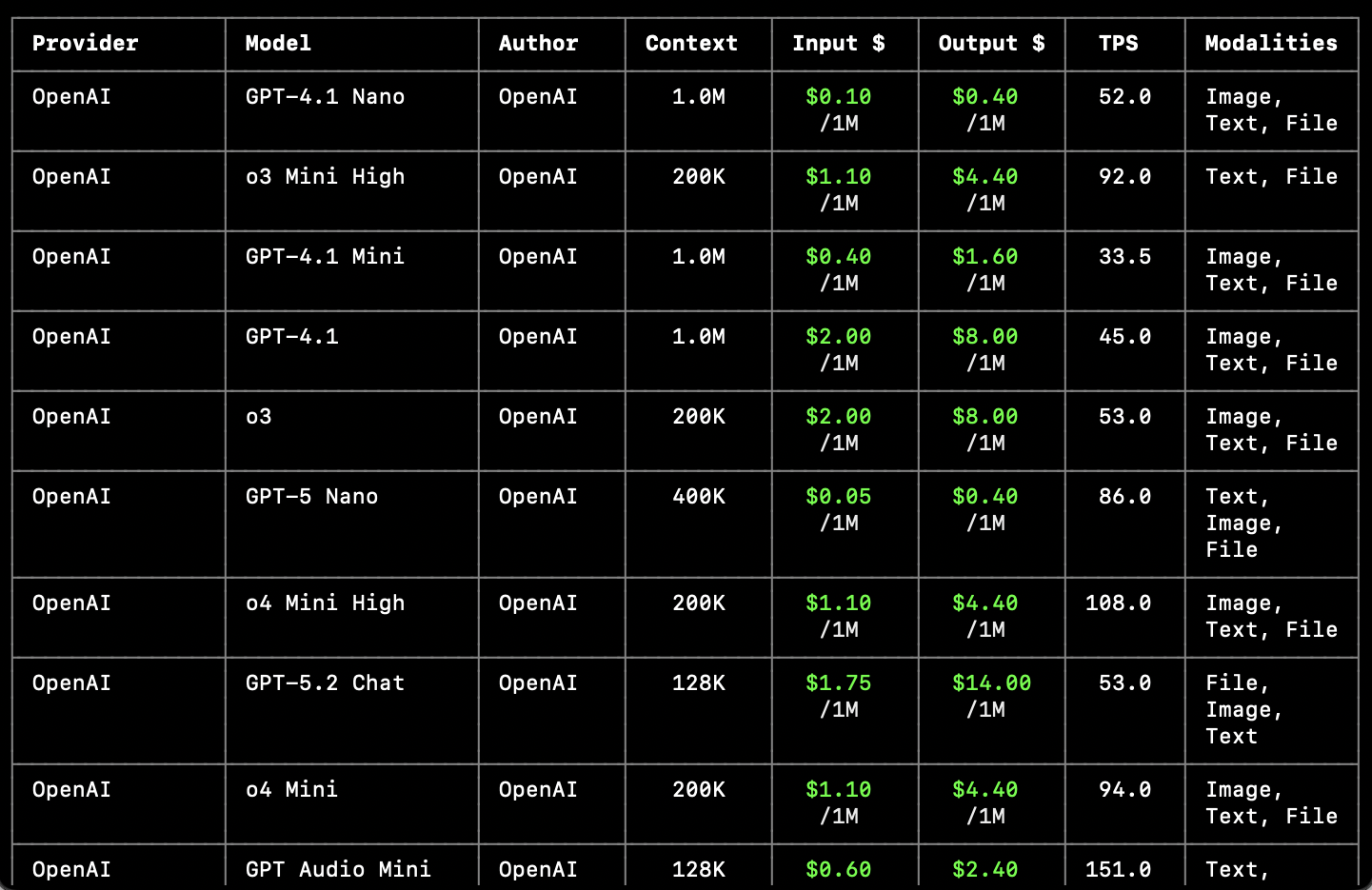

인공지능 인프라 구축 시 GPU 자원 확보와 LLM API 비용 최적화는 필수적이지만, 업체마다 가격 정보가 파편화되어 있어 비교가 어렵다. deploybase-cli는 이러한 불편을 해소하기 위해 터미널에서 직접 실시간 가격 데이터를 조회할 수 있는 인터페이스를 제공한다. 사용자는 간단한 명령어로 Lambda, Google Cloud 등 다양한 업체의 GPU 가용성과 OpenAI, Anthropic 등 주요 모델의 토큰당 비용을 즉시 확인할 수 있다. Node.js 환경에서 쉽게 설치 가능하며, 상세한 필터링 기능을 통해 프로젝트 요구사항에 맞는 최적의 자원을 빠르게 탐색할 수 있다.

배경

Node.js 18+, npm 또는 npx

대상 독자

AI 인프라 엔지니어, LLM 애플리케이션 개발자, MLOps 전문가

의미 / 영향

파편화된 클라우드 GPU 및 LLM API 시장의 가격 정보를 표준화된 CLI 인터페이스로 통합하여 인프라 선택의 투명성을 높인다. 이는 소규모 개발팀이나 스타트업이 비용 효율적인 AI 서비스를 구축하는 데 기여한다.

섹션별 상세

npm install -g deploybase-cli

# 또는 설치 없이 실행

npx deploybase-clideploybase-cli 설치 및 실행 명령어

deploybase gpu --model h100 --provider lambda

deploybase gpu --search 80gb sxm특정 GPU 모델 및 사양으로 가격을 검색하는 예시

deploybase llm --author openai --modality text

deploybase llm --search claude제작사 및 모달리티별로 LLM 가격을 검색하는 예시

실무 Takeaway

- GPU 자원이 필요한 개발자는 'deploybase gpu --model h100' 명령어를 통해 여러 클라우드 업체의 실시간 가격과 가용성을 즉시 비교하여 인프라 비용을 최적화할 수 있다.

- LLM API 연동 시 'deploybase llm --modality image'와 같은 필터링을 활용하여 특정 기능에 대해 가장 저렴하거나 성능이 우수한 모델을 빠르게 탐색 가능하다.

- 별도의 웹사이트 방문 없이 터미널 워크플로우 내에서 인프라 비용을 확인하고 결정할 수 있어 개발 생산성이 향상된다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료