핵심 요약

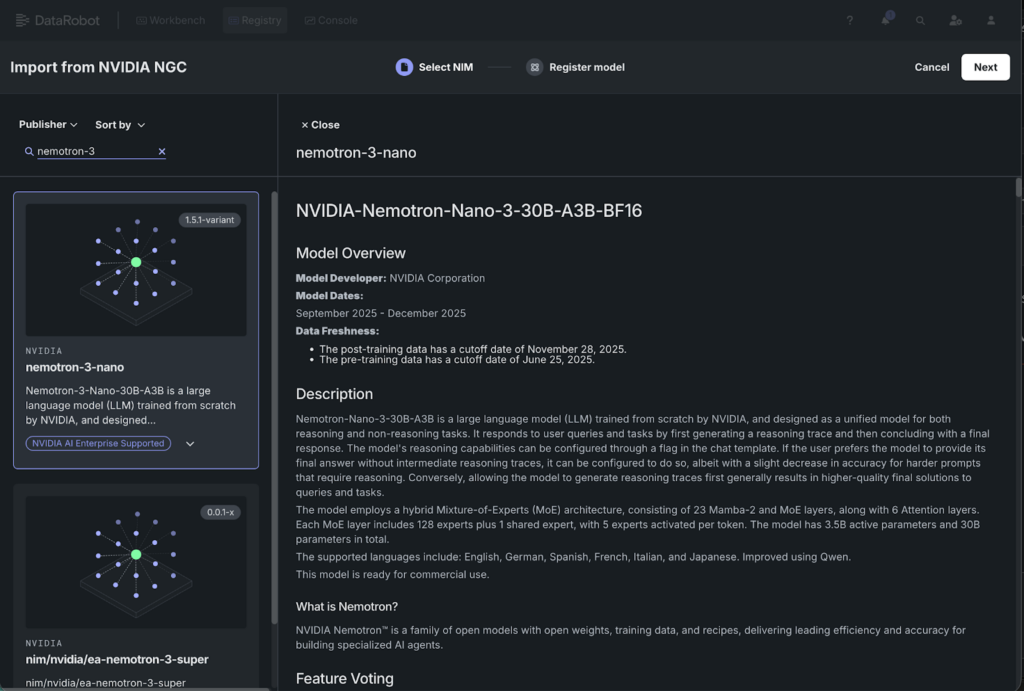

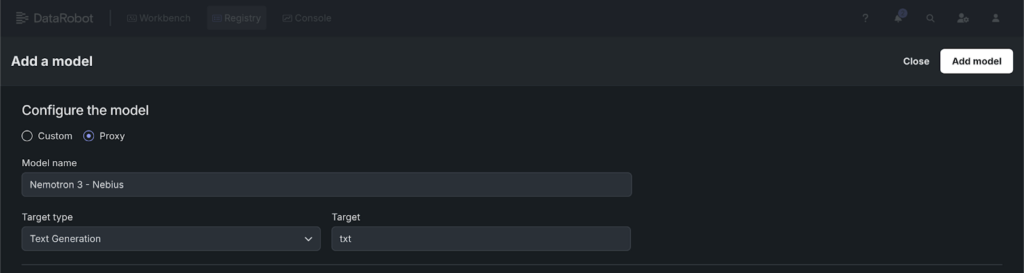

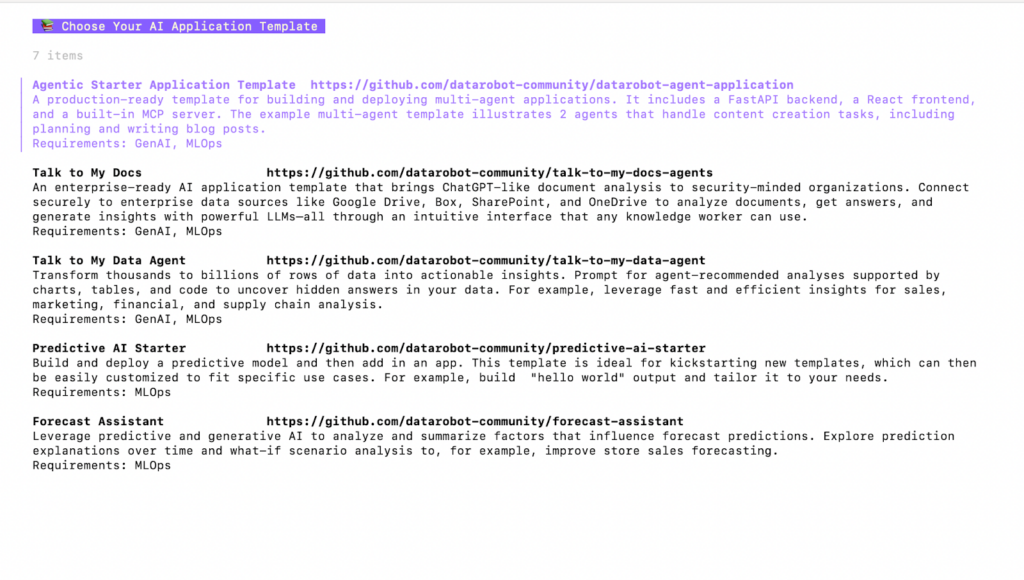

DataRobot과 Nebius는 기업용 AI 에이전트의 개발부터 배포, 거버넌스까지 전 과정을 가속화하는 'AI Factory for Enterprises'를 발표했다. 이 솔루션은 DataRobot의 Agent Workforce Platform과 Nebius의 AI 전용 GPU 클라우드 인프라를 통합하여 에이전트의 프로덕션 전환 기간을 획기적으로 단축한다. NVIDIA NIM 통합과 Workload API를 통해 보안이 강화된 모델 추론 환경을 제공하며, OpenTelemetry 표준 기반의 모니터링으로 에이전트의 성능과 안전성을 실시간으로 관리한다.

배경

Kubernetes 및 컨테이너 배포에 대한 기본 지식, LLM 에이전트 프레임워크(LangChain, LlamaIndex 등) 사용 경험, NVIDIA NIM 및 GPU 인프라에 대한 이해

대상 독자

기업용 AI 에이전트를 구축하고 프로덕션 환경에서 운영하려는 MLOps 엔지니어 및 개발자

의미 / 영향

이 파트너십은 기업이 AI 에이전트를 도입할 때 겪는 인프라 성능 불확실성과 거버넌스 부재 문제를 동시에 해결한다. 특히 NVIDIA 가속 컴퓨팅 기반의 검증된 스택을 제공함으로써 실험 단계의 에이전트를 실제 비즈니스 가치를 창출하는 프로덕션 수준으로 빠르게 전환할 수 있게 한다.

섹션별 상세

curl -X POST "${DATAROBOT_API_ENDPOINT}/workloads/" \

-H "Authorization: Bearer ${DATAROBOT_API_TOKEN}" \

-H "Content-Type: application/json" \

-d '{

"name": "agent-service",

"importance": "HIGH",

"artifact": {

"name": "agent-service-v1",

"status": "locked",

"spec": {

"containerGroups": [{

"containers": [{

"imageUri": "your-registry/agent-service:latest",

"port": 8080,

"primary": true,

"entrypoint": ["python", "server.py"],

"resourceRequest": {"cpu": 1, "memory": 536870912},

"readinessProbe": {"path": "/readyz", "port": 8080}

}] }]

}

},

"runtime": {

"replicaCount": 2,

"autoscaling": {

"enabled": true,

"policies": [{

"scalingMetric": "inferenceQueueDepth",

"target": 70,

"minCount": 1,

"maxCount": 5

}] }

}

}'Workload API를 사용하여 컨테이너화된 에이전트 서비스를 오토스케일링 정책과 함께 배포하는 예시

functions:

planner:

_type: chat_completion

llm_name: datarobot_llm

system_prompt: |

You are a content planner. You create brief, structured outlines for blog articles.

writer:

_type: chat_completion

llm_name: datarobot_llm

system_prompt: |

You are a content writer working with a planner colleague.

content_writer_pipeline:

_type: sequential_executor

tool_list: [planner, writer]

workflow:

_type: tool_calling_agent

llm_name: datarobot_llm

tool_names:

- content_writer_pipelineNAT(Node Architecture Tooling)를 사용하여 플래너와 라이터 노드로 구성된 순차적 에이전트 워크플로우를 정의하는 YAML 설정

실무 Takeaway

- Nebius의 Token Factory를 실험 단계에서 활용하면 사용한 토큰만큼만 비용을 지불하여 초기 인프라 구축 비용 없이 신속하게 에이전트를 프로토타이핑할 수 있다.

- Workload API를 사용하면 복잡한 에이전트 시스템을 컨테이너화하여 배포할 때 RBAC, 감사 추적, 오토스케일링이 포함된 거버넌스 엔드포인트를 즉시 생성할 수 있다.

- LLM-as-a-Judge 및 골든 데이터셋 기반의 평가 프레임워크를 도입하여 에이전트의 답변 정확도와 브랜드 가이드라인 준수 여부를 정량적으로 검증해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료