핵심 요약

최적화 알고리즘의 수렴 분석과 제어 이론의 안정성 분석 사이에는 밀접한 수학적 연결 고리가 존재한다. 경사 하강법과 같은 최적화 기법은 사실상 PID 제어기와 동일한 구조를 가진 동적 시스템으로 해석되며, 리아푸노프 함수를 통해 그 수렴성이 증명된다. 이러한 관점은 Nesterov의 가속 기법처럼 복잡한 알고리즘의 분석을 자동화하고, 더 견고한 학습 시스템을 설계하는 데 중요한 통찰을 제공한다. 저자는 최적화와 제어라는 두 분야의 융합을 통해 라플라스 변환 없이도 PID 제어를 이해할 수 있는 새로운 교육적 접근법을 제안한다.

배경

볼록 최적화(Convex Optimization), 제어 공학 기초(Control Theory), 리아푸노프 안정성(Lyapunov Stability), 미분적분학

대상 독자

최적화 이론 연구자, 제어 공학자, 기계학습 알고리즘 설계자

의미 / 영향

최적화와 제어 이론의 융합은 AI 모델 학습의 안정성을 높이고 비용을 최적화하는 새로운 알고리즘 설계의 기반이 된다. 특히 PID 제어 관점에서의 해석은 복잡한 딥러닝 최적화 기법들을 더 직관적이고 체계적으로 분석할 수 있게 한다.

섹션별 상세

최적화 알고리즘의 수렴 증명은 동적 시스템의 안정성을 평가하는 리아푸노프 함수(Lyapunov function) 분석과 본질적으로 동일하다. 경사 하강법의 분석은 함수 값 자체나 최적점까지의 거리를 리아푸노프 함수로 설정하는 것에서 시작된다. Nesterov의 가속 기법 또한 복잡한 형태의 리아푸노프 함수를 사용하여 수렴성을 증명하며, 이는 알고리즘이 진행됨에 따라 특정 에너지 함수가 감소함을 보여주는 과정이다.

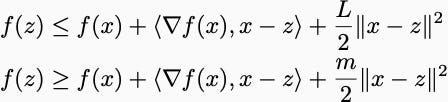

경사 하강법 분석의 핵심은 립시츠 연속성(Lipschitz continuity)과 강볼록성(Strong convexity)이라는 두 가지 부등식에 기반한다. 립시츠 상수는 그래디언트의 변화율 상한을 결정하며, 강볼록성 파라미터는 하한을 결정한다. 최적화 이론가들은 이 두 부등식을 조합하여 리아푸노프 함수가 매 반복마다 감소함을 수학적으로 증명하며, 이는 제어 이론에서 비선형 시스템의 안정성을 보장하는 방식과 일치한다.

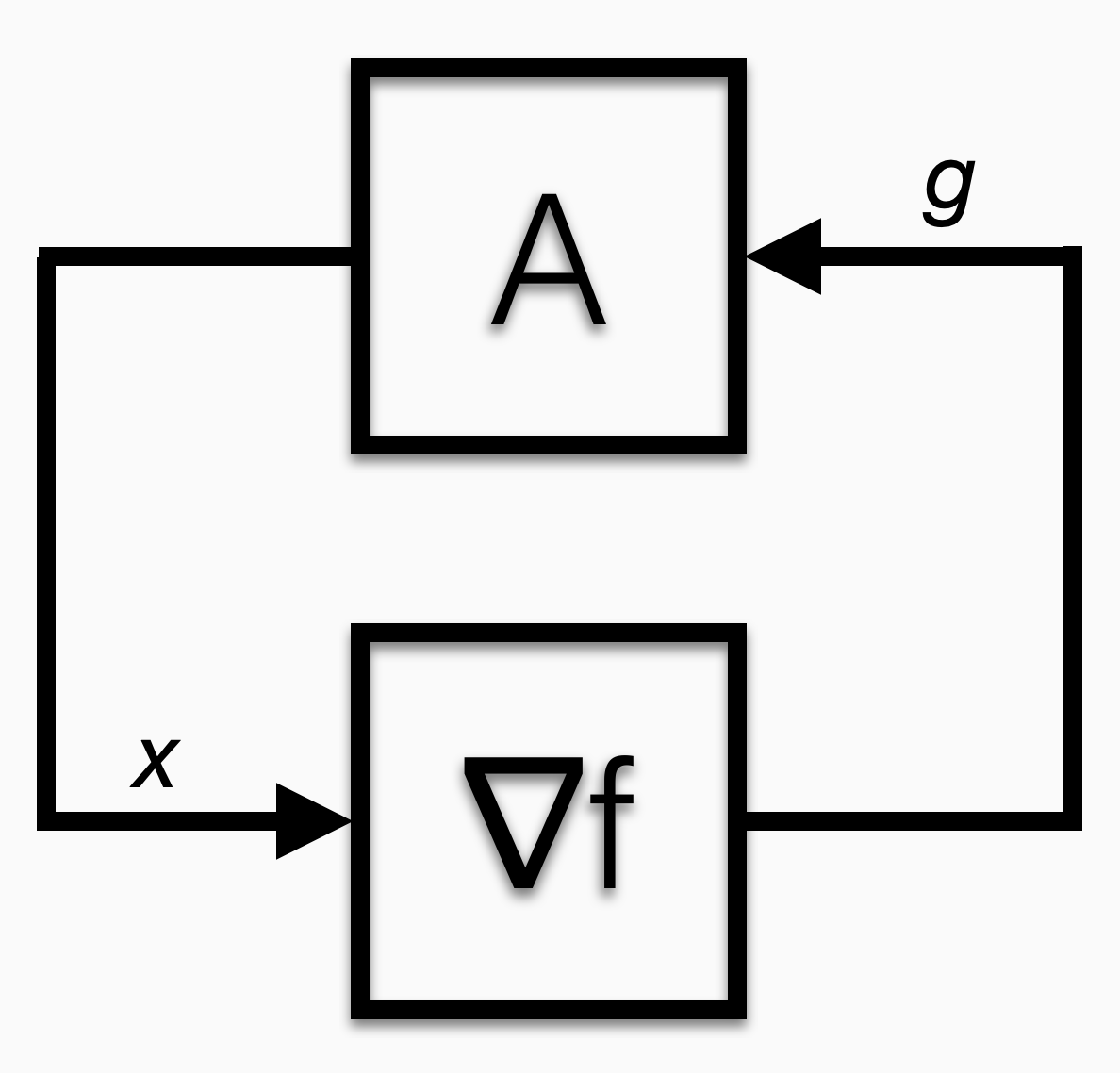

최적화 알고리즘은 입력 벡터를 받아 볼록 함수의 그래디언트를 출력하는 블랙박스를 포함한 피드백 제어 시스템으로 모델링된다. 이 관점에서 경사 하강법은 오차를 누적하여 수정하는 적분 제어기(Integral controller)와 정확히 일치한다. 가속 기법들은 비례-적분-미분(PID) 제어기의 구조를 띠며, 투영 경사 하강법(Projected gradient)은 PI 제어기로 해석될 수 있다.

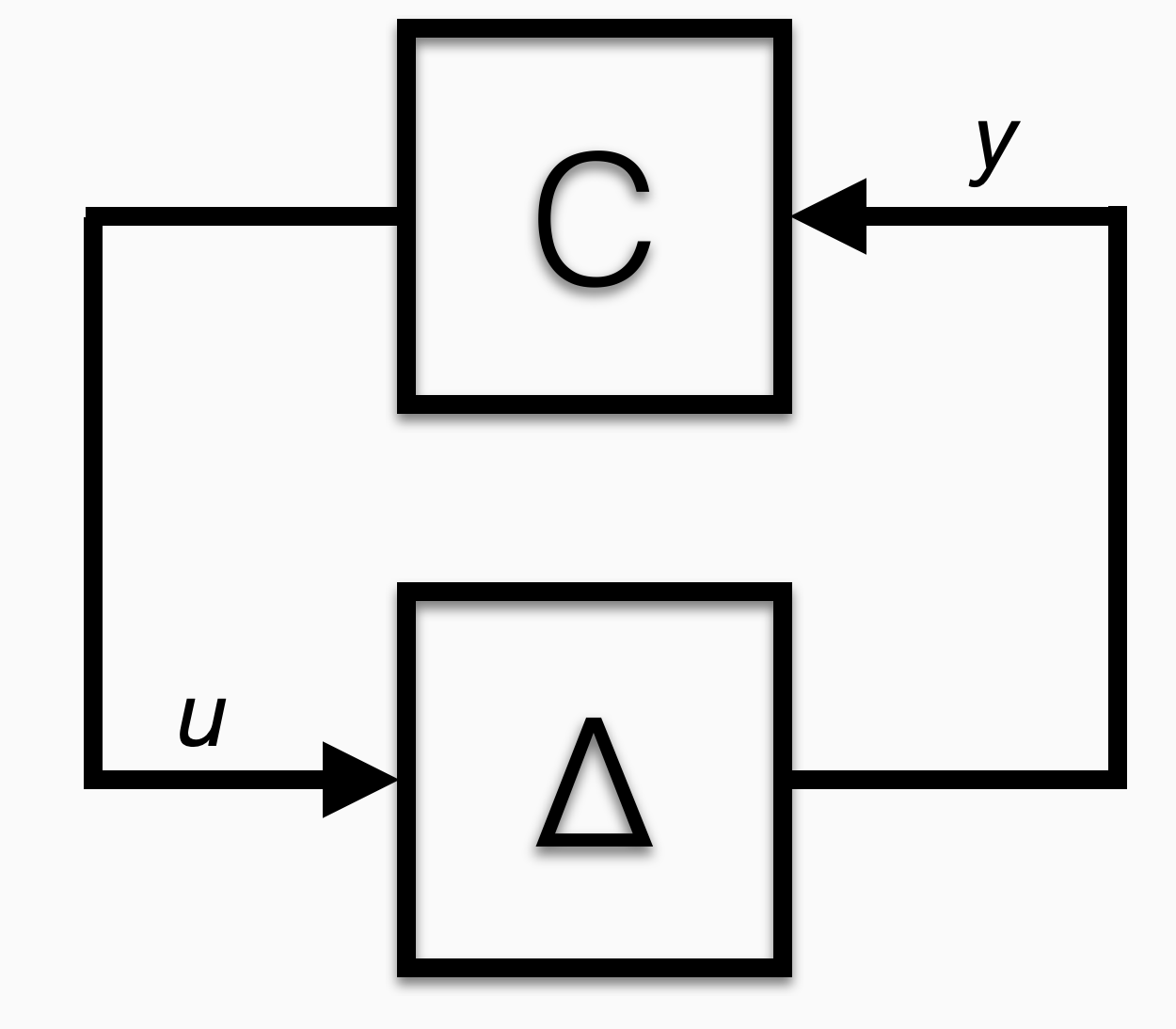

적분 이차 제약(IQC) 프레임워크를 통해 최적화 알고리즘의 분석을 자동화할 수 있다. 제어 이론에서 불확실한 비선형성을 다루는 '섹터 경계(Sector-bounded)' 개념을 최적화의 기울기 조건에 적용하면, 컴퓨터가 리아푸노프 스타일의 증명을 스스로 찾아내도록 만들 수 있다. 이러한 자동화된 증명 시스템은 알고리즘의 수렴 속도뿐만 아니라 수치적 안정성과 견고성에 대한 새로운 통찰을 제공한다.

이미지 분석

실무 Takeaway

- 경사 하강법을 단순한 최적화 도구가 아닌 적분 제어 시스템으로 이해하면 제어 이론의 풍부한 안정성 분석 도구를 활용할 수 있다.

- Nesterov 가속 기법의 복잡한 수렴 증명은 적절한 리아푸노프 함수를 설정함으로써 체계적인 동적 시스템 분석 문제로 치환된다.

- IQC나 PEP 프레임워크를 사용하면 새로운 최적화 알고리즘의 수렴 성능과 견고성을 수학적으로 자동 검증할 수 있다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료