핵심 요약

중국 AI 기업 MiniMax가 최신 모델 MiniMax-M2.7을 출시하며 오픈 모델 시장의 효율성 기준을 경신했다. 이 모델은 Z.ai의 GLM-5와 대등한 지능 지수를 기록하면서도 추론 비용은 1/3 수준으로 낮췄으며, 특히 모델이 스스로 학습 데이터를 생성하고 성능을 개선하는 자가 진화(Self-Evolution) 능력을 갖췄다. 아티클은 이 외에도 Xiaomi의 MiMo-V2-Pro 출시, Mamba-3 하이브리드 아키텍처의 부상, 그리고 단순 프롬프팅을 넘어선 에이전트 하네스 중심의 시스템 설계 트렌드를 심도 있게 다룬다.

배경

LLM 벤치마크 지표 이해, 에이전트 아키텍처 기본 지식, RAG 및 벡터 검색 개념

대상 독자

LLM 기반 에이전트 및 프로덕션 시스템 개발자, AI 인프라 엔지니어

의미 / 영향

MiniMax-M2.7의 등장은 고성능 모델의 가격 경쟁을 가속화하며, 자가 진화 개념의 실용화 가능성을 보여준다. 에이전트 구축의 중심이 모델 튜닝에서 시스템 하네스 설계로 이동하고 있음을 시사한다.

섹션별 상세

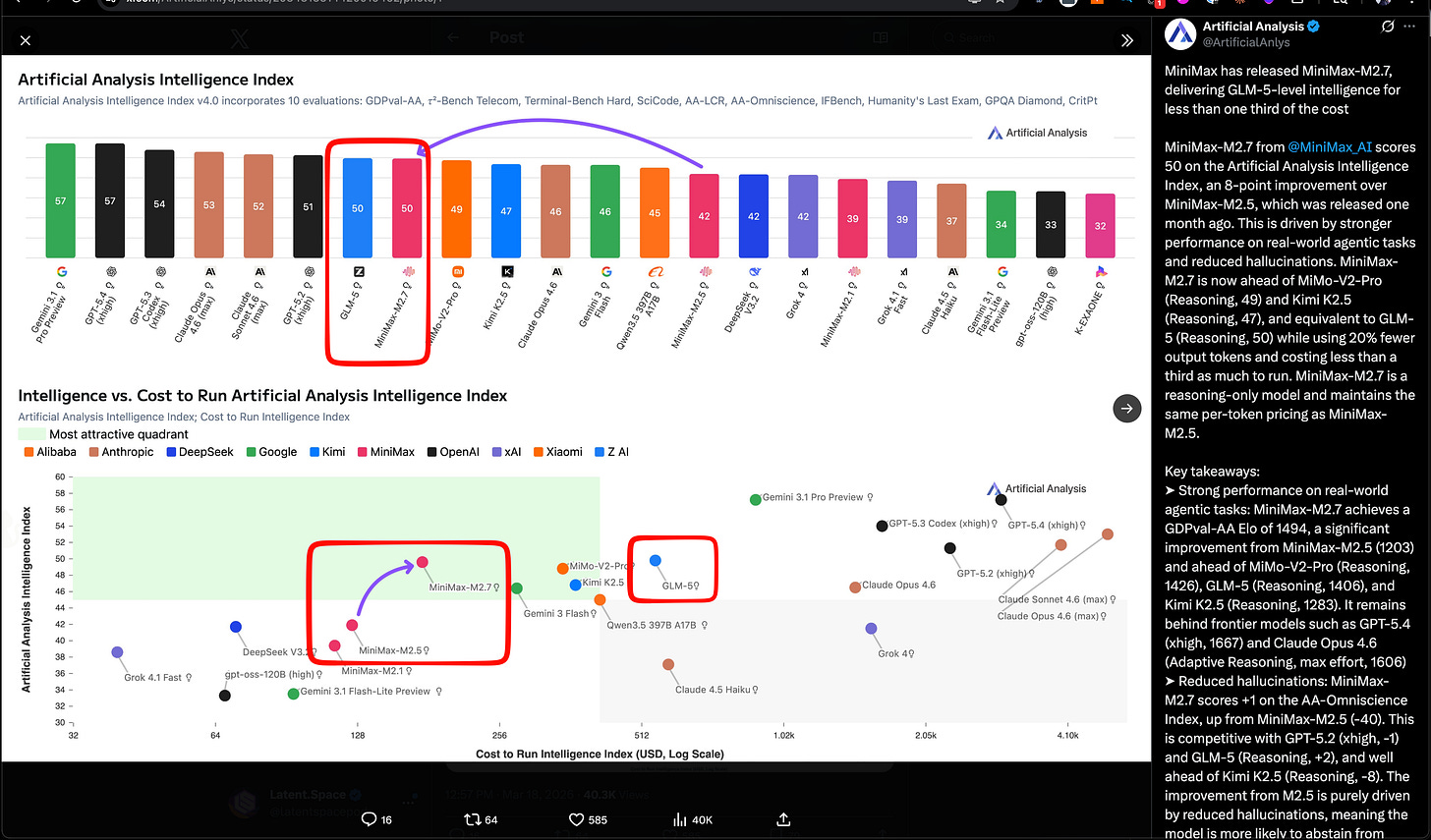

MiniMax-M2.7은 Artificial Analysis 지능 지수에서 50점을 기록하며 GLM-5와 동등한 수준에 올랐다. 100만 토큰당 입력 $0.30, 출력 $1.20의 가격 정책을 통해 GLM-5 대비 1/3 미만의 비용으로 운영이 가능하다. 실세계 에이전트 작업 성능이 크게 향상되었으며, 이전 버전인 M2.5 대비 환각 현상이 눈에 띄게 줄어든 것이 확인됐다.

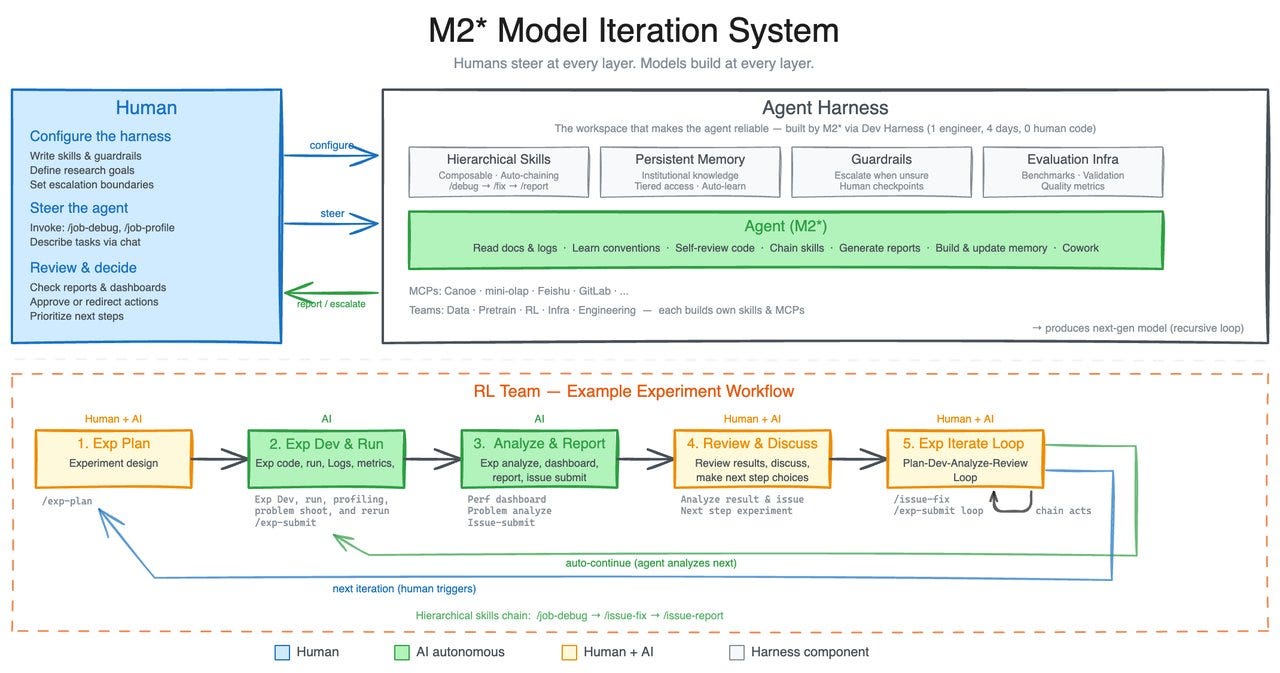

모델이 자신의 진화 과정에 깊이 참여하는 자가 진화 메커니즘을 도입했다. 내부 하네스 시스템을 통해 스스로 피드백을 수집하고, 평가 데이터셋을 구축하며, 기술(Skills)과 아키텍처를 반복적으로 개선한다. 현재 전체 개발 워크플로의 30~50%를 모델이 직접 처리할 수 있는 수준에 도달했으며, 이를 통해 내부 평가 세트에서 30%의 성능 향상을 달성했다.

업계의 관심이 단순한 모델 성능에서 모델을 둘러싼 실행 환경인 하네스 엔지니어링으로 이동하고 있다. 에이전트의 신뢰성을 높이기 위해 계층적 기술, 지속성 메모리, 가드레일, 평가 인프라를 통합하는 시스템 설계가 중요해졌다. 기술(Skills)은 단순한 텍스트 스니펫을 넘어 스크립트와 자산을 포함한 패키지 형태로 진화하고 있으며, MCP를 통한 배포 방식이 논의되고 있다.

Mamba-3의 출시와 함께 SSM을 Transformer와 결합하는 하이브리드 구조가 주목받고 있다. Kimi의 Attention Residual 연구는 모델 연구와 인프라의 공동 설계가 성능의 핵심임을 보여준다. Hugging Face의 새로운 커널 라이브러리 출시로 인해 복잡한 커스텀 커널의 배포와 통합이 용이해지면서 추론 최적화 장벽이 낮아지고 있다.

문서 지능(Document AI) 분야는 표, 수식, 차트 이해를 단일 패스로 처리하는 엔드투엔드 멀티모달 파서로 진화하고 있다. Baidu의 Qianfan-OCR과 Chandra OCR 2는 높은 정확도와 다국어 지원을 제공한다. LlamaIndex는 이를 컨텍스트 엔지니어링으로 정의하며, 레이아웃 감지와 시각적 근거를 포함한 인간 감사 가능한 워크플로의 중요성을 강조한다.

실무 Takeaway

- MiniMax-M2.7처럼 비용 효율성이 극대화된 SOTA급 오픈 모델을 활용하여 RAG 및 에이전트 시스템의 운영 비용을 기존 대비 70% 이상 절감할 수 있다.

- 성능 차별화의 핵심이 모델 자체에서 에이전트 하네스와 기술(Skills) 설계로 이동하고 있으므로, 도구 사용 및 피드백 루프가 포함된 시스템 아키텍처 구축에 집중해야 한다.

- 복잡한 문서 데이터 처리를 위해 단순 마크다운 변환 대신 레이아웃과 시각 정보를 보존하는 멀티모달 OCR 모델과 컨텍스트 엔지니어링 기법을 도입해야 한다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료