핵심 요약

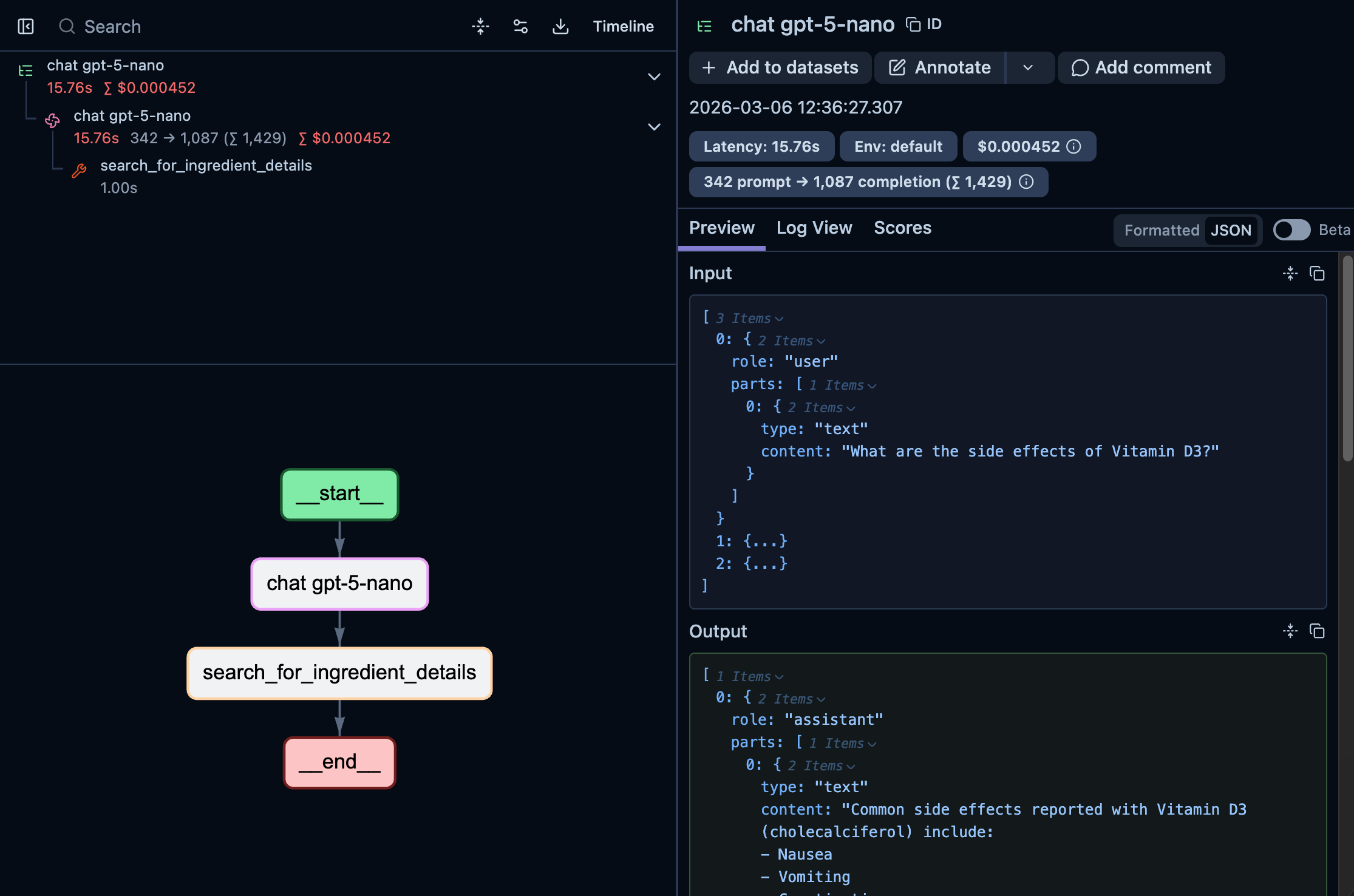

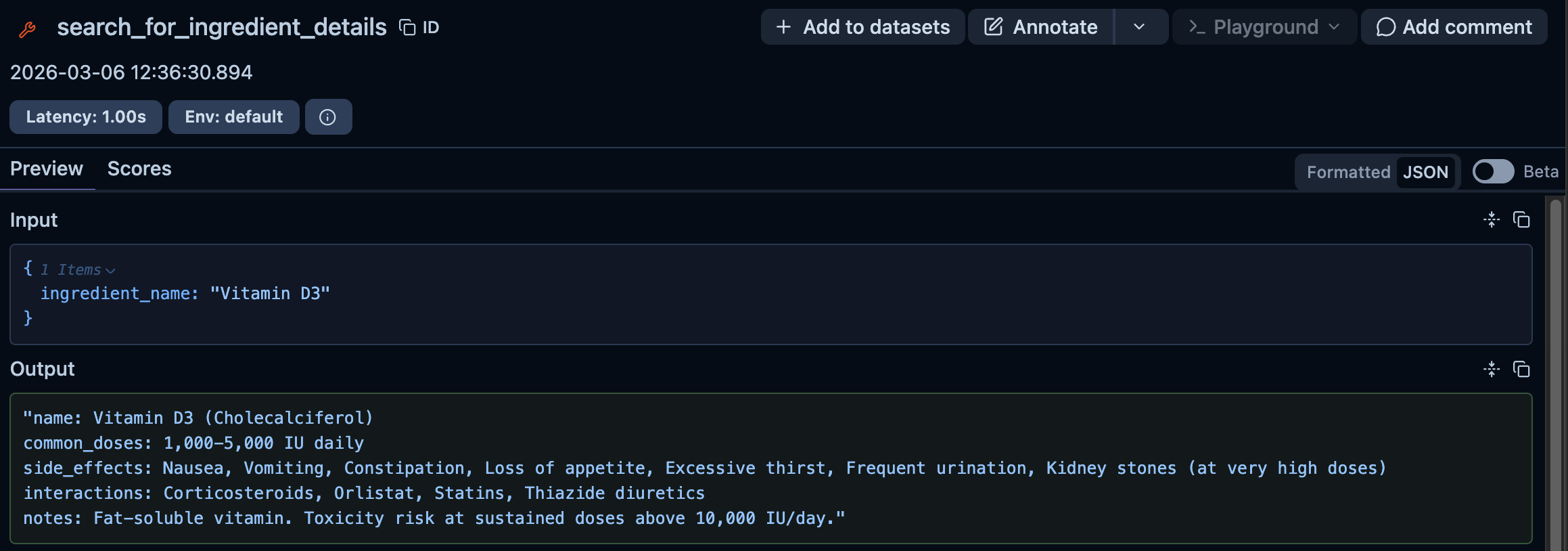

LLM을 프로덕션 환경에서 운영할 때 발생하는 지연 시간 디버깅과 토큰 비용 추적의 어려움을 해결하기 위해 RubyLLM 전용 OpenTelemetry 인스트루멘테이션이 출시되었다. 기존의 단순 데이터베이스 로깅은 호출 간의 맥락과 정확한 타이밍 정보를 제공하지 못하는 한계가 있었다. 새로운 도구는 별도의 코드 수정 없이 채팅 완료, 도구 호출, 토큰 사용량을 자동으로 캡처하여 표준 규격으로 전송한다. 이를 통해 개발자는 Langfuse와 같은 플랫폼에서 복잡한 에이전트 워크플로우를 타임라인 형태로 시각화하고 성능 병목 지점을 즉각적으로 파악할 수 있다.

배경

Ruby 및 RubyLLM 라이브러리에 대한 기본 지식, OpenTelemetry의 기본 개념 (Trace, Span, Exporter), Langfuse 등 LLM 관측성 플랫폼 계정 (선택 사항)

대상 독자

RubyLLM을 사용하여 프로덕션 환경에서 LLM 서비스를 구축하고 운영하는 개발자 및 시스템 아키텍트

의미 / 영향

Ruby 생태계에서도 LLM 관측성을 위한 표준화된 도구가 마련됨에 따라, 복잡한 AI 에이전트 시스템의 안정성과 투명성을 확보하기가 훨씬 쉬워졌다. 이는 특히 금융이나 의료와 같이 엄격한 감사 추적이 필요한 분야에서 Ruby 기반 AI 서비스 도입을 가속화하는 계기가 될 것이다.

섹션별 상세

gem "opentelemetry-sdk"

gem "opentelemetry-exporter-otlp"

gem "opentelemetry-instrumentation-ruby_llm"RubyLLM 관측성을 위한 필수 젬 설치 설정

OpenTelemetry::SDK.configure do |c|

c.use "OpenTelemetry::Instrumentation::RubyLLM"

endRubyLLM 인스트루멘테이션을 활성화하는 기본 설정 코드

OpenTelemetry::SDK.configure do |c|

c.service_name = "ruby_llm-demo"

c.add_span_processor(

OpenTelemetry::SDK::Trace::Export::BatchSpanProcessor.new(

OpenTelemetry::Exporter::OTLP::Exporter.new(

endpoint: "https://us.cloud.langfuse.com/api/public/otel/v1/traces",

headers: { "Authorization" => "Basic #{credentials}" }

)

)

)

c.use "OpenTelemetry::Instrumentation::RubyLLM"

end수집된 트레이스 데이터를 Langfuse 백엔드로 전송하기 위한 상세 설정

실무 Takeaway

- opentelemetry-instrumentation-ruby_llm 젬을 사용하면 기존 RubyLLM 코드를 수정하지 않고도 전체 LLM 워크플로우를 자동 추적할 수 있다.

- Langfuse와 같은 OTLP 백엔드를 연동하여 실시간으로 토큰 비용을 모니터링하고 지연 시간 병목 지점을 시각적으로 분석할 수 있다.

- 프로덕션 배포 시에는 보안을 위해 메시지 내용 캡처 옵션을 신중히 관리하고 민감 정보 필터링 메커니즘을 반드시 구축해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료