핵심 요약

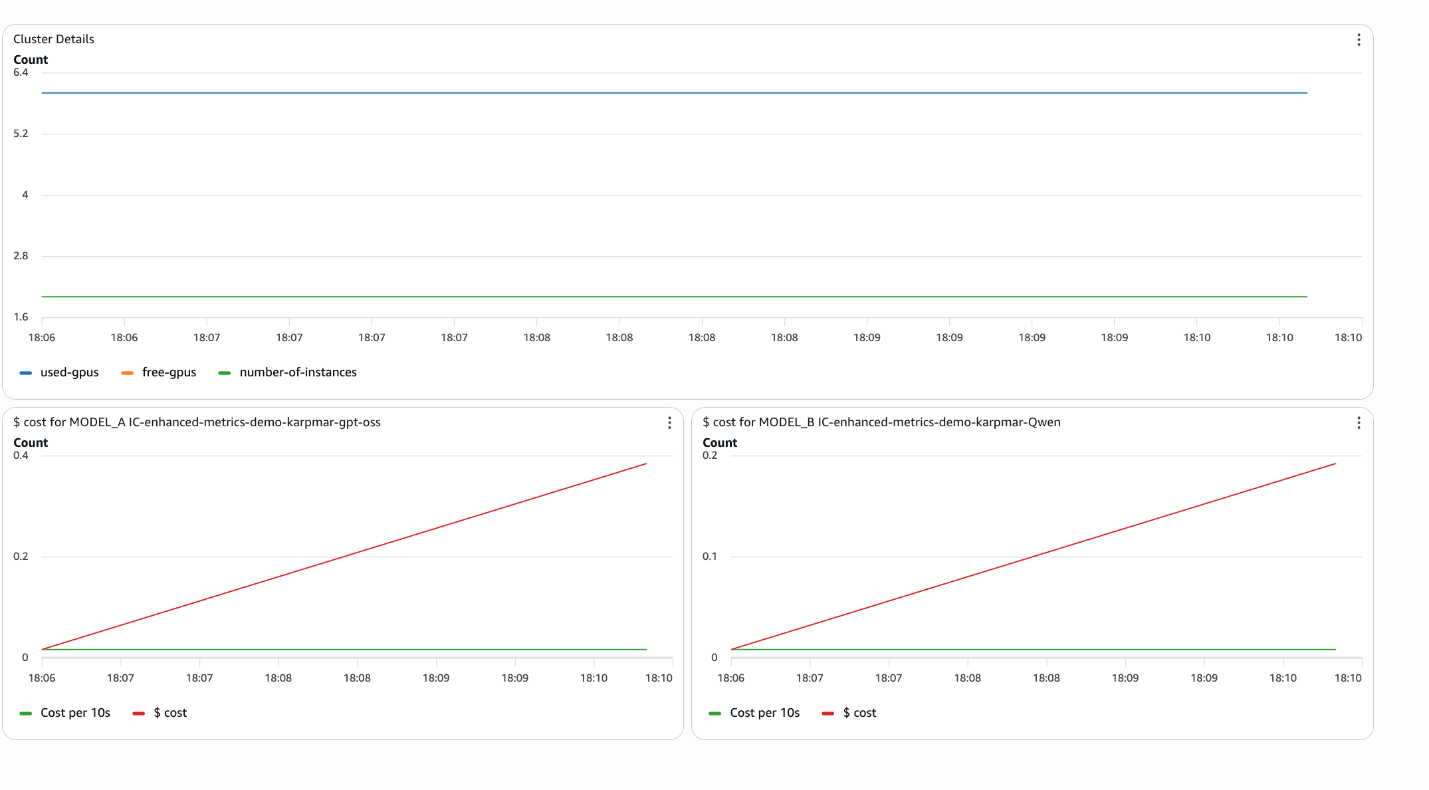

Amazon SageMaker AI는 기존의 집계된 메트릭 한계를 넘어 개별 인스턴스와 컨테이너 수준의 상세 정보를 제공하는 향상된 메트릭 기능을 도입했다. 이 기능을 통해 개발자는 다중 모델 환경에서 모델별 GPU 사용량과 비용을 정확히 산출하고 병목 현상을 정밀하게 진단할 수 있다. 메트릭 발행 주기를 최소 10초까지 설정할 수 있어 실시간 모니터링과 공격적인 오토스케일링이 가능해졌다. 결과적으로 복잡한 프로덕션 환경에서 ML 워크로드의 운영 효율성과 비용 투명성을 개선한다.

배경

Amazon SageMaker AI 엔드포인트 운영 경험, Amazon CloudWatch 메트릭 및 쿼리 표현식에 대한 기본 지식, SageMaker Inference Components 개념 이해

대상 독자

SageMaker를 사용하여 대규모 ML 모델을 배포하고 운영하는 MLOps 엔지니어 및 개발자

의미 / 영향

이 기능은 다중 모델 호스팅 환경에서 불투명했던 리소스 소비와 비용 구조를 명확하게 시각화한다. 특히 GPU 자원의 효율적 배분과 모델별 정확한 ROI 분석을 가능하게 하여 기업의 ML 운영 비용 최적화에 기여한다.

섹션별 상세

response = cloudwatch.get_metric_data(

MetricDataQueries=[

{

'Id': 'e1',

'Expression': 'SEARCH(\'{/aws/sagemaker/InferenceComponents,InferenceComponentName,GpuId} MetricName="GPUUtilizationNormalized" InferenceComponentName="IC-my-model"\', \'SampleCount\', 10)'

},

{

'Id': 'e2',

'Expression': 'SUM(e1)' # GPU count

},

{

'Id': 'e3',

'Expression': 'e2 * 5.752 / 4 / 360' # Cost per 10s based on ml.g6.12xlarge hourly cost

},

{

'Id': 'e4',

'Expression': 'RUNNING_SUM(e3)' # Cumulative cost

}

],

StartTime=start_time,

EndTime=end_time

)CloudWatch 쿼리를 사용하여 특정 모델의 누적 비용을 계산하는 예시

response = sagemaker_client.create_endpoint_config(

EndpointConfigName='my-config',

ProductionVariants=[{

'VariantName': 'AllTraffic',

'ModelName': 'my-model',

'InstanceType': 'ml.g6.12xlarge',

'InitialInstanceCount': 2

}],

MetricsConfig={

'EnableEnhancedMetrics': True,

'MetricsPublishFrequencyInSeconds': 10, # Default 60s

}

)엔드포인트 설정 시 향상된 메트릭을 활성화하고 발행 주기를 10초로 설정하는 예시

실무 Takeaway

- 다중 모델 엔드포인트 운영 시 EnableEnhancedMetrics 파라미터를 활성화하여 모델별 정확한 비용 청구 모델을 구축할 수 있다.

- 성능 병목 현상이 의심되는 경우 메트릭 주기를 10초로 설정하여 인스턴스 간 트래픽 불균형이나 특정 컨테이너의 리소스 고갈 문제를 정밀하게 추적한다.

- CloudWatch의 SEARCH와 SUM 표현식을 조합하여 클러스터 내 유휴 GPU 자원을 실시간으로 감시함으로써 서비스 중단 없는 확장 전략을 수립한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료