핵심 요약

LLM 도입 및 셀프 호스팅을 고려하는 기술 결정자와 엔지니어를 위해 토큰, 가중치, 추론, KV 캐시 등 핵심 개념을 정리한다. 텍스트가 토큰으로 변환되어 모델을 통과하고 다시 텍스트로 복구되는 전 과정을 다루며 특히 vLLM과 같은 추론 엔진의 역할과 최적화 기법을 강조한다. 이를 통해 API 서비스와 자체 구축 모델 간의 비용 및 성능 트레이드오프를 정확히 평가할 수 있는 기반 지식을 제공한다.

배경

LLM 기본 구조 이해, GPU 및 VRAM 개념, Python 및 API 활용 능력

대상 독자

LLM 셀프 호스팅 및 인프라 최적화를 고민하는 엔지니어 및 기술 결정자

의미 / 영향

오픈소스 모델의 효율적인 서빙 기법과 양자화 기술의 발전은 기업들이 고가의 API 의존도를 낮추고 자체 인프라에서 고성능 AI를 운영할 수 있게 한다. 특히 vLLM과 같은 엔진을 통한 최적화는 실시간 서비스 구현의 비용 장벽을 크게 낮추는 역할을 한다.

섹션별 상세

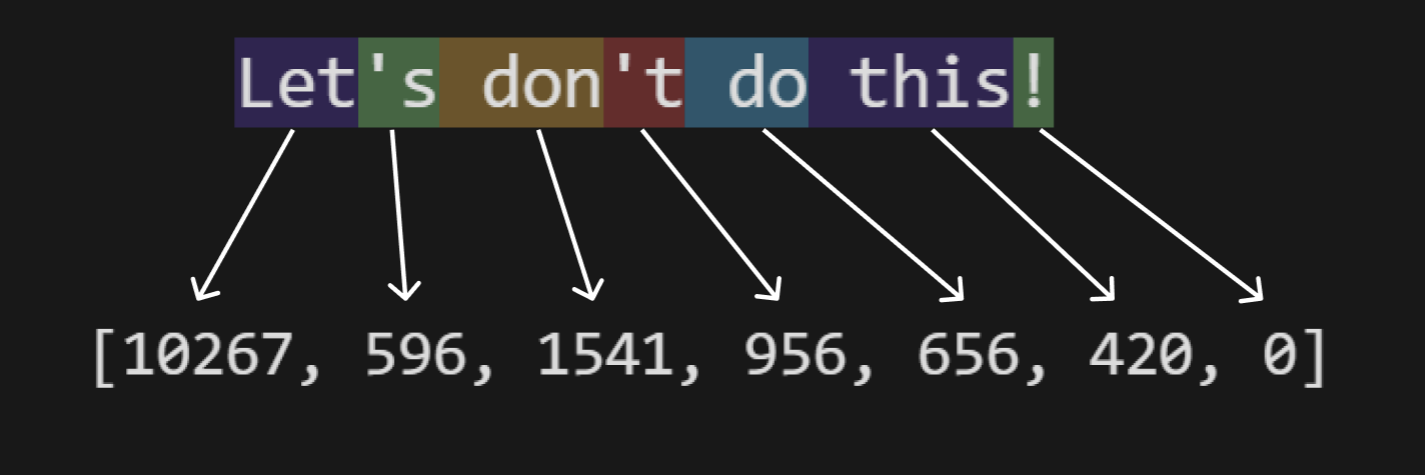

텍스트는 모델 처리 전 숫자로 된 토큰으로 변환되며 영어 기준 1단어는 약 1.3토큰에 해당한다. 모델 가중치는 GPU의 VRAM에 로드되어 연산에 사용되며 파라미터 수가 많을수록 더 많은 메모리가 필요하다. 최근에는 지식 증류 기법을 통해 적은 파라미터로도 과거 대형 모델의 성능을 능가하는 효율적인 모델들이 등장하고 있다.

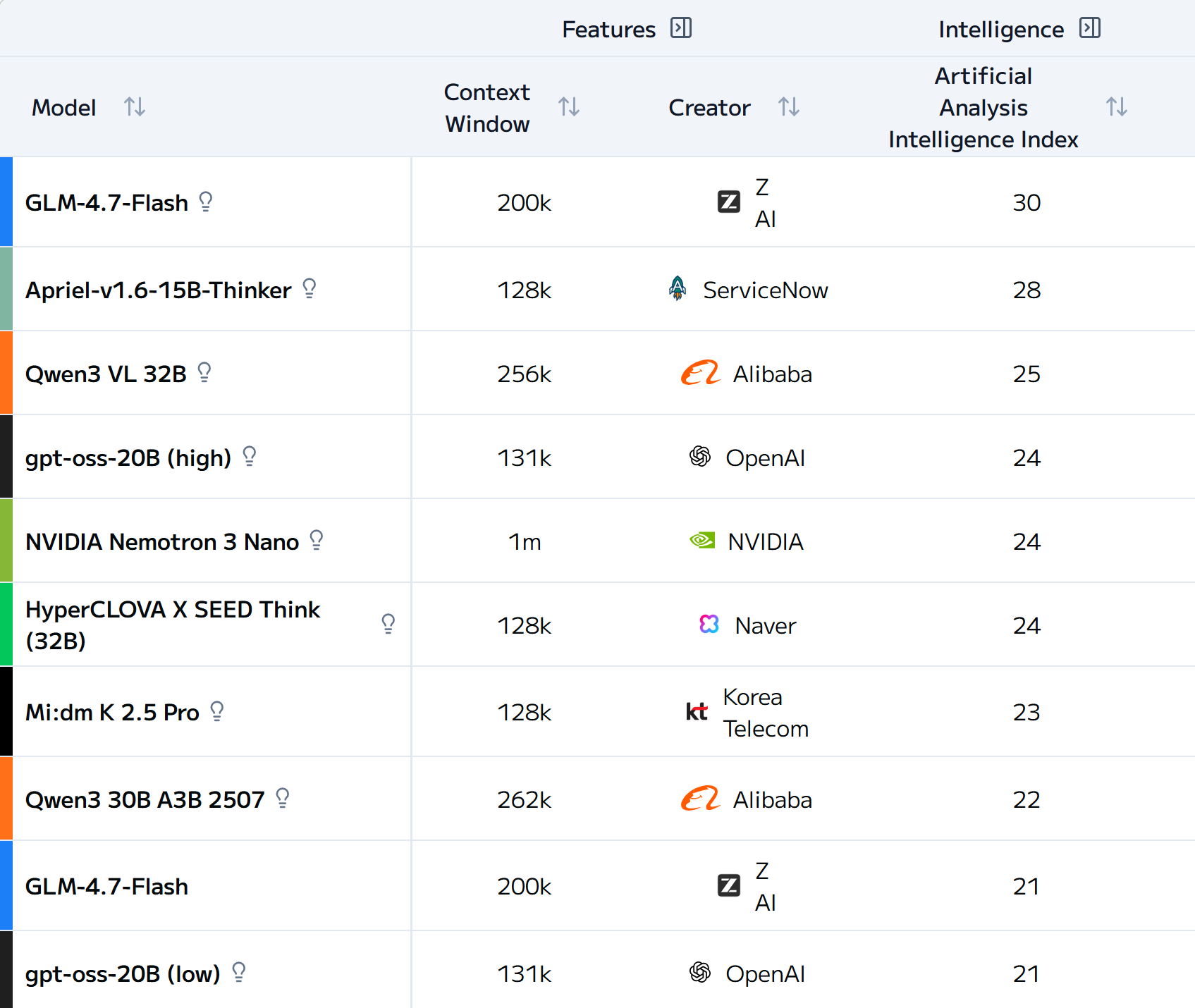

추론은 VRAM에 로드된 모델이 응답을 생성하는 과정이며 입력과 출력 토큰의 총합인 유효 시퀀스 길이는 모델의 컨텍스트 윈도우 제한을 넘을 수 없다. 컨텍스트 윈도우는 아키텍처상의 한계치이나 실제 운영 시에는 지연 시간과 품질 저하를 방지하기 위해 이보다 훨씬 적은 토큰을 사용하는 것이 권장된다. 토큰 수 표기 시 128k와 128Ki 사이의 이진 접두사 차이를 명확히 구분하는 것이 기술적 정확성 측면에서 중요하다.

추론 모델은 단순 패턴 매칭을 넘어 다단계 논리 단계를 거치도록 훈련되어 수학이나 코딩 등 복잡한 분석 작업에서 높은 신뢰도를 제공한다. 추론 과정에서 생성되는 생각 토큰은 모델의 논리적 정확도를 높이지만 전체 시퀀스 길이를 늘려 메모리 사용량을 증가시키는 요인이 된다. 사용자는 reasoning_effort 파라미터를 조절하여 추론의 깊이와 생성 속도 사이의 균형을 전략적으로 선택할 수 있다.

양자화는 모델 가중치의 정밀도를 낮추어 VRAM 점유율을 획기적으로 줄이는 포스트 프로세싱 기법이다. BF16 형식을 4비트로 압축하면 메모리 사용량을 4분의 1로 줄일 수 있어 저사양 하드웨어에서도 대형 모델 실행이 가능해진다. 다만 사후 양자화는 모델의 안정성을 해칠 수 있으므로 처음부터 저정밀도 추론에 최적화되어 훈련된 모델을 선택하는 것이 유리하다.

vLLM은 OpenAI API와 호환되는 고성능 추론 서버로 KV 캐시를 통해 이전 연산 결과를 재사용함으로써 생성 속도를 극대화한다. 첫 토큰 생성 단계인 프리필은 연산 부하가 크지만 이후 디코딩 단계에서는 캐시된 데이터를 활용해 매우 빠른 속도로 토큰을 스트리밍할 수 있다. 프리픽스 캐싱 기능을 활용하면 공통된 시스템 프롬프트를 공유하는 여러 요청에서 중복 연산을 제거하여 처리량을 높일 수 있다.

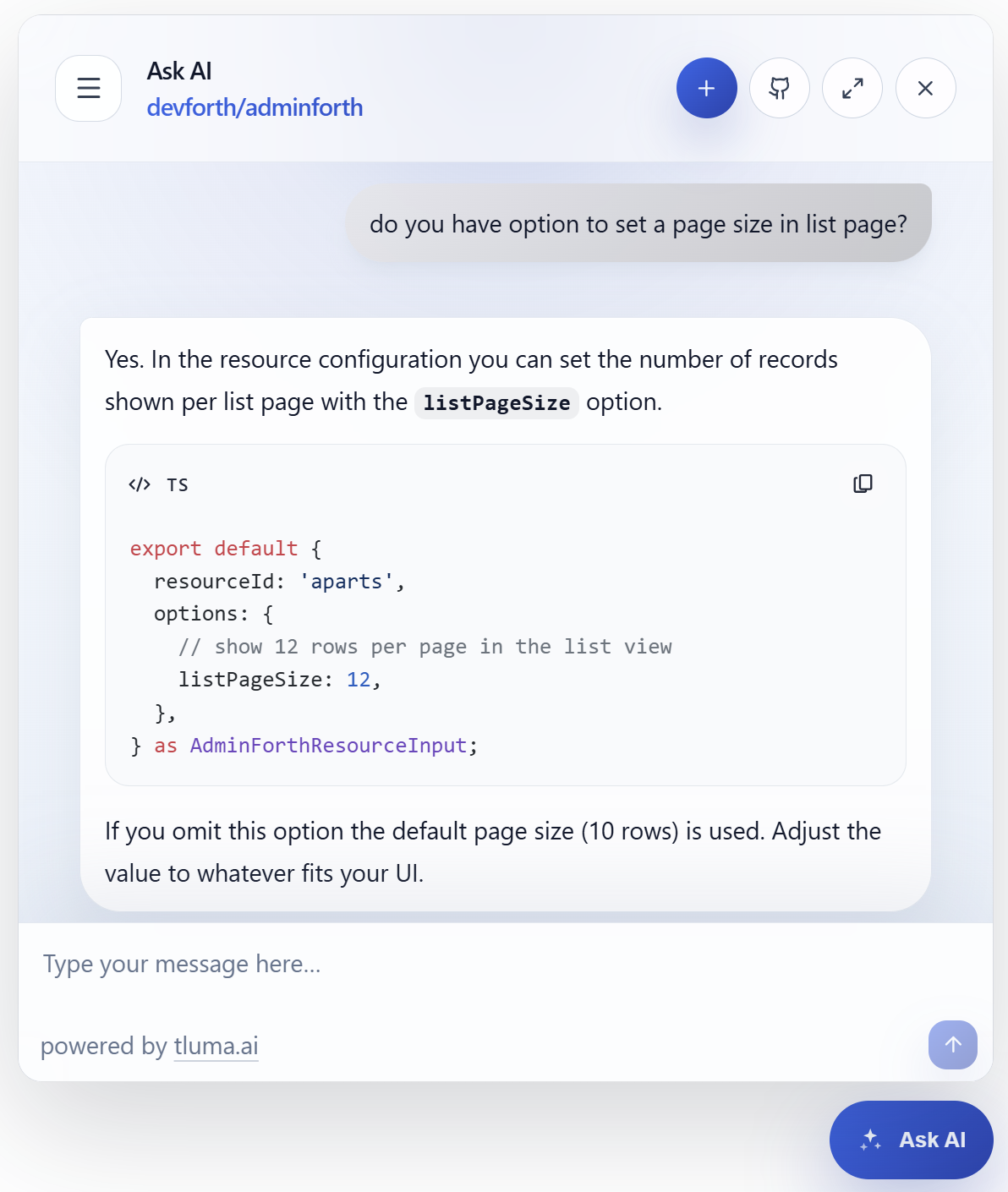

typescript

export default {

resourceId: 'aparts',

options: {

// show 12 rows per page in the list view

listPageSize: 12,

},

} as AdminForthResourceInput;AdminForth 리소스 설정에서 페이지당 표시되는 레코드 수를 지정하는 예시 코드

실무 Takeaway

- VRAM 요구량 산정 시 모델 가중치 크기뿐만 아니라 동시 접속 시퀀스 처리를 위한 KV 캐시 공간을 반드시 추가로 확보해야 한다.

- vLLM의 --max-num-seqs 파라미터를 조절하여 단일 GPU에서의 동시 처리량과 개별 요청의 지연 시간 사이의 트레이드오프를 최적화할 수 있다.

- 추론 모델 도입 시 생각 토큰으로 인한 시퀀스 길이 증가를 고려하여 컨텍스트 윈도우 설계를 보수적으로 접근해야 한다.

언급된 리소스

DemoTluma Project

GitHubvLLM GitHub

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료