핵심 요약

NYU에서 열린 'Cultural AI' 컨퍼런스의 논의를 바탕으로, 대형 언어 모델(LLM)의 본질을 '기계화된 전통(Mechanized Tradition)'으로 규정한다. 코스마 샬리지는 AI가 새로운 지능을 발휘하기보다 훈련 데이터 속의 언어적 관습과 템플릿을 기계적으로 복제하는 도구라고 주장한다. 레이몽 크노의 '문체 연습'을 활용한 실험 결과, 인간과 AI 모두 실제 품질과 무관하게 '인간이 쓴 글'이라는 라벨에 더 높은 점수를 주는 편향성을 보였다. 결과적으로 AI는 개별적 인격체가 아닌, 사회적 지성이 축적된 '지적 관습의 세탁기'로 이해해야 한다.

배경

LLM의 기본 작동 원리 (Next-token prediction), 사회과학적 설문 및 실험 설계에 대한 기초 지식

대상 독자

AI 윤리 및 사회과학 연구자, LLM의 본질을 탐구하는 개발자, 문화 기술 전문가

의미 / 영향

AI를 인격체로 보는 시각에서 벗어나 인류 문화의 거울이자 도구로 재정의한다. 특히 AI 평가 시스템에서 발생하는 '인간 선호 편향'을 수치로 입증함으로써, 향후 AI 벤치마크 설계 시 라벨링에 의한 오염 가능성을 경고한다.

섹션별 상세

코스마 샬리지는 LLM을 '정보 검색 및 합성'의 관점에서 정의하며, 이 합성이 철저히 훈련 데이터에 존재하는 언어적 관습과 장르의 규칙을 따르는 기계적 과정임을 강조한다.

인간의 문화 자체가 매우 정형화되어 있으며, 전통을 따름으로써 사고의 과정을 외부화하고 효율화한다는 점에서 AI는 인류의 외부화된 지성(Intellect)을 기계적으로 구현한 결과물이다.

자크 바준의 '지성의 집' 개념을 인용하여, AI를 개별적 인격이 아닌 사회가 공유하고 외부화한 지식의 습관과 상징이 기계화된 '로어 세탁기(Lore Laundering Machine)'로 묘사한다.

Wouter Haverals와 Meredith Martin은 레이몽 크노의 '문체 연습' 99가지 버전을 활용해 인간 번역본과 AI 생성본의 문체 재현 능력을 비교하는 설문 실험을 진행했다.

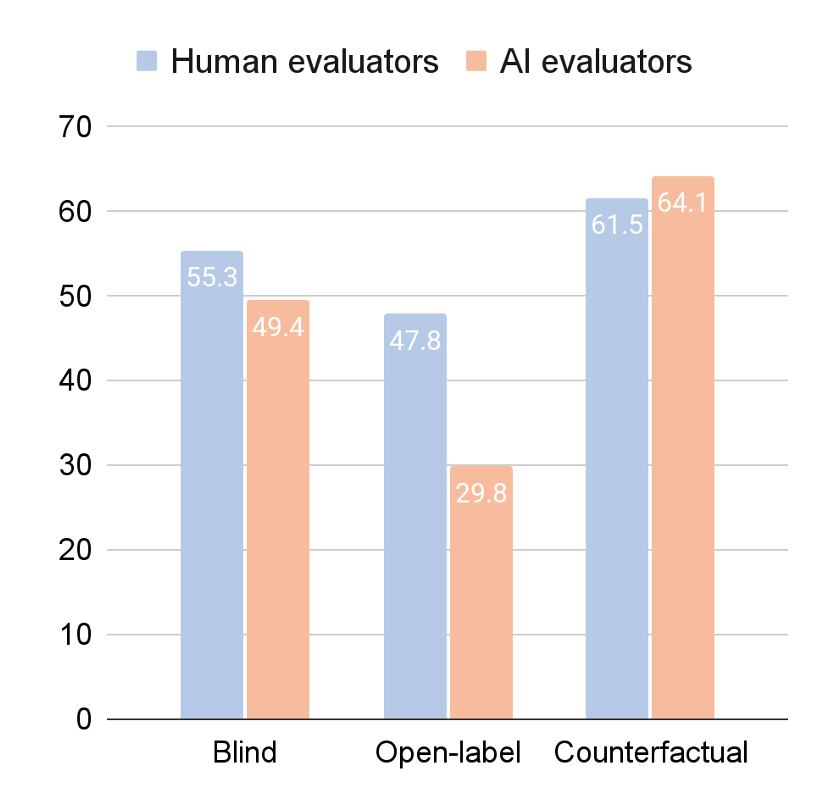

저자 정보를 가린 블라인드 테스트에서 인간 피험자들은 AI의 글을 55%의 비율로 소폭 선호했으나, 저자 라벨이 공개되자 선호도가 역전되는 현상이 발생했다.

가장 흥미로운 결과는 라벨을 반대로 붙였을 때(AI 글을 인간 글로 표시) 발생했으며, 인간(62%)과 AI(64%) 모두 '인간 저자'라고 표시된 텍스트를 압도적으로 선호하며 권위에 대한 편향성을 드러냈다.

실리콘 샘플링을 통한 AI의 자가 평가에서도 AI는 자신이 생성한 글보다 '인간 저자'라는 라벨이 붙은 글에 더 높은 점수를 부여하는 모순적 결과를 보였다.

실무 Takeaway

- LLM을 독립된 지능이 아닌 인류의 문화적 관습과 템플릿을 복제하는 '기계화된 전통'으로 인식하여 기술의 본질적 한계를 파악해야 한다.

- 콘텐츠 평가 시 '인간 저자'라는 라벨이 주는 심리적 편향이 실제 텍스트 품질보다 더 큰 영향을 미치므로, AI 결과물 평가 시 블라인드 테스트가 필수적이다.

- AI는 새로운 지식을 창조하기보다 기존의 지적 관습을 효율적으로 재사용하게 해주는 도구이므로, 창의적 사고와 정형화된 형식의 구분이 필요하다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료