핵심 요약

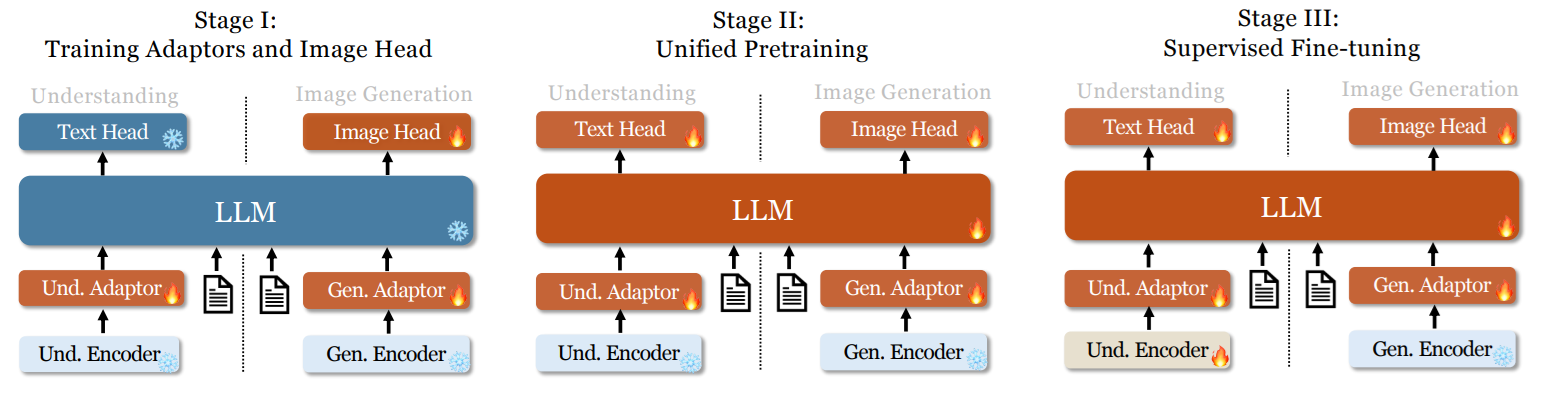

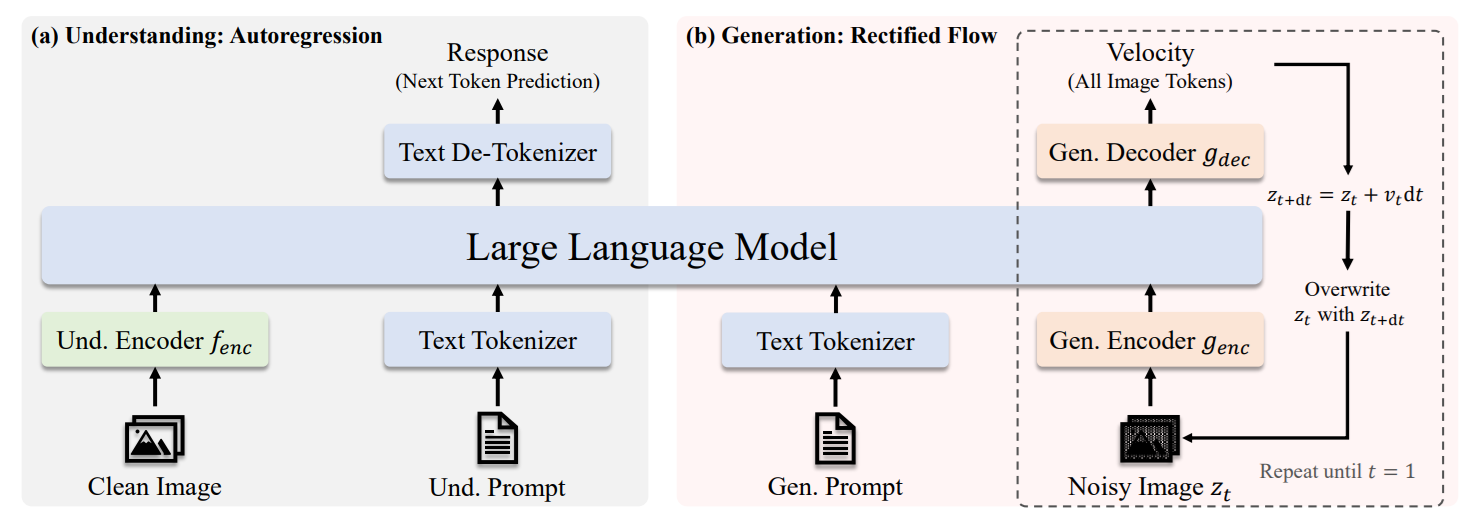

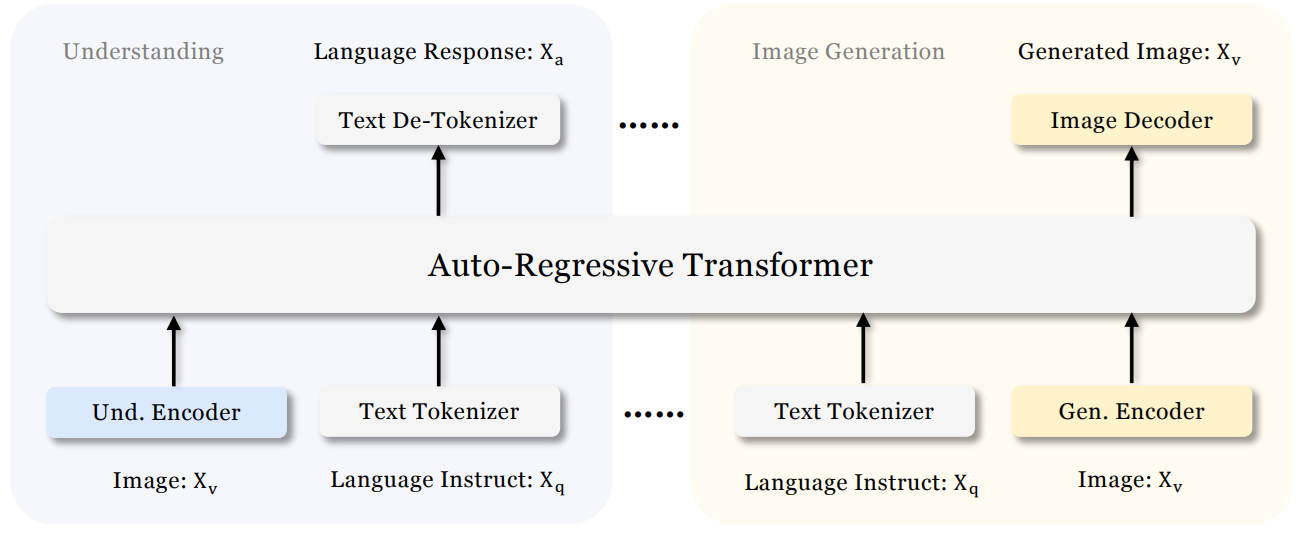

DeepSeek는 효율적인 학습 방법과 오픈 웨이트 정책을 통해 비전-언어 모델(VLM) 분야에서 중요한 위치를 차지하고 있다. 이 글은 이미지 이해와 생성을 동시에 수행하는 Janus 시리즈부터 고해상도 문서 처리에 특화된 DeepSeek-OCR까지 주요 모델들의 기술적 특징을 상세히 다룬다. 특히 최신 모델인 DeepSeek-VL2의 동적 타일링 아키텍처와 Roboflow Supervision 라이브러리를 이용해 모델의 텍스트 출력을 정형화된 객체 탐지 데이터로 변환하는 구체적인 워크플로우를 제시한다. DeepSeek의 모델들은 MoE 아키텍처와 MLA 기법을 결합하여 높은 성능과 추론 효율성을 동시에 확보했다.

배경

Python 프로그래밍 지식, PyTorch 및 Transformers 라이브러리 기본 사용법, 객체 탐지(Object Detection) 및 Bounding Box 개념 이해

대상 독자

오픈 소스 VLM을 활용하여 시각적 이해 및 생성 파이프라인을 구축하려는 AI 엔지니어 및 연구자

의미 / 영향

DeepSeek의 오픈 웨이트 모델들은 고성능 멀티모달 AI에 대한 접근성을 높여 비용 효율적인 온프레미스 배포를 가능하게 한다. 특히 이해와 생성을 통합한 Janus 아키텍처는 향후 멀티모달 에이전트 설계의 중요한 표준이 될 가능성이 크다.

섹션별 상세

import supervision as sv

from PIL import Image

image = Image.open("giraffe.png")

deepseek_vl2_result = (

"The giraffe at the back"

"[[580, 270, 999, 904]]"

"The giraffe at the front"

"[[26, 31, 632, 998]]"

)

detections = sv.Detections.from_vlm(

vlm=sv.VLM.DEEPSEEK_VL_2,

result=deepseek_vl2_result,

resolution_wh=image.size

)

print(detections.xyxy)

print(detections.data["class_name"])DeepSeek-VL2의 텍스트 출력을 Roboflow Supervision을 사용하여 정형화된 객체 탐지 데이터로 변환하는 예시

실무 Takeaway

- 고해상도 문서나 복잡한 차트 분석이 필요한 프로젝트에는 동적 타일링을 지원하는 DeepSeek-VL2 모델이 가장 적합하다.

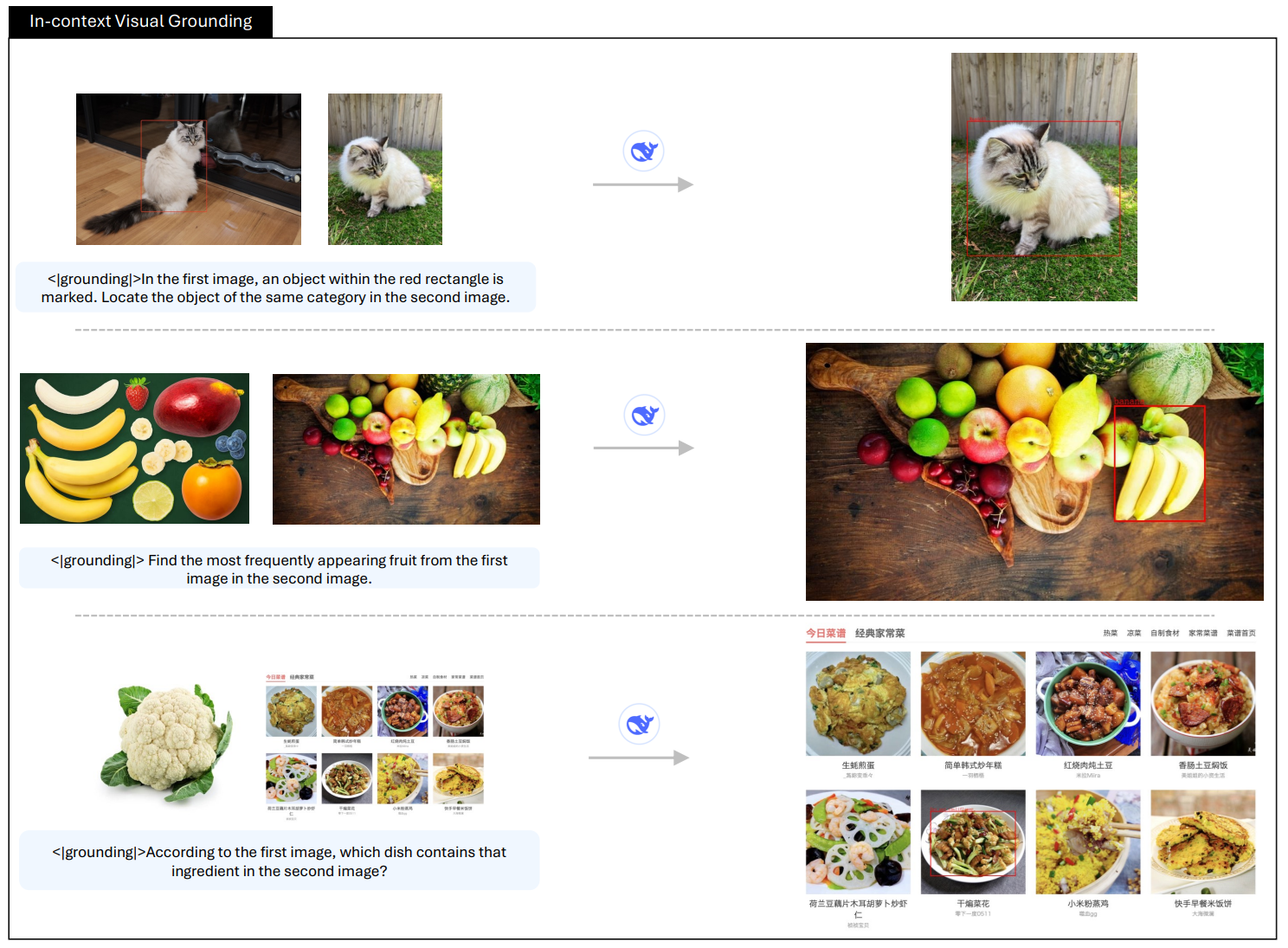

- 이미지 이해와 생성을 하나의 모델로 통합하여 워크플로우를 단순화하려면 Janus-Pro의 분리형 인코딩 아키텍처를 활용해야 한다.

- VLM의 텍스트 기반 좌표 출력을 Roboflow Supervision과 결합하면 별도의 추가 학습 없이도 제로샷 객체 탐지 시스템을 구축할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.