핵심 요약

Intel Core Ultra Series 3 프로세서의 Xe3 아키텍처와 PyTorch 2.10의 XPU 백엔드 통합을 통해 PC 및 에지 기기에서의 AI 성능이 크게 향상되었다. TorchAO 라이브러리를 활용한 저정밀도 양자화 최적화로 Llama 3.1과 같은 대형 언어 모델을 노트북 iGPU에서 효율적으로 구동할 수 있다. 또한 SYCL 기반의 커스텀 연산자 지원과 Anomalib, LeRobot 등 주요 에코시스템의 네이티브 통합으로 제조 및 로보틱스 분야의 온디바이스 AI 학습과 배포가 용이해졌다. 이는 외장 GPU나 클라우드 인프라 없이도 강력한 AI 애플리케이션을 구축할 수 있는 기반을 제공한다.

배경

PyTorch 기본 지식, Intel GPU 드라이버 설치 및 환경 구성, 양자화(Quantization) 개념에 대한 이해

대상 독자

Intel 하드웨어 기반 온디바이스 AI 및 에지 컴퓨팅 솔루션을 개발하는 ML 엔지니어

의미 / 영향

이번 업데이트는 고가의 외장 GPU나 클라우드 의존도를 낮추고, 일반적인 노트북이나 산업용 PC의 내장 그래픽만으로도 고성능 AI 모델의 학습과 추론이 가능함을 보여준다. 이는 데이터 보안이 중요한 제조 현장이나 저전력이 필수적인 로보틱스 분야에서 온디바이스 AI 도입을 가속화하는 계기가 될 것이다.

섹션별 상세

import torch

from transformers import AutoModelForCausalLM, TorchAoConfig

from torchao.quantization import Int4WeightOnlyConfig

model_id = "meta-llama/Meta-Llama-3.1-8B-Instruct"

quant_config = Int4WeightOnlyConfig(

group_size=128,

int4_packing_format="plain_int32"

)

quantization_config = TorchAoConfig(quant_config)

model = AutoModelForCausalLM.from_pretrained(

model_id,

device_map="xpu",

torch_dtype=torch.float16,

quantization_config=quantization_config,

)TorchAO를 사용하여 Llama 3.1 8B 모델을 Int4 양자화로 로드하고 Intel XPU에서 실행하는 예시

from anomalib.data import MVTecAD

from anomalib.engine import Engine, SingleXPUStrategy, XPUAccelerator

from anomalib.models import Patchcore

datamodule = MVTecAD(category="transistor")

model = Patchcore()

engine = Engine(

strategy=SingleXPUStrategy(),

accelerator=XPUAccelerator(),

)

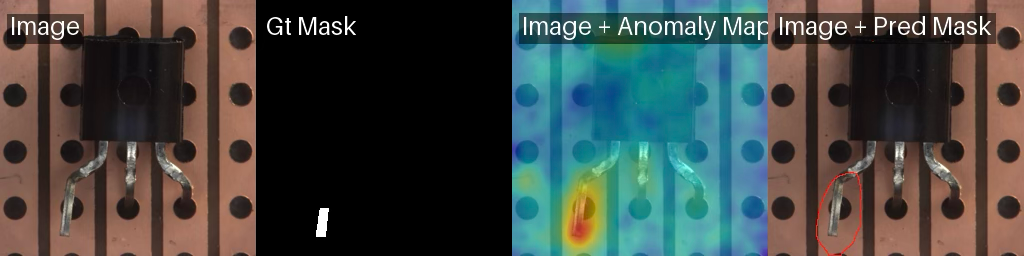

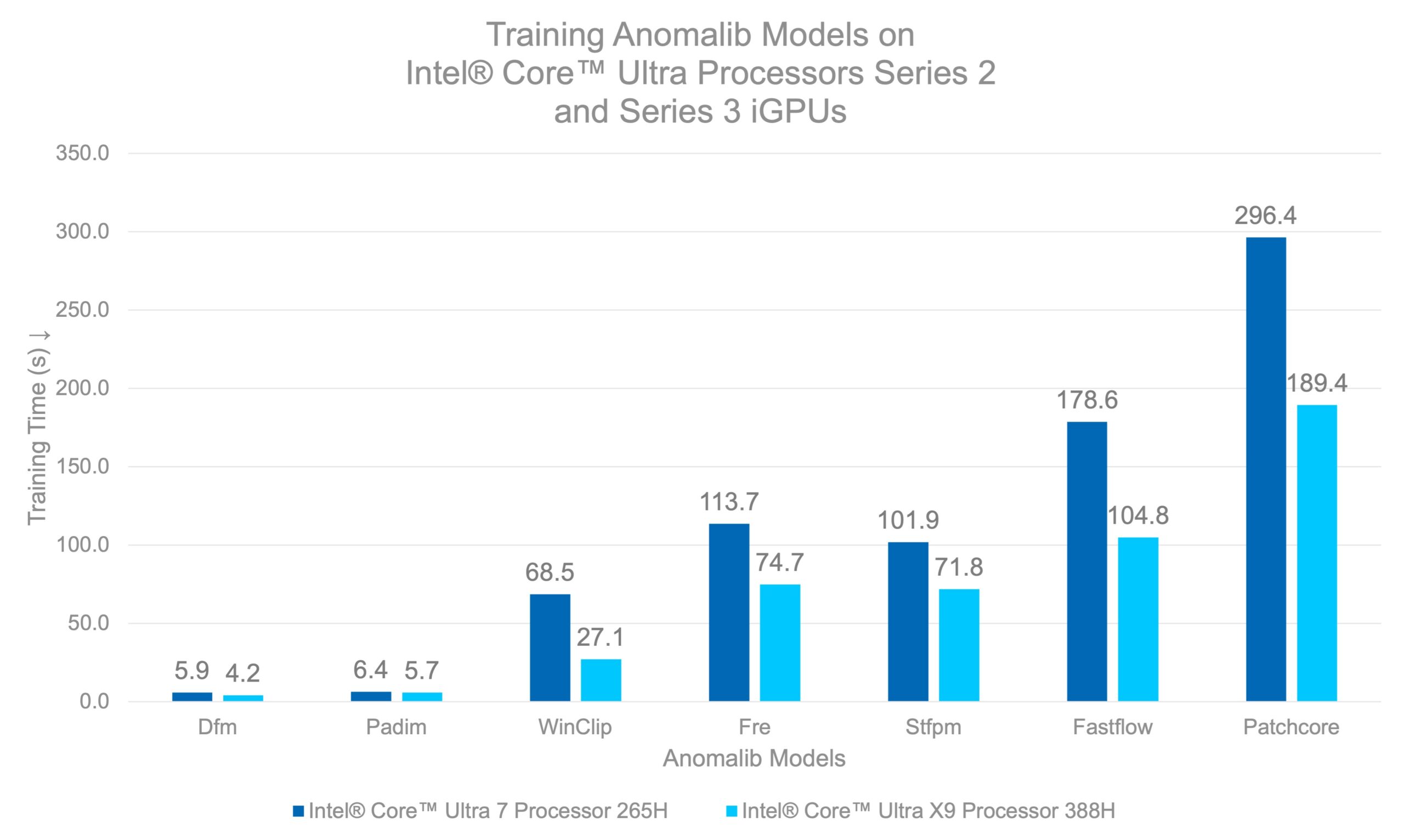

engine.train(datamodule=datamodule, model=model)Anomalib를 사용하여 Intel iGPU에서 Patchcore 이상 탐지 모델을 학습하는 예시

실무 Takeaway

- TorchAO의 Int4WeightOnlyConfig를 적용하면 Llama 3.1 8B 모델을 노트북 iGPU 환경에서 메모리 효율적으로 로드하고 고성능 추론을 수행할 수 있다.

- Anomalib를 사용하면 10줄 미만의 코드로 산업용 이상 탐지 모델인 Patchcore를 Intel iGPU에서 직접 학습시켜 에지 환경의 제조 공정에 즉시 적용 가능하다.

- SYCL 확장을 활용하여 Windows 환경에서도 PyTorch 표준 연산자 이외의 하드웨어 최적화 커널을 개발함으로써 특정 도메인의 성능 병목을 해결할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.