핵심 요약

Stack Overflow는 사용자가 질문을 게시하기 전 품질을 개선할 수 있도록 돕는 '질문 도우미(Question Assistant)'를 도입했다. 초기에는 LLM 단독으로 품질을 평가하려 했으나 일관성 문제로 실패했고, 대신 전통적인 로지스틱 회귀(Logistic Regression) 모델로 특정 결함 지표를 탐지한 뒤 Gemini LLM으로 구체적인 피드백을 생성하는 하이브리드 방식을 채택했다. 이 시스템은 Azure Databricks와 Kubernetes 환경에서 운영되며, A/B 테스트 결과 질문의 성공률(채택 또는 높은 점수)이 12% 향상되는 성과를 거두었다.

배경

머신러닝 기초(로지스틱 회귀, TF-IDF), LLM 프롬프트 엔지니어링, A/B 테스트 개념

대상 독자

LLM 서비스를 프로덕션에 도입하려는 개발자 및 데이터 과학자

의미 / 영향

단순한 챗봇 형태의 AI 도입보다 기존의 검증된 ML 기법과 LLM을 결합하는 것이 서비스의 신뢰도와 실질적인 비즈니스 가치를 높이는 데 유리함을 시사한다. 특히 주관적인 품질 관리가 필요한 커뮤니티 서비스에서 AI를 보조 도구로 활용하는 구체적인 청사진을 제공한다.

섹션별 상세

이미지 분석

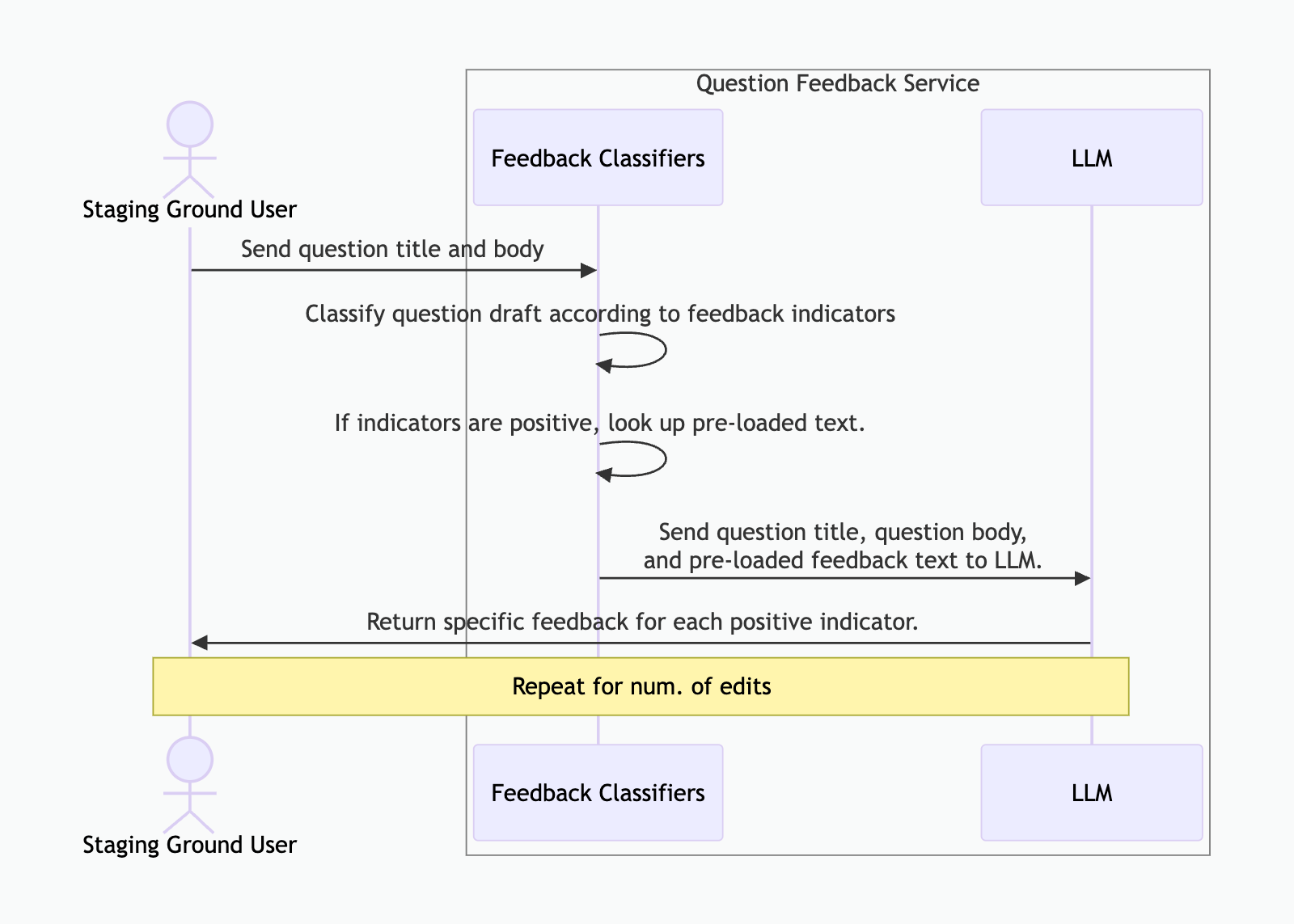

사용자가 질문을 제출하면 피드백 분류기(ML)가 지표를 진단하고, 긍정적인 지표가 발견될 경우 LLM이 맞춤형 피드백을 생성하여 사용자에게 반환하는 전체 워크플로우를 보여준다. 이 과정은 사용자가 질문을 수정할 때마다 반복되어 품질을 점진적으로 개선하는 구조임을 알 수 있다.

질문 피드백 서비스의 작동 과정을 보여주는 시퀀스 다이어그램

실무 Takeaway

- 주관적인 품질 평가는 1-5점의 수치화보다 이진 분류(Binary Classification) 기반의 구체적 결함 지표로 접근하는 것이 모델 성능과 사용자 피드백 측면에서 더 효과적이다.

- LLM의 환각이나 일관성 문제를 해결하기 위해 전통적인 ML 모델을 필터로 사용하고 LLM을 텍스트 합성 도구로 활용하는 하이브리드 구조가 실무 배포에 유리하다.

- 성공 지표 설정 시 초기 가설(리뷰 시간 단축)이 빗나가더라도 데이터 분석을 통해 실제 가치(질문 성공률 향상)를 발견하는 유연한 성과 측정이 필요하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료