핵심 요약

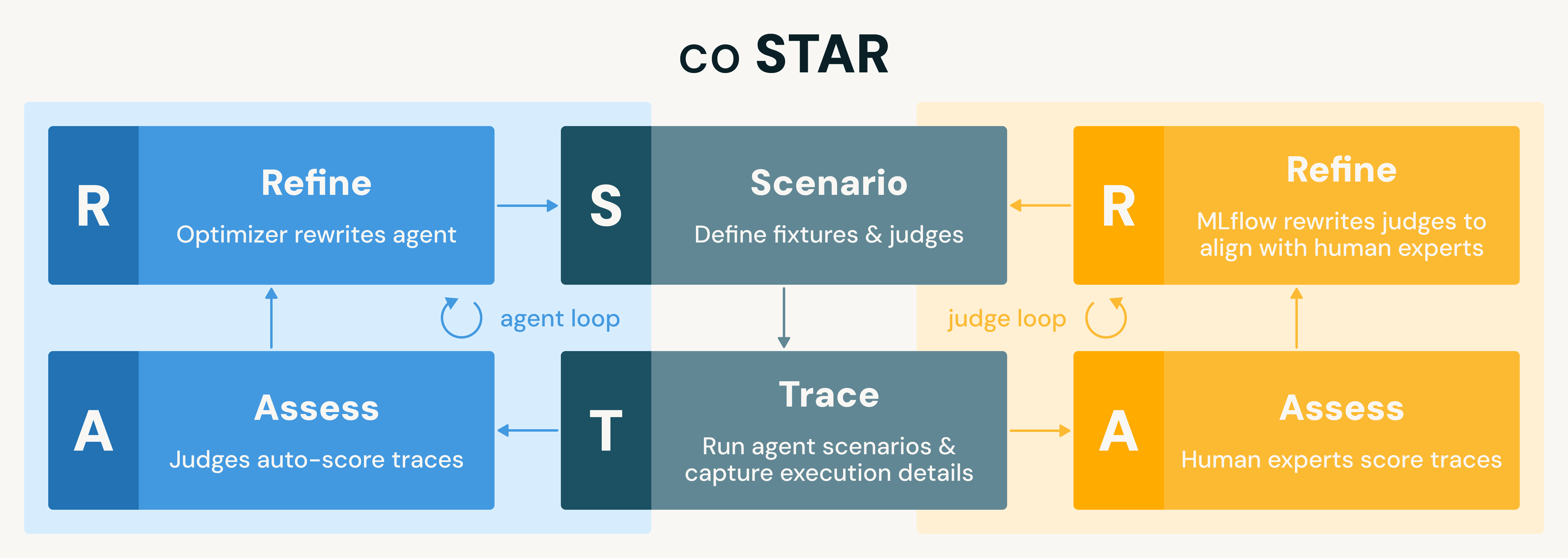

AI 에이전트 개발은 비결정성과 복잡한 실행 과정으로 인해 기존 소프트웨어 테스트 방식을 적용하기 어렵다. Databricks는 이를 해결하기 위해 시나리오 정의(Scenario), 트레이스 캡처(Trace), 판사 모델 평가(Assess), 자동 개선(Refine)으로 구성된 coSTAR 방법론을 제안한다. 이 시스템은 인간 전문가와 판사 모델을 정렬하는 루프와 정렬된 판사를 통해 에이전트를 최적화하는 루프를 결합하여 운영된다. 이를 통해 에이전트 변경 검증 시간을 2주에서 단 몇 시간으로 단축하고 프로덕션 환경의 안정성을 확보했다.

배경

LLM 및 AI 에이전트 기본 개념, MLflow 사용 경험, 소프트웨어 테스트(TDD)에 대한 이해

대상 독자

AI 에이전트를 프로덕션에 배포하고 유지보수하는 MLOps 엔지니어 및 개발자

의미 / 영향

AI 에이전트 개발이 '감(Vibe)'에 의존하던 단계에서 벗어나 자동화된 테스트와 최적화 루프를 갖춘 체계적인 엔지니어링 영역으로 진화하고 있음을 시사한다.

섹션별 상세

{

"name": "messy_data_analyst",

"initial_state": {

"dataset": "dbfs:/samples/messy_data.csv",

"schema": "..."

},

"prompt": "Clean this dataset and identify the top 3 features for predicting churn.",

"expectations": {

"output_exists": true,

"valid_python": true,

"handles_nulls": true

}

}에이전트 테스트를 위해 초기 상태와 성공 기준을 정의한 시나리오 픽스처 예시

실무 Takeaway

- 에이전틱 판사(Agentic Judge)를 도입하여 전체 트레이스를 한 번에 입력하는 대신 필요한 부분만 도구로 조회하게 함으로써 평가 비용을 낮추고 정확도를 높여야 한다.

- 에이전트 실행(Trace)과 평가(Assess)를 물리적으로 분리하여 저장된 트레이스에 대해 다양한 판사 모델을 비용 효율적으로 재시험할 수 있는 구조를 구축해야 한다.

- 개발 단계에서 사용한 판사 모델을 프로덕션 환경의 실시간 트래픽 모니터링에도 동일하게 적용하여 성능 저하나 비용 급증을 조기에 감지하는 통합 파이프라인을 운영해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.