핵심 요약

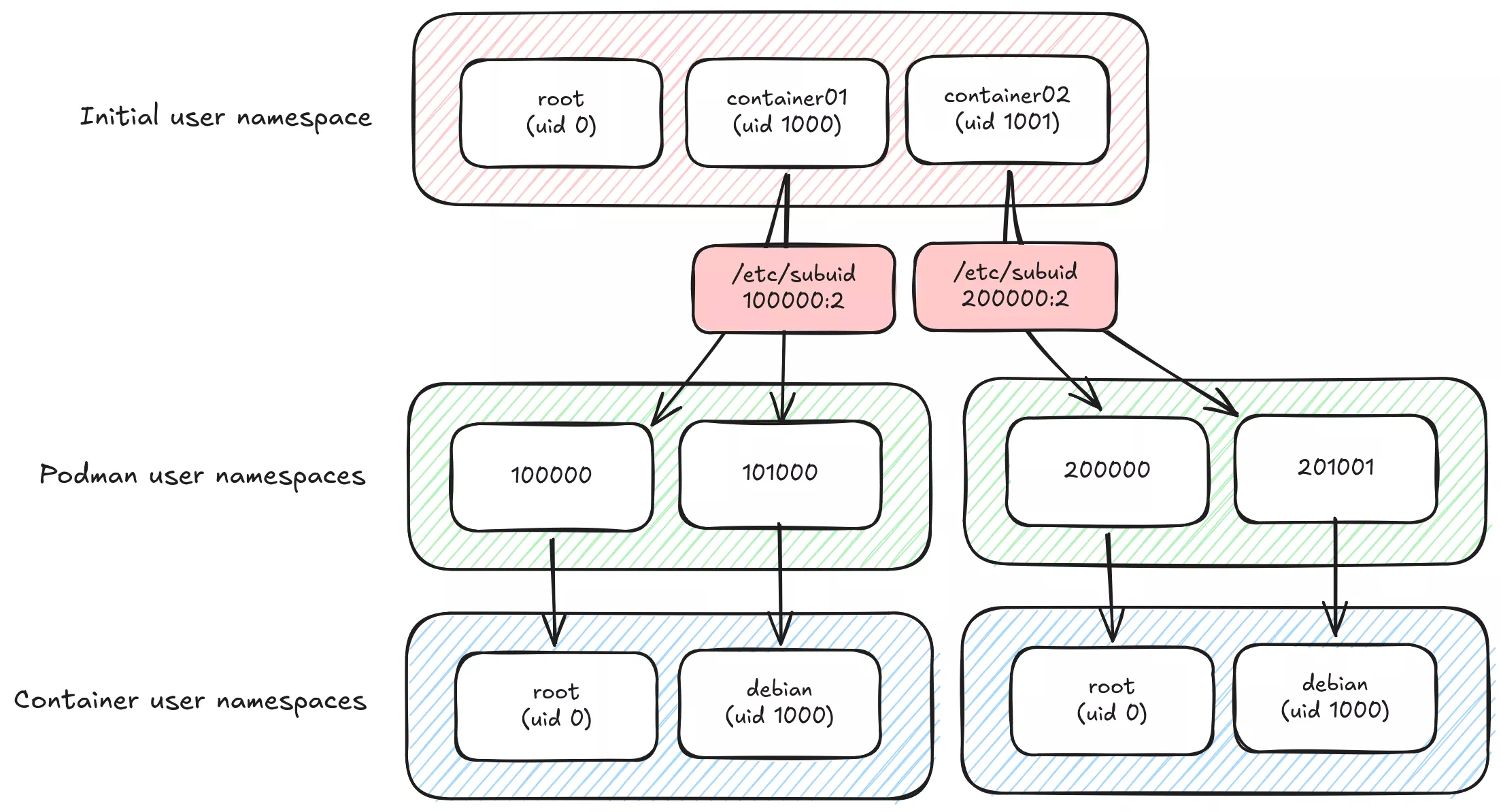

클라우드 LLM 사용 시 발생하는 데이터 유출 우려를 해소하기 위해 기업 내부망에 독립된 LLM 서버를 구축하는 상세 과정을 설명한다. NVIDIA RTX Pro 6000 Blackwell GPU와 llama.cpp를 기반으로, Podman의 루트리스 컨테이너와 사용자 네임스페이스를 활용해 프로세스를 격리한다. 특히 보안 취약점이 될 수 있는 NVIDIA UVM 모듈을 배제하기 위해 Vulkan 백엔드를 도입하고, 장치 파일 권한 제어 및 AppArmor 설정을 통해 보안 계층을 강화한다. 최종적으로 네트워크가 완전히 차단된 상태에서 고성능 추론이 가능한 안전한 인프라를 완성한다.

배경

Linux 시스템 관리 실무 지식, Docker 또는 Podman 컨테이너 기초, NVIDIA 드라이버 및 CUDA 아키텍처 이해

대상 독자

기업용 LLM 인프라를 설계하는 시스템 아키텍트 및 보안 엔지니어

의미 / 영향

이 가이드는 클라우드 AI의 보안 한계를 극복하려는 기업들에게 실질적인 하드웨어 및 소프트웨어 보안 강화 방법론을 제시한다. 특히 Vulkan을 활용한 추론이 CUDA의 강력한 대안이 될 수 있음을 보여줌으로써 AI 인프라의 보안 표준을 한 단계 높이는 데 기여한다.

섹션별 상세

import math

from gguf import GGUFReader

shards = (

"gpt-oss-120b-mxfp4-00001-of-00003.gguf",

"gpt-oss-120b-mxfp4-00002-of-00003.gguf",

"gpt-oss-120b-mxfp4-00003-of-00003.gguf",

)

n_parameters = 0

n_bytes = 0

for path in shards:

reader = GGUFReader(path)

for tensor in reader.tensors:

n_parameters += math.prod(tensor.shape)

n_bytes += tensor.data.nbytes

print(f"{n_parameters=:,}")

print(f"{n_bytes=:,}")GGUF 모델 파일의 텐서 정보를 읽어 실제 모델 가중치가 차지하는 메모리 크기를 계산하는 코드

cmake -B build -DGGML_CUDA=ON -DCMAKE_CUDA_COMPILER=/usr/local/cuda-13/bin/nvcc ./llama.cpp

cmake --build build --config Release

./build/bin/llama-cli --list-devicesCUDA 백엔드를 활성화하여 llama.cpp를 빌드하고 사용 가능한 GPU 장치를 확인하는 과정

map "$request_method:$uri" "$whitelist" {

default 0;

"GET:/" 1;

"GET:/health" 1;

"POST:/chat/completions" 1;

"POST:/v1/chat/completions" 1;

}

upstream container01 {

server unix:/var/lib/containers/container01/socks/llama-cpp.sock;

}

server {

listen 127.0.0.1:80;

location / {

if ($whitelist = 0) { return 403; }

proxy_pass http://container01;

}

}Nginx를 사용하여 허용된 API 경로만 화이트리스트 방식으로 접근을 허용하는 리버스 프록시 설정

[Container]

Image=ghcr.io/ggml-org/llama.cpp:server-vulkan

AddDevice=nvidia.com/gpu=0

Network=none

Volume=/var/lib/models:/models:ro

User=1000

UserNS=keep-id

NoNewPrivileges=true

Exec=--host "/run/llama-cpp/llama-cpp.sock" --model /models/gpt-oss-120b.gguf --ctx-size 504000 --parallel 4Podman Quadlet을 사용하여 네트워크가 차단된 고립된 LLM 컨테이너 서비스를 정의하는 설정

실무 Takeaway

- 데이터 기밀성이 중요한 환경에서는 네트워크가 차단된 온프레미스 서버에 llama.cpp와 Vulkan 백엔드를 조합하여 보안과 성능을 동시에 확보할 수 있다.

- Podman의 루트리스 모드와 사용자 네임스페이스 매핑을 적용하면 컨테이너 환경에서도 호스트 시스템에 미치는 보안 영향을 최소화할 수 있다.

- NVIDIA UVM 모듈은 보안상 위험 요소가 될 수 있으므로, vRAM이 충분한 환경이라면 이를 비활성화하거나 Vulkan 백엔드로 대체하는 것이 권장된다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.